완전 자율주행 자동차 실내 대형 디스플레이에 적합한 제스처 인터랙션 디자인

Copyright Ⓒ 2026 KSAE / 245-04

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

Large displays in fully autonomous vehicles make touch screens hard to use because of reach limits. This study proposes guidelines for gesture interaction with front large displays. A prototype system was built and tested in usability studies that considered in-vehicle activities, age groups, and gender. Quantitative results on satisfaction and workload (NASA-TLX) indicate that default gestures for each function should be familiar and require low physical and mental effort. To improve accessibility, alternative gestures should be available for users with hand tremors or discomfort linked to specific gestures. Interviews on preferred gestures for each function complemented the analysis. Based on these findings, final guidelines for adaptive gesture interaction in fully autonomous vehicles are presented.

Keywords:

Gesture interaction, Fully autonomous vehicle, Large displays, Usability evaluation, Human-machine interface키워드:

제스처 인터랙션, 완전 자율주행 자동차, 대형 디스플레이, 사용성 평가, 인간 기계 상호작용1. 서 론

최근 자율 주행에 대한 상업적 및 학계의 관심이 엄청나게 증가하였으며 전문가들은 완전 자율주행 자동차(FAV: Fully Autonomous Vehicle) 도입이 30~50년 내에 점진적으로 이루어질 것으로 예상한다.1) FAV 내에서 운전자는 여러 활동을 수행할 수 있으며 그 활동에 완전히 집중할 수 있다.2) 최근 시중에 출시되어 있는 차량들은 아래 Fig. 1의 왼쪽 이미지와 같이 대부분 운전석에서 손이 닿는 거리에 있는 전방 대시보드 디스플레이와 터치 인터랙션을 할 수 있다.3) 하지만 Fig. 1의 오른과 같이 2030년 전후를 예상으로 하는 컨셉카 및 자율주행 전기 택시와 같은 미래의 차량은 기존의 터치 인터랙션 방식으로 전방 대시보드에 위치한 디스플레이와 인터랙션하기 어려운 등 많은 변화를 겪고 환경이 많이 달라지기 때문에 전방의 터치 인터렉션 외에도 적합한 인터랙션이 필요한 시점이다. 운전자들은 이제 차량 내 인터페이스 내에서 최신 스마트폰의 다양한 기능을 재현하는 CarPlay나 Android auto와 같은 복잡한 다기능 인포테인먼트 시스템과 상호 작용할 수 있다.4) 이러한 시스템과 상호작용하기 위한 인터랙션 방식 중 하나인 제스처 인터랙션은 사용자가 화면이나 특정 물리적 제어 장치를 찾을 필요가 없다는 장점이 있다.5) 또한 제스처 인터랙션은 위생적 이점도 있으며 멀리서 인터랙션이 가능하다.6) 그로 인해 중앙 디스플레이에 국한되지 않고 차량 내부 전체에서 인터랙션이 가능하며, 이는 향후 자율주행 자동차에서 좌석 배치에 더 큰 유연성을 제공하고 사교, 업무 및 휴식을 위한 더 많은 시간을 얻을 수 있도록 지원한다.7) 현재까지 제스처 인터랙션 기술이 많이 발전해 왔으나 몇 가지 과제는 여전히 남아 있다. 제스처 방식에 따라 사용자가 느끼는 직관성, 익숙함 등의 정도가 다르다는 피드백이 있음에 따라 인체공학적 고려가 필요하다.8) 더욱이 운전으로부터 자유로운 실내활동이 이루어지는 FAV 실내 환경에서 대형 디스플레이와의 인터랙션에 있어서 남성과 여성, 다양한 연령층을 아우르는 적합한 제스처 인터랙션 디자인이 필요하다. FAV의 대형 디스플레이는 홈 엔터테인먼트 환경의 TV와 유사한 상호작용 경험을 제공한다. 관련 연구들은 키넥트(Kinect)나 립모션(Leap motion) 같은 제스처 인식 장비를 활용해 TV 기능에 대한 직관적인 제스처를 발굴하고 그 동의율을 검증했다. 일부 연구에서는 핸드헬드(Wii 리모컨) 및 프리핸드(Kinect) 제스처의 선호도를 비교하여, 기능별로 더 적합한 인터랙션 방식이 존재함을 확인하였다.9-11) 이는 다른 인터랙션 방식과 상호보완하는 방향으로 제스처 인터랙션 방식이 잘 개발되는 것과 실제 자율주행 차량 실내 환경에서 적합한 제스처 인터랙션 디자인에 대한 실증 연구가 필요함을 시사한다. 이에 따라 FAV 내 전방 디스플레이와의 제스처 인터랙션 수행이 가능한 실험 환경을 구축하여 실내 행위 및 연령대, 성별에 따라 사용성 테스트를 실시하였다. 제스처 인터랙션의 만족도 및 작업부하(NASA-TLX)에 대한 정량적 분석을 실시하였으며 특정 기능에 따라 최종적으로 선호하는 제스처 방식에 대한 인터뷰의 정성적 분석까지 실시한 결과까지 반영하여 제스처 인터랙션 가이드라인을 제안하였다.

2. 선행연구 검토

제스처 인터랙션은 운전자가 직접 운전하는 차량에 대한 연구들 및 자율주행 상황을 가정한 차량에 대한 연구들이 이루어져 왔다. 먼저 운전자가 직접 운전하는 차량에 대한 연구들에 대해서는 운전 중 인포테인먼트 시스템 사용으로 인한 인지 부하 감소 및 안전성 향상을 위해 제스처 인터랙션에 청각 피드백을 결합한 멀티모달 인터랙션 사용성 평가,12,13) 제스처 인터랙션을 포함한 인포테인먼트 시스템의 안전성 측면에서 이루어진 연구들에 대한 문헌 분석,14) 제스처 복합 센싱 모션인식 방법,15) 가상환경 주행시뮬레이터 환경에서의 제스처 사용에 따른 특성16) 등의 연구가 있었다. 여러 연구에서 청각 패드백과 제스처 인터랙션이 결합된 멀티모달 인터페이스의 성능을 분석했다. 한편, VUI(Voice User Interface)의 한계를 바탕으로 스티어링 휠 제스처 입력이 청각 피드백과 결합하여 인지적 작업 부하를 줄이면서 인터랙션 효율성을 개선할 수 있음을 보여주었다.17) 또한, 많은 연구가 시뮬레이션 환경에서 수행되어 실제 주행 환경의 복잡성을 반영하지 못하는 문제점이 지적되었다. 따라서 실제 주행 환경의 다양하고 예측할 수 없는 상황에서 IVIS(In-Vehicle Infortainment System)의 성능을 평가할 수 있는 개선된 연구 방법론이 요구되며 증강 현실 헤드업 디스플레이를 통해 운전자가 시선을 도로에 유지하면서 중요한 정보를 쉽게 확인하도록 하는 인터페이스 설계가 필요하다고 하였다.14) 그 외에 제스처 인터랙션을 수행하는데 있어서 대시보드에 배치된 센서가 사용자 불편을 초래할 수 있어 암레스트와 기어 레버 사이에 센서를 배치함으로써 문제를 개선한 사례가 있었다.18)

그리고 자율주행 상황을 가정한 차량에 대한 연구로는 자율주행 자동차 내 시스템과의 인터랙션,8,19) 자율주행 자동차를 제어할 수 있는 제스처에 대한 사용성 평가20) 등이 이루어져 왔다. 이 연구들에 따르면 참가자들은 차량과 인터랙션을 하는데 있어서 휴식을 취할 때보다 비디오를 시청하고, 식사하고, 노트북에서 작업하는 동안 손 제스처를 상당히 선호하였으며 휴식을 취할 때 운전자는 손 움직임과 같은 신체 활동을 하고 싶어하지 않았다.19) 자동차 앞유리를 디스플레이로 활용하여 이에 대한 인터랙션 방식으로 제스처 인터랙션과 트랙패드 인터페이스와 비교한 연구에서는 제스처 인터랙션 방식이 더 피로도를 느꼈으나 더 사용자 친화적이고 매력적이라는 피드백을 얻었다.8) 자율주행 자동차를 제어할 수 있는 제스처에 대한 사용성 평가 연구에서는 멀티미디어 시스템의 제스처 제어와 달리, 손 제스처 인식 오류 등 잘못된 조작은 차량 운전자와 탑승자에게 부정적인 영향을 미칠 수 있기 때문에 모든 참가자가 제스처 내비게이션 시스템 사용의 안전성에 대해 큰 우려를 표명하였다.20)

요약하자면, 운전자가 직접 운전하는 차량에 대한 연구에서는 운전자 작업 부하 감소, 안전성, 제스처 사용의 편의성 등에 주로 초점이 맞추어진 연구들이 많이 이루어졌으며 실제 주행 상황을 고려한 연구의 필요성, 제스처 인식의 정확성 등이 언급되었다. 그리고 완전 자율주행 상황을 가정한 차량에 대한 제스처 인터랙션 연구들은 아직 많이 이루어지지 않았다. FAV 실내에서의 제스처 인터랙션 연구는 운전중인 운전자의 시각적 산만함을 줄여야 하는 부분을 고려하지 않아도 되며 실제 주행이 아닌 시뮬레이션 환경에서도 충분한 연구의 의의를 가진다. 현재 완전 자율주행 상황에서 인포테인먼트 시스템과의 제스처 인터랙션 디자인에 관한 연구가 많지 않으며 제스처 사용시 사용자의 실내 행위가 고려된 연구는 없기에 이는 본 연구의 주요 기여이다.

3. 연구 방법

3.1 실험 참여자

FAV 실내 환경에서 대형 디스플레이와의 인터랙션에 있어서 남성과 여성, 다양한 연령층을 대상으로 적합한 제스처 인터랙션에 대하여 조사하기 위해 연구에 참여한 인원은 총 30명이었다. 그리고 FAV에서 각 상황에 따라 전방 와이드 스크린 디스플레이와 인터랙션하는 가운데 성별 및 연령대별로 나타나는 특이사항을 조사하기 위해 남성과 여성은 각각 15명, 그리고 20대부터 60대까지 연령대별로 각각 6명씩 동일한 비율로 피험자를 모집하였다(Table 1). 각 피험자별로 실험은 약 1시간 정도 진행되었으며 실험 종료 후 모든 참가자는 연구 참여 대가로 3만원을 받았다.

3.2 실험에 사용된 실내 행위 종류와 기능 및 제스처 종류

문헌 분석을 통해 다음과 같이 실내 행위 종류, 인포테인먼트 시스템의 기능 및 제스처 종류를 최종적으로 선정하였다. 운전기사가 운전하는 차량 내 활동이 FAV 내 활동과 상관관계가 높다는 연구 결과21)에 따라 실험 내용에 포함될 실내 행위 종류는 대중교통을 이용하는 동안 이루어지는 실내 행위들에 대해 연구 결과들22,23)을 참고하여 선정하였다. 양손이 자유로운 휴식 상태, 그리고 대중교통 이용 시 ICT 장치 사용이 주로 많이 이루어진다는 결과에 따라 스마트폰 사용 상태 총 2가지로 정하였다.

실험에 사용할 기능 및 제스처 종류 선정을 위해 참고한 각 문헌에서의 제스처 실험 환경은 본 연구와 다른 점들이 존재한다. 따라서 특정 기능에 대한 제스처 동작들에 대한 평가 결과를 모든 상황에 동일하게 적용하기는 쉽지 않다. 그럼에도 불구하고 다른 실험 환경을 감안하고 여러 참가자들이 특정 작업에 대해 같거나 유사한 제스처를 제안하는 정도를 측정하는 동의율, 특정 제스처가 주어진 작업에 얼마나 적절한지를 측정하는 수용률, 제스처 수용 지표인 a-index 등이 평균 이상으로 우수한 연구결과들9,11,24-30)을 참고하여 실험에 사용할 기능들에 대한 제스처 동작들을 선정하였다. 총 200편 이상의 문헌을 살펴본 후 추려낸 120편 이상의 문헌을 연구하여 90가지 이상의 기능들과 650건 이상의 제스처 동작들을 확인 하였다. 그 중 실험에 사용할 유튜브 동영상 시청에 있어서 필요한 4가지 주요 기능들31)을 선정한 후 각 기능별로 2가지씩, 총 8가지의 제스처 동작들을 최종적으로 선정하였다.

3.3 실험 장비

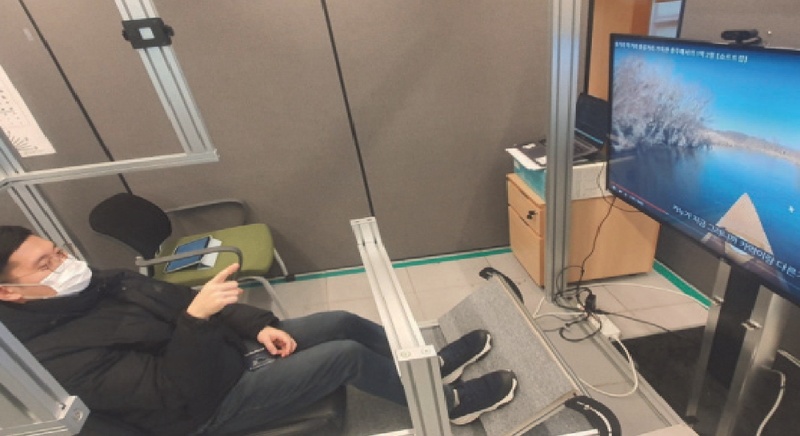

아래 Fig. 2와 같이 피실험자가 앉을 자동차 시트, 전방 디스플레이, 제스처 동작 인식을 위한 웹캠을 사용하였으며 Fig. 3과 같이 전방 와이드스크린 디스플레이와 인터랙션할 수 있는 환경을 구축하였다.

3.4 제스처 인터랙션 시스템 구현

제스처 인터랙션 시스템 구현을 위해 Visual studio code 프로그램을 사용하였으며 프로그래밍 언어는 Python(3.7.9 버전)을 사용하였고 구글 AI 프레임워크인 미디어파이프(MediaPipe)를 다운로드 및 설치하여 사용하였다. 구현된 제스처 동작들은 유튜브(Youtube) 동영상 재생 환경에서 사용되었다.

3.5 설문 문항

실험이 시작되기 전 실험 참여자의 인구통계학적 정보를 조사했다. 모든 참가자는 사전 동의를 받았으며 연구에 참여하기로 자원했다. 이 연구는 헬싱키 선언의 윤리적 권고에 따라 수행되었다. 또한 본 연구는 승인번호 KMU-202311-HR-383으로 국민대학교 기관생명윤리위원회(KMUIRB)의 승인을 받은 후 수행되었다. 제스처 실험을 진행하는 동안 실험 참여자는 한 가지 기능에 대해 태스크를 마칠 때마다 설문 및 인터뷰를 진행하였다. 객관식 설문 문항은 특정 실내 행위에 따라 사용하는 기능에 대해 사용하는 제스처 각각에 대하여 전반적 만족도 리커트 7점 척도 문항,32) 작업 부하(NASA-TLX) 7점 척도 문항33)에 대해 답변하였다. 주관식 설문 문항은 한 가지 기능에 대해 두 가지 제스처를 수행한 후 둘 중 더 선호하는 제스처를 선택하게 한 후 그 이유에 대하여 답변하였다.

3.6 데이터 분석

먼저 아래와 같이 제스처 인터랙션의 만족도, 작업부하(NASA-TLX) 데이터의 통계적으로 유의미한 차이가 있는지 여부에 대하여 귀무가설과 대립가설을 설정하였다.

● 성별 분석

- - 귀무가설(H0): 전방 대형 디스플레이 제스처 인터랙션의 만족도는 남성과 여성간 차이가 없다.

- - 대립가설(H1): 전방 대형 디스플레이 제스처 인터랙션의 만족도는 남성과 여성간 차이가 있다.

- - 귀무가설(H0): 전방 대형 디스플레이 제스처 인터랙션의 작업 부하(NASA-TLX)는 남성과 여성간 차이가 없다.

- - 대립가설(H1): 전방 대형 디스플레이 제스처 인터랙션의 작업 부하(NASA-TLX)는 남성과 여성간 차이가 있다.

통계분석을 진행함에 있어 남성, 여성 각 집단의 수가 30명을 넘지 않는 관계로 비모수 통계 분석 방법인 Mann whitney U test 방법으로 분석하였다.

● 연령대별 분석

- - 귀무가설(H0): 전방 대형 디스플레이 제스처 인터랙션의 만족도는 연령대별 차이가 없다.

- - 대립가설(H1): 전방 대형 디스플레이 제스처 인터랙션의 만족도는 연령대별 차이가 있다.

- - 귀무가설(H0): 전방 대형 디스플레이 제스처 인터랙션의 작업부하(NASA-TLX)는 연령대별 차이가 없다.

- - 대립가설(H1): 전방 대형 디스플레이 제스처 인터랙션의 작업부하(NASA-TLX)는 연령대별 차이가 있다.

통계분석을 진행함에 있어 20대, 30대, 40대, 50대, 60대 이상 각 집단의 수가 30명을 넘지 않는 관계로 비모수 통계 분석 방법인 Kruskal wallis H test 방법으로 분석하였다. 데이터의 신뢰성 분석은 0에서 1 사이의 범위를 갖는 크론바 알파를 사용하여 평가되었다. 분석 프로그램은 SPSS를 사용하였으며 그 결과 138개 설문지 문항에 대한 크론바 알파 값이 0.932인 것으로 나타나 신뢰성이 있는 것으로 확인되었다.

녹음된 인터뷰는 직접 전사작업하는 과정을 거친 후 귀납적 주제 분석 접근법34)으로 분석되었다. 전체 기록을 반복적으로 읽으면서 데이터에 익숙해진 후 초기 코드를 생성하고 인터뷰에서 여러 패턴을 식별한 후 주제를 생성하였다. 그 후 사용된 기능 및 기능별로 사용된 제스처 종류 카테고리별로 그룹화 하였다. 그리고 일부 대표적인 인용문(Quotations)을 사용하여 연구 결과를 뒷받침하였다.

4. 데이터 분석 결과

4.1 제스처 인터랙션 만족도 전체 평균값 분석 및 최종 선택

제스처 인터랙션 만족도 전체 평균값 및 최종 선택을 분석해 보았을 때, 먼저 재생/일시정지 및 볼륨조절 기능은 각각 검지손가락을 사용하는 Push point, Move index finger 제스처가 휴식, 스마트폰 사용 상황에서 모두 만족도 및 최종 선택 횟수도 높았다. 다음/이전 기능에서는 Hand swipe 제스처가 Palm swipe 제스처에 비해 휴식, 스마트폰 사용 상황에서 모두 만족도 및 최종 선택 횟수가 높았다. 유독 Hand swipe 제스처와 Palm swipe 제스처의 만족도 차이가 크게 났는데 이는 다음/이전 기능에 대한 Palm swipe 제스처 동작 선정을 위해 참고한 문헌들에서 특정 기능에 대한 제스처 동작 유도(Elicitation) 연구만 진행했거나24) Wizard of oz 방법을 사용하는 등29) 본 연구와 다른 실험 환경이 영향을 준 것으로 파악된다. 이러한 결과는 높은 동의율을 얻었던 이전 연구 결과를 그대로 적용할 수 없으며 FAV 내 대형 디스플레이와의 인터랙션에 있어서 사용자에게 적합한 제스처 인터랙션 디자인을 위해 본 연구가 필요한 이유를 뒷받침한다. 탐색 기능의 경우에는 휴식 상태에서 Pinch and move 제스처가 Move index finger 제스처보다 만족도가 높고 최종 선택 횟수도 높았으나 스마트폰 사용 상태의 경우 Pinch and move 제스처가 만족도가 더 높았음에도 불구하고 최종 선택 횟수는 Move index finger 제스처가 더 높았다. 이는 특정 제스처에 대한 만족도가 실질적인 최종 선택과 항상 일치하지만은 않음을 나타내며 인터뷰 내용을 참고해 보았을 때 Pinch and move 제스처가 재미는 있었으나 편하게 사용하기는 Move index finger 제스처가 좋다는 의견이 있었다(P16).

● P16(40대 여성): 이렇게 약간 뭐 지퍼락 이렇게 딱 잠그듯이 그런 느낌이 들어서 되게 재미는 있었는데 실제로 그냥 편하게 쓰기에는 이게(Move in-dex finger) 매번 쓰는 제스처다 보니까 Move index finger 제스처가 훨씬 편하고 의식 없이 하기도 빠를 것 같고...

4.2 연령대별 분석

특정 실내행위에 따라 사용되는 기능에 대한 제스처 인터랙션의 연령대별 만족도 평균값을 분석해 보면 먼저 재생/일시정지 기능에 대해 휴식, 스마트폰 사용 시 Push point 제스처, 다음/이전 기능에 대하여 휴식, 스마트폰 사용 시 Hand swipe 제스처가 전 연령대 그룹에서 선호되었다. 그리고 탐색 기능에 대해서는 휴식 상태일 때 60대 이상, 스마트폰 사용 시 40대 그룹을 제외하고는 모두 Pinch and move 제스처에 대한 만족도가 더 높았다. 특정 실내행위에 따라 사용되는 기능에 대한 제스처 인터랙션 만족도 평균값은 연령대간에 통계적으로 유의미한 차이는 없는 것으로 나타났다.

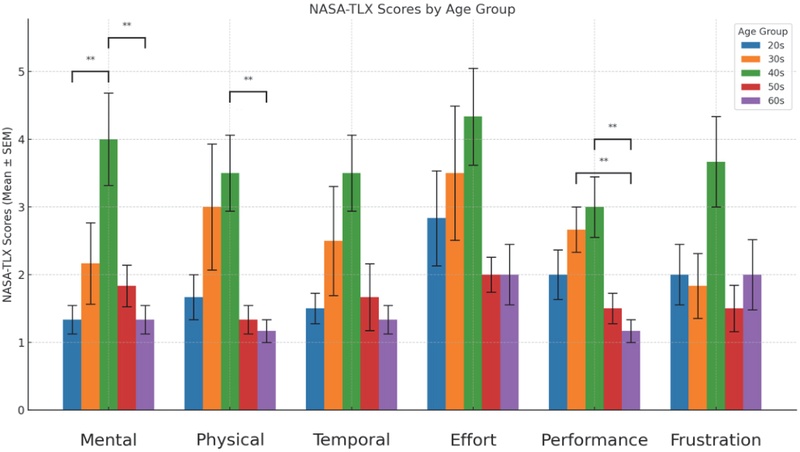

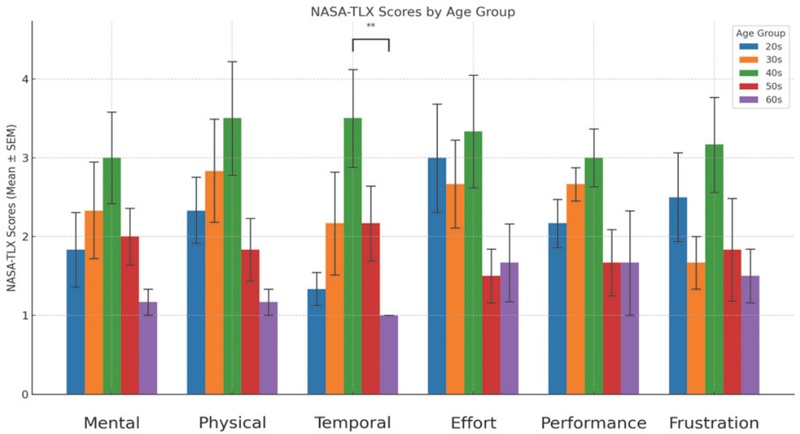

다음으로 특정 실내행위에 따라 사용되는 기능에 대한 제스처 인터랙션 작업부하(NASA-TLX) 평균값의 연령대별 차이를 분석하기 위하여 Kruskal wallis H test로 분석해 본 결과 유의수준(⍺=0.05)보다 P-value값이 낮은 항목들이 있었다. 이에 따라 귀무가설(H0)인 ‘전방 대형 디스플레이 제스처 인터랙션의 작업부하(NASA-TLX)는 연령대별 차이가 없다.’를 기각하며 대립가설(H1)인 ‘전방 대형 디스플레이 제스처 인터랙션의 작업 부하(NASA-TLX)는 연령대간 차이가 있다.’를 채택한다. 먼저 휴식 상태에서 볼륨조절 기능의 Move index finger 제스처 NASA-TLX mental 점수에서 40대가 20, 60대보다 유의미하게 높았으며(p=0.019), NASA-TLX physical 점수에서 40대가 60대보다 유의미하게 높았고(p=0.025), NASA-TLX performance 점수에서 30, 40대가 60대보다 유의미하게 높았으며(p=0.004), 휴식 상태에서 볼륨조절 기능의 Move palm 제스처 NASA-TLX temporal 점수에서 40대가 60대보다 유의미하게 높았다(p=0.008). 항목별 NASA-TLX 점수 평균값 또한 40대가 타 연령대에 비해 가장 높았다. 이와 관련하여 40대의 휴식 상태에서 볼륨조절 기능 사용에 관한 인터뷰 내용을 분석해 본 결과 Move index finger 제스처를 수행할 때 손을 쥐어야 하는 부담이 있고 수전증으로 인한 불편이 있으며(P1, P30), Move palm 제스처와 같이 평소에 익숙하지 않은 동작으로 인한 신체적 불편함(P5), 다른 활동과 병행할 때의 집중력 분산(P16), 그리고 트라우마가 있어서 Move index finger 제스처로부터 오는 부정적인 심리(P29) 등이 있었던 것으로 나타났다.

● P30(40대, 여성): 이렇게 하니까 약간 조금 디테일한 게 손가락이 떨리는 게...제가 수전증이 있어가지고 이렇게 폈을 때 이렇게 오르락내리락하기 요거보단 사실 이게 더 편했던 것 같습니다.

● P16(40대, 여성): 이거를 제가 실제로 카톡을 주고받고 있었거든요. 그러면서 이걸 하니까...신경이랑 이런게 쓰이는 거예요. 그리고 그게 잘 되고 있나...신경이 쓰였죠.

● P29(40대, 남성): 검지손가락으로 이렇게 위아래로 하면은 좀…위압감을 느끼고...기분이 나쁠 것 같아요...난 트라우마가 생겨났고...위화감이 있어 나는...

4.3 성별 분석

특정 실내행위에 따라 사용되는 기능에 대한 제스처 인터랙션의 성별 만족도 평균값을 분석해 보면 먼저 휴식, 스마트폰 사용 상태에서 재생/일시정지 기능에 대해서는 Push point 제스처, 다음/이전 기능에 대해서는 Hand swipe 제스처를 남성, 여성 모두 선호하였다. 그리고 볼륨조절 기능에 대해서는 휴식 상태에서 Move palm 제스처가 남성에게 더욱 선호되었으며 여성의 경우 Move index finger 제스처를 더 선호한 것으로 나타났다. 하지만 스마트폰 사용 상태에서는 남성과 여성 모두 Move index finger 제스처를 선호하였다. 탐색 기능에 대해서는 휴식, 스마트폰 사용 상태 모두 Pinch and move 제스처가 남성과 여성 모두 선호하는 것을 알 수 있었다. 특정 실내행위에 따라 사용되는 기능에 대한 제스처 인터랙션 만족도 평균값은 남성과 여성간 통계적으로 유의미한 차이는 없는 것으로 나타났다.

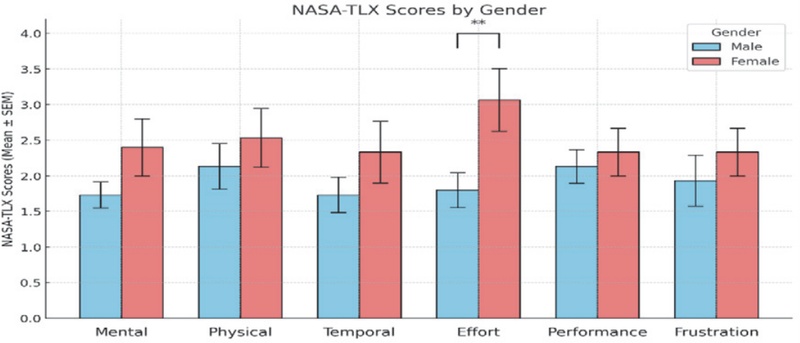

NASA-TLX scores for move index finger gesture in volume control during resting state by gender group

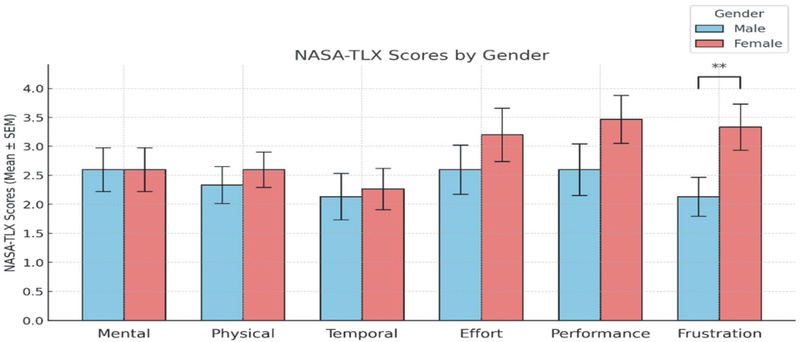

NASA-TLX scores for pinch and move gesture in the seek function during resting state by gender group

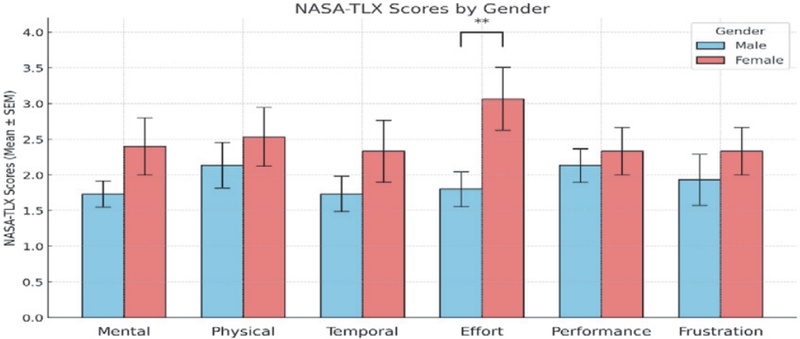

다음으로 특정 실내행위에 따라 사용되는 기능에 대한 제스처 인터랙션 작업부하(NASA-TLX) 평균값의 성별 차이를 분석하기 위하여 Mann whitney U test로 분석해 본 결과 유의수준(⍺=0.05)보다 P-value값이 낮은 항목들이 있었다. 이에 따라 귀무가설(H0)인 ‘전방 대형 디스플레이 제스처 인터랙션의 작업부하(NASA-TLX)는 남성과 여성간 차이가 없다.’를 기각하며 대립가설(H1)인 ‘전방 대형 디스플레이 제스처 인터랙션의 작업 부하(NASA-TLX)는 남성과 여성간 차이가 있다.’를 채택한다. 먼저 휴식 상태에서 볼륨조절 기능의 Move index finger 제스처 NASA-TLX effort 점수가 여성이 남성보다 유의미하게 높았으며(p=0.04), Move palm 제스처 NASA-TLX effort 점수가 여성이 남성보다 유의미하게 높았고(p=0.045), 휴식 상태에서 탐색 기능의 Pinch and move 제스처 NASA-TLX frustration 점수가 여성이 남성보다 유의미하게 높았다(p=0.02). 여성이 유의미하게 NASA-TLX 항목들의 평균값이 높았던 것과 관련하여 휴식 상태에서의 볼륨 조절 기능과 탐색 기능 사용에 관한 인터뷰 내용을 분석해 본 결과 수전증 등의 질환이 있는 경우 Move index finger 제스처 수행에 어려움이 있었다(P11, P21, P30). 그리고 익숙하지 않은 제스처에 대해 불편함을 표현했으며(P5, P27) 특히 손을 크게 움직이거나 손바닥을 펴는 동작이 불편하고 신경이 쓰인다고 하였다(P6, P16, P26). 또한 새롭고 익숙하지 않은 제스처에 대해 낯설음과 불편함을 느꼈으며(P10, P27) 추가적인 동작이 필요하거나 학습이 필요한 제스처는 귀찮고 번거롭다고 느꼈다(P16, P18, P30).

● P11(30대, 여성): 저는 손이 조금 떨리는 편인데 그러면 저 같은 경우는 손바닥에 훨씬 더 집중해서 올리기가 쉽거든요.

● P5(40대, 여성): 이거는 평소에 익숙하지 않은 동작이라서···손목에 힘을 주게 돼서 저도 모르게 불편한 감이 있구요···생각보다 조금 많이 손을 많이 올려야 되는 불편함이 좀 있는 것 같아요.

● P18(60대, 여성): 이제 내가 만약에 이걸 한다면, 이렇게 해서 한다는 걸 외워야 되잖아요. 그게 좀 단순한 게 좋은 거 같아.

5. 제스처 인터랙션 가이드라인

본 연구 결과 완전 자율주행 자동차 내 대형 디스플레이에 적합한 제스처 인터랙션 디자인을 위해 실내 행위, 성별, 연령대별 사용성 테스트를 실시할 필요가 있었음을 시사한다. 이러한 실증적 결과를 바탕으로 완전 자율주행 자동차 내 대형 디스플레이에 적합한 제스처 인터랙션 가이드라인을 다음과 같이 제안한다(Table 7).

6. 결론 및 향후 연구

본 연구는 FAV 내 전방 디스플레이와의 제스처 인터랙션을 위한 프로토타입을 구축하여 실내 행위 및 연령대, 성별에 따라 사용성 테스트를 실시하여 제스처 인터랙션 가이드라인을 제시하는 것을 목표로 하였다. 연구 결과, 사용자들은 익숙하지 않거나 신체적 부담이 큰 제스처에 대해 불편함과 높은 작업부하를 느끼는 것으로 나타났다. 특히 수전증과 같은 질환 보유자나 특정 동작에 트라우마가 있는 사용자들은 특정 제스처에 대해 어려움을 겪는다는 점을 확인했다. 이는 특정 기능에 대한 기본 제스처는 평소에 익숙하고 신체적, 정신적 부담이 적은 동작으로 설정하되, 질환이나 트라우마 등 부정적 요인을 유발하지 않도록 대체 제스처 옵션을 함께 제공해야 함을 시사한다. 이러한 정량적, 정성적 분석 결과를 종합하여 최종적으로 제스처 인터랙션 디자인 가이드라인을 제안할 수 있었다. 본 연구는 몇 가지 제한점을 가지며, 이는 향후 연구를 통해 보완할 필요가 있다. 첫째, 제스처의 장기적인 학습 효과를 검증하지 못했다. 향후 장기간의 연구를 통해 사용자 만족도의 변화를 파악해야 한다. 둘째, 수전증 등 질환 보유자 그룹을 명확히 분류하여 이들 집단에 대한 심층적인 분석을 수행할 필요가 있다. 셋째, 더 다양한 실내 행위 조건과 많은 피험자를 대상으로 연구를 진행하여 결과를 더욱 일반화해야 한다.

Acknowledgments

본 연구는 한국연구재단(2022S1A5B5A17047746, 자율주행차량 전방 와이드 스크린 디스플레이에 대한 상황별 제스처 컨트롤 방식 선호도 연구)과 산업통상자원부 한국산업기술평가관리원 자동차산업핵심기술개발사업(20018907, 가변형 디스플레이 및 친환경 소재 적용 자율주행 칵핏 모듈 기술 개발)의 지원을 받아 수행되었다.

References

-

B. Brown, M. Broth and E. Vinkhuyzen, “The Halting Problem: Video Analysis of Self-Driving Cars in Traffic,” Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems, pp.1-14, 2023.

[https://doi.org/10.1145/3544548.3581045]

-

B. Pfleging, M. Rang and N. Broy, “Investigating User Needs for Non-Driving-Related Activities During Automated Driving,” Proceedings of the 15th International Conference on Mobile and Ubiquitous Multimedia, pp.91-99, 2016.

[https://doi.org/10.1145/3012709.3012735]

- Motoring Research, The 20 Best New Car Dashboards in 2024, Motoring Research, https://www.motoringresearch.com/slideshow/the-20-best-new-car-dashboards-in-2024/, , 2024.

-

S. Wu, T. Gable, K. May, Y. M. Choi and B. N. Walker, “Comparison of Surface Gestures and Air Gestures for In-Vehicle Menu Navigation,” Archives of Design Research, Vol.29, No.4, pp.65-80, 2016.

[https://doi.org/10.15187/adr.2016.11.29.4.65]

- C. A. Pickering, K. J. Burnham and M. J. Richardson, “A Research Study of Hand Gesture Recognition Technologies and Applications for Human Vehicle Interaction,” Proceedings of the 3rd Institution of Engineering and Technology Conference on Automotive Electronics, pp.1-15, 2007.

-

R. Walter, G. Bailly and J. Müller, “StrikeAPose: Revealing Mid-Air Gestures on Public Displays,” Proceedings of the SIGCHI Conference on Human Factors in Computing Systems (CHI), pp.841-850, 2013.

[https://doi.org/10.1145/2470654.2470774]

-

P. D. S. Fink, V. Dimitrov, H. Yasuda, T. L. Chen, R. R. Corey, N. A. Giudice and E. S. Sumner, “Autonomous Is Not Enough: Designing Multisensory Mid-Air Gestures for Vehicle Interactions Among People with Visual Impairments,” Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems, pp.1-13, 2023.

[https://doi.org/10.1145/3544548.3580762]

-

P. Bellani, A. Picardi, F. Caruso, F. Gaetani, F. Brevi, V. Arquilla and G. Caruso, “Enhancing User Engagement in Shared Autonomous Vehicles: An Innovative Gesture-Based Windshield Interaction System,” Applied Sciences, Vol.13, No.17, Paper No.9901, 2023.

[https://doi.org/10.3390/app13179901]

-

H. Dong, A. Danesh, N. Figueroa and A. El Saddik, “An Elicitation Study on Gesture Preferences and Memorability Toward a Practical Hand-Gesture Vocabulary for Smart Televisions,” IEEE Access, Vol.3, pp.543-555, 2015.

[https://doi.org/10.1109/ACCESS.2015.2432679]

-

R. D. Vatavu, “A Comparative Study of User-Defined Handheld vs. Freehand Gestures for Home Entertainment Environments,” Journal of Ambient Intelligence and Smart Environments, Vol.5, No.2, pp.187-211, 2013.

[https://doi.org/10.3233/AIS-130200]

-

R. D. Vatavu and I. A. Zaiti, “Leap Gestures for TV: Insights from an Elicitation Study,” Proceedings of the ACM International Conference on Interactive Experiences for TV and Online Video, pp.131-138, 2014.

[https://doi.org/10.1145/2602299.2602316]

-

M. Tabbarah, J. Ospina-Bohórquez, J. E. Gonzalez, M. A. González Franco, M. T. Quintero and K. Y. Lim, “Novel In-Vehicle Gesture Interactions: Design and Evaluation of Auditory Displays and Menu Generation Interfaces,” Proceedings of the 15th International Conference on Automotive User Interfaces and Interactive Vehicular Applications, pp.224-233, 2023.

[https://doi.org/10.1145/3580585.3607164]

-

J. Sterkenburg, S. Landry and M. Jeon, “Design and Evaluation of Auditory-Supported Air Gesture Controls in Vehicles,” Journal on Multimodal User Interfaces, Vol.13, No.2, pp.55-70, 2019.

[https://doi.org/10.1007/s12193-019-00298-8]

-

R. Krstačić, A. Žužić and T. Orehovački, “Safety Aspects of In-Vehicle Infotainment Systems: A Systematic Literature Review from 2012 to 2023,” Electronics, Vol.13, No.13, Paper No.2563, 2024.

[https://doi.org/10.3390/electronics13132563]

- C. Hwang, K. Kim, S. Yun and Y. Sung, “Development of Motion Recognition System with Combination Sensor,” KSAE Annual Conference Proceedings, p.855, 2019.

- S. Park, Y. Oh and D. Ryu, “A Study of Gesture Control Technology Features Based on Virtual Reality Driving Simulator,” KSAE Annual Conference Proceedings, p.1561, 2017.

-

Z. Cui, H. Kuen, M. Spina, A. T. Rasmussen and A. D. Andrade, “Enhancing Interactions for In-Car Voice User Interface with Gestural Input on the Steering Wheel,” Proceedings of the 13th International Conference on Automotive User Interfaces and Interactive Vehicular Applications, pp.59-68, 2021.

[https://doi.org/10.1145/3409118.3475126]

-

K. Małecki, A. Nowosielski and M. Kowalicki, “Gesture-Based User Interface for Vehicle On-Board System: A Questionnaire and Research Approach,” Applied Sciences, Vol.10, No.18, Paper No.6620, 2020.

[https://doi.org/10.3390/app10186620]

-

A. Ataya, A. Eskandarian and H. Rakha, “How to Interact with a Fully Autonomous Vehicle: Naturalistic Ways for Drivers to Intervene in the Vehicle System While Performing Non-Driving Related Tasks,” Sensors, Vol.21, No.6, Paper No.2206, 2021.

[https://doi.org/10.3390/s21062206]

-

X. Qian, W. Ju and D. M. Sirkin, “Aladdin’s Magic Carpet: Navigation by In-Air Static Hand Gesture in Autonomous Vehicles,” International Journal of Human–Computer Interaction, Vol.36, No.20, pp.1912-1927, 2020.

[https://doi.org/10.1080/10447318.2020.1801225]

- The Conversation, Driverless Cars: How You’ll Use Free Time for Work and Rest According to Research, The Conversation, https://theconversation.com/driverless-cars-how-youll-use-free-time-for-work-and-rest-according-to-research-113090, , 2019.

-

P. A. Singleton, “Multimodal Travel-Based Multitasking During the Commute: Who Does What?,” International Journal of Sustainable Transportation, Vol.14, No.2, pp.150-162, 2020.

[https://doi.org/10.1080/15568318.2018.1536237]

-

X. Yao, Y. Chen, Z. Chen, Y. Liu, C. Liu and Y. Wang, “A Comparative Study of Passenger Multitasking Activities on Commuting and Leisure Electrified Intercity Railways,” Journal of Advanced Transportation, Vol.2022, No.1, Paper No.3001392, 2022.

[https://doi.org/10.1155/2022/3001392]

-

L. Xuan, D. Gaisong, M. Zhou, J. Zhang, X. Li and S. Liu, “Comparison on User Experience of Mid-Air Gesture Interaction and Traditional Remote Control,” Proceedings of the Seventh International Symposium of Chinese CHI, pp.16-22, 2019.

[https://doi.org/10.1145/3332169.3333570]

-

G. Young, H. Milne, D. Griffiths, E. Padfield, R. Blenkinsopp and O. Georgiou, “Designing Mid-Air Haptic Gesture Controlled User Interfaces for Cars,” Proceedings of the ACM on Human-Computer Interaction, Vol.4, pp.1-23, 2020.

[https://doi.org/10.1145/3397869]

-

N. K. Dim, C. Silpasuwanchai, S. Sarcar and X. Ren, “Designing Mid-Air TV Gestures for Blind People Using User- and Choice-Based Elicitation Approaches,” Proceedings of the 2016 ACM Conference on Designing Interactive Systems, pp.204-214, 2016.

[https://doi.org/10.1145/2901790.2901834]

-

H. Y. Leng, N. M. Norowi and A. H. Jantan, “A User-Defined Gesture Set for Music Interaction in Immersive Virtual Environment,” Proceedings of the 3rd International Conference on Human-Computer Interaction and User Experience in Indonesia, pp.44-51, 2017.

[https://doi.org/10.1145/3077343.3077348]

-

A. Sluÿters, A. Marquardt, B. van der Waaij and C. Holz, “Consistent, Continuous, and Customizable Mid-Air Gesture Interaction for Browsing Multimedia Objects on Large Displays,” International Journal of Human–Computer Interaction, Vol.39, No.12, pp.2492-2523, 2023.

[https://doi.org/10.1080/10447318.2022.2078464]

-

J. F. Hessam, D. Johnson, M. Billinghurst and A. Dey, “Towards Optimization of Mid-Air Gestures for In-Vehicle Interactions,” Proceedings of the 29th Australian Conference on Computer-Human Interaction, pp.126-134, 2017.

[https://doi.org/10.1145/3152771.3152785]

-

P. Vogiatzidakis and P. Koutsabasis, “Frame-Based Elicitation of Mid-Air Gestures for a Smart Home Device Ecosystem,” Informatics, Vol.6, No.2, Paper No.23, 2019.

[https://doi.org/10.3390/informatics6020023]

- Google, Keyboard Shortcuts for YouTube, Google Support, https://support.google.com/youtube/answer/7631406, , 2024.

- R. Likert, “A Technique for the Measurement of Attitudes,” Archives of Psychology, No.140, pp.1-55, 1932.

- S. G. Hart and L. E. Staveland, “Development of NASA-TLX (Task Load Index): Results of Empirical and Theoretical Research,” in Human Mental Workload, P. A. Hancock and N. Meshkati (Eds.), pp.5-39, 1988.

-

V. Braun and V. Clarke, “Using Thematic Analysis in Psychology,” Qualitative Research in Psychology, Vol.3, No.2, pp.77-101, 2006.

[https://doi.org/10.1191/1478088706qp063oa]