EKF를 활용한 ORB Visual SLAM 차량 궤적 보정에 관한 연구

Copyright Ⓒ 2026 KSAE / 244-09

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

This study proposed a trajectory fusion technique using the Extended Kalman Filter(EKF) to improve the accuracy of vehicle trajectories generated by ORB-SLAM. Although ORB-SLAM is an efficient feature-based visual SLAM algorithm, its accuracy may degrade in long-term autonomous vehicle trajectory tracking due to sensor noise and cumulative errors. Hence, this study applied an EKF to filter and correct the ORB-SLAM output trajectory, thereby achieving more refined vehicle position estimation results. Experiments were conducted in the KITTI public dataset environment to evaluate the performance of the proposed method. The results showed that the EKF-based vehicle position estimation fusion technique recorded lower trajectory errors for the ego-vehicle trajectory than the conventional ORB-SLAM and other Visual SLAM algorithms. This study presents a novel approach to enhancing vehicle position estimation accuracy in ORB-SLAM systems and is expected to be applicable in autonomous driving navigation applications.

Keywords:

Simultaneous localization and mapping, Extended kalman filter, Autonomous driving, Vision, Trajectory estimation키워드:

슬램, 확장 칼만 필터, 자율주행, 비전, 궤적추정1. Introduction

자율주행 시스템에서 궤적 추정 알고리즘의 강건성은 차량의 위치 파악과 주행 안전성을 보장하는 핵심 요소이다. GPS나 IMU와 같은 물리적 센서가 차량의 위치를 측정할 수 있으나, 이들 센서는 환경적 제약과 노이즈에 취약하여 신뢰성이 낮아지는 경우가 발생한다. 특히, IMU는 차량의 고속 주행과 곡선 주행에서 누적 오차가 발생한다. 또한 GPS는 고층 빌딩에 의한 간섭으로 인해 도심 환경에서 차량의 위치 추정에 취약하다. 이러한 한계를 극복하기 위해 알고리즘적 보정 기법이 요구된다.

최근 비주얼 SLAM(Visual Simultaneous Localization and Mapping)4)은 카메라 영상으로부터 차량의 이동 궤적을 추정하는 핵심 기술로 자리잡고 있다. 특히 ORB-SLAM(Oriented FAST and Rotated BRIEF SLAM)은 특징점 기반 경량화 알고리즘으로 높은 계산 효율성과 실시간 처리 능력을 갖추어 자차 위치 추정에 널리 활용되고 있다. ORB-SLAM은 카메라 포즈 추정과 동시에 맵을 구축하며, 2D Map 위에서 루프 클로징(Loop closing) 모듈을 통해 누적오차를 줄이고 차량의 위치를 추정한다.

루프 클로징과 같은 정확한 차량의 위치를 추정하려는 최적화 기법에도 불구하고 ORB-SLAM은 장기간 주행 시 센서 노이즈 및 누적 오차로 인해 궤적 정확도가 저하되는 한계를 가진다.1-3)

본 연구에서는 이러한 SLAM 알고리즘의 한계를 극복하기 위해 확장 칼만 필터(EKF)를 적용하여 ORB-SLAM 궤적을 보정하는 새로운 기법을 제안한다.

EKF는 예측과 관측의 반복 갱신을 통해 오차를 줄이는 비선형 필터링 기법으로, 본 연구에서는 EKF를 ORB-SLAM 위치 2D 좌표 출력에 직접 적용하여 궤적 정확도를 정량적으로 개선하였음을 입증한다.

본 논문의 주요 기여는 다음과 같다.

- 1. ORB-SLAM 모델의 궤적 2D 데이터에 EKF를 적용하여 누적 오차를 보정하는 방법을 제안한다.

- 2. 기존 ORB-SLAM과 EKF 기반 ORB-SLAM의 궤적 정확도를 정량적으로 비교한다.

- 3. 다른 Visual SLAM 모델과 EKF 기반 ORB-SLAM의 궤적 정확도를 정량적으로 비교한다.

2. Related Work

GPS나 IMU와 같은 물리적인 항법 센서와 SLAM 기술의 Sensor Fusion을 통한 위치 추정을 보정하려는 연구는 지속적으로 연구되어 왔다. 또한 Camera, Lidar 인지 센서를 통한 SLAM 기술 구현은 지속적인 연구가 진행되어 왔다.

본 세션에서는 ORB-SLAM의 개발 과정과 단일 센서 및 센서 융합된 차량 위치 보정 기술들의 동향을 확인한다. 최근 학습 기반 SLAM 연구로 위치 추정의 강건성을 향상시키려는 연구 살펴본다.

2.1 ORB-SALM 계열 관련 연구

Visual SLAM에서 카메라 센서의 키프레임으로 차량의 위치를 추정하는 원형 모델은 PTAM5)(Parallerl Tracking and Mapping)으로, 트래킹과 맵핑을 분리해 실내 공간에서의 실시간 포즈 추정을 정립했다.

이후 ORB-SLAM1)은 ORB6) 특징 및 장소 인식 · 포즈 그래프 최적화7)를 통합해 대규모 실내외에서 높은 정확도/실시간성을 달성했고, 스테레오 · RGB-D까지 확장된 ORB-SLAM22), VI-SLAM으로 일반화한 ORB-SLAM33)로 진화했다.

Mur-Artal과 Tardos는 ORB-SLAM1)을 최초로 제안하여, 단일 카메라(Monocular) 기반의 비주얼 SLAM에서 높은 계산 효율성과 정확성을 동시에 달성하였다. ORB 특징점(Oriented FAST and Rotated BRIEF)을 활용하여 추적과 맵핑을 수행하였으며, 키프레임 기반의 최적화와 루프 클로징(Loop closing) 기법을 통해 장기간 주행에서도 전역적 일관성을 유지할 수 있음을 입증하였다. 이 연구의 주요 기여는 경량화된 특징점 기반 SLAM 구조를 정립하여 실시간 동작을 가능케 한 점이다.

이후 Mur-Artal과 Tardos는 ORB-SLAM22)를 개발하여 RGB-D 카메라와 스테레오 카메라까지 지원 범위를 확장하였다. ORB-SLAM2는 단일 카메라 기반 SLAM의 제약을 넘어 깊이 정보와 다중 카메라 구성을 활용함으로써 궤적 추정의 강건성을 강화하였다. 다양한 카메라 설정을 지원하는 범용적 SLAM 프레임워크를 제시했다는 점에 의미가 있다.

Campos은 ORB-SLAM33)를 발표하여, 기존 비주얼 SLAM에 관성 센서(IMU)를 융합하는 VIO(Visual-Inertial Odometry)까지 포함시켰다. ORB-SLAM3는 단일 카메라, 스테레오 카메라, RGB-D 카메라뿐만 아니라 카메라-IMU 융합까지 지원함으로써 복잡한 주행 환경에서도 높은 추정 정확도와 안정성을 제공하였다. 비주얼-관성 센서 융합을 통해 장기간 · 고속 주행에서의 드리프트를 크게 감소시켰다.

2.2 Visual SLAM 단일 센서 및 센서 퓨전 기반 궤적 보정 융합연구

Qin 등은 VINS-Mono8)를 제안하여 단안 카메라와 IMU를 융합한 비주얼-관성 SLAM 시스템을 개발하였다. 이 연구에서는 비주얼-관성 데이터를 비선형 최적화 프레임워크를 통해 드리프트를 줄이고 궤적 정확도를 개선한 점이다. 특히, 온라인 상태에서 융합을 수행하면서도 후처리적 궤적 보정을 가능하게 하여 장기간 추적의 안정성을 보장하였다.

Leutenegger은 OKVIS9)(Optimization-based Keyframe Visual-Inertial SLAM)를 제안하였다. OKVIS는 필터 기반 접근 대신 비선형 최적화 기반 방식을 적용하여 카메라-IMU 융합을 수행하였으며, 키프레임 단위에서 궤적을 후처리적으로 정제하는 특징을 가진다.

Hess은 Google Cartographer10)를 개발하여 LiDAR 기반 SLAM의 성능을 획기적으로 향상시켰다. 이 시스템은 스캔 매칭과 포즈 그래프 최적화를 결합하여 실시간 매핑을 수행하면서도, 후처리적 전역 최적화를 통해 누적 오차를 보정하였다.

Lim 등은 ORORA11)(Outlier-Robust Radar Odometry)를 제안하여 레이더 기반 SLAM에서 발생하는 다중 경로 반사, 간섭, 클러터 노이즈 등으로 인한 외란(Outlier) 문제를 해결하였다. 이 연구는 악천후나 조명 변화에 취약한 카메라 기반 SLAM과 달리, 레이더 신호를 활용해 다양한 환경에서도 안정적인 궤적 추정이 가능함을 입증하였다.

Shan 등은 LIO-SAM12)을 개발하여 LiDAR와 IMU 데이터를 강결합(Tightly-coupled) 방식으로 융합한 SLAM 프레임워크를 제시하였다. 이 연구는 스캔 매칭 기반 LiDAR SLAM의 장점과 IMU의 단기 추정 안정성을 결합함으로써, 대규모 환경에서도 높은 정확도와 강건성을 동시에 달성하였다. 특히, 스무딩 및 매핑(Smoothing and mapping) 기법을 통해 LiDAR-IMU 데이터를 효율적으로 결합하였다.

2.3 Visual SLAM 최적화 및 위치 추정 연구

Rosten과 Drummond는 원형 이웃 픽셀의 밝기 비교를 학습된 의사결정 트리로 최적화한 FAST14) 코너 검출기를 제안하여, 코너 판정의 분기 과정을 대폭 단축함으로써 실시간 SLAM 전처리에 적합한 고속·경량 특징 검출을 가능하게 했다.

Lowe는 스케일·회전에 불변한 키포인트와 고차원 기술자를 갖는 SIFT15)를 제안하여, 시점·조명 변화에 강한 정합을 가능케 함으로써 이후 SLAM의 Structure-from-Motion에서 정확도 기준(Baseline)으로 자리매김하게 했다.

Kümmerle 등은 SLAM/BA 문제를 통합적으로 다루는 그래프 기반 비선형 최소자승 프레임워크 g2o7)를 제안하여, 노드–엣지 모델과 다양한 선형 솔버·강건 손실을 모듈화해 문제 맞춤형 백엔드 최적화를 실용적으로 지원했다.

2.4 딥러닝 기반 차량 위치 추정 연구

DeTone 등은 자기지도학습으로 검출기와 기술자를 공동 학습하는 SuperPoint16)를 제안하여, 단일 패스 추론으로 다양한 도메인에서 반복성과 인라이어 비율을 높여 실시간 프런트엔드의 강건한 매칭을 구현했다.

Sun 등은 검출기 없이 트랜스포머로 반밀집 매칭을 수행하는 LoFTR17)를 제안하여, 텍스처가 부족한 구간에서도 신뢰도 높은 대응점을 제공함으로써 전통적 키포인트 검출의 취약점을 보완했다. 이는 SLAM/VO 프런트엔드의 매칭 안정성을 크게 끌어올려 후단 최적화의 수렴을 돕는다.

Tyszkiewicz 등은 Reinforcement Learning 기반의 키포인트·디스크립터를 종단간 학습하는 DISK18)를 제안하여, 맞는 매칭을 많이 만들수록 보상이라는 목적을 직접 최적화함으로써 다양한 조건에서 인라이어 매칭 수를 극대화했다.

Sarlin 등은 그래프 신경망과 미분가능 최적수송을 이용해 상호주의·컨텍스트를 고려하는 러너블 매처 SuperGlue19)를 제안하여, 기존 조합 대비 매칭 정확·강건성을 크게 향상시켰다.

Lindenberger 등은 설계를 단순화·경량화한 LightGlue20)로 메모리/연산 효율과 정확도를 동시에 높여 실시간 응용 적합성을 강화했다.

Teed와 Deng은 Dense Bundle Adjustment 레이어와 recurrent 업데이트로 포즈·깊이를 반복 정련하는 DROID-SLAM21)을 제안하여, 단안 학습만으로도 스테레오/RGB-D에서 성능을 확장하여 강건한 SLAM을 구현했다.

Wang 등은 비전 트랜스포머의 멀티레벨 주의집중을 이용한 TransVPR22)을 제안하여, 전역 표현과 키-패치 재랭킹을 통합해 정확도-지연의 균형을 개선, 대규모 주행 데이터셋에서 SOTA급 장소 인식을 보였다.

앞서 살펴본 연구들은 주로 멀티센서 융합(VIO, LIO, Radar-SLAM) 또는 최적화 기반 후처리 기법을 통해 궤적 추정 성능을 향상시키는 데 집중하였다. 즉, 센서 하드웨어를 추가하거나 복잡한 최적화 프레임워크나 딥러닝 모델을 가져와 차량의 위치를 추론 적용하는 방식이 주류였다. 반면, 본 연구는 단일 카메라 기반 ORB-SLAM의 출력 궤적 자체를 확장 칼만 필터(EKF)로 보정하는 새로운 접근법을 제시한다. 이는 별도의 센서 융합이나 복잡한 최적화 과정을 요구하지 않으면서도, EKF의 예측-갱신 메커니즘을 활용하여 누적 오차와 잡음을 실시간적으로 줄일 수 있다는 점에서 기존 연구와 구분된다. 따라서 본 연구는 경량성과 실시간성을 유지하면서 Visual SLAM의 정확도를 개선하는 장점을 가진다.

3. Method

3.1 ORB-SLAM Trajectory Extraction

제안 기법에서 EKF는 ORB-SLAM 내부 백엔드(포즈 그래프 최적화, Loop closing 등)에 통합되는 것이 아니라, ORB-SLAM이 최종적으로 산출하는 카메라 중심 궤적을 입력으로 받아 외부 후처리(Post-processing) 단계에서 동작한다. 즉, 기존 ORB-SLAM 파이프라인은 그대로 유지하고, 그 결과에 2차원 EKF를 추가로 적용해 궤적을 보정하는 비침투적(Add-on) 구조를 채택하였다.

KITTI odometry 데이터셋은 각 프레임에 대해 3차원 포즈 Tt를 제공하지만, 본 연구에서는 승용차가 포장도로 평면을 따라 주행한다고 가정하여 Roll과 Pitch에 의한 고저 변화는 무시하였다. 실험에 사용한 시퀀스는 도심 포장도로 주행으로 구성되어 있으며, 이 경우 차량의 수직 방향 변위와 롤/피치 각 변화는 상대적으로 작고, 본 연구의 주요 관심사는 도로 평면 상의 횡방향 및 종방향 궤적 오차이다. 따라서 실제 3차원 위치 [xt, yt, zt]T 중 도로 평면에 해당하는 두 축만을 상태로 사용하여 μt = [xt, yt]T 로 투영하는 2차원 모델을 채택하였다.

ORB-SLAM이 제공하는 2차원 궤적을 저차원 상태 공간에서 필터링하여 누적 드리프트와 관측 잡음을 완화하는 데 초점을 둔다.

본 연구에서는 ORB-SLAM에서 생성된 궤적 데이터를 추출하여 EKF를 적용한다. ORB-SLAM의 궤적 데이터는 공용 데이터셋인 KITTI 06번 씬 DATA의 카메라 Feature를 GT(Ground Truth)로 활용하여 궤적을 생성하였다. 생성된 궤적을 EKF로 필터링하여 차량 궤적을 카메라 프레임마다 수정 보완하였다. 이를 통해 차량의 위치 추적 성능을 보다 향상시켰다.

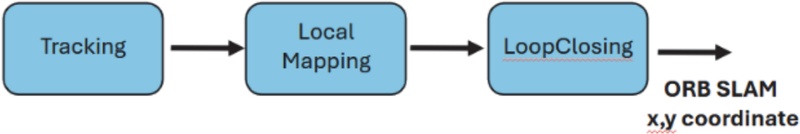

Fig. 1은 ORB-SLAM이 입력 영상으로부터 차량의 2차원 좌표를 추출하는 과정을 단계적으로 나타낸 것이다. 첫 단계인 Tracking 모듈에서는 연속된 영상 프레임으로부터 특징점을 검출하고, 이를 기반으로 카메라의 상대적인 위치와 자세를 추정한다. 이어서 Local mapping 단계에서는 추적된 특징점을 활용하여 지역 지도를 구성하고, 새로운 키프레임을 삽입하여 궤적 정보를 보강한다. 마지막으로 Loop closing 단계에서는 과거에 방문했던 장소와 현재 프레임을 비교하여 루프를 검출하고, 누적된 오차를 보정하여 전역적인 정합성을 확보한다. 이와같은 일련의 과정을 통해 ORB-SLAM은 최종적으로 차량의 2차원 궤적, 즉 xorb, yorb 좌표를 1차로 산출하게 된다.

3.2 EKF 적용 프로세스

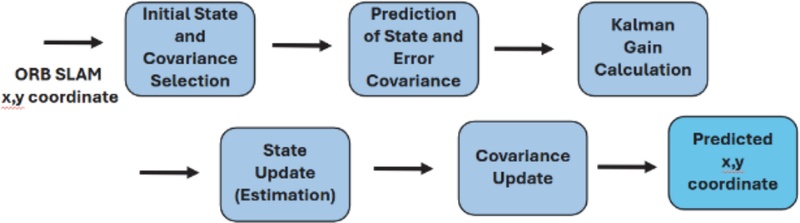

Fig. 2는 ORB-SLAM으로부터 추출된 차량의 xorb,yorb좌표 궤적을 확장 칼만 필터(Extended Kalman Filter, EKF)로 보정하는 과정을 나타낸 개념도이다. EKF는 상태(State)와 공분산(Covariance)을 초기화하는 단계에서 시작되며, 이후 시스템의 운동 모델을 기반으로 상태 예측(Prediction of state)과 오차 공분산(Error covariance)을 갱신한다. 이어서 관측값과 예측값의 차이를 최소화하기 위해 칼만 이득(Kalman gain)을 계산하고, 이를 이용해 상태를 보정 (State update)한다. 이 과정에서 새로운 관측 정보가 반영되며, 추정된 상태의 신뢰도를 나타내는 공분산 역시 업데이트(Covariance update)된다. 최종적으로 EKF는 ORB-SLAM의 원시 좌표로부터 불확실성이 줄어든 보정 좌표(Predicted x,y coordinate)를 출력한다. 이러한 일련의 절차는 ORB-SLAM이 가지는 누적 오차와 센서 노이즈 문제를 완화시켜, 보다 안정적이고 정밀한 궤적 추정을 나타냈다.

EKF를 적용하기 위해 다음과 같은 상태 벡터를 정의한다. EKF의 예측 단계에서는 운동 모델을 기반으로 상태 변화를 예측하고, 관측 데이터(ORB-SLAM의 궤적)를 이용하여 갱신한다.

3.3 EKF 기반 궤적 보정 알고리즘

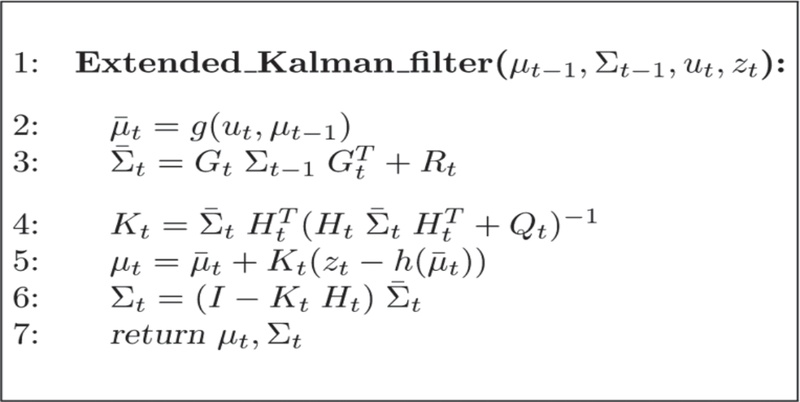

Fig. 3은 EKF가 ORB-SLAM의 출력 좌표를 받아 상태를 예측하고, 칼만 이득을 산출하며, 관측과 융합하여 최종적으로 차량 궤적을 보정하는 절차를 요약한 것이다. EKF는 크게 상태 예측, 공분산 예측, 칼만 이득 계산, 상태갱신, 공분산 갱신의 다섯 단계로 구성된다. 먼저, 이전 추정치와 제어 입력을 바탕으로 현재 상태를 예측한다.

본 연구에서는 ORB-SLAM의 프레임 간 상대 이동량을 제어 입력 ut=[vt]로 활용하여, 차량의 위치를 2차원 평면 상에서 예측하였다. 이어서, 상태 전이 모델의 야코비안 매트릭스 Gt와 프로세스 노이즈 Rt를 통해 예측 공분산을 계산하였다.

그 다음, 관측 모델의 야코비안 매트릭스 Ht와 측정 노이즈 Qt를 이용해 칼만 이득을 산출하였다.

이 이득은 예측치와 관측치의 가중 결합 비율을 결정하는 역할을 한다. ORB-SLAM이 산출한 좌표 관측 zt = []와의 차이를 반영하여 상태를 보정한다

마지막으로 공분산을 갱신하여 추정 불확실성을 줄인다.

본 연구에서 EKF의 상태 변수(State)는 차량의 2차원 위치 μt = [xt, yt]T 이고, 관측값(Measurement)은 []T 이다. 따라서 EKF는 ORB-SLAM의 추정 좌표를 측정치로 받아, 모델 기반 예측과 융합함으로써 궤적의 누적 오차와 잡음을 보정한다.

EKF 상태, 제어입력, 관측은 다음과 같이 정의한다. 상태 벡터는 차량의 2차원 위치 μt = [xt, yt]T이고 제어입력 μt 는 ORB-SLAM이 프레임간 산출하는 상대변위 μt = []T 로 정의한다. 관측값 zt 는 ORB-SLAM이 제공하는 좌표 []T이다. 상태 전이운동 모델 f(·)는 1차 미분 gudo xoi의 평면 이동 모델로 설정하였다. = f(μt-1, μt) = μt-1 + μt + wt 여기서 는 예측상태, wt는 평균 0, 공분산 Rt를 갖는 프로세스 노이즈이다. 이에 대한 상태 전이 야코비안 Gt는 Gt = = I2 가 되며, 예측 공분산은 로 계산된다. 관측 모델 h(·)는 ORB-SLAM의 좌표를 상태에서 대한 항등 관측응로 사용하는 단순한 구조다. zt = h(μt) + vt, h(μt) = μt 여기서 vt는 평균 0, 공분산 Qt를 갖는 측정 노이즈이고, 관측 야코비안 Ht = = I2로 주어진다. 이때 프로세스 노이즈와 측정 노이즈의 공분산 행렬은 각각 , 로 모델링하여 는 사전 실험을 통해 궤적 스무딩 효과와 과도한 필터링이 발생하지 않는 범위에서 경험적으로 설정하였다. 칼만 이득 Kt는 로 계산되고 이를 통해 상태를 로 갱신한다. 공분산은 로 업데이트합니다.

보정된 값은 원시 ORB-SLAM 궤적이 아닌, 오차 공분산이 줄어든 신뢰성 높은 차량 궤적 좌표이다. 이는 결과적으로 GT(Ground truth)에 근접한 안정적인 궤적을 형성하였다.

4. Result

제안된 기법의 성능을 검증하기 위해 공용 데이터셋 (KITTI)을 활용하여 모델별 성능을 비교 분석하였다. KITTI 데이터셋의 Scene-06을 활용하였다. RMSE(Root Mean Squar Error)를 통하여 ORB-SLAM과 EKF가 적용된 ORB-SLAM의 예측값의 정확도를 확인하였다. 또한 EKF가 적용된 Visual SLAM 모델들과 EKF-ORB SLAM의 모델을 비교하였다. RMSE는 모델의 차량 궤적 예측값과 KITTI 데이터셋의 실제값 간의 오차를 측정하는 지표로 활용하였다.

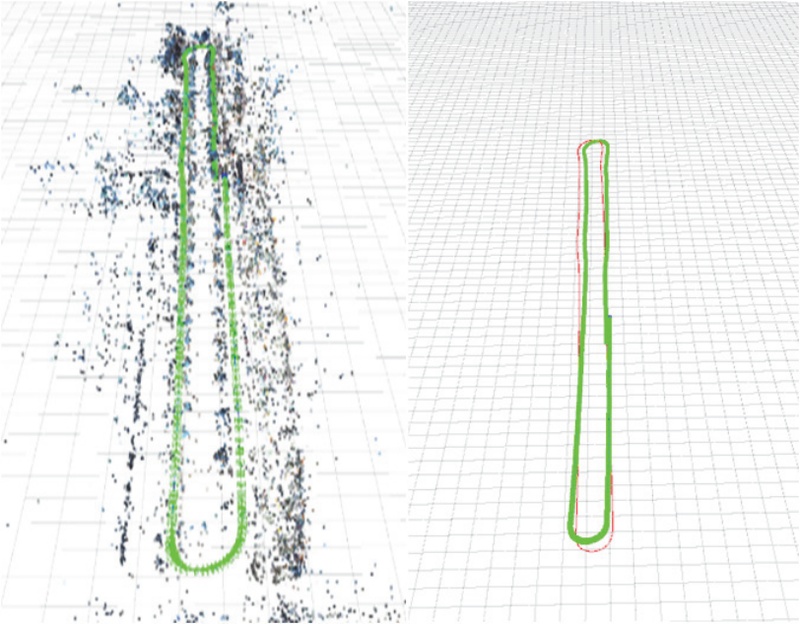

Fig. 4는 EKF ORB-SLAM으로 복원된 희소 2D 포인트 클라우드(주변 건물·가로수·차량 가장자리 등) 위에, 차량의 주행 궤적을 초록색 선으로 표시한 결과이다. 주행 시나리오는 직선 주행 후 유턴을 포함하는 폐곡선 코스로 구성하였다.

Left image show that EKF-ORB-SLAM smooths the ORB-SLAM path and aligns it with camera scene feature structure, reducing lateral wobble and drift. Right image Comparing red GT and green EKF paths, the loops overlap and the long straight stays nearly parallel, indicating improved global consistency and accuracy

초록색 궤적은 EKF로 보정된 ORB-SLAM 위치 추정 결과로, 맵의 구조선에 평행하게 정렬되고 좌우 흔들림이 완화되어(측방 편차 감소) 장거리 누적 드리프트가 억제되었다.

포인트클라우드의 산포가 큰 구간(나뭇가지·반사체/텍스처 부족 구간)에서도 궤적은 연속적이고 매끄럽게 유지되며, 이는 본 연구의 EKF 기반 후처리가 ORB-SLAM의 관측 좌표 [xorb,yorb]와 프레임 간 상대 변위를 가중 융합해 고주파 노이즈와 저주파 드리프트를 동시에 줄였음을 시각적으로 보여준다.

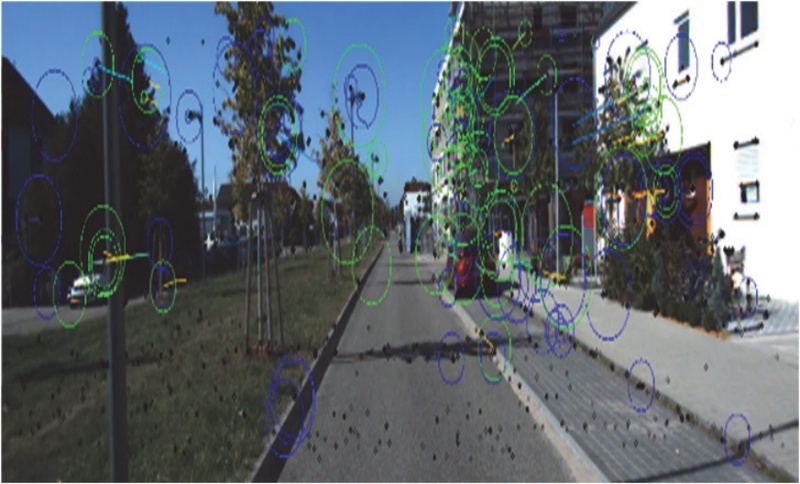

Fig. 5는 KITTI 도로 주행 장면에서 특징점 검출·매칭 결과를 시각화 하였다. 전역에 표시된 파란색 동그라미는 해당 프레임에서 검출된 전체 특징점(매칭 후보)을, 초록색 동그라미는 이들 중 RANSAC 기반의 기하학적 검증을 통과한 유효 매칭(Inliers)을 뜻한다. 즉, 파란색은 노이즈·오검출을 포함한 데이터, 초록색은 카메라 포즈 추정에 실제 사용되는 관측치를 의미한다.

Feature detection and inlier visualization on a kitti frame. Blue circles denote all detected/putative feature matches, while green circles indicate geometrically validated inliers(ransac) that are used for camera pose estimation. The inlier set forms the orb-slam measurements zt and is later fused with the ekf to suppress high-frequency noise and mitigate drift

장면 우측처럼 건물과 나무가 밀집되어 텍스처가 풍부한 구역에서는 초록색 점밀도가 높아 추정이 안정적이고, 좌측 도로/하늘처럼 텍스처가 빈약한 구역에서는 파란점 대비 초록점 비율이 낮아져 불확실성이 증가한다.

이러한 공간적 Inlier 분포 차이가 ORB-SLAM 단독 시 발생하는 편차의 원인이며, 본 논문에서는 EKF 융합을 통해 이와 같은 에러를 극복하고자 한다.

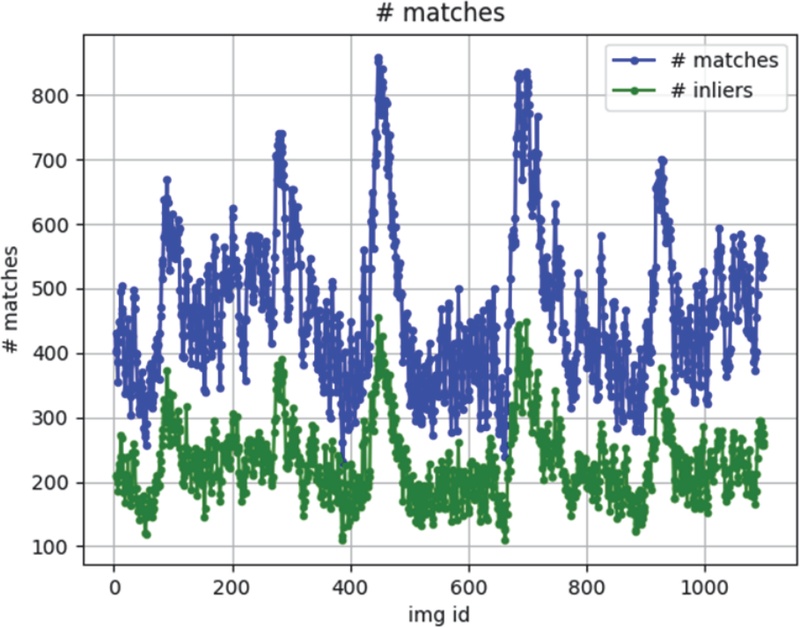

Fig. 6은 ORB-SLAM 모델에서 연속된 이미지 프레임 간 특징점 매칭 결과를 나타낸 것이다. 파란색 곡선은 전체 매칭된 이미지 프레임의 특징점의 개수를 의미하며, 평균적으로 약 500개 수준에서 안정적으로 유지되는 것을 확인할 수 있다. 반면 초록색 곡선은 전체 매칭 중에서 기하학적 제약 조건(RANSAC 기반 유효성 검증)을 만족하는 유효 매칭(Inliers)의 개수를 나타내며, 평균로 250개 수준으로 관찰된다. 이는 전체 매칭의 약 50 %가 유효 매칭으로 판정되었음을 의미하며, 나머지는 잘못된 매칭(Outlier)임을 보여준다. 특히 프레임 구간에 따라 Inlier 개수의 변동 폭이 커지는 현상이 나타나는데, 이는 텍스처 부족이나 카메라 이미지의 명암 변화와 같은 환경적 요인으로 인해 특징점 검출의 신뢰성이 저하되었기 때문으로 해석할 수 있다.

| (1) |

This indicates the number of matched feature points ORB between images. The green lines represent only the correctly matched points (valid correspondences, inliers) among all matched points. Only 47 % of the matched data was used as inliers

식 (1)은 예측 계적과 실제 궤적간의 차이를 정량적으로 평가하는 데사용된 RMSE(Root Mean Squared Error)의 정의를 나타낸다. RMSE는 실제 궤적 yi 와 추정 궤적 간의 오차를 제곱하여 평균한 뒤 제곱근을 취함으로써 계산된다.

Table 1에서는 다양한 SLAM 기법을 이용한 위치인식 결과와 여기에 EKF를 적용하였을 때 얻어진 RMSE 감소를 비교하여 제시하였다. EKF 적용 이전에는 ORB-SLAM의 RMSE가 2.583, SIFT가 2.123, SuperPoint가 2.911로 나타나 SIFT가 상대적으로 낮은 오차를 보였다. 반면 EKF를 결합한 이후에는 ORB-SLAM의 RMSE가 1.783으로 크게 감소하여 SuperPoint 2.672, SIFT 1.968을 모두 앞섰다. 결론적으로 제안한 EKF-ORB-SLAM은 동일 조건에서 가장 낮은 RMSE를 달성하여, SIFT 및 SUPER POINT 대비 정량적으로 우수한 궤적 추정 성능을 보였음을 확인하였다.

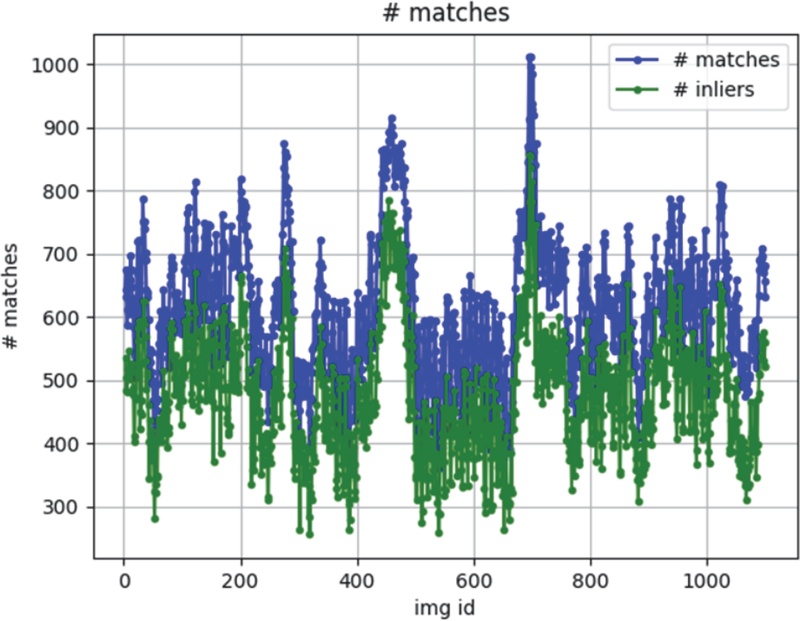

EKF를 ORB-SLAM에 결합했을 때 SIFT 대비 오차가 더 감소한 이유는 다음과 같이 해석된다. ORB는 저텍스처·반복 패턴 구간에서 외란과 드리프트가 크기 때문에 Fig. 6에서 EKF를 적용하지 않았을 때 Match에서 Inlier의 비율이 50 %로 현저히 낮은 것을 확인하였다. SIFT의 경우 Fig. 7에서 EKF가 적용되지 않았을 때 평균 Match 580 ~ 620개 수준으로 Inlier로 사용된 피처는 470~520개로 확인되었다. SIFT의 전체 매칭의 약 75 % 비율로 매칭이 판정되었음을 확인하였다. 이에 비해 ORB SLAM은 Inlier의 비율이 현저히 낮다. EKF는 이러한 ORB SLMA의 저주파 드리프트와 고주파 노이즈로 인한 Match와 Inlier 낮은 전환 비율로 인해 발생할 수 있는 불이익을 개선했다고 해석할 수 있다. 반면 SIFT는 단일 관측 자체의 정합정확도가 높아 EKF적용 효과가 미미한 것으로 판단하였다.

This indicates the number of matched feature points SIFT between images. The green lines represent only the correctly matched points(valid correspondences, inliers) among all matched points. about 75 % of the matched data was used as inliers

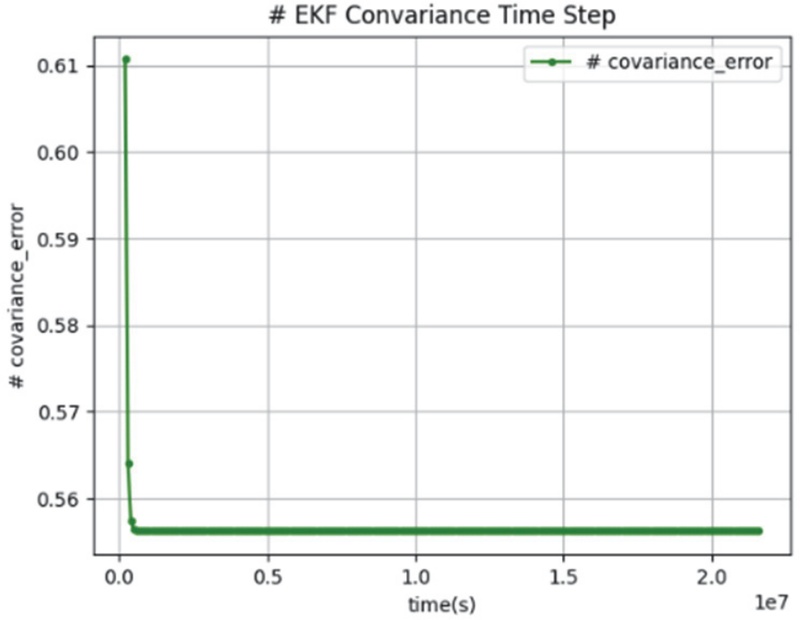

Fig. 8은 EKF 적용 과정에서 추정된 포즈 공분산의 변화 추이를 나타낸다. 초기 단계에서는 약 0.61 수준의 비교적 높은 불확실성을 보였으나, 시간이 지남에 따라 공분산 값이 감소하여 약 0.56 부근에서 큰 변동 없이 유지되는 것을 확인할 수 있다. 본 연구에서는 공분산의 절대값이 0에 수렴한다고 주장하기보다는, 초기값 대비 감소한 이후 인접한 시점 간 변화율이 일정 임계값 이하로 유지되는 구간을 안정화 구간(Δ Σ/Δ t < 0.01, 또는 Steady-state 조건)으로 해석한다. 즉, Fig. 8은 EKF 적용 후 추정 불확실성이 감소하고, 이후 좁은 범위 내에서 안정적으로 유지된다는 점을 시각적으로 보여준다.

5. Conclusion

본 논문은 단일 카메라 기반 ORB-SLAM이 산출하는 이차원 궤적의 잡음과 누적 오차를 줄이기 위해 확장 칼만 필터를 후처리로 적용하는 경량 보정 프레임워크를 제안한다. 상태는 차량의 위치 x와 y로 정의하고 관측은 ORB-SLAM이 제공하는 좌표를 사용해 예측과 갱신을 반복함으로써 관측 변동을 공분산에 반영하고 칼만 이득으로 가중 융합한다. KITTI 데이터셋에서 실시한 실험에서 공분산은 시간에 따라 안정적으로 감소하며 대표 시퀀스의 궤적 오차는 ORB-SLAM 대비 크게 줄었다. 예를 들어 RMSE는 2.283에서 1.783으로 개선되었고 특징점 조합별 비교에서도 ekf FAST ORB가 1.783로 ekf SIFT 1.968과 ekf SUPERPOINT 2.672보다 가장 낮았다. 재구성된 포인트클라우드 위에서 보정 궤적은 좌우 흔들림과 드리프트가 완화되어 지도의 구조와 더 잘 정합되었으며 프레임 간 매칭이 저하되는 구간에서도 자차의 궤적 추정이 안정적으로 유지되었다. 본 연구를 통해 별도의 추가 센서나 복잡한 전역 최적화 및 딥러닝 모델을 요구하지 않고 기존 ORB SLAM 파이프라인에 바로 접목할 수 있어 실시간성 및 구현 용이성을 보장하면서 궤적 정확도를 실질적으로 향상시킨 점이 본 연구의 핵심 기여다. 본 논문에서 제안한 EKF-ORB-SLAM은 현재 KITTI odometry 데이터셋의 대표 시퀀스(Scene-06)에 대해 검증되었으며, 이는 도심 직선·커브·U턴이 포함된 하나의 주행 시나리오에 대한 사례 연구에 해당한다. 따라서 고속도로, 교외 도로, 장거리 주행 등 보다 다양한 도로 환경과 복수 시퀀스에 대한 통계적 검증이 이루어지지 않았다는 한계가 있다. 향후 연구에서는 여러 시퀀스 및 다른 데이터셋을 추가하여 다양한 궤적 패턴에서의 성능을 정량적으로 분석하고, EKF 파라미터 튜닝에 따른 민감도까지 포함한 확장 실험을 수행할 예정이다.

Nomenclature

| μt-1 : | the previous state estimate(mean) |

| Σt-1 : | the previous state covariance matrix(uncertainty in the estimate) |

| ut : | the control input applied at the current step |

| zt : | the current measurement or observation |

| n : | number of data points |

| Yi : | actual value(ground truth) |

| : | predicted value |

| Subscripts | |

|---|---|

| Orb : | orb predicted result ordinate |

| A, B, C, P : | nodal point |

| L, R : | left, right |

References

-

R. Mur-Artal and J. D. Tardós, “ORB-SLAM: A Versatile and Accurate Monocular SLAM System,” IEEE Transactions on Robotics, Vol.31, No.5, pp.1147-1163, 2015.

[https://doi.org/10.1109/TRO.2015.2463671]

-

Mur-Artal and J. D. Tardós, “ORB-SLAM2: An Open-Source SLAM System for Monocular, Stereo, and RGB-D Cameras,” IEEE Transactions on Robotics, Vol.33, No.5, pp.1255-1262, 2017.

[https://doi.org/10.1109/TRO.2017.2705103]

-

Campos, R. Elvira, J. J. Gómez Rodríguez, J. M. M. Montiel and J. D. Tardós, “ORB-SLAM3: An Accurate Open-Source Library for Visual, Visual-Inertial, and Multi-Map SLAM,” IEEE Transactions on Robotics, Vol.37, No.6, pp.1874-1890, 2021.

[https://doi.org/10.1109/TRO.2021.3075644]

-

M. Servières, V. Renaudin, A. Dupuis and N. Antigny, “Visual and Visual-Inertial SLAM: State of the Art, Classification, and Experimental Benchmarking,” Journal of Sensors, Paper No.2054828, pp.1-26, 2021.

[https://doi.org/10.1155/2021/2054828]

-

G. Klein and D. Murray, “Parallel Tracking and Mapping for Small AR Workspaces,” IEEE and ACM International Symposium on Mixed and Augmented Reality (ISMAR), pp.225-234, 2007.

[https://doi.org/10.1109/ISMAR.2007.4538852]

-

E. Rublee, V. Rabaud, K. Konolige and G. Bradski, “ORB: An Efficient Alternative to SIFT or SURF,” IEEE International Conference on Computer Vision (ICCV), pp.2564-2571, 2011.

[https://doi.org/10.1109/ICCV.2011.6126544]

-

R. Kümmerle, G. Grisetti, H. Strasdat, K. Konolige and W. Burgard, “g2o: A General Framework for Graph Optimization,” IEEE International Conference on Robotics and Automation (ICRA), pp.3607-3613, 2011.

[https://doi.org/10.1109/ICRA.2011.5979949]

-

T. Qin, P. Li and S. Shen, “VINS-Mono: A Robust and Versatile Monocular Visual-Inertial State Estimator,” IEEE Transactions on Robotics, Vol.34, No.4, pp.1004-1020, 2018.

[https://doi.org/10.1109/TRO.2018.2853729]

-

S. Leutenegger, M. Furgale, V. Rabaud and R. Siegwart, “Keyframe-Based Visual–Inertial Odometry Using Nonlinear Optimization,” The International Journal of Robotics Research, Vol.34, No.3, pp.314-334, 2015.

[https://doi.org/10.1177/0278364914554813]

-

W. Hess, D. Kohler, H. Rapp and D. Andor, “Real-Time Loop Closure in 2D LIDAR SLAM,” IEEE International Conference on Robotics and Automation (ICRA), pp.1271-1278, 2016.

[https://doi.org/10.1109/ICRA.2016.7487258]

-

H. Lim, M. Renaudin, A. Dupuis and N. Antigny, “ORORA: Outlier-Robust Radar Odometry,” IEEE International Conference on Robotics and Automation (ICRA), pp.2046-2053, 2023.

[https://doi.org/10.1109/ICRA48891.2023.10160997]

-

T. Shan, B. Englot, D. Meyers, W. Wang, C. Ratti and D. Rus, “LIO-SAM: Tightly-Coupled Lidar Inertial Odometry via Smoothing and Mapping,” IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), pp.5135-5142, 2020.

[https://doi.org/10.1109/IROS45743.2020.9341176]

-

C. Kim and K. Huh, “Development of a Pose and Position Estimation Algorithm with Considering the Error and Latency from the GPS and In-Vehicle Sensors,” Transactions of KSAE, Vol.26, No.5, pp.620-629, 2018.

[https://doi.org/10.7467/KSAE.2018.26.5.620]

-

E. Rosten and T. Drummond, “Machine Learning for High-Speed Corner Detection,” European Conference on Computer Vision (ECCV), pp.430-443, 2006.

[https://doi.org/10.1007/11744023_34]

-

D. G. Lowe, “Distinctive Image Features from Scale-Invariant Keypoints,” International Journal of Computer Vision, Vol.60, No.2, pp.91-110, 2004.

[https://doi.org/10.1023/B:VISI.0000029664.99615.94]

-

D. DeTone, T. Malisiewicz and A. Rabinovich, “SuperPoint: Self-Supervised Interest Point Detection and Description,” IEEE Conference on Computer Vision and Pattern Recognition Workshops (CVPR Workshops), pp.337-350, 2018.

[https://doi.org/10.1109/CVPRW.2018.00060]

-

J. Sun, Z. Shen, Y. Wang, H. Bao and X. Zhou, “LoFTR: Detector-Free Local Feature Matching with Transformers,” IEEE Conference on Computer Vision and Pattern Recognition (CVPR), pp.8922-8931, 2021.

[https://doi.org/10.1109/CVPR46437.2021.00881]

- M. Tyszkiewicz, P. Fua and E. Trulls, “DISK: Learning Local Features with Policy Gradient,” Advances in Neural Information Processing Systems (NeurIPS), Vol.33, pp.9706-9718, 2020.

-

P.-E. Sarlin, D. DeTone, T. Malisiewicz and A. Rabinovich, “SuperGlue: Learning Feature Matching with Graph Neural Networks,” IEEE Conference on Computer Vision and Pattern Recognition (CVPR), pp.4938-4947, 2020.

[https://doi.org/10.1109/CVPR42600.2020.00499]

-

L. Lindenberger, P.-E. Sarlin, V. Larsson and M. Pollefeys, “LightGlue: Local Feature Matching at Light Speed,” IEEE International Conference on Computer Vision (ICCV), pp.17627-17636, 2023.

[https://doi.org/10.1109/ICCV51070.2023.01616]

- Z. Teed and J. Deng, “DROID-SLAM: Deep Visual SLAM for Monocular, Stereo, and RGB-D Cameras,” Advances in Neural Information Processing Systems (NeurIPS), Vol.34, pp.16558-16569, 2021.

-

J. Wang, Y. Zhong, J. Zhang and Y. Xie, “TransVPR: Transformer Based Place Recognition with Multi-Level Attention,” IEEE Conference on Computer Vision and Pattern Recognition (CVPR), pp.13643-13652, 2022.

[https://doi.org/10.1109/CVPR52688.2022.01328]