차량 인포테인먼트 시스템의 오디오 신호 자동화 평가를 위한 사운드 검증 솔루션

Copyright Ⓒ 2025 KSAE / 236-08

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

The evolution of the IVI(In-Vehicle Infotainment System) underscores the escalating significance of extending connectivity beyond rudimentary audio and video playback capabilities, which are aimed at optimizing passenger safety and convenience. Sound anomalies within the IVI system are increasingly recognized as technically significant. However, the complex nature of audio features makes manual evaluation challenging. In this paper, we present an MSVS(Mobis Sound Verification Solution), which is an automated sound testing tool that can detect subtle sound irregularities. When utilizing this solution to test audio capabilities, it enables real-time verification of silent intervals and detection of any pop noise within the incoming audio signals. Moreover, through the application of deep learning in the target signal detection feature, it is possible to determine the currently playing audio signal. To evaluate the performance of the MSVS, a simulation environment comparative to an actual vehicle was established to reproduce and evaluate various problems occurring in the IVI.

Keywords:

Silence detection, Pop noise detection, Audio signal detection, Mel-spectrogram, IVI, MSVS키워드:

묵음 검출, 팝 노이즈 검출, 오디오 신호 검출, 멜 스펙트로그램, 차량 인포테인먼트 시스템, 모비스 사운드 검증 솔루션1. 서 론

자동차 및 IT(Information Technology) 산업의 지속적인 성장과 함께, 자동차는 더 이상 단순한 이동 수단이 아니라, 운전자와 승객들에게 편안함과 즐거움을 주는 공간으로서 역할을 하고 있다.1) 최근 ICT(Information and Communication Technologies)의 발전으로 인해 자동차 산업은 IVI(In-Vehicle Infotainment) 시스템의 신기술 개발에 집중하고 있다.2) IVI 시스템은 음악 재생, 비디오 시청, 내비게이션 안내 등 운전 시 다양한 편의 기능을 제공하며, 운전 시간을 더욱 유익하게 만들고 있다. 특히, 차량 내부에서의 오디오 신호는 이러한 인포테인먼트 시스템의 핵심 요소 중 하나이다. 최근에는 차량 내부 시스템과 인포테인먼트 시스템이 유기적으로 연결되어 차량 외부에서 들어오는 소음을 상쇄시키거나, 자동으로 음악의 볼륨을 조절할 수 있다.3,4) 또한, 전기차의 경우 주행 시 엔진음을 가공하여 발생시킴으로써 주변 보행자의 안전성도 향상하고 있다.5) 따라서 오디오 신호의 정확성과 품질은 차량 내/외부 사람들에게 큰 영향을 미치게 되었고, 그에 따라 차량에서 발생하는 오디오 신호의 중요성은 계속 부각되고 있다.

하지만, IVI 시스템의 미디어 기능이 더욱 복잡해지고 다수 제어기와의 연결성이 고도화되면서 사운드 이상 현상의 발생률도 높아지고 있다. 이러한 IVI 시스템의 오디오 신호에 대한 평가와 검증은 이전까지 주로 평가 근무자가 직접 청취하며 수동적으로 이루어졌다. 그러나, 인포테인먼트 시스템에서 발생하는 오디오 신호가 더욱 다양하고 복잡해짐에 따라 사람이 수동으로 평가하는 과정에서 많은 시간과 노력이 필요하게 되었고, 평가의 정확도를 보장하기도 어려워졌다. 이를 해결하기 위해, 차량에서 발생하는 오디오 신호를 자동으로 평가하여 오류를 검출할 수 있는 사운드 검증 시스템의 필요성이 대두되고 있다.6) 이러한 시스템은 복잡한 오디오 신호의 파형을 빠르고 효율적으로 분석하여 IVI 시스템의 오디오 품질을 향상시키는데 도움을 줄 수 있다.

본 논문에서는 IVI 시스템에서 발생하는 대표적인 사운드 이상 문제인 묵음, 팝 노이즈, 타깃 음원 재생 오류 현상을 자동으로 평가하기 위한 사운드 검증 솔루션을 제안한다.7) MSVS(Mobis Sound Verification Solution)는 실시간으로 IVI 시스템에서 출력되는 오디오 신호를 입력 받아 진폭과 주파수의 변화를 이용해 묵음 구간의 발생 여부와 팝 노이즈의 유무를 탐지한다. 또한 최신 딥러닝 기술을 활용해 Mel-Spectrogram의 특징을 분석해 현재 재생되고 있는 오디오 신호를 식별하여 미디어마다 사전에 정의된 음원이 제대로 출력되는지 검증한다.

묵음 검출 기능은 기존 주파수 변환 기법8)의 높은 계산량으로 인한 지연 문제를 보완하기 위해, 연산 부담을 최소화하면서도 빠르고 안정적인 MSE(Mean Squared Energy) 기반 묵음 검출 기법을 적용한다. 실시간으로 입력되는 오디오 신호를 특정 윈도우 길이만큼 분석하여 부분적으로 묵음 구간이 발생하는지 여부를 판단한다. 팝 노이즈 검출 기능은 기존의 에너지 기반 방법9)이 잡음 환경에서 신뢰도가 낮거나 계산 비용이 높은 한계를 가지는 반면, 본 연구의 진폭 및 주파수 변화 기반 검출 방식은 팝 노이즈의 특성을 직접 분석하여 연산량을 최소화하면서도 높은 검출 정확도를 유지할 수 있다. 시간 순서대로 주파수를 추출하여 급격한 주파수 변화가 발생한 구간을 감지한 후, 진폭의 임계값을 설정해 일정 크기 이상의 신호를 팝 노이즈로 규정해 검출한다. 또한, 오디오 탐색 기능은 잡음이 많은 환경에서 검색 정확도가 낮은 한계를 갖는 Fingerprint 알고리즘 기반 방식10)을 보완하기 위해 Mel-Spectrogram을 활용한 딥러닝 모델로 오디오 신호 검색 성능을 향상시켰다.

사전에 정해진 평가 시나리오에 맞는 음원의 Mel-Spectrogram11)을 추출하여 이미지화하고, CNN(Convolutional Neural Network)12) 알고리즘을 활용해 AI(Artificial Intelligence) 딥러닝 모델에 추출된 이미지를 학습시킨다. 이후, 실시간으로 입력된 음원의 Mel-Spectrogram 이미지로 학습시킨 모델을 이용해 분류하여 음원을 특정한다. 이를 통해 미디어마다 올바른 음원이 재생되었는지 여부를 판단한다. 제안하는 사운드 검증 솔루션의 성능을 확인하기 위해 시험 데이터의 종류를 차량 전장음, 배경 음악, 최신 가요 등으로 구성하여 다양한 조건에서 솔루션의 성능을 검증하였다.

본 논문의 구조는 다음과 같다. 2장에서 MSVS의 구축 환경과 전체 시스템 구조를 설명하고, 3장에서는 MSVS의 세부 기능들을 각각 설명한다. 4장에서는 MSVS의 성능을 평가하기 위한 실험 환경과 실험 결과에 관해서 설명하고, 5장에서는 결론 및 향후 연구 방향을 설명하고 본 논문을 마무리한다.

2. MSVS 구축 환경 및 시스템 구조

2.1 MSVS 구축 환경

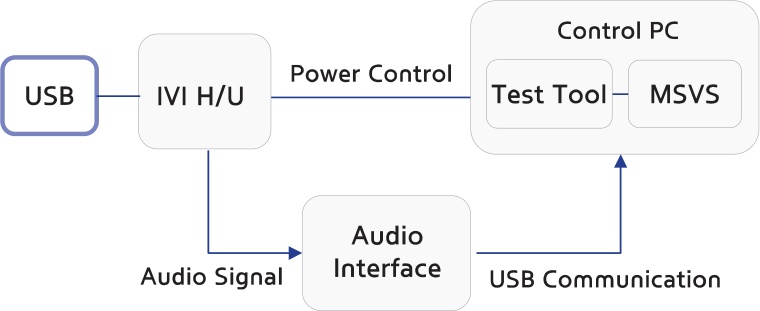

MSVS 구축 환경은 Fig. 1과 같이 크게 3가지 요소로 구성된다. 첫 번째로 테스트를 진행할 IVI 시스템에 TASCAM이라고 하는 오디오 인터페이스를 연결한다(Photo. 1). 이를 통해, IVI 시스템에서 나오는 아날로그 오디오 신호가 TASCAM으로 전달되고, USB 통신을 통해 평가를 수행할 제어 컴퓨터에 디지털 신호로 입력된다. 본 논문에서는 USB 메모리에 저장된 다양한 종류의 음원을 IVI 시스템에 재생시켜 평가를 수행하였다. 제어 컴퓨터에서는 IVI 시스템을 자동으로 평가하기 위한 기존의 테스트 소프트웨어 툴과, 사운드 검증을 위한 MSVS 시스템이 함께 동작하여 평가가 수행된다.

2.2 MSVS 시스템 구조

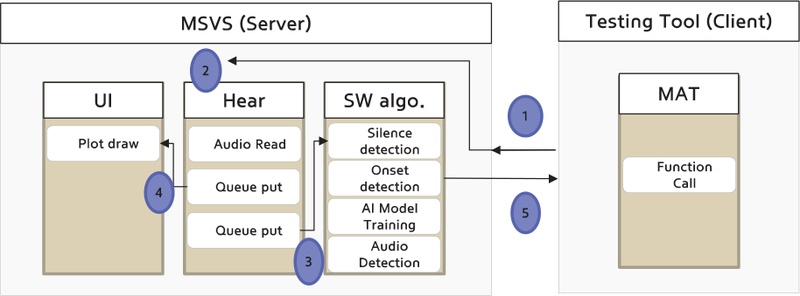

본 논문에서 제안하는 사운드 검증 솔루션의 전체 구조는 Fig. 2와 같다.

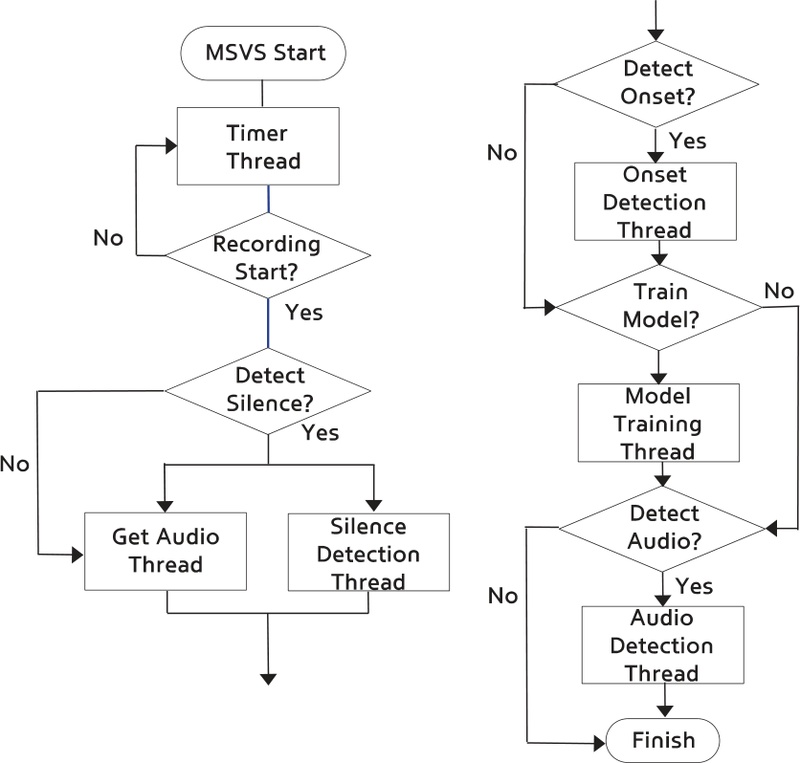

사운드 검증 솔루션은 파이썬 기반으로 개발되었고, 기존 자동화 평가에 활용된 테스팅 소프트웨어 툴과 소켓 통신을 통해 정보를 주고받으며 자동으로 평가를 수행한다. 테스팅 소프트웨어 툴에서 오디오 신호 평가 요청이 들어오면, 서버 형태로 동작하는 사운드 검증 솔루션이 해당 메시지를 감지해 실시간으로 입력되는 오디오 신호를 받아 평가를 시작한다. 실시간으로 입력된 오디오 신호는 큐를 통해서 저장되고, 파이썬 GUI(Graphical User Interface) 화면에서 그래프 형태로 표현된다. Fig. 2와 같이 사운드 검증 솔루션의 핵심 평가 소프트웨어 알고리즘은 크게 4가지로 구성된다. 첫 번째는 오디오 신호에 부분 묵음 구간을 검출하는 'Silence Detection' 기능이 있고, 두 번째는 팝 노이즈 유무를 판단하는 'Onset Detection' 기능이 있다. 세 번째는 타깃 음원을 검출하기 위해 사전에 음원 학습을 위한 'AI Model Training' 기능이 있고, 마지막으로 실제로 타깃 신호의 정보를 검출하는 'Audio Detection' 기능이 있다. 각 기능의 동작 순서는 Fig. 3처럼 나타낼 수 있다.

MSVS가 동작하기 시작하면 시간 측정을 위한 'Timer' 스레드가 실행되고, 이어서 녹음 기능이 동작한다. 이때 만약 묵음 검출 기능을 사용한다면 오디오 신호를 실시간으로 입력 받는 'Get Audio'스레드와 'Silence Detection' 스레드가 동시에 동작하며 실시간으로 묵음 구간을 검출하게 된다. 만약 사용자가 팝 노이즈 검출 기능을 활성화하면 테스팅 툴의 요청에 따라 'Pop Noise Detection' 스레드가 선택적으로 동작하게 되며 팝 노이즈 유무를 판단한다. 이후 'Model Training' 스레드가 동작해 사전에 저장된 음원 데이터 세트를 활용해 AI 모델 학습을 수행한다. 모델 학습이 종료되면 'Audio Detection' 스레드가 동작해 오디오 신호 탐색 기능을 수행하여 현재 입력된 음원을 특정하며 전체 평가가 종료된다.

3. MSVS 기능별 세부 알고리즘

3.1 Silence Detection

본 연구에서는 실시간 판단 속도를 극대화하기 위해 MSE 기반 묵음 검출 기법을 적용하였다. 기존의 주파수 변환 기반 기법8)은 높은 정확도를 제공할 수 있지만, 실시간 처리를 위한 계산량이 증가하여 지연 문제가 발생할 수 있다. 반면, MSE 기반 검출 방식은 신호의 에너지 변화를 직접적으로 평가함으로써 연산 부담을 최소화하면서도 빠르고 안정적인 묵음 검출이 가능하다. IVI 시스템으로부터 매 1 s 간 입력된 오디오 음원의 MSE 값을 계산하여 판단한다.13) MSE는 식 (1)과같이 나타낼수 있다.

| (1) |

여기서, N은 신호의 평균 에너지 값을 구할 수 있는 1 s간 입력된 오디오 신호의 개수이고, x는 오디오 신호의 각 진폭 포인트이다. 이때, MSE 값을 데시벨(dB)로 변환하고, 그 중 크기가 90 %에 해당하는 값과 임계 값 Y를 설정하여 묵음 발생 여부를 판단한다. 본 논문에서는 인간의 청각 한계와 소음 환경에서의 일반적인 음압 수준을 고려하여 Y를 60 dB로 설정하였다. 일반적으로 60 dB는 일상적인 대화 소음 수준에 해당하며, 이보다 낮은 경우 배경 소음이나 묵음으로 간주될 가능성이 크다. 따라서 60 dB 이하인 경우를 묵음으로 판단하도록 설정함으로써, 불필요한 신호를 제거하고 분석의 정확도를 향상시킬 수 있도록 하였다. 묵음 구간은 인간이 인지할 수 있는 오디오 이상 현상을 검출하기 위해 10 ms ~ 1 s까지 단계별로 설정하여 실시간으로 입력되는 음원 파형에 해당 묵음 구간을 검출할 수 있는지 시뮬레이션을 통해 검증하였다.

3.2 Pop Noise Detection

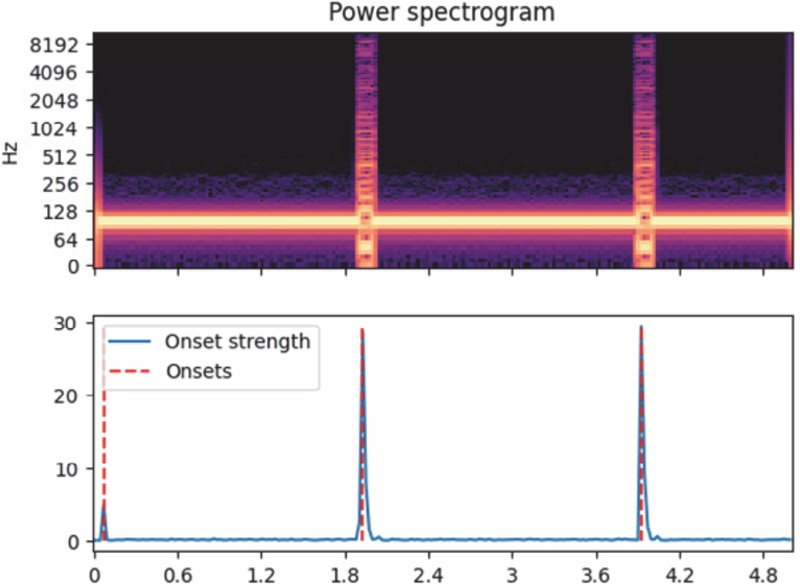

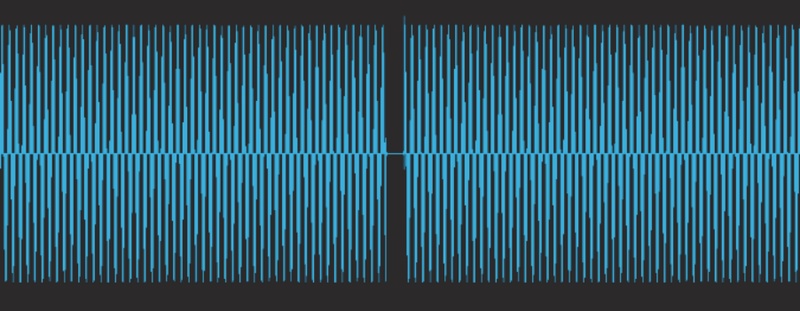

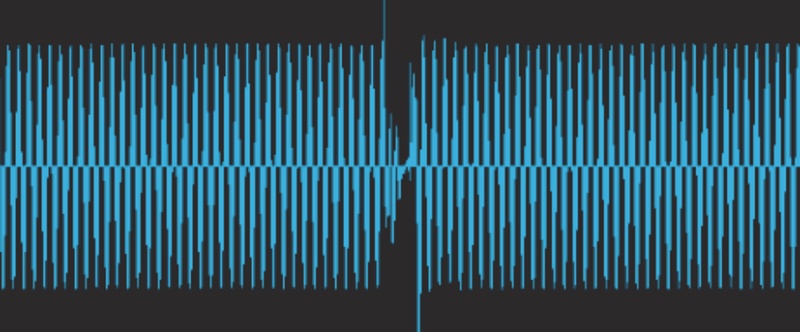

기존의 에너지 기반 팝 노이즈 검출 방법9)은 특정 환경에서 높은 성능을 보일 수 있으나, 잡음 환경에서의 신뢰도 저하 또는 실시간 처리 시 높은 계산 비용과 같은 한계를 가진다. 반면, 본 연구에서 제안한 진폭 및 주파수 변화 기반 검출 방식은 팝 노이즈의 고유한 급격한 진폭 변화와 특정 주파수 대역의 특성을 직접 분석함으로써, 연산량을 최소화하면서도 높은 검출 정확도를 유지할 수 있다. 제안 팝 노이즈 검출 과정은 녹음된 음원 파일을 읽어 진폭 크기와 주파수의 급격한 변화를 감지하여 이루어진다. 해당 연산은 음악 및 오디오 신호 처리를 위한 파이썬 라이브러리인 'Librosa'를 활용하였다. 'Librosa'는 음악 분석, 오디오 신호 변환 및 기타 오디오 처리 작업을 수행하기 위한 다양한 기능을 제공한다. 팝 노이즈는 짧은 시간 동안 순간적인 진폭과 주파수의 변화가 있는 노이즈를 의미한다. 이를 검출하기 위해 크게 2가지 방법으로 알고리즘을 개발하였다. 첫 번째 방법은 'Librosa' 라이브러리에서 제공하는 'onset_strength' 함수를 활용해 진폭 세기를 측정하였다. 이후 임의의 임계값을 설정하여 해당값보다 큰 신호를 일차적으로 팝 노이즈 후보로 검출한다. 두 번째방법은 'Librosa'의 'onset_detect' 함수를 적용해 진폭이 큰 신호 중에 주파수 변화가 급격하게 발생한 구간을 탐지한다. 이를 통해 팝 노이즈를 최종적으로 검출할 수 있다. Fig. 4는 팝 노이즈 발생 예시를 나타낸다. 앞서 설명한 바와 같이, 진폭이 큰 신호 중에서 주파수 변화가 급격하게 변화한 구간을 탐색하면 팝 노이즈를 검출할 수 있다.

3.3 Audio Detection

기존의 오디오 신호 탐색 과정은 Fingerprint 알고리즘을 활용한 음원 탐색 시스템을 사용하고 있었다.10) 하지만, 차량 내부와 같이 잡음이 많은 환경에서는 녹음되는 음원의 품질이 낮아 음악 검색의 정확도가 낮다는 단점이 있다. 이를 보완하기 위해, Mel-Spectrogram으로 전처리된 오디오 데이터를 최신 딥러닝 모델로 학습하여 오디오 신호의 검색 성능을 향상했다.

본 논문에서 제안하는 데이터 전처리 방식은 Mel-Spectrogram을 활용한 이미지 데이터 생성 방법이다. 입력된 오디오 신호 파형에 STFT(Short Time Fourier Transform)을 적용한다. 일반적으로 신호의 주파수 특성을 파악하는 경우에는 식 (2)와 같이 FFT(Fast Fourier Transform)를 사용한다.

| (2) |

이때, N은 FFT 크기, n은 윈도우 크기를 의미한다. 하지만, FFT는 전체 시간에 대한 평균적인 주파수 성질만 제공하여 시간에 따라 주파수의 변화 추이를 확인하기 어렵다.

반면에, STFT는 전체 시간을 짧은 시간 간격으로 일정하게 나누고, 해당 시간 간격 안에는 오디오 신호의 적용해 스펙트럼을 구한다. 특성이 변하지 않는다고 가정한다. 이후 각 구간에 대해 FFT 공식을 STFT 수식은 식 (3)과 같이 나타낼 수 있다.

| (3) |

여기서, N은 FFT 크기, w(n)은 윈도우 함수, n은 윈도우 크기, H는 윈도우가 겹치는 Hop 크기를 의미한다. k의 범위는 식 (2)와 같다.

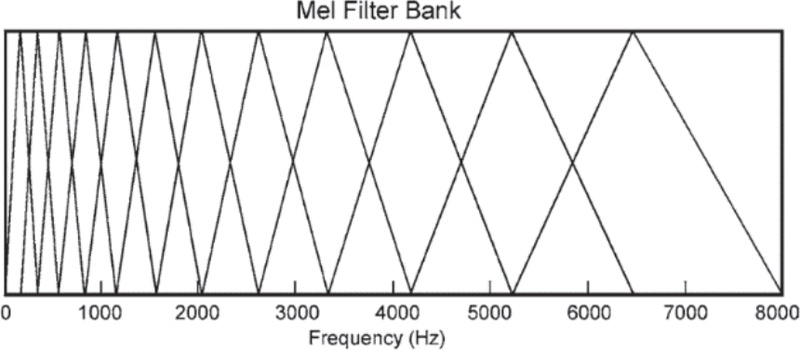

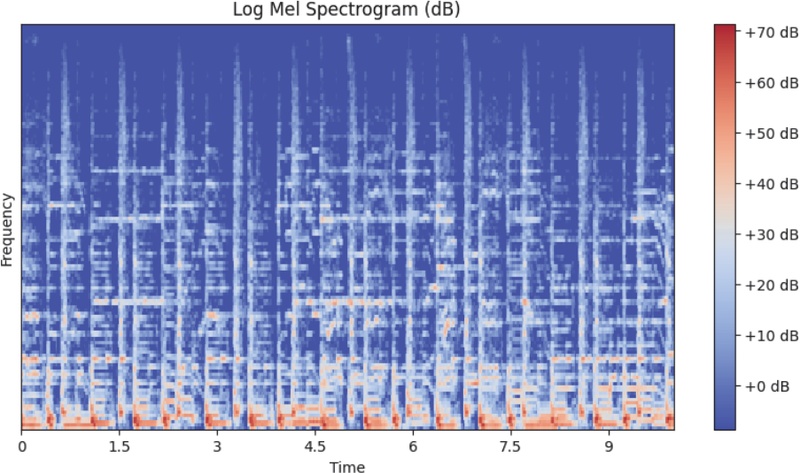

STFT 수식을 적용하고 난 후, 사람의 가청 주파수 특성을 반영하기 위해 Fig. 5의 Mel-Filter Bank를 적용한다. 사람의 청력은 1,000 Hz 이상의 주파수에 대해서는 덜 민감하므로 1,000 Hz 미만은 선형 그래프 형태를 띄고, 1,000 Hz 이상은 로그 그래프 형태를 띠도록 변형시켜 주는 Mel-Filter Bank를 적용하여 Mel-Spectrogram을 생성한다. 이후, 로그 스케일을 적용하면 Fig. 6과 같이 Log Mel-Spectrogram을 적용한 이미지 데이터가 생성된다.

음원 데이터를 활용해 Mel-Spectrogram 이미지 데이터를 얻은 후, 데이터 증강 기법을 적용하여 딥러닝 학습을 위해 필요한 학습 데이터를 생성한다. 본 논문에서 제안하는 데이터 증강 기법은 크게 2가지 방법을 사용한다. 첫 번째 방법은 음원 구간 추출과 순서 변경이다. 전체 음원에서 평가하고자 하는 음원의 길이만큼 1 s 단위로 추출하는 방법이다. 예를 들어, 30 s 길이의 음원에서 5 s만 오디오 평가에 사용한다고 가정하면, 0 ~ 4 s, 1 ~ 5 s, 이렇게 1 s 단위로 시간을 이동시켜가며 학습할 음원 데이터를 추출한다. 두 번째 방법은 다양한 잡음 환경에서의 성능 변화를 분석하기 위해 SNR(Signal-to-Noise Ratio)을 5 dB 단위로 조정하며 5 ~ 50 dB 범위에서 음원에 백색 잡음을 추가한다. 차량 내부는 주변 환경으로부터의 잡음이 많아 기존 Fingerprint 알고리즘만 적용했을 경우 음원 탐색 정확도가 낮았다. 이를 보완하기 위해 음원에 여러 단계의 잡음을 포함해 Mel-Spectrogram 이미지를 생성하여 다양한 학습 데이터를 구성하였다.

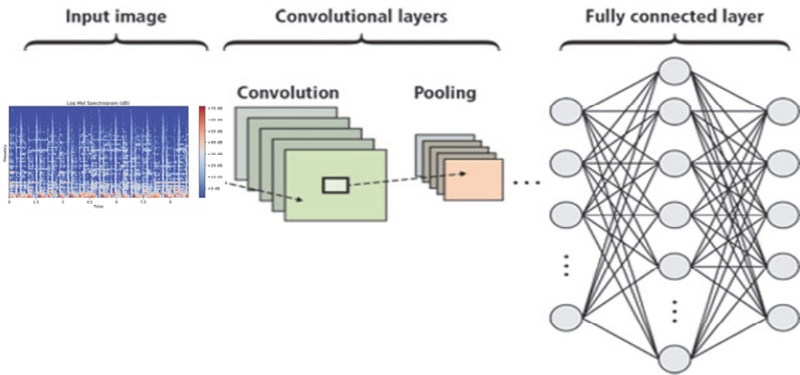

Mel-Spectrogram 이미지 데이터를 생성한 후, 이를 활용하여 CNN 기반의 딥러닝 모델을 학습하였다. CNN 모델은 딥러닝 라이브러리 'Keras'를 사용하여 구현하였으며, 입력된 이미지 데이터에서 특징을 효과적으로 추출하고 분류할 수 있도록 설계되었다. Fig. 7과 같이 특징 추출 과정에서는 Convolution Layer와 Pooling Layer를 3개 층으로 구성하였으며, 각 Convolution Layer에는 128, 256, 512개의 필터를 사용하여 다양한 수준의 특징을 학습할 수 있도록 하였다. 각 층에서는 ReLU(Rectified Linear Unit) 활성 함수를 적용하여 비선형성을 강화하였다. 또한, 과적합을 방지하고 모델의 일반화 성능을 높이기 위해 각 Convolution Layer 뒤에 Max Pooling Layer를 적용하여 특징 맵의 크기를 줄이고 연산 효율을 향상시켰다.

이후, Convolution Layer에서 추출된 특징을 기반으로 Fully Connected Layer를 3개 층으로 구성하여 최종 이미지 분류를 수행하였다. Fully Connected Layer에서도 ReLU 활성 함수를 적용하여 학습의 수렴 속도를 높이고, 최종 출력층에서는 Softmax 함수를 사용하여 각 클래스에 대한 확률 값을 계산하고 가장 유사도가 높은 음원을 선택하도록 하였다. 모델의 학습 과정에서는 Adam 최적화 알고리즘을 사용하여 빠르고 안정적인 학습을 유도하였으며, 손실 함수로는 Categorical Crossentropy를 적용하여 다중 클래스 분류 문제에 최적화하였다. 학습 데이터는 일정 비율로 훈련과 검증 데이터로 나누어 모델의 성능을 평가하며, 과적합을 방지하기 위해 Dropout 기법을 일부 Fully Connected Layer에 적용하여 신경망의 일반화 성능을 강화하였다.

4. 성능 평가

본 논문에서 제안하는 사운드 검증 솔루션은 차량 내부 환경을 고려하기 위해, 실제 차량 인포테인먼트 시스템을 이용하여 사운드 이상 문제 탐지 성능을 평가하였다. Table 1은 사운드 검증 솔루션 개발에 사용된 파라미터이다. 솔루션의 성능은 크게 묵음 검출, 팝 노이즈 검출, 오디오 탐색으로 3가지 기능 별로 각각 평가를 진행하였다.

4.1 Silence Detection 평가

묵음 검출 기능의 평가는 IVI 시스템에서 실시간으로 재생되는 음원에 묵음 구간이 있는지 확인하는 방식으로 진행되었다. 묵음 구간의 길이는 10 ms ~ 1 s 사이로 총 10단계로 나누어 검출 가능한 최소 길이를 확인하였다. 묵음 검출 평가에 사용한 음원은 250 Hz 정현파에 묵음 구간을 삽입하여 평가용 파일 모음을 제작하였다. 각 음원은 묵음 구간 길이와 횟수를 변화시켜 가며 다양한 조건에서 묵음을 탐지하는지 평가하였다.

Table 1은 묵음 검출 구간 길이에 따른 검출 정확도를 나타낸다. 알고리즘 상에서는 10 ms 이상의 묵음 구간은 모두 검출할 수 있도록 구현한 후 실제로 평가를 수행했다. 한 곡당 10번의 평가를 수행한 결과, 20 ms 이상의 묵음 구간의 검출 정확도는 100 %로 측정되었지만, 10 ms 묵음 구간은 검출하지 못했다. 원인을 분석하기 위해 입력된 오디오 신호 파형을 비교하였다. Fig. 8과 같이 인위적으로 묵음 구간 10 ms를 넣은 음원의 파형은 해당 부분만 삭제된 형태로 생성된다. 하지만 이를 IVI 시스템에서 재생시켜 시험용 PC로 입력된 파형을 보면, Fig. 9와 같이 잡음이 포함된 상태가 된다. 따라서 잡음으로 인해 10 ms 묵음 구간은 신호가 존재하는 구간으로 인지하게 된다. 또한, 묵음 구간의 시작 부분과 끝부분에 팝 노이즈처럼 신호 세기가 순간적으로 올라가는 부분이 있음을 발견했다. 이를 통해, 묵음 구간이 포함된 음원을 IVI 시스템에서 재생했을 때 묵음 전후 구간에서 팝 노이즈가 발생할 수 있음을 확인하였다. 따라서 본 알고리즘을 활용한다면, 20 ms 이상의 묵음 구간은 100 % 검출할 수 있다. 추후 신호 처리 과정에서 노이즈를 줄이는 방안을 고려한다면 20 ms 이하의 묵음도 효과적으로 검출할 수 있을 것으로 기대된다.

4.2 Pop Noise Detection 평가

팝 노이즈 탐색 성능을 평가하기 위해 기존 100 Hz 정현파 신호에 실제 차량에서 발생한 팝 노이즈 신호를 추가해 평가용 음원을 생성한다. Table 2와 같이 정현파 음원의 길이를 5 s, 10 s, 30 s로 3가지 경우에서 평가를 진행하였고, 각각 팝 노이즈 신호의 개수를 다르게 하여 평가용 음원을 제작한다. 이때, 팝 노이즈 개수에 따라 전체 정현파 음원의 길이를 등분하여 팝 노이즈의 발생 위치를 지정해 평가용 음원을 생성한다. 이후 해당 음원을 IVI 시스템을 통해 재생하여 실제 차량과 유사하게 평가 환경을 구성해 시뮬레이션을 수행하였다.

이후, 음원 1개당 10번의 테스트를 통해 팝 노이즈 검출 알고리즘의 성능을 검증하였다. 평가 결과, 같은 길이 음원에 팝 노이즈 개수가 많아질수록 팝 노이즈를 검출하는 정확도가 하락함을 확인하였다. 원인을 분석해 보면 팝 노이즈 개수가 많아지면 음원 전체적으로 평균 진폭 값이 높아지게 되고, 이는 에너지 크기 기반으로 팝 노이즈를 판단하는 알고리즘의 정확도를 낮출 수 있다. 따라서 팝 노이즈가 정현파 속에 1개 포함되어 있을 때는 100 % 검출이 되었지만, 하나의 음원에 팝 노이즈 발생 개수가 많아질수록 팝 노이즈 횟수의 검출 정확도는 하락하였다. 하지만, 전체 파일에 팝 노이즈의 발생 유무는 100 % 정확도로 검출할 수 있다. 추후 인공지능 모델을 활용해 팝 노이즈 패턴을 더욱 정밀하게 분석하는 연구를 수행한다면 팝 노이즈 횟수의 검출 정확도를 향상시킬 수 있을 것으로 기대된다.

4.3 Audio Detection 평가

오디오 탐색 알고리즘의 성능을 평가하기 위해, 기존에 사용하고 있는 핑거프린트 기반의 음악 검색 알고리즘과 제안한 알고리즘을 비교하였다. 또한 제안한 알고리즘에서 오디오 신호 전처리 방식의 차이가 성능에 미치는 영향을 측정하기 위해 오디오 신호의 Mel-Spectrogram 이미지로 학습을 시킨 CNN 모델과, MFCC(Mel-Frequency Cepstral Coefficient)14) 이미지로 학습을 시킨 CNN 모델을 구분하여 각각 성능을 측정하였다. MFCC는 Mel-Spectrogram으로 추출된 특징점에 행렬을 압축해서 표현해 주는 DCT(Discrete Cosine Transform) 연산을 수행한 결과이다. 그리고 각각의 이미지를 기반으로 학습 데이터를 생성해 CNN 모델로 학습을 수행하였다. 전체 학습 데이터 세트는 차량 전장음, 정현파, 일반 가요 그리고 배경음악으로 이루어진 20가지 음원을 사용하였다. 이때, 음원의 길이를 5 s, 10 s, 30 s로 나눠 3 종류의 학습 데이터 세트를 구성하였고, 각 알고리즘을 활용한 시뮬레이션을 통해 성능을 비교하였다.

Table 3은 입력 오디오 음원 길이의 종류에 따른 3가지 알고리즘의 평균 음원 탐색 성능을 나타낸다. 기존 오디오 핑거 프린트 알고리즘은 단순히 주파수 성분의 일부 특성만으로 데이터베이스를 만들어 음원의 종류를 구별하는 방식이었기에, 잡음이 없는 환경에서 동일한 음원 구간이 재생되어야 정확도가 높게 측정되었다. 하지만, 차량 내부와 같이 잡음이 많은 환경에서는 최대 정확도가 52.2 %로 비교적 낮게 측정되었다. 이를 보완하고자 CNN 모델 학습 기반의 제안 알고리즘을 적용한 결과, 최대 90 % 이상의 성능이 측정되었다. 또한, 음원 데이터 전처리 방식을 MFCC와 Mel-Spectrogram으로 구별해 제안 알고리즘 성능을 비교한 결과, MFCC가 처리 속도는 빠르지만, Mel-Spectrogram에 비해 음원 분류 성능이 낮게 측정되었다. Mel-Spectrogram을 활용한 제안 알고리즘은 최대 95.3 %의 정확도를 나타내며 잡음이 많은 차량 내부 환경에서 가장 높은 성능을 확인할 수 있었다.

5. 결 론

본 논문에서는 차량 인포테인먼트 시스템에서 발생하는 대표적인 사운드 이상 문제인 묵음과 팝 노이즈 현상 그리고 음원 재생 오류를 자동으로 평가하는 사운드 검증 솔루션을 제안하였다. MSVS는 실시간으로 인포테인먼트 시스템에서 출력되는 오디오 신호를 입력 받아 녹음을 수행하는 동시에 묵음 검출 알고리즘이 동작하여 진폭 정보를 기반으로 묵음 구간이 있는지 실시간으로 판단한다. 이를 통해, 20 ms 묵음 구간은 100 % 정확도로 검출할 수 있다. 이후, 팝 노이즈 검출 알고리즘이 작동되어 녹음된 파일의 음원 세기와 주파수의 변화를 통해 팝 노이즈가 있는지 확인한다. 팝 노이즈의 발생 유무는 100 % 정확도로 탐지한다.

마지막으로 타깃 음원 탐색 오류 문제를 검출하는 경우에는, 현재 재생되어야 할 음원이 무엇인지 알고 있는 상태에서, 사전에 CNN 모델을 이용해 오디오 신호를 학습한 데이터를 바탕으로 현재 실시간으로 재생되고 있는 음원을 특정하여 현재 재생되고 있는 사운드가 오류 없이 재생되고 있는지 판단한다. 그 결과, 최대 95.3 %의 정확도로 특정 음원 탐색이 가능하다. 제안 사운드 검증 솔루션 MSVS는 기존에 수동으로 진행하던 다양한 IVI 시스템의 사운드 평가를 자동으로 수행하여 수동 평가자의 업무 복잡도를 낮추고, 평가 효율성을 극대화하는데 활용될 수 있다. 향후 묵음 검출 기능과 팝 노이즈 검출 기능에도 인공지능 기술을 접목하여 정확도를 향상하는 방안을 연구할 계획이다.

References

-

W. Xu, H. Zhou, N. Cheng, F. Lyu, W. Shi and J. Chen, “Internet of Vehicles in Big Data Era,” IEEE/CAA Journal of Automatica Sinica, Vol.5, No.2, pp.19–35, 2018.

[https://doi.org/10.1109/jas.2017.7510736]

-

G. Dimitrakopoulos and P. Demestichas, “Intelligent Transportation Systems,” IEEE Vehicular Technology Magazine, Vol.5, No.1, pp.77–84, 2010 .

[https://doi.org/10.1109/mvt.2009.935537]

-

S. Choi, H. Oho, K. Hwang and K. Chang, “Noise Reduction Design Methodology for the Passenger Vehicle Considering Acoustic Characteristics of the Interior Cavity,” Transactions of KSAE, Vol.29, No.3, pp.265–273, 2021.

[https://doi.org/10.7467/ksae.2021.29.3.265]

-

D. Schubert, R. Henneberger, S. Hecker, S. Sentpali and S. Marburg, “Active Noise Cancellation in Passenger Cars Using the Electrical Power Steering Motor,” IEEE Conference on Control Technology and Applications, pp.255–260, 2017.

[https://doi.org/10.1109/ccta.2017.8062472]

-

F. M. Belenguer, A. Martínez-Millana, F. S. C. Ramón and A. Mocholí-Salcedo, “The Effectiveness of Alert Sounds for Electric Vehicles Based on Pedestrians’ Perception,” IEEE Transactions on Intelligent Transportation Systems, Vol.23, No.4, pp.2956–2965, 2022.

[https://doi.org/10.1109/tits.2020.3025499]

- S. Kim and J. Kim, “Sound-Based Abnormal Combustion Classification Model for High Compression Ratio, Spark-Ignition Engines Using Mel-Frequency Cepstrum Coefficients and Ensemble Learning Algorithms,” Int. J. Automotive Technology, Vol.24, No.3, pp.873–881, 2023.

- J. Yoon, H. Lee, S. Kang, K. Cho and S. Seo, “Development of an Automated Evaluation Tool and Test Data Based Verification to Detect Sound Problems in the IVI System,” KSAE Spring Conference Proceedings, p.401, 2024.

- M. Papaj, “Silence/Noise Detection for Speech and Music Signals,” New Trends in Audio and Video / Signal Processing Algorithms, Architectures, Arrangements, and Applications SPA 2008, Poznan, Poland, pp.83–88, 2008.

- P. Gupta and H. Patil, “Effect of Speaker-Microphone Proximity on Pop Noise: Continuous Wavelet Transform-Based Approach,” 13th International Symposium on Chinese Spoken Language Processing(ISCSLP), Singapore, pp.110–114, 2022.

- H. Kim and J. Cho, “Music Search Algorithm for Automotive Infotainment System,” The Korea Institute of Intelligent Transport Systems, Vol.12, No.1, pp.81–87, 2013.

-

S. Seo, C. Kim and J. Kim, “Convolutional Neural Networks Using Log Mel-Spectrogram Separation for Audio Event Classification with Unknown Devices,” Journal of Web Engineering, Vol.21, No.2, pp.497–522, 2022.

[https://doi.org/10.13052/jwe1540-9589.21216]

- M. Yousefi and J. H. L. Hansen, “Block-Based High Performance CNN Architectures for Frame-Level Overlapping Speech Detection,” IEEE/ACM Transactions on Audio, Speech, and Language Processing, Vol.29, pp.28–40, 2021.

-

A. Adjila, M. Ahfir and D. Ziadi, “Silence Detection and Removal Method Based on the Continuous Average Energy of Speech Signal,” International Conference on Information Systems and Advanced Technologies, pp.1–5, 2021.

[https://doi.org/10.1109/icisat54145.2021.9678476]

- Q. Li, Y. Yang, T. Lan, H. Zhu, Q. Wei and F. Qiao, “MSP-MFCC: Energy-Efficient MFCC Feature Extraction Method with Mixed-Signal Processing Architecture for Wearable Speech Recognition Applications,” IEEE Access, Vol.8, pp.48720–48730, 2020.