램프 병합 구간 및 병목 구간이 포함된 복합도로에서의 오프라인 강화학습 기반 자율주행 연구

Copyright Ⓒ 2025 KSAE / 235-08

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

Offline reinforcement learning(RL) has emerged as a promising approach for autonomous driving. While offline RL is practical because it can learn from pre-collected data, many studies consider only a single road structure, which limits its scalability. In this study, we model a complex road structure scenario as a Partially Observable Markov Decision Process(POMDP) and employ the proposed model based on implicit Q-learning(IQL). Furthermore, we perform experiments to evaluate various offline RL algorithms using different datasets. Results confirm that the proposed solution outperforms existing methods and demonstrates robustness and effectiveness in complex driving scenarios.

Keywords:

Autonomous driving system, Deep reinforcement learning, Offline reinforcement learning, Partially observable Markov decision process, Bottleneck, On-Ramp merging, Decision-making키워드:

자율 주행 시스템, 심층 강화학습, 오프라인 강화학습, 부분 관측 마르코프 의사결정, 병목 구간, 램프 병합 구간, 판단1. 서 론

최근 심층 신경망을 활용한 인공지능 기술이 발전함에 따라 인공지능을 활용한 자율주행 기술에 대한 연구가 활발히 진행되고 있으며,1,2) 강화학습 방법론을 통해자율 주행 자동차의 의사 결정 모델을 구현하려는 시도가 증가하고 있다.3) 강화학습은 개체가 환경과의 상호작용을 통해 누적보상이 최대가 되는 행동을 선택하도록 학습하는 방법으로, 예측 불가능한 도로 환경에서도 유연하고 정확한 의사결정을 수행하도록 한다.4-11) 그러나 기존 강화학습 방법은 학습 과정에서 환경과의 실시간 상호작용을 필요로 하기 때문에 높은 학습 비용을 유발할 수 있다는 어려움이 존재한다.12)

오프라인 강화학습은 기존 강화학습의 어려움을 해결하기 위한 방법론으로 고려될 수 있다. 오프라인 강화학습은 사전에 수집된 고정된 데이터를 기반으로 학습을 수행하는 방법으로, 환경과 실시간 상호작용을 필요로 하지 않으며,13) 데이터 수집과 학습 과정이 분리되어 있다는 특성이 있다. 이러한 특성으로 인해 기존 강화학습에서 실시간 상호작용의 어려움으로 발생했던 한계점을 보완하고, 안전하고 효율적인 주행 학습이 가능하게 되었다.14-17)

오프라인 강화학습은 데이터 기반(Data-driven) 학습 방식인 모방학습(Imitation Learning; IL)과 유사하지만, 데이터셋에 포함된 데이터들의 가치(Value)를 평가하여 행동을 결정한다는 점에서 차이가 있다. 행동 복제(Behavior Cloning; BC)는 모방학습의 대표적인 알고리즘으로 데이터 기반의 자율주행 연구에 다수 사용되고 있다.18) 하지만, 행동 복제 알고리즘은 학습 시 전문가 데이터셋을 사용해야 하며, 이러한 데이터셋은 수집 비용이 높고 항상 완벽한 데이터를 확보하기 어렵다는 한계가 존재한다.19) 특히, 주행 데이터는 운전 환경의 불확실성, 다양한 차량 특성과 도로 환경, 인간 운전자의 주관적 판단 등 여러 요인으로 인해 비효율적이거나 비합리적인 행동을 포함할 가능성이 크며, 행동 복제의 경우 이러한 행동들을 모방하여 주행성능이 저하될 수 있다. 반면, 오프라인 강화학습은 보상을 기반으로 가치판단을 진행하기 때문에 비효율적인 행동을 억제하고 누적 보상이 최대가 되는 행동을 선택하도록 학습할 수 있다.

오프라인 강화학습 기반 자율주행 연구에서 다양한 오프라인 강화학습 알고리즘의 성능을 비교 분석하는 것은 중요하다. 오프라인 강화학습 알고리즘은 구현 방식에 따라 주행 데이터셋에 존재하는 상태-행동을 학습에 반영하는 방식이 다르기 때문에, 알고리즘별로 주행 데이터의 특성에 적응하는 방식이 상이하다. 따라서, 다양한 알고리즘을 비교 분석함으로써 오프라인 강화학습 기반 자율주행 학습의 신뢰성을 확보해야 한다.

오프라인 강화학습 기반 자율주행 연구는 활발히 진행되고 있지만, 다양한 도로 구조를 동시에 고려하여 통합 주행 학습을 다룬 연구는 여전히 부족한 상황이다.20-22) 특히, 병목 구간 및 램프 병합 구간과 같이 차량간 상호작용의 경우의 수가 매우 다양한 상황에서, 두 도로 구조에서 모두 안정적으로 동작할 수 있는 통합 자율주행 의사결정 모델을 학습하는 것은 해결해야 할 핵심적인 문제이다.

따라서, 본 연구에서는 복합적인 도로 구조에서 오프라인 강화학습을 활용하여 다양한 품질의 데이터셋에서도 효율적으로 주행 모델을 학습할 수 있음을 실험을 통해 검증한다. 이를 위해 Partially observable Markov decision process 모델을 설계하여 복합 도로 환경에서의 효과적인 주행 모델 학습을 목표로 한다. 특히 IQL23) 알고리즘을 중심으로 다양한 오프라인 강화학습 알고리즘 및 행동 복제 방식과의 비교를 통해 IQL이 상대적으로 우수한 성능을 보임을 확인하며, 알고리즘 간의 성능 차이를 분석한다.

본 논문의 구성은 다음과 같다. 2장에서 본 연구에 대한 선행 연구를 살펴본 후, 3장에서는 본 연구에서 제안하는 복합 도로에서의 효율적인 주행 학습을 위한 POMDP 및 IQL 기반 자율주행 학습 방법에 대해 소개한다. 4장에서는 오프라인 강화학습 및 행동 복제 기반 자율 주행 자동차의 성능을 평가하고, 5장에서는 본 연구의 결론을 다룬다.

2. 선행연구

2.1. 심층 강화학습 기반 자율주행 연구

강화학습은 개체가 환경과의 상호작용을 통해 누적보상이 최대가 되는 행동 정책을 학습하는 방법이다. 여기서 정책이란, 개체가 특정 상태나 관측에 대한 행동을 결정하는 함수를 의미한다. 강화학습은 불확실하고 동적인 환경에서 효율적인 의사결정이 필요한 자율주행 분야에 널리 활용되고 있으며 다양한 도로 환경에서 강화학습 기반 주행 정책을 학습하는 연구가 활발히 진행되고 있다.8-11)

강화학습 기반 자율주행 연구는 직선 도로 및 고속도로와 같이 비교적 간단한 도로 구조에서의 문제를 해결하는 연구를 시작으로 발전되었다.8,9) 최근에는 보다 현실적인 주행 정책의 필요성이 대두됨에 따라, 복잡하고 불규칙한 교통 정체가 발생하는 환경에서의 강화학습 기반 자율주행 연구가 활발히 수행되고 있다.10,11) 예를 들어, 차량밀도가 높은 온램프 및 오프램프 구간에서 안전한 차선변경을 고려하는 연구가 있으며,10) 차선 감소 구간이 존재하는 램프 병합 구간에서 성공적인 추월 행동 학습을 위해 강화학습 주행 정책을 구축한 연구가 존재한다.11)

이처럼 강화학습 기반 자율주행 정책은 비교적 복잡한 도로 환경에서도 성공적인 주행이 가능함이 보고되고 있지만, 현재 대부분의 연구에서는 단일 도로 구조에서의 문제 해결만을 고려한다.21,22) 그러나 보다 현실적인 자율주행 기술을 위해서는 다양한 도로 구조에서도 성공적인 주행이 가능한 주행 정책의 구축이 필요하다. 이에, 본 연구는 램프 병합 구간 및 병목구간이 포함된 복합 도로에서 성공적인 주행을 위한 강화학습 기반 자율주행 정책 구축을 목표로 한다.

2.2 데이터셋 기반 자율주행 연구

안전한 자율주행 정책 구축을 위해서는 학습 과정에서 실제 도로 환경과 상호작용이 필요 없는 데이터 기반의 학습 방식이 고려될 수 있다. 모방학습은 전통적인 데이터 기반 방식으로, 모방학습 기반 자율주행 연구 또한 꾸준히 고려되어 왔다.24,25) 구체적으로 고속도로에서 인간 운전자의 주행 행동을 모방한 안전한 주행 정책 학습에 관한 연구24)와, CNN 및 모방학습 기반의 CNNO 방법론을 통해 높은 정확도의 스티어링 각도 예측을 실행하는 연구가 존재한다.25) 하지만 데이터셋 내 행동을 그대로 복제하는 모방학습의 특성상, 해당 방식을 활용하기 위해서는 전문가를 통해 수집된 높은 품질의 주행 데이터가 필수적으로 요구된다는 어려움이 존재한다.22)

최근에는 이러한 모방학습의 한계를 극복하기 위한 방법으로 오프라인 강화학습 기반 자율주행 연구가 활발히 고려되고 있다.14-17) 오프라인 강화학습은 기존의 모방학습 방식과 달리 데이터셋에 대한 가치 평가를 통해 데이터셋의 품질 대비 개선된 주행 정책을 학습할 수 있다고 알려져 있다. 예를 들어, Variational autoencoder를 통해 운전 행동을 스킬로 분리하여 오프라인 강화학습을 기반으로 장기 주행 경로 계획 문제를 해결한 연구가 있으며,14) 교차로(Intersection)에서 좌회전 시나리오를 고려하여 오프라인 강화학습 기반의 주행 정책을 학습하는 연구가 존재한다.15) 이외에도 3차선 고속도로(Highway), 교차로 등 다양한 도로 구조에서 오프라인 강화학습을 활용한 연구들이 수행되고 있다.16,17)

이처럼 오프라인 강화학습은 안전한 주행 정책의 학습을 가능하게 하며, 기존의 모방학습 기반 방법론 대비 개선된 성능의 의사결정 모델을 구축할 수 있다. 이에, 본 연구에서는 데이터 기반 방식 중 오프라인 강화학습을 활용하여 자율주행 정책 모델을 구축한다.

2.3 오프라인 강화학습 알고리즘

오프라인 강화학습은 사전에 수집된 데이터만을 활용한 정책 학습을 고려하기 때문에 주행 정책의 행동 분포가 달라지는 Out of Distribution(OOD) 문제가 발생할 수 있다.13) 이에, 오프라인 강화학습 연구는 이러한 OOD 문제를 우회하기 위해 보수적인 학습 방법을 취하는 방향으로 발전하고 있다.26)

대표적인 오프라인 강화학습 방법론으로는 모방학습 기반 방식, Value regularization 방식, In-sample learning 방식이 존재한다.26) 여기서, 모방학습 기반 방식은 기존의 강화학습 방법론과 모방학습을 결합한 방법론으로 IL 알고리즘이 대표적이다.27) 해당 알고리즘에서는 기존 강화학습 알고리즘28)의 정책 학습 과정에서 행동 복제 규제항을 추가하여 가치평가와 모방을 동시에 진행하는 방식을 제안했다. Value regularization 방식은 정책 평가를 위한 가치 함수를 규제하는 방법으로 알려져 있다. 대표적인 알고리즘으로는 Conservative Q Learning(CQL)29) 방식이 있으며, 해당 방식에서는 데이터셋에 포함되지 않은 행동의 가치를 매우 낮게 평가함으로써 보수적인 학습을 수행하였다. 마지막으로 In-sample learning 방식은 가치함수 학습 시 데이터셋에 존재하지 않는 상태-행동 쌍에 대한 가치 평가를 학습에서 배제하는 방식으로, OOD 샘플에 대한 평가 자체를 수행하지 않는다는 특징을 갖는다. 대표적인 알고리즘으로는 본 연구에서 고려하는 IQL23) 알고리즘이 있다.

이처럼 오프라인 강화학습 알고리즘은 다양한 관점에서 발전되고 있으며, OOD 문제 완화에 효과적임이 보고되고 있다. 이에, 본 연구에서는 오프라인 강화학습 방법론 중 In-sample learning인 IQL 기반의 자율 주행 정책을 제안한다. 이때, 다양한 오프라인 강화학습 알고리즘이 적용되었을 때의 주행 정책과의 비교를 통해 제안 방식의 성능을 분석한다.

3. 복합 도로 구조 환경에서 자율주행 정책 학습을 위한 오프라인 강화학습 모델 설계

강화학습을 위한 환경은 Markov decision process를 통해 모델링할 수 있다. MDP에서 개체는 환경의 모든 상태 정보를 관측 가능하다고 가정한다. 하지만, 도로 주행환경에서 개체가 모든 상태 정보를 관측하는 것은 현실적으로 어려움이 있기 때문에 본 연구에서는 부분적인 관측정보를 기반으로 의사결정을 수행하는 POMDP를 통해 주행환경을 모델링한다.30) POMDP는 튜플 < S, A, T, Ω, O, R, γ >로 정의되고, 각각은 주행환경의 모든 정보를 포함한 상태 정보 st ∈ S, 자율 주행 자동차, 즉 개체가 실행 가능한 행동 at ∈ A, 상태 전이 확률 T(st+1|st,at), 개체가 상태 정보로부터 관측한 정보 ot ∈ O, 특정 상태 st에서 ot를 관측할 확률 Ω(ot|st) 보상 함수 rt = Rt(st,at,st+1), 감가율 γ ∈ [0,1)을 나타낸다.

3.1 복합 도로 환경

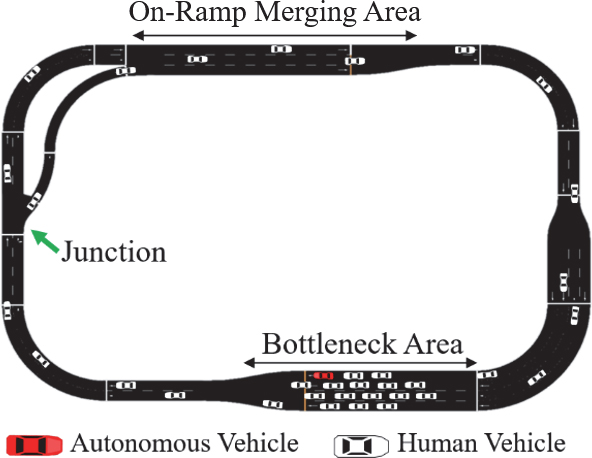

본 연구에서는 여러 도로 구조가 존재하는 복합적인 도로 환경에서 활용가능한 하나의 통합 주행 정책 학습을 목표로 한다. 이에 Fig. 1과 같은 램프 병합 구간(On-Ramp merging area)과 병목 구간(Bottleneck area)이 동시에 존재하는 도로 환경을 고려하며, 램프 병합 구간 진입을 위한 분기점(Junction)과 각 도로 구조를 연결하는 고속도로(Highway)를 포함하고 있다. 해당 도로 환경에서는 총 N대의 차량 C = {c1,c2, ..., cN}이 주행하며, 차선 감소 구간(Lane reduction zone)에서의 합류 또는 교통 정체로 인해 복잡하고 다양한 도로 환경이 조성된다. 이때 한 대의 자율 주행 자동차 cN는 다수의 일반차량 CHV = {c1,c2, ..., cN-1}과 함께 주행하며 램프 병합 구간에서는 합류 차선에서 본 차선으로 안전하게 합류하는 것을 목표로 하고, 병합 구간에서는 교통 정체를 효율적으로 통과하는 것을 목표로 한다.

도로 내의 모든 정보를 포함하는 상태 st ∈ S는 다음과 같이 정의된다.

| (1) |

식 (1)에서 vt = [vt,1,vt,2, ..., vt,N]T는 도로 환경 내 모든 차량의 절대 속도를 의미하며, pt = [pt,1,pt,2, ..., pt,N]T는 절대위치, nt = [nt,1,nt,2, ..., nt,N]T는 차량이 위치한 차선번호, dt = [dt,1,dt,2, ..., dt,N]T는 차선 감소 구간까지 남은 거리를 의미한다.

3.2 Partially Observable Markov Decision Process 문제 정의

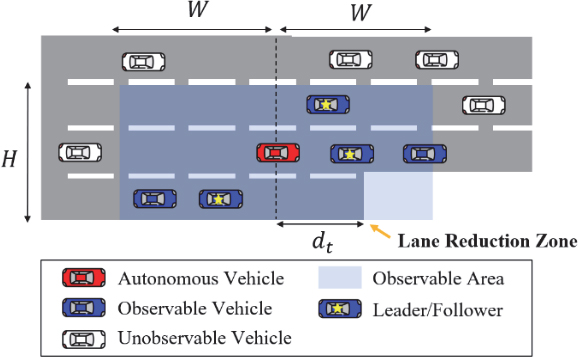

현실적인 주행 환경의 모델링에는 부분적인 관측 정보를 기반으로 의사결정을 진행하는 POMDP가 적합 하다. 이에, 본 연구에서 개체는 Fig. 2와 같이 부분적인 주행 정보를 활용하여 의사결정을 수행한다. 구체적으로 자율 주행 자동차는 전후방 W만큼의 거리와 자신이 위치한 차선을 포함하는 H개의 차선을 관측하며, 이를 관측가능 영역(Observable area)이라 한다. 관측가능 영역내에 존재하는 차량들의 집합 Ct,obs은 다음과 같은 조건을 만족한다.

| (2) |

| (3) |

여기서, Δpt,i와 Δnt,i는 자율 주행 자동차 cN와 i번째 일반 차량 ci과의 상대 거리 및 상대 차선을 의미한다.

| (4) |

이때, Ct,obs 중 관측 가능한 차선 h에 대해 자율 주행자동차 전방에 있는 차량들 (pt,i > pt,N)의 집합을 전방 차량 집합 Lt,h로 정의하며, 자율 주행 자동차 후방에 있는 차량들 (pt,i < pt,N)의 집합을 후방 차량 집합 Ft,h으로 정의한다. 이때, 차선별 전후방 관측차량 중 자율 주행 자동차와 가장 가까이 있는 차량을 Leader/Follower로 정의하며, 각각 lt,h와 ft,h로 표현한다. 이때, 자율 주행자동차와 동일차선 (nt,i = nt,N) Leader/Follower에 대해 와 로 정의한다.

Observation : 자율 주행 자동차의 t 시점 관측정보 ot ∈ O는 다음과 같이 정의한다.

| (5) |

식 (5)에서 vt,N은 자율 주행 자동차의 절대 속도이며, pt,N은 자율 주행 자동차의 절대 위치를 의미한다. 은 자율 주행 자동차와 차선별 Leader/Follower의 상대 속도이고, 는 상대 거리이다. 는 자율 주행 자동차의 전방 관측가능영역 내 차선 별 차량 밀도를 나타내고, 이는 차선별전방 관측 차량 대수인 |Lt,h|로 계산된다. 구체적으로 i번째 차량의 길이 ei 및 차량간 최소 안전거리 δ0를 다음과 같이 정의한다.

| (6) |

다음으로, 는 각 차선별 주행 가능 거리를 나타낸다. 구체적으로, 특정 차선 h ∈ H가 개체의전방 관측 거리 W 내에서 감소하는 경우, ζt,h ≤ W로 정의되며, 이는 전방 관측 가능 영역 내 주행 가능 거리인 dt로 계산된다(Fig. 2). 반면, 차선 감소가 없을 경우 ζt,h = W의 값을 갖는다.

Action : 자율 주행 자동차의 t 시점 행동 at ∈ A 은 다음과 같이 정의된다.

| (7) |

여기서 at,acc는 자율 주행 자동차의 가속도 조절 행동을 의미하고 at,lc는 차선변경행동을 의미한다. 가속도 조절행동 at,acc ∈ [amin,amax]은 최소 가속도 amin 와 최대 가속도 amax 내에 연속적인 범위의 값을 갖는다. 차선변경행동 at,lc는 {-1,0,1}의 이산적인 행동으로 정의되며, 각각 오른쪽으로 차선변경, 차선 유지, 왼쪽으로 차선변경을 의미한다.

Reward : 자율 주행 자동차의 t시점 보상 rt = 는 t 시점의 상태 st에서 개체의 행동 at와 t+1시점의 상태 st+1의 값을 통해 계산된다. 본 연구에서는 복합도로 구조에서 성공적인 주행 행동 학습을 위해 다음과 같은 보상함수를 고려한다.

| (8) |

여기서, Rt,driving은 자율 주행 자동차의 성공적 주행을 위한 보상항이며, Rt,safety는 안전한 주행을 위한 보상항을 의미한다. 또한, Rt,merge는 합류구간에서의 주행행동 학습을 위한 보상항이다.

1) 성공적 주행 보상항(Rt,driving): 자율 주행 자동차의 성공적인 속도 조절 및 차선변경을 위한 보상항 Rt,driving은 다음과 같이 정의한다.

| (9) |

여기서 η는 상수로 정의되며, 각 보상항에 대한 중요도 계수를 의미한다.

먼저, 속도 조절을 위한 보상항 Rt,vel은 다음과 같이 정의된다.

| (10) |

식 (10)은 자율 주행 자동차가 목표속도 v*에 가깝게 주행하면서 제한속도 vlimit을 초과하지 않는 주행 행동을 유도하기 위한 보상항이다. 구체적으로, 자율 주행 자동차는 목표속도 v*에 가깝게 주행할수록 최대의 보상을 획득하고 v*를 초과하여 주행할 경우 보상은 선형적으로 감소하게 된다. 또한 제한속도 vlimit를 초과할 경우 페널티를 받게 된다.

차선변경을 위한 보상항 Rt,lc 는 무의미한 차선변경 완화를 위해 설계되었으며, 다음과 같다.

| (11) |

식 (11)을 통해, |at,lc| = 1인 경우 즉, 자율 주행 자동차가 차선변경 행동을 수행했을 때 상수의 페널티를 부여한다. 해당 항을 통해 자율 주행 자동차는 차선변경 페널티를 감수하고도 얻을 수 있는 보상이 더 큰 경우에만 차선변경을 수행하도록 학습된다.

가가속도 최소화를 위한 처벌항 Rt,jerk은 다음과 같이 정의된다.

| (12) |

식 (12)에서 는 t-1 과 t 사이의 가속도 변화량으로, 해당 값이 클수록 높은 페널티를 부여한다. 이는 자율 주행 자동차의 급가속 또는 급감속 행동을 완화하기 위한 목적으로 설계하였다.

2) 안전 주행 보상항(Rt,safety): 안전한 주행을 위한 보상항 Rt,safety 은 다음과 같이 정의한다.

| (13) |

여기서 Rt,l은 자율 주행 자동차와 동일 차선 Leader와의 안전거리 유지를 목적으로 하며, 다음과 같이 정의한다.

| (14) |

여기서, 자율 주행 자동차와 동일 차선 Leader와의 상대 거리 가 안전거리 보다 짧을 경우 페널티를 받는다. 이때, 안전거리 는 다음과 같이 정의된다.

| (15) |

식 (15)에서 δ0는 최소 안전거리를 의미하며, t*는 사고를 피하기 위해 필요한 최소 시간을 의미한다.

Rt,f은 자율 주행 자동차와 동일 차선 Follower와의 안전거리 유지를 위한 항으로 다음과 같다.

| (16) |

식 (16)은 차선변경 시 활성화되며, Follower와의 상대거리가 안전거리보다 짧아지면 페널티를 받게 된다. 이때, 동일차선 Follower와의 안전거리 는 다음과 같이 정의된다.

| (17) |

마지막으로 충돌 사고 발생 시 처벌항 Rt,crash은 다음과 같이 정의된다.

| (18) |

자율주행 시스템에서 충돌 사고는 가장 피해야 할 주행 행동으로, 본 연구에서는 해당 처벌항의 계수인 ηcrash을 가장 높은 값으로 설정하여 충돌 사고를 피하는 주행 경향성을 학습하도록 하였다.

3) 합류 주행 보상항(Rt,merge): 합류구간에서 본차선으로의 성공적 합류를 유도하기 위한 처벌항 Rt,merge 은 다음과 같이 정의한다.

| (19) |

식 (19)에서 ζt+1,c는 전환지점까지 남은 거리를 의미한다. 해당 값이 작아질수록, 즉 전환 지점과 가까운 지점에서 본 차선과의 합류를 수행할수록 지연된 합류로 간주하여 더욱 높은 페널티를 부여한다. 여기서, μt+1는교통 밀도 가중치로 다음과 같이 정의된다.

| (20) |

식 (20)에서 W는 전방 관측가능 영역을 의미하며 |Lt,main|는 본 차선의 전방 관측가능 영역 내 존재하는 차량의 대수를 의미한다. 관측가능 영역 내에 다수의 차량이 존재할 때, 즉, 본 차선의 높은 교통밀도로 인해 차선변경이 불가능한 상황에서 Rt,merge 로 인한 페널티를 완화한다.

다음 절에서는 앞서 정의한 POMDP 기반의 오프라인 강화학습 기반 자율주행 정책 학습을 위해 IQL을 활용한 학습 방법을 제안한다.

3.3 Implicit Q-Learning 기반 자율주행 정책 학습

본 연구에서는 복합 도로 상황에서 안전한 주행 정책 구축을 위해 오프라인 강화학습 기반의 주행 정책 학습을 수행한다.

자율주행 도메인에서는 사소한 예측 오류가 심각한 안전사고로 이어질 가능성이 크다. 특히, 주변 차량과의 상호작용이 빈번한 램프 병합 구간과 병목구간에서는 안정적이고 신뢰할 수 있는 의사결정이 필수적이다. 이에, 정책 학습 과정에서 OOD 샘플의 활용을 완전히 배제함으로써 보다 안전한 주행 정책을 구축할 수 있는 IQL 알고리즘을 고려한다.

학습을 위한 데이터셋 D은 3.2절의 POMDP를 기반으로 사전 학습된 개체를 통해 수집되며, 각 데이터 샘플은 튜플 형태로 정의된다.

자율주행 정책 πΦ 학습을 위해 본 연구에서는 크리틱 네트워크 Qθ1, Qθ2 및 VΨ를 활용한다. 여기서 Qθi 네트워크는 관측-행동 쌍 (ot,at)의 가치를 평가하며, VΨ 네트워크는 특정 관측 ot에서의 가치를 근사한다. 이때, 학습의 안정성을 위해 각각의 Target Q 네트워크 를 고려한다. 각 네트워크의 입출력 요소는 Table 1을 통해 확인할 수 있다.

관측-행동 쌍에 대한 가치를 근사하는 Qθi 네트워크의 학습은 Temporal-Difference(TD) 에러에 기반하며, 손실함수 LQ(θi)는 다음과 같이 정의한다.

| (21) |

식 (21)에서, 는 TD 타겟으로, Qθi 는 해당 TD 타겟과의 오차를 최소화하는 방향으로 업데이트된다. 이때, TD 타겟 계산에 Vψ(ot+1)를 활용함으로써 Qθi 학습 시 데이터셋 내에 존재하지 않는 상태-행동쌍에 대한 평가를 고려하지 않는다. 이는 데이터셋 내의 주행 행동만을 활용한 학습을 가능하게 하며 궁극적으로 OOD 문제를 완화한다.

관측 정보에 대한 가치를 근사하는 Vψ 학습을 위한 손실함수 Lv(ψ)는 다음과 같이 정의한다.

| (22) |

이때, Vψ 네트워크의 손실함수 계산 시 와 중 작은 값을 활용함으로써 Vψ의 과대추정을 방지한다. 식 (22)에서 은 비대칭적 손실함수인 Expectile regression을 의미하며, 다음과 같이 정의한다.

| (23) |

식 (23)에서, τ가 1.0에 가까울수록, Vψ 네트워크는 현재 관측정보 ot에 대한 가치를 데이터셋 내의 최대 보상 기댓값 로 평가하게 된다.

액터 네트워크의 손실함수 Lπ(Φ)는 Qθ와 Vψ을 기반으로 계산되며, 다음과 같이 정의한다.

| (24) |

식 (24)에서, 는 데이터셋 내 특정한 관측 ot에서의 행동 분포 at를 모방하기 위한 항이며, 모방의 정도는 상수 β 및 Qmin - Vψ(ot)을 통해 결정된다. IQL은 식 (24)을 통해 데이터셋 내 상대적으로 높은 가치를 갖는 행동을 학습할 수 있다.

마지막으로, Target Q 네트워크 , 는 급격한 변화를 방지하기 위해 Soft update 기반으로 업데이트 되며, 이는 다음과 같이 정의한다.

| (25) |

이때, σ ∈ [0,1]은 Soft update 가중치를 의미한다.

4. 성능 측정 및 결과 분석

본 장에서는 오프라인 강화학습 기반 자율 주행 자동차의 학습 결과 분석 및 주행 성능 평가를 수행한다. 먼저, 실험을 위한 시뮬레이터의 설정과 데이터셋에 대해 정의한 후, 오프라인 강화학습 기반 주행 정책과 모방학습 기반 주행 정책의 특성과 경향성의 차이에 대해 분석한다. 이후 다양한 평가 지표를 활용하여 주행 성능을 종합적으로 평가하고, 이를 통해 각 알고리즘을 비교한다.

4.1 시뮬레이션 및 학습 환경 설정

본 연구에서는 실험을 위해 교통 제어 시뮬레이터인 SUMO31) 기반의 강화학습 라이브러리를 지원하는 FLOW32) 프레임워크를 사용하였다. 자율 주행 자동차는 H = 3 차선과 전후방 W = 30 m 범위를 관측한다. 도로환경 내 모든 차량의 수는 N = 35이며, 1대의 자율 주행 자동차를 포함한다. 이때, 모든 차량들의 목표속도 v*는49.27 km/h이며, 제한속도 vlimit은 113 km/h으로 설정하였다. 또한 최저 및 최고 가속도의 값은 각각 amin = -5.4 m/s2, amax = 5.4 m/s2를 가진다. 주행 에피소드 실행시간 TE = 3,000ts으로 1ts는 0.1 s로 설정하였다.

도로 환경 내에 존재하는 일반차량 ci ∈ CHV 는 Intelligence Driving Model(IDM)33) 기반의 가속도 제어를 수행하며, SUMO lane change model34)을 통해 차선변경 행동을 제어한다. IDM은 동일 차선 Leader 차량과의 상대 거리와 상대 속도, 목표속도 등을 기반으로 가속도 값을 결정하며, SUMO lane change model은 도로 환경 및 인접 차선의 상황 등을 고려하여 차선변경 시점을 결정한다.

4.2 학습 알고리즘, 데이터셋 및 평가 지표 정의

본 절에서는 성능 비교를 위해 활용된 오프라인 및 모방학습 알고리즘에 대해 설명하고, 학습 과정에서 활용된 다양한 품질의 데이터셋 구성 및 특성에 대해서 정의한다.

본 연구에서는 IQL 기반 자율주행 정책의 성능 평가를 위해 데이터 기반 알고리즘과의 비교를 수행한다. 본연구에서 고려하는 비교 알고리즘은 다음과 같다.

- · Implicit Q Learning (Proposed)23): 유망한 오프라인 강화학습 방법론으로, 본 연구에서 제안하는 주행 정책 학습을 위한 알고리즘이다. 특정 상태에서 선택한 행동의 기대 보상 값을 직접적으로 사용하지 않고 상태 가치 함수를 기반으로 정책을 학습한다.

- · Conservative Q Learning (CQL)29): 행동이 과대 평가되지 않도록 보수적으로 학습하는 오프라인 강화학습 방법론이다. 크리틱 네트워크 학습 시 데이터셋에 존재하지 않는 행동에 대해 낮은 Q 값을 가지도록 규제항을 도입하여 안정적인 학습을 유도한다.

- · Imitative Learning (IL)27): 기존 액터 크리틱 알고리즘의 액터 네트워크 목적함수에 데이터셋을 모방하는 규제항을 추가한 알고리즘이다. 이를 통해 데이터셋의 상태-행동을 직접적으로 모방하면서 동시에 가치평가를 진행한다.

- · Behavior Cloning (BC): 모방학습의 대표적인 방법으로, 데이터셋 내 행동과 학습된 주행 정책의 차이를 최소화하는 방향으로 학습된다.

각 알고리즘에 대한 하이퍼파라미터 설정은 Appendix A1에서 확인할 수 있다.

주행 데이터셋은 그 특성상 다양한 운전 실력의 운전자들로부터 수집될 수 있으며, 각 운전자들의 운전 실력에 따라 여러 품질의 주행 데이터를 포함할 수 있다. 이에 본 연구에서는 다양한 품질의 데이터셋과 혼합 데이터셋을 고려하였으며, 시뮬레이션 환경에서 사전 학습된 다양한 성능의 주행 정책을 통해 수집하였다. 이때, 주행 정책은 온라인 강화학습 방식인 Twin delayed deep deterministic policy gradient 알고리즘28)을 통해 앞서 제안한 도로구조 및 POMDP를 기반으로 학습되었다. 본 연구에서 고려하는 데이터셋들은 총 1.2M개의 샘플로 이루어져 있으며, 3,000 Time step으로 구성된 에피소드를 400번 수행하여 구축되었다. 이때, 사전 수집된 정책의 성능에 따라 다양한 품질의 데이터셋을 고려하였으며, 데이터셋의 특징은 다음과 같다.

- · Final dataset: 가장 높은 품질의 데이터셋으로, 복합도로 환경에서 학습이 완료된 시점의 주행 정책을 기반으로 수집되었다.

- · Medium dataset: 학습이 완료되지 않은 개체로부터 수집된 데이터셋으로, 보상 값을 기준으로 학습이 완료된 개체 대비 50 %의 성능을 보이는 개체로 수집되었다.

- · Initial dataset: 낮은 품질의 데이터셋으로 전체 학습기간 대비 10 %, 즉, 학습 초기 단계에서 수집된 데이터셋을 의미한다.

- · Random dataset: 가장 낮은 품질의 데이터셋으로, 모든 상태에서 무작위로 행동을 선택하는 개체를 통해 수집되었다.

- · Final + Medium dataset: Final 데이터셋과 Medium 데이터셋을 동일한 비율로 혼합한 데이터셋이다. 혼합 데이터셋 중 가장 높은 품질을 가진다.

- · Medium + Random dataset: Medium 데이터셋과 Random 데이터셋을 동일한 비율로 혼합한 데이터셋이다.

- · Initial + Random dataset: Initial 데이터셋과 Random 데이터셋을 동일한 비율로 혼합한 데이터셋으로 가장 낮은 품질을 가진다.

- · Merge dataset: 램프 병합 구간만 존재하는 도로 환경에서 학습된, 학습 완료 시점의 주행 정책을 기반으로 수집되었다.

- · Bottleneck dataset: 병목 구간만 존재하는 도로 환경에서 학습 완료된 주행 정책을 기반으로 수집되었다.

본 연구에서는 각 알고리즘의 성능을 분석을 위한 평가지표로 Normalized reward를 고려하며, 이는 다음과같이 정의한다.

| (26) |

여기서 rewardπϕ는 학습된 정책 모델 πϕ의 보상을 의미하며, rewardrandom 및 rewardfinal는 각각 Random 데이터셋과 Final 데이터셋에 포함된 주행 데이터의 평균 보상을 의미한다. 즉, Normalized reward 값이 높을수록, 해당주행 정책의 성능이 우수함을 의미한다.

4.3 데이터셋에 따른 오프라인 강화학습 기반 자율 주행 자동차의 학습 성능 분석 및 평가

본 절에서는 학습 시 경험한 도로 환경에 따른 각 도로 구조에서의 주행 성능과 데이터셋 품질에 따른 주행 정책 모델의 성능을 비교한다. 이후, 높은 성능을 보이는 주행 정책 간의 주행 성능 비교를 통해 IQL 기반 자율주행 정책 모델의 우수성을 분석한다.

본 절에서는 도로 환경별 데이터셋에 따른 각 도로 구조에서의 성능을 비교하기 위해 램프 병합 구간과 병목 구간에서 수집한 보상에 대해 Normalized reward를 비교한다. 비교를 위해 고려하는 학습 도로 환경은 다음과 같다.

- · Complex road structure (proposed): 제안하는 복합 도로 구조 환경에서 학습된 주행 정책으로, Final dataset을 기반으로 학습했다.

- · On-ramp merging area: 램프 병합 구간만 존재하는 단일 도로 환경에서 학습된 주행 정책으로, Merge Dataset을 기반으로 학습했다.

- · Bottleneck area: 병목 구간만 존재하는 단일 도로 환경에서 학습된 주행 정책으로, Bottleneck dataset을기반으로 학습했다.

Table 2는 램프 병합 구간과 병목구간에서 각 알고리즘별 주행 정책의 Normalized reward를 비교한 표이다. 해당 결과를 통해 알고리즘의 차이보다는 학습 시 경험한 도로구조에 따라 경향성이 나누어짐을 보였으며, 단일 도로 환경에서 학습된 주행 정책은 해당 도로 구조에서는 우수한 성능을 보이지만 학습 시 경험하지 않은 다른 도로 구조에서는 성능이 감소하는 경향을 보였다. 예를 들어 IQL의 경우 램프 병합 구간에서 학습했을 때 해당 구간에서는 1.02 ± 0.01의 Normalized reward가 측정되었으나, 병목 구간에서는 0.68 ± 0.27으로 감소하였다. 반면, 제안한 복합 도로 구조에서 학습된 주행 정책의 Normalized reward는 램프 병합 구간에서 1.10 ± 0.02, 병목 구간에서 1.06 ± 0.03으로 모든 구간에서 안정적인 성능을 보였다. 이는 복합 도로 환경을 포함한 데이터셋을 활용하는 것이 주행 정책의 일반화 성능을 향상시키는 데 효과적임을 의미한다.

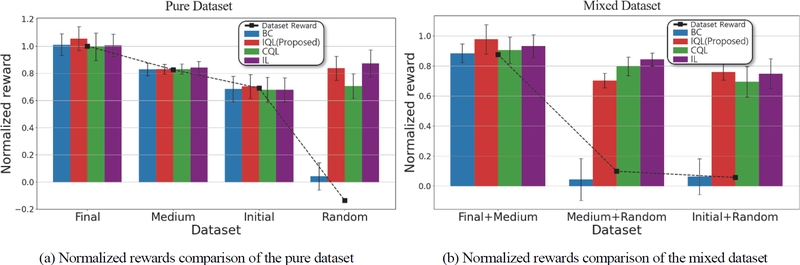

Fig. 3은 데이터셋 품질에 따른 Normalized reward를 측정한 결과이다. 여기서, x축은 데이터셋 종류, y축은 10개 랜덤 시드에 대한 Normalized reward을 의미한다. 막대 상단의 에러바는 1차 표준 편차를 의미하며, 꺽은선 그래프는 데이터셋 자체의 Normalized reward로, 해당 데이터셋의 품질을 반영한다. 이후 절 내용부터는 알고리즘별 성능을 단일 데이터셋 및 혼합 데이터셋 관점에서 분석한다.

1) 단일 데이터셋: Fig. 3(a)는 단일 데이터셋을 고려했을 때의 Normalized reward를 나타낸 결과이다. 해당 결과를 통해 사전 학습된 주행 정책으로부터 수집된 데이터셋을 통해 학습할 경우, 학습 성능은 데이터셋의 성능에 비례하는 것을 확인할 수 있다. 반면, 무작위 주행 정책을 기반으로 수집된 Random 데이터셋을 고려할 경우 BC의 성능은 크게 감소하지만 오프라인 강화학습 알고리즘은 높은 성능을 유지하는 것을 확인할 수 있다. 이는 오프라인 강화학습 알고리즘이 데이터셋 내 상태-행동 쌍에 대해 가치 평가를 진행하여, 상대적으로 높은 가치를 갖는 행동을 학습할 수 있기 때문이다.

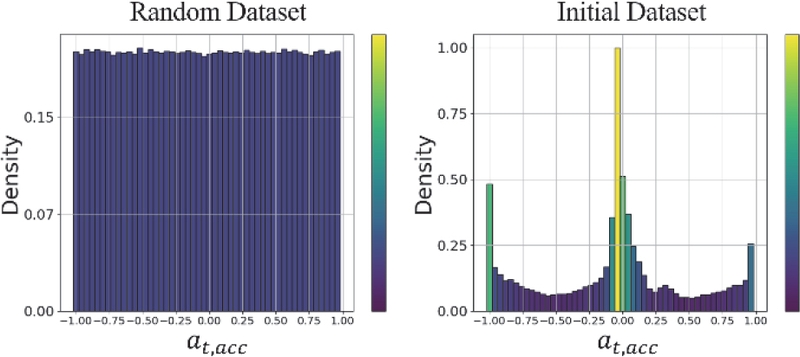

이때, 오프라인 강화학습 알고리즘의 성능은 Initial 데이터셋을 고려했을 때보다, 품질이 가장 낮은 Random 데이터셋에서 더 높은 것을 확인할 수 있다. 이는 데이터셋 품질뿐만 아니라, 데이터셋 내 행동의 다양성 또한 학습에 중요한 영향을 미침을 의미한다.35,36) 구체적으로 Random 및 Initial 데이터셋이 포함하고 있는 행동 분포는 Fig. 4를 통해 확인할 수 있다. 여기서 x축은 가속도 조절 행동 at,acc의 값을 의미하며, y축은 빈도를 의미한다. 해당 결과를 통해 Random 데이터셋의 행동 분포가 Initial 데이터셋보다 균일함을 확인할 수 있며, 이는 Random 데이터셋이 Initial 데이터셋보다 행동 다양성이 높다는 것을 의미한다. 즉, 다양성 높은 데이터 내에서 상대적으로 높은 가치를 갖는 행동을 학습하는 오프라인 알고리즘 특성상, 높은 행동 다양성을 갖는 Random 데이터셋을 고려할 때 더욱 개선된 정책을 학습할 수 있음을 시사한다.

2) 혼합 데이터셋: Fig. 3(b)는 혼합 데이터가 고려되었을 때의 Normalized reward를 측정한 그래프이다. 해당 결과에서도 오프라인 강화학습 알고리즘은 모든 데이터셋에서 0.7 이상의 Normalized reward 값을 보이는 것을 확인할 수 있다. 반면, BC의 경우 Random 데이터셋이 고려된 혼합 데이터셋에서 매우 낮은 성능을 보이는 것을 확인할 수 있다. 이는 혼합 데이터셋을 고려하더라도 오프라인 강화학습은 BC 방법론 대비 개선된 주행 정책을 구축할 수 있음을 의미한다.

해당 분석을 통해 오프라인 강화학습 방법론이 주행 정책 학습에 있어서 데이터셋의 품질 저하에 강건한 것을 확인할 수 있으며, 이는 오프라인 강화학습 기반 자율주행 정책의 유효성을 나타낸다. 그러나, 주행 정책 학습을 위한 알고리즘을 선택하는 기준에서는 단순한 보상 값의 비교 뿐만 아니라 주행 환경에서의 성능 비교가 필요하다. 이에, 다음 절에서는 Normalized reward 기준 높은 성능을 보이는 주행 정책을 주행 성능 관점에서 분석한다.

본 절에서는 각 알고리즘을 통해 구축된 주행 정책의 주행 성능을 평가한다. 모든 주행 정책들은 제안한 POMDP환경에서 수집된 데이터셋을 통해 학습되었으며, 이때, 유의미한 비교를 위해 각 알고리즘별 Normalized reward가 0.85를 초과하는 우수한 주행 정책에 대해 주행성능을 측정하였다. 본 연구에서 고려하는 주행 성능 측정 지표는 다음과 같다.

- · Agility: 자율 주행 자동차의 속도로, 에피소드 길이 TE 동안의 평균 속도로 정의된다.

| (27) |

- · Bottleneck travel time: 병목 구간을 통과하는데 소요된 시간으로, 병목 구간의 길이 및 병목 구간에서의 자율 주행 자동차의 평균 속도 에 대해서 로 정의한다.

- · Merge travel time: 램프 병합 구간의 평균 통과 시간을 의미하며, 램프 구간의 길이 와 램프 구간 내 자율 주행 자동차의 평균 속도 에 대해서 로 정의한다.

- · Time-to-Collision: 자율 주행 자동차가 현재의 속도 vt,N를 유지할 경우, 동일 차선 Leader 와 충돌까지 남은 시간을 의미한다.

| (28) |

- 이때, 는 지시함수를 의미하며, 자율 주행 자동차와 동일 차선 Leader와의 상대 속도가 양수일 때 인 경우에 0의 값을 갖는다.

- · Safety: 자율 주행 자동차의 충돌율을 의미하며, 전체 주행 에피소드 Etotal대비 충돌사고가 발생한 에피소드 Ecollision 의 비율로 정의된다.

| (29) |

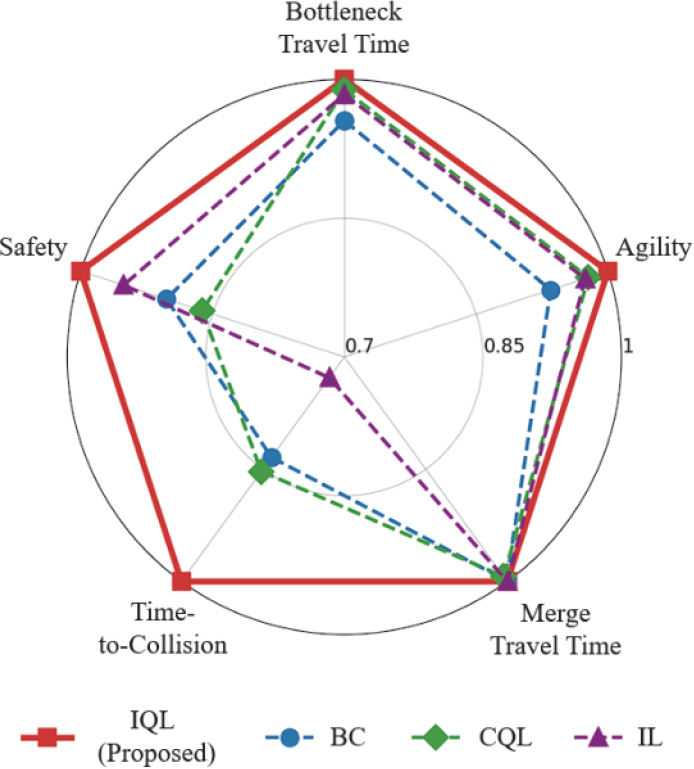

Fig. 5는 알고리즘별 주행성능에 대한 레이더 차트를 나타낸다. 여기서, 각 Marker는 각각의 알고리즘을 나타내며, 각각의 주행 지표는 높은 값을 가질수록 우수한 주행 성능임을 나타냈다. 구체적으로 해당 지표들은 주행 정책의 주행 성능 데이터들에 대해 Min-Max 정규화를 진행한 후 IQL 성능을 기준으로 변환하였다.

해당 결과를 통해 IQL 기반 자율주행 정책이 모든 주행 성능 지표에서 우수한 값을 보이는 것을 확인할 수 있다. 특히, 주행 안전성과 관련된 지표인 Safety 및 Time-to-Collision에서 비교 알고리즘 대비 각각 평균 19.5 %, 9.48 % 높게 측정되는 것을 확인할 수 있는데, 제안하는 IQL 기반 자율주행 정책을 고려할 경우 안전하면서도 효율적인 주행이 가능함을 의미한다. 이는 IQL이 데이터셋에 포함되지 않은 상태-행동 쌍들에 대한 평가를 배제하여 OOD문제를 성공적으로 해결함으로써 제안한 POMDP 기반의 주행 정책을 효과적으로 학습하였기 때문이다. 반면, 각 도로 구조 별 성능과 관련된 지표인 Bottleneck travel time과 Merge travel time의 경우IQL을 포함한 각 알고리즘간 차이가 크지 않은 것을 확인할 수 있다. 이는 각 알고리즘별 주행정책이 동일한 POMDP를 기반으로 학습되었으며, 그 중에서 높은 Normalized reward를 가지는 주행 정책들은 각 구간에서 성공적인 주행이 가능하기 때문이다.

5. 결론 및 토의

본 연구에서는 램프 병합 구간과 병목 구간이 동시에 존재하는 복합 도로 환경에서 주행 정책 학습을 위한 POMDP 모델을 정의하였으며, 데이터셋에 포함되지 않은 데이터들의 가치 평가를 배제함으로써 OOD문제를 완화한 IQL 기반의 주행 정책 학습 방식을 제안하였다. 제안 방식의 성능을 확인하기 위해 다양한 품질의 데이터셋을 정의하였고, IQL을 포함한 CQL, IL등 다양한 오프라인 알고리즘과 모방학습 알고리즘인 BC와의 Normalized reward를 비교하였다. 이를 통해 오프라인 강화학습이 모방학습 대비 데이터셋 품질 저하에 강건함을 확인하였으며, 보상 값의 단순한 비교가 아닌 주행 성능을 통해 각 알고리즘의 경향성을 확인하였다. 해당 결과에서 IQL이 다른 알고리즘에 대비 모든 지표해서 우수함을 보였으며, 안전과 관련된 지표인 Safety 및 Time-to-Collision에서 타 알고리즘 대비 각각 19.5 %, 9.48 % 향상된 성능을 보이는 것을 확인하였다.

본 논문에서 제안한 방식은 시뮬레이터 환경에서 평가되었으며, 이는 실제 자율주행 자동차에서의 실험과는 다소 차이가 존재한다. 이에 따라 향후 연구에서는 실제 도로 환경에서 수집된 데이터를 활용하여 시뮬레이터 환경에서 검증할 것이며, 보다 현실적인 도로 환경을 반영하기 위해 램프 병합구간 및 병목 구간을 포함한 다양한 도로 환경을 구축할 예정이다.

Nomenclature

| S : | state space |

| A : | action space |

| T : | state transition probability |

| Ω : | observation probability |

| O : | observation space |

| R : | reward function |

| γ : | discount factor |

| st : | state |

| at : | action |

| ot : | observation |

| N : | the number of vehicles |

| C : | a set of all vehicles |

| CHV : | a set of human-driven vehicles |

| CAV : | a set of autonomous vehicles |

| Ci ≠ N : | human-driven vehicles |

| CN : | autonomous vehicle |

| vt : | velocity vector of vehicles |

| pt : | position vector of vehicles |

| nt : | lane indices vector of vehicles |

| dt : | distance to lane reduction zones |

| W : | observation range, m |

| H : | number of observable lanes |

| Ct,obs : | a set of observed vehicles |

| Lt,h : | a set of leaders in lane h |

| Ft,h : | a set of followers in lane h |

| lt,h : | nearest leader in lane h |

| ft,h : | nearest follower in lane h |

| ζt : | drivable distance vector |

| pt : | traffic density vector |

| ei : | length of i-th vehicle, m |

| δ0 : | minimum safe distance, m |

| at,acc : | acceleration action |

| at,lc : | lane-changing action |

| amin : | minimum acceleration limit, m/s2 |

| amax : | maximum acceleration limit, m/s2 |

| v* : | target velocity, km/s |

| vlimit : | speed limit, km/s |

| Qθ : | state-action value network |

| : | target state-action value network |

| LQ(θ) : | loss function for the critic network |

| VΨ : | state value network |

| Lv(Ψ) : | loss function for the value network |

| : | expectile regression loss function |

| Πθ : | actor network (policy) |

| LΠ(Φ) : | loss function for the actor network |

| : | length of bottleneck area, m |

| : | length of on-ramp merging area, m |

| TE : | Length of an episode |

| Etotal : | Total number of episodes |

| Ecollision : | Number of accident episodes |

Subscripts

| t : | time step |

| i : | index for individual vehicle |

| h : | lane index within the observation range |

| c : | same lane as the autonomous vehicle |

| : | nearest leader in the autonomous vehicle’s lane |

| : | nearest follower in the autonomous vehicle’s lane |

Acknowledgments

A part of this paper was presented at the KSAE 2024 Fall Conference and Exhibition

이 성과는 정부(과학기술정보통신부)의 재원으로 한국연구재단(RS-2023-00278812) 및 정보통신기획평가원-대학ICT연구센터(ITRC)의 지원을 받아 수행된 연구임(IITP-2025-RS-2020-II201602).

References

-

S. Kim, Y. Kim, H. Jeon, D. Kum and K. Lee, “Autonomous Driving Technology Trend and Future Outlook: Powered by Artificial Intelligence,” Transactions of KSAE, Vol.30, No.10, pp.819–830, 2022.

[https://doi.org/10.7467/KSAE.2022.30.10.819]

-

Q. Rao and J. Frtunikj, “Deep Learning for Self-Driving Cars: Chances and Challenges,” Proceedings of the International Workshop on Software Engineering for AI in Autonomous Systems, pp.35–38, 2018.

[https://doi.org/10.1145/3194085.3194087]

-

B. Kiran, I. Sobh, V. Talpaert, P. Mannion, A. Sallab, S. Yogamani and P. Pérez, “Deep Reinforcement Learning for Autonomous Driving: A Survey,” IEEE Transactions on Intelligent Transportation Systems, Vol.23, No.6, pp.4909–4926, 2021.

[https://doi.org/10.1109/TITS.2021.3054625]

-

T. Kim, H. Lee, K. Kim and S. Hwang, “Path-Following Strategies for 4-Wheel Independent Steering EVs Using PPO Reinforcement Learning and Turning Radius Gain,” Transactions of KSAE, Vol.31, No.8, pp.575–584, 2023.

[https://doi.org/10.7467/KSAE.2023.31.8.575]

-

C. Eom, D. Lee and M. Kwon, “Autonomous Driving Strategy for Bottleneck Traffic with Prioritized Experience Replay,” Journal of the Korean Institute of Communications and Information Sciences, Vol.48, No.6, pp.690–703, 2023.

[https://doi.org/10.7840/kics.2023.48.6.690]

-

S. J. Kim, G. M. Shin, J. S. Jeon, J. Y. Bang, J. Y. Kim and S. I. Jeong, “A Study on Highway Driving Decision Making with Hybrid Action for Autonomous Vehicles Using Deep Reinforcement Learning,” Journal of the Korean Institute of Communications and Information Sciences, Vol.49, No.12, p.1671, 2024.

[https://doi.org/10.7840/kics.2024.49.12.1671]

-

Y. J. Jo, H. J. Jeong and G. H. Hwang, “Autonomous Vehicle Based on Deep Reinforcement Learning to Prevent Traffic Congestion in V2X,” Journal of the Korean Institute of Communications and Information Sciences, Vol.48, No.10, p.1235, 2023.

[https://doi.org/10.7840/kics.2023.48.10.1235]

-

K. Makantasis, M. Kontorinaki and I. Nikolos, “Deep Reinforcement-Learning-Based Driving Policy for Autonomous Road Vehicles,” IET Intelligent Transport Systems, Vol.14, No.1, pp.13–24, 2020.

[https://doi.org/10.1049/iet-its.2019.0249]

-

S. Nageshrao, H. Tseng and D. Filev, “Autonomous Highway Driving Using Deep Reinforcement Learning,” IEEE International Conference on Systems, Man and Cybernetics, pp.2326–2331, 2019.

[https://doi.org/10.1109/SMC.2019.8914621]

- F. Ye, S. Zhang, P. Wang and C. Chan, “Automated Lane Change Strategy Using Proximal Policy Optimization-Based Deep Reinforcement Learning,” IEEE Intelligent Vehicles Symposium, 2020.

-

S. Hwang, J. Kim, H. Jeong and Y. Park, “Autonomous Vehicle Cut-In Algorithm for Lane-Merging Scenarios via Policy-Based Reinforcement Learning Nested Within Finite-State Machine,” IEEE Transactions on Intelligent Transportation Systems, Vol.23, No.10, pp.17594–17606, 2022.

[https://doi.org/10.1109/TITS.2022.3153848]

-

G. Dulac-Arnold, N. Levine, D. Mankowitz, J. Li, C. Paduraru, S. Gowal and T. Hester, “Challenges of Real-World Reinforcement Learning: Definitions, Benchmarks and Analysis,” Machine Learning, Vol.110, pp.2419–2468, 2021.

[https://doi.org/10.1007/s10994-021-05961-4]

-

R. Prudencio, M. Maximo and E. Colombini, “A Survey on Offline Reinforcement Learning: Taxonomy, Review, and Open Problems,” IEEE Transactions on Neural Networks and Learning Systems, Vol.35, No.8, pp.10237–10257, 2023.

[https://doi.org/10.1109/TNNLS.2023.3250269]

-

Z. Li, F. Nie, Q. Sun, F. Da and H. Zhao, “Boosting Offline Reinforcement Learning for Autonomous Driving with Hierarchical Latent Skills,” IEEE International Conference on Robotics and Automation, pp.18362–18369, 2024.

[https://doi.org/10.1109/ICRA57147.2024.10611197]

-

M. Melkumov and A. Panov, “Planning Maneuvers for Autonomous Driving Based on Offline Reinforcement Learning: Comparative Study,” International Conference on Intelligent Information Technologies for Industry, pp.65–74, 2023.

[https://doi.org/10.1007/978-3-031-43789-2_6]

-

B. Mirchevska, M. Werling and J. Boedecker, “Optimizing Trajectories for Highway Driving with Offline Reinforcement Learning,” Frontiers in Future Transportation, Vol.4, 2023.

[https://doi.org/10.3389/ffutr.2023.1076439]

-

C. Diehl, T. Sievernich, M. Krüger, F. Hoffmann and T. Bertram, “Uncertainty-Aware Model-Based Offline Reinforcement Learning for Automated Driving,” IEEE Robotics and Automation Letters, Vol.8, No.2, pp.1167–1174, 2023.

[https://doi.org/10.1109/LRA.2023.3236579]

-

A. Ly and M. Akhloufi, “Learning to Drive by Imitation: An Overview of Deep Behavior Cloning Methods,” IEEE Transactions on Intelligent Vehicles, Vol.6, No.2, pp.195–209, 2020.

[https://doi.org/10.1109/TIV.2020.3002505]

-

M. Zare, P. Kebria, A. Khosravi and S. Nahavandi, “A Survey of Imitation Learning: Algorithms, Recent Developments, and Challenges,” IEEE Transactions on Cybernetics, Vol.54, No.1, pp.310–326, 2024.

[https://doi.org/10.1109/TCYB.2024.3395626]

- F. Ye, S. Zhang, P. Wang and C. Chan, “A Survey of Deep Reinforcement Learning Algorithms for Motion Planning and Control of Autonomous Vehicles,” IEEE Intelligent Vehicles Symposium, pp.1073–1080, 2021.

- Y. Chen, C. Ji, Y. Cai, T. Yan and B. Su, “Deep Reinforcement Learning in Autonomous Car Path Planning and Control: A Survey,” arXiv preprint arXiv:2404.00340, , 2024.

-

J. Wu, C. Huang, H. Huang, C. Lv, Y. Wang and F. Wang, “Recent Advances in Reinforcement Learning-Based Autonomous Driving Behavior Planning: A Survey,” Transportation Research Part C: Emerging Technologies, Vol.164, Paper No. 104654, 2024.

[https://doi.org/10.1016/j.trc.2024.104654]

- I. Kostrikov, A. Nair and S. Levine, “Offline Reinforcement Learning with Implicit Q-Learning,” International Conference on Learning Representations, 2022.

-

Z. Cui, Y. Wang, N. Bian and H. Chen, “Reward Machine Reinforcement Learning for Autonomous Highway Driving: A Unified Framework for Safety and Performance,” International Conference on Vehicular Control and Intelligence, pp.1–6, 2023.

[https://doi.org/10.1109/CVCI59596.2023.10397271]

-

O. Qureshi, M. Durrani and S. Raza, “Imitation Learning for Autonomous Driving Cars,” International Conference on Artificial Intelligence, pp.58–63, 2023.

[https://doi.org/10.1109/ICAI58407.2023.10136686]

-

D. Lee, C. Eom, S. Choi, S. Kim and M. Kwon, “Survey on Practical Reinforcement Learning: From Imitation Learning to Offline Reinforcement Learning,” Journal of the Korean Institute of Communications and Information Sciences, Vol.48, No.11, pp.1405–1417, 2023.

[https://doi.org/10.7840/kics.2023.48.11.1405]

- S. Fujimoto and S. Gu, “A Minimalist Approach to Offline Reinforcement Learning,” Advances in Neural Information Processing Systems, Vol.34, pp.20132–20145, 2021.

- S. Fujimoto, H. Hoof and D. Meger, “Addressing Function Approximation Error in Actor-Critic Methods,” International Conference on Machine Learning, pp.1587–1596, 2018.

- A. Kumar, A. Zhou, G. Tucker and S. Levine, “Conservative Q-Learning for Offline Reinforcement Learning,” Advances in Neural Information Processing Systems, Vol.33, pp.1179–1191, 2020.

- G. Kang, J. Lee, C. Eom and M. Kwon, “Autonomous Driving Strategy Using Offline Reinforcement Learning with Diverse Quality Driving Datasets,” KSAE Fall Conference Proceedings, 2024.

-

P. Lopez, M. Behrisch, L. Bieker-Walz, J. Erdmann, Y. Flötteröd, R. Hilbrich and E. Wießner, “Microscopic Traffic Simulation Using SUMO,” Proceedings of the International Conference on Intelligent Transportation Systems, pp.2575–2582, 2018.

[https://doi.org/10.1109/ITSC.2018.8569938]

- C. Wu, A. Kreidieh, K. Parvate, E. Vinitsky and A. Bayen, “Flow: A Modular Learning Framework for Mixed Autonomy Traffic,” IEEE Transactions on Robotics, Vol.36, No.4, pp.1093–1112, 2020.

-

M. Treiber, A. Hennecke and D. Helbing, “Congested Traffic States in Empirical Observations and Microscopic Simulations,” Physical Review E, Vol.62, No.2, pp.1805–1824, 2000.

[https://doi.org/10.1103/PhysRevE.62.1805]

- J. Erdmann, “Lane-Changing Model in SUMO,” Simulation of Urban Mobility User Documentation, https://sumo.dlr.de, , 2015.

- Y. Chebotar, Q. Vuong, K. Hausman, F. Xia, Y. Lu, A. Irpan and S. Levine, “Q-Transformer: Scalable Offline Reinforcement Learning via Autoregressive Q-Functions,” Conference on Robot Learning, pp.3909–3928, 2023.

- X. Yu, C. Bai, H. Guo, C. Wang and Z. Wang, “Diverse Randomized Value Functions: A Provably Pessimistic Approach for Offline Reinforcement Learning,” arXiv preprint arXiv:2404.06188, , 2024.