자율주행 레이싱을 위한 장애물 회피 경로 계획 및 추종 알고리즘

Copyright Ⓒ 2025 KSAE / 235-02

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

The development of autonomous vehicle technology has been driven by advancements in artificial intelligence and high-performance sensor capabilities for ensuring safety and efficiency. Recently, the demand for robust and rational control stability in high-speed driving scenarios has increased, prompting the organization of various autonomous driving racing competitions. This paper presents a collision avoidance algorithm designed to address small obstacles, such as debris, in autonomous driving scenarios. Utilizing an improved YOLO model and sensor fusion-based perception algorithm, small obstacles were detected at distances of up to 150 meters. To ensure optimized path selection in high-speed environments, Frenet Optimal Trajectory Planning was employed for path planning. Kinematic Model Predictive Control(MPC) and PID control were applied to track the selected path. The proposed algorithm was implemented on a mass-production vehicle(AVANTE CN7) and tested in the KIAPI proving ground environment, achieving reasonable performance during the preliminary round of the 2024 University Autonomous Driving Competition.

Keywords:

Autonomous vehicle racing, Path planning, Vehicle control, MPC, Frenet frame, Sensor fusion, Object detection키워드:

자율주행 자동차 레이싱, 경로 계획, 차량 제어, 모델 예측 제어, 프레넷 프레임, 센서 융합, 객체 인지1. 서 론

자율주행 자동차 시스템은 인공지능과 머신러닝, 고성능 센서 기술의 발전을 통해 안전성과 효율성을 갖춘 주행 기술로 빠르게 발전하고 있다. 특히 최근에는 고속주행 상황에서도 정교한 제어와 안정성을 구현하는 데 중점을 두면서, 극한의 조건을 요구하는 자율주행 레이싱 분야로 연구의 관심이 확대되고 있다. 이러한 흐름 속에서 F1-Tenth, Indy challenge, 현대자동차 자율주행 챌린지와 같은 대회들이 고속 환경에서 자율주행 레이싱을 목표로 개최되고 있다. 다수 차량이 동시에 주행하는 레이싱 환경에 대응하는 자율주행 기술 개발을 위하여 인지, 판단, 제어 알고리즘에 대한 연구들이 수행되고 있다.

인지 알고리즘과 관련된 대표 연구는 다음과 같다. Wang과 Jia1)는 2D object detection 결과를 활용하여 객체의 바운딩 박스 내부에 투영된 라이다 포인트클라우드를 대상으로 3D 영역 제안을 수행함으로써 탐색 공간을 제한하였다. Yang 등2)은 이미지 기반의 Semantic segmentation 결과를 활용하여 객체의 픽셀에 투영된 포인트클라우드를 클러스터링함으로써 원시 포인트클라우드 데이터에 추가적인 정보를 더해주었다.

자율주행 차량의 구조에서 판단은 매우 필수적인 역할을 담당하고 있다. 단순히 교통 법규를 준수하는 것부터, 회피, 추월 등의 상황을 정확하게 판단해야 한다. 이러한 판단구조는 대표적으로 학습 기반과 규칙 기반으로 나누어진다. Tian 등3)은 강화 학습 알고리즘인 PPO-C를 사용해 자율주행 레이싱 상황에서 기존의 대표적인 심층 강화 학습(DRL) 알고리즘과 비교해 우수한 결과를 보여주었다. 대표적인 자율주행 오픈소스 플랫폼 Autoware4)에서는 Final state machine을 사용하여 판단 단계를 구현하며 이는 일반적인 상황에서 합리적인 판단을 제공한다.

자율주행 차량을 안전하고 효율적으로 목적지까지 이동시키는 경로 계획 연구는 기존 경로 탐색 알고리즘의 발전부터 차량에 최적화된 경로 계획 알고리즘까지 많은 연구가 수행되고 있다. Werling 등5)과 Huang 등6)은 Frenet 좌표계를 활용하여 자율주행 차량의 경로 생성 문제를 다루며, 횡방향 및 종방향 운동의 통합 최적화를 통해 안전하고 편안한 주행 궤적을 생성하는 알고리즘을 제안하였다. 이 알고리즘들은 동적 교통 상황에서 안전한 차선 변경, 거리 유지 및 속도 유지를 위한 최적 제어 솔루션을 제공하며, Werling 등5)의 경우 실제 차량에서의 구현을 통해 그 성능을 입증하였다. Kim 등7)은 무인자율차량을 위한 샘플링 기반 지역 경로 계획 방법을 제안하였다. Alcala 등8)은 고속 자율주행 레이싱 차량의 경로 계획을 위해 선형 파라미터 변동 모델 기반 경로 계획(LPV-MP)을 제안하였다. 또한 해당 연구에서는 정적 장애물만을 고려한 경로 계획 방법을 다루었다. Betz 등9)은 Indy autonomous challenge에 참가하며, 단기 계획 단계(STPS)와 장기 계획 단계(LTPS)를 통해 고속 자율주행환경에서 효율적인 경로 계획에 대한 연구가 진행되었다. He 등10)은 병렬 계산을 통해 시간 효율성을 높이고 3차 Bezier-곡선과 학습 기반 MPC를 활용한 알고리즘을 설계하였다. Liniger와 Lygeros11), Wang 등12)에서는 게임이론을 활용하여 최적의 경로를 생성하는 연구를 진행하였다.

경로 계획을 통해 결정된 경로를 정확하게 추종하기 위한 경로 추종 – 제어 알고리즘과 관련된 대표 연구는 다음과 같다. Hwang 등13)은 단순한 LKAS(Lane Keeping Assistance System)에 모델 기반 예측 제어기를 활용하여 최대 80 km/h의 속도에서 성능을 검증하였다. Katriniok 등14)은 도로 교차로에서 Connected Automated Vehicles(CAVs)의 완전 분산 제어 시스템 아키텍처 설계를 위하여 Nonconvex Optimal Control Problem(OCP)를 활용하여 Model Predictive Control(MPC)를 적용하였다. Zhou 등15)은 CARLA 시뮬레이터 환경에서 경로 추종을 위한 기존 MPC와 Event-Triggered MPC를 비교하였다. Pérez-Gil 등16)은 Deep Reinforcement Learning (DRL), Deep Q-learning (DGN), Deep Deterministic Policy Gradient (DDPG)를 구현하여 비교 평가를 수행하였다. Yang 등17)은 인지 알고리즘에 적용되는 Convolutional Neural Network(CNN)을 제어 시스템에 접목하여 End-to-End 알고리즘을 설계하였다. Hwang 등13), Katriniok 등14), Zhou 등15)에서는 MPC를 활용한 규칙 기반 제어 알고리즘을 설계하였으며, Pérez-Gil 등16), Yang 등17)에서는 신경망을 활용한 학습 기반 제어 알고리즘을 설계하였다.

이와 같은 기존 연구들은 주로 각각의 모듈에 대한 단독 연구이거나 시뮬레이션 환경 혹은 스케일카 등을 활용해 진행되었다. 하지만 다양한 모듈을 통합하고 실차를 활용해 적용 가능성을 확인하는 연구의 필요성도 요구되고 있다. 따라서 본 논문의 연구는 자율주행 레이싱환경에서 발생할 수 있는 충돌 회피를 위해 기존 연구들을 발전시키고 나아가 새로운 방법을 제안하며 이를 실차에 적용해 PG에서 검증하였다.

본 논문의 기여는 다음과 같다.

- 1. 정적 장애물 객체 인지를 위하여 센서 퓨전 기반 인지 알고리즘을 설계하였으며, Test set에서 Recall 0.985를 달성하여 10 ~ 150 m 거리 내의 소형 객체 대부분을 정확하게 인지함을 확인하였다.

- 2. Frenet 좌표계 기반의 경로 계획 알고리즘의 적절한 비용 함수 내의 가중요소 결정을 통한 안정적인 충돌 회피 경로를 생성하였다.

- 3. 최적 경로를 추종하기 위한 MPC 기반 횡방향 제어 알고리즘과 PID 제어 기반 종방향 제어 알고리즘을 적용하였다.

본 논문의 나머지 구성은 다음과 같다. 2장에서는 센서 퓨전 기반의 장애물 인지 알고리즘을 제시한다. 3장에서는 Frenet 좌표계 기반의 최적 경로 계획 알고리즘을 기술한다. 4장에서는 제안된 최적 경로를 추종하기 위한 종-횡방향 제어 알고리즘을 다룬다. 5장 및 6장에서는 실험 환경과 결과를 다루며 마지막 장에서는 연구의 결론을 제시한다.

2. 센서 퓨전 기반 장애물 객체 인지 알고리즘

본 논문에서는 먼 거리에 있는 객체를 탐지하고, 3차원상에서의 정확한 위치 좌표를 계산하기 위해 카메라와 라이다로 구성된 다중 센서 시스템을 채택하였다. 두 센서 데이터 사이의 정합 정밀도를 높이기 위해 체커 보드를 활용하여 Target 기반 Camera -LiDAR 캘리브레이션을 수행하였으며, 소형 객체 검출 성능을 높이기 위해 텍스처 정보가 풍부한 이미지 데이터에 2D object detection을 적용하였다. 2D object detection의 경우 Less detect layer 구조의 YOLO-LDL 모델20)을 활용하여 연산량을 줄이고, 하드웨어 자원 소모를 최소화하였다. 또한 실차 환경에서의 실시간 대응 및 안전한 주행을 위해 인지 알고리즘 최적화를 진행하여 10 Hz 이상의 응답 속도를 확보하였다.

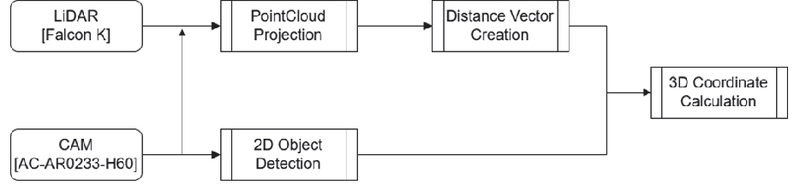

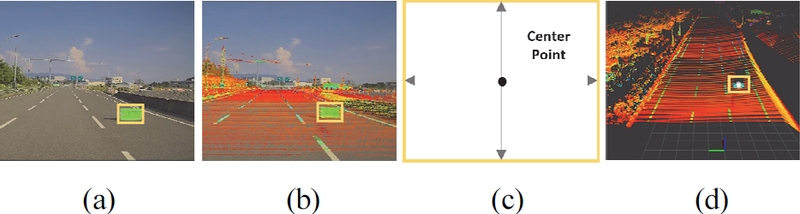

본 연구에서 활용한 센서 퓨전 기반 인지 알고리즘의 구조는 Fig. 1과 같으며 2D object detection, PointCloud projection, Distance vector creation, 3D coordinate calculation의 네 가지 프로세스로 구성된다. 해당 구조는 이미지의 텍스처 정보를 활용하여 소형 객체 검출에서 우수한 성능을 보이는 2D object detection, Point cloud의 거리 정보를 보존하는 Distance vector creation 프로세스를 포함하여 소형 객체의 거리 정보를 정확하게 예측할 수 있다. Fig. 2(a)는 YOLOv5를 기반으로 객체를 탐지하고 바운딩 박스로 시각화한 결과이며, Fig. 2(b)는 포인트 클라우드를 이미지로 투영한 결과이다. 이 과정에서 각 이미지 픽셀에 투영된 포인트 클라우드의 X, Y, Z 값을 벡터 형태로 변환하여 거리 정보를 보존하였다. 이후 Fig. 2(c)와 같이 포인트 클라우드 거리 정보를 보유하고 있는 픽셀 중 객체의 바운딩 박스의 센터 좌표에 제일 근접한 픽셀을 선별하였고, 해당 픽셀의 거리 정보를 바탕으로 Fig. 2(d)와 같이 객체의 3차원 좌표를 복원하였다.

3. Frenet 좌표계 최적 경로 계획

기존의 직교 좌표계에서는 경로의 종, 횡 방향 경로와 차량의 위치 관계가 연관되어 계산 복잡도가 증가한다. 본 연구에서는 Frenet 좌표계 기반의 최적 경로 계획을 이용해 종 방향과 횡 방향 경로를 독립적으로 진행하여 연산량과 계산 효율을 높이고, 다양한 비용 함수와 제약 조건을 적용해 최적의 경로를 선택하였다.

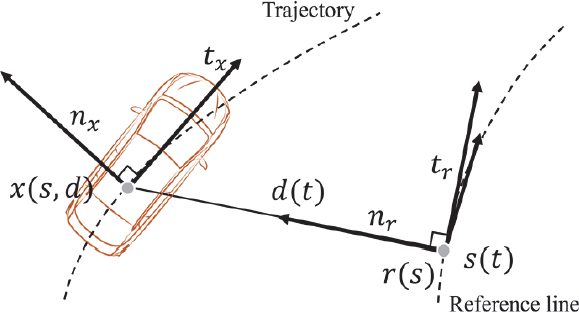

3.1 Frenet 좌표계 변환

Frenet 좌표계에서는 도로 중심선을 기준으로 기준선을 따라가는 방향을 s축으로, 기준선에 수직인 방향을 d축으로 정의한다. Fig. 3에서 차량의 위치 x(s,d)는 Frenet 좌표계에서 표현되며, s(t)는 시간 t에 따른 기준선 상의 위치를 나타낸다. d(t)는 차량이 기준선 수직 방향으로의 위치를 나타낸다. nx, nr 은 각각 차량과 기준선의 방향벡터를 나타낸다.

3.2 Frenet 좌표계 경로 계획

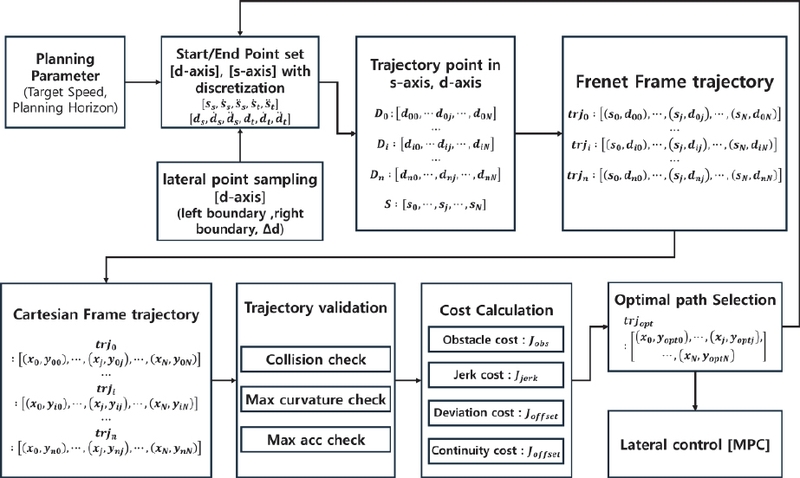

Fig. 4는 Frenet 최적 경로 계획 알고리즘의 모델 개략도이다. Frenet 좌표계에서 경로를 생성하기 위해 경로의 초기 상태와 종료 상태를 식 (1), (2)으로 정의하였다.

| (1) |

| (2) |

식 (1), (2)에서 정의된 상태량들을 활용하여 4차 다항식 기반의 종방향 경로와 5차 다항식 기반의 횡방향 경로를 생성하며, 이는 식 (3), (4)와 같다.19)

| (3) |

| (4) |

생성된 후보 경로들을 활용하여 최대 곡률 제한과 최대 가속도 제한이 반영되어 제약 조건에 부합되는 일부 후보 경로들을 도출하였다.

생성된 후보 경로 중 충돌 회피를 위한 최적 경로를 선택하기 위하여 식 (5)와 같이 비용 함수 Jfrenet가 정의되었다. Jfrenet은 가가속도(jerk), d 축으로의 오프셋, 충돌, 연속성이 반영되었다. 식 (5)를 통해 도출된 최적 경로는 직교 좌표계로 변환하여 4절에 언급될 횡방향 제어 알고리즘의 요구 경로로 활용되었다.

| (5) |

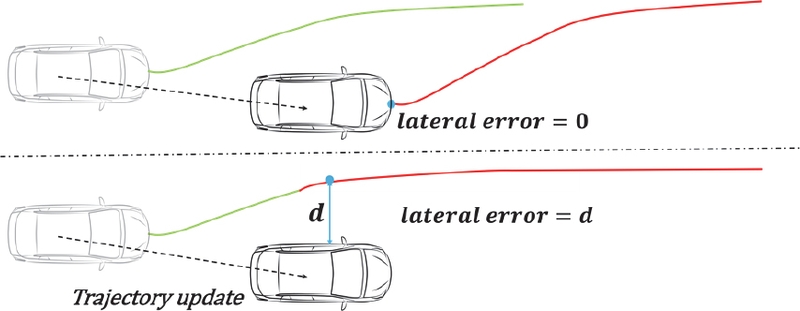

3.3 경로의 갱신

본 논문에서는 기존의 Frenet 최적 경로 계획 알고리즘들에서 자차의 위치를 기준으로 계속에서 경로를 갱신하는 것과 달리 Fig. 5와 같이 이전에 선택된 최적 경로의 n번째 Trajectory point의 상태량을 다음 경로의 초기 상태로 사용해 경로를 생성하였다. 차량의 Frenet 좌표계 기준 위치(s,d) 기준으로 n번째 점의 s좌표에 도달하면 경로를 갱신하였다. 해당 방법을 사용함으로써 경로 생성의 비용을 줄일 수 있으며 연속성을 보장할 수 있다. 또한 경로의 비용이 비슷해 최적 경로의 선택이 급격하게 바뀌는 현상을 방지하여 안정적인 경로 선택과 추종이 가능하게 하였다.

4. 경로 추종을 위한 종방향 및 횡방향 제어 알고리즘

4.1 종방향 제어 알고리즘

자율주행 자동차의 종방향 제어를 위하여 요구 종방향 속도 vxdes와 현재 종방향 속도 vx와 비례, 적분, 미분 제어 이득 값 kp, ki, kd을 활용하여 Proportional-Integral-Derivative (PID) 제어기를 설계하였다. PID 제어기의 제어 입력은 요구 종방향 가속도 axdes이며, 이는 식 (6), (7)과 같다.

| (6) |

| (7) |

4.2 횡방향 제어 알고리즘

MPC는 현재 시점을 기준으로 예측 구간 Np까지 시스템의 동작을 예측하고 최적 제어 입력을 도출할 수 있는 제어 알고리즘이다. 본 논문에서 활용된 횡방향 제어기는18)을 활용하여 설계되었다. 자율주행 자동차의 횡방향 제어를 위하여 기구학 모델, 동역학 모델 및 학습 기반 시스템 모델 등 다양한 방법론이 존재한다. 본 연구에서는 동역학, 학습 기반 시스템 모델보다 모델 파라미터가 상대적으로 적고 계산 효율성이 높은 기구학 모델 기반 비선형 자전거 모델을 활용하였다. 설계된 기구학 모델 기반 비선형 자전거 모델의 상태 공간 방정식은 다음과 같이 표현될 수 있다.

| (8) |

식 (8)에서 δr는 요구 조향 각도를 나타내며 애커만 조향 시스템을 기반으로δr = atan(Lk)로 표현될 수 있다. 여기서 곡률은 요구 각도와 웨이포인트의 거리를 통해서 계산될 수 있으며, 로 표현될 수 있다. 계산된 k의 노이즈를 최소화하기 위하여 CV(Constant Velocity) 모델을 적용하여 칼만필터를 활용하였다. MPC의 비용함수는 가중치 Q, R를 활용하여 다음과 같이 표현될 수 있다.

| (9) |

식 (9)에서 Y,Yref, U, Uref는 각각 예측된 상태량, 요구 상태량, 예측된 제어 입력, δr이 포함된 요구 조향각도 행렬을 나타낸다.

5. 성능 평가

5.1 센서 및 하드웨어 구성

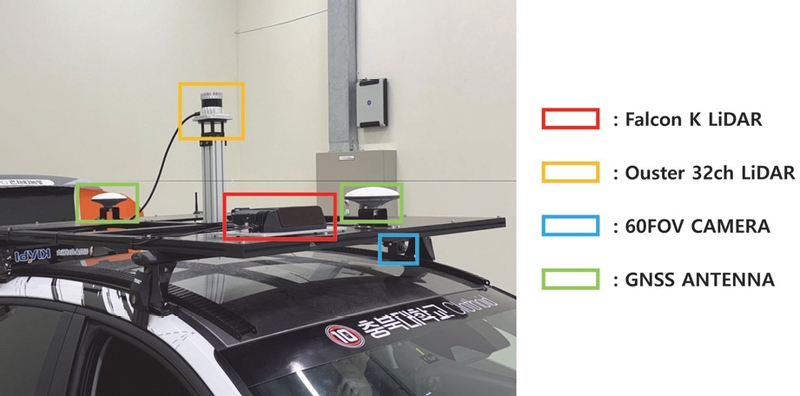

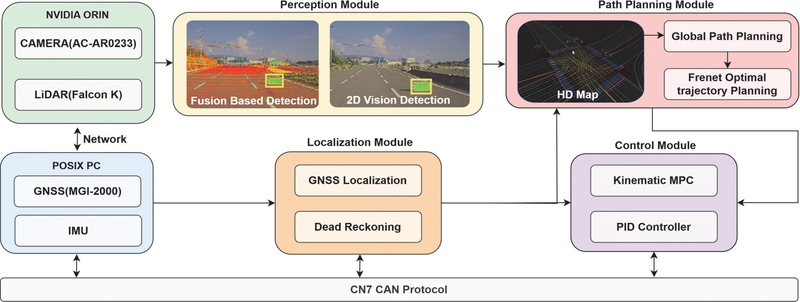

본 논문에서는 고속 자율주행을 구현하기 위한 다양한 센서를 활용하였다. 특히 전방의 장거리의 객체를 효율적으로 검출하기 위해 고채널의 Solid-State LiDAR를 카메라와 함께 사용하였다. 그리고 시스템의 효율을 위해 센서 데이터 처리와 자율주행 알고리즘을 구동하는 PC 2대로 나누어 활용하였다. Table 1, 2에서 활용된 센서와 PC의 상세 구성을 확인할 수 있다. 설계된 자율주행 알고리즘은 2023년형 AVANTE CN7 차량에 적용되어 구현 및 검증하였다. Fig. 6, 7을 통해 실제 차량에 장착된 센서와 차량의 모습을 확인할 수 있다.

Fig. 8에서는 자율주행 시스템 구성도를 나타내었다. 전체 모듈은 CAN 통신, 위치인식, 인지, 경로 계획, 제어 모듈로 구성되며 2대의 PC에서 나누어 작동된다. 각 모듈 간의 통신은 ROS message를 통해 진행하였다. CAN 통신 모듈은 차량 상태량을 제공하고, 제어량을 입력하는 역할을 하며, 위치인식 모듈은 GNSS 정보와 추측항법을 활용해 차량의 위치 정보를 제공한다. 인지, 경로 계획, 제어 모듈은 2 ~ 4장에서 기술한 각각의 알고리즘을 구동하는 역할을 한다.

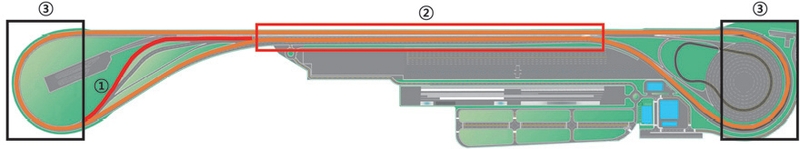

5.2 실차 실험 환경 및 시나리오 구성

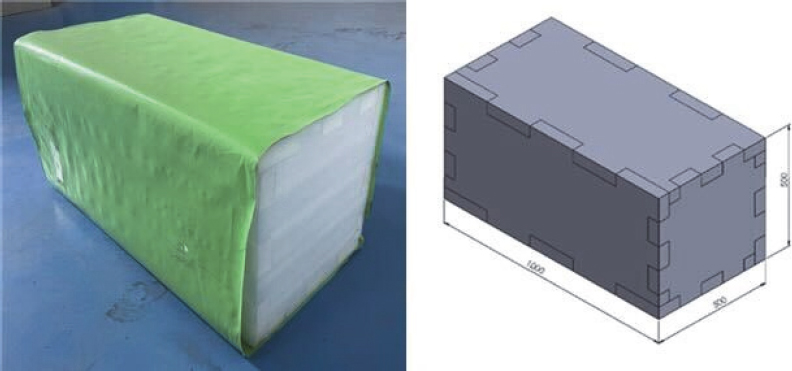

설계된 자율주행 알고리즘 실험은 지능형자동차부품진흥원 대구 주행 시험장의 고속 주회로 환경에서 진행하였다. 활용된 장애물은 50 × 50 × 100 cm의 직육면체 박스 형태이며 총 2개의 장애물이 고속 주회로의 3차로에 배치되었다. Fig. 9, 10은 사용된 장애물의 실제 사진과 PG의 모습을 나타낸다.

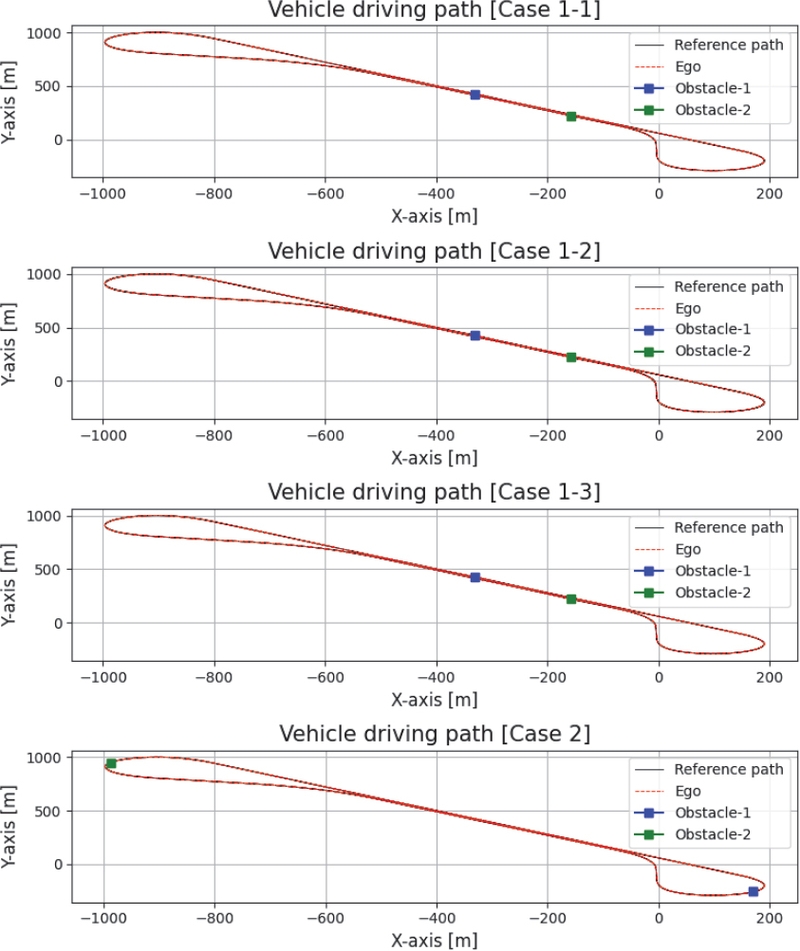

실험 시나리오는 Table 3에 나타낸 것처럼 직진 구간에서 차량의 목표속도를 50, 70, 100 km/h로 장애물을 회피하는 시나리오와 뱅크 곡선 구간에서 70 km/h로 장애물을 회피하는 시나리오 총 4가지로 구성하였으며, 총 2바퀴를 주행하였다. Case [1-3]의 경우 요구 종방향 속도는 직진 구간에서 100 km/h, 뱅크 구간에서는 70 km/h가 적용되었다.

5.3 평가 결과

본 연구에서는 먼 거리에 있는 장애물을 검출하기 위해 직접 장애물 데이터셋을 구축하였다. 지능형자동차부품진흥원 대구 주행 시험장에서 10 ~ 150 m 거리의 장애물 데이터를 취득하였으며, Table 4와 같이 Train, validation, test set으로 분할하였다. 최종적으로는 BDD100K 데이터셋과 장애물 데이터셋을 활용하여 장애물 객체 검출 알고리즘을 학습하였으며, 장애물 객체에 대해서만 성능 평가를 진행하였다.

Table 5는 YOLOv5 모델에 Test set을 적용하여 계산한 Precision, recall, mAP50 성능지표 결과를 나타낸다. 그중 Precision이 가장 낮은 성능을 보였으며, 이는 특정 프레임에 반대편 차선에 위치한 장애물의 일부가 포함되어 있었기 때문에 False positive가 증가한 것이 주요 원인으로 작용하였다. mAP 50은 Recall에 비해 낮은 성능을 기록하였으며, 객체의 거리가 멀어질수록 바운딩박스의 Confidence가 50 % 이하로 감소한 것이 주요 원인으로 작용하였다. Fig. 11은 YOLOv5 모델에 Test set을 적용하여 추론한 결과이며, 최소 10 m에서 최대 150 m 거리에 있는 장애물을 정확하게 추론한 것을 확인할 수 있다.

본 논문에서 설계된 알고리즘의 성능 평가를 위하여 경로 계획과 추종 알고리즘의 파라미터들은 Table 6, 7에서 볼 수 있다.

| (10) |

| (11) |

| (12) |

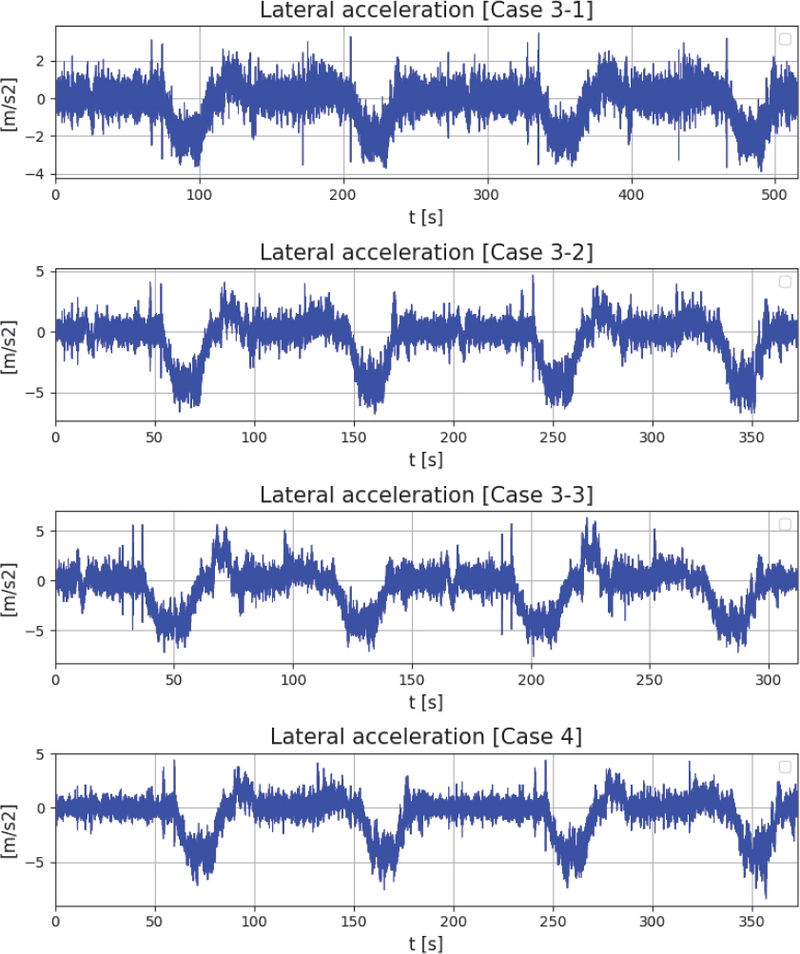

본 연구에서는 회피 시작과 완료 상황의 TTC, 횡가속도 값과 연산시간을 평가에 활용하였다.

Table 8은 제안된 알고리즘의 실시간성과 경로 최적화 능력을 다양한 평가 지표를 통해 보여준다. TTC는 장애물과의 충돌까지 남은 시간을 의미하며 장애물 회피 시작 순간의 TTC 값은 경로계획 알고리즘의 반응성을 평가할 수 있다.

회피 완료 순간의 TTC는 경로 계획 알고리즘이 안정적이면서 효율적인 회피를 수행했는지 판단하는 지표로 사용하였다. 모든 시나리오에서 제안하는 알고리즘은 TTC 약 4초 이상에서 회피를 시작하였으며 이는 100 km/h 상황에서 110 m 거리에서 회피를 시작했다는 것을 의미한다. Van Der Horst와 Hogema21)에 따르면 1.5초 미만의 TTC는 위험 상황으로 간주하며 충돌 회피 알고리즘의 활성화 기준은 최소 4초로 정의하고 있다. 본 연구는 이러한 TTC 기준에 대해 합리적인 회피 성능을 보여주는 것을 확인할 수 있다.

주행 중 차량의 횡 가속도는 차량이 합리적인 경로를 생성하고 이를 안정적으로 추종할 수 있는지를 판단하는 중요한 지표이다. 본 연구에서는 차량의 안정적 거동을 위해 횡 가속도의 제약 조건을 설정하였고, 모든 시나리오에서 RMS 값이 이 제약 조건을 만족하는 경로를 성공적으로 생성하고 추종하였다. 그러나 대부분의 시나리오에서 최대(Max) 횡 가속도 값에서 큰 차이를 보이는 것이 관찰되었다. 특히, Case [1-1]을 제외한 나머지 시나리오에서는 고속 주행 중 회피 동작을 수행할 때 경로 추종 알고리즘과 결합하였을 때 높은 횡 가속도를 보여주었다. 하지만 해당 결과를 통해 마른 노면 상황에서 0.8 G 까지의 횡방향 회피 동작이 가능함을 확인할 수 있었다.

연산시간은 알고리즘의 응답 속도와 실시간 데이터 처리 능력을 평가하는 중요한 지표로, 모든 시나리오에서 20 ms 미만으로 유지되었다. 이는 자율주행 차량이 동적 환경에 빠르게 적응하고 적절한 반응을 할 수 있음을 나타낸다. 또한, 평균 연산시간은 15 ms로 측정되어, 일반적으로 자율주행 차량에서 실시간으로 요구되는 50 ~ 150 ms보다 매우 적은 시간으로 제안된 알고리즘이 안정적으로 높은 성능을 유지할 수 있음을 보여준다.

Fig. 12는 자율주행 자동차의 정적 장애물 회피를 위한 전반적인 주행 경로를 보여준다. 검은 실선은 횡방향 오차 계산 시 선택되었던 요구 웨이포인트를 나타내며, 빨간 점선은 실차가 주행 경로를 나타낸다. 파란색 점과 초록색 점은 장애물이 위치를 나타낸다.

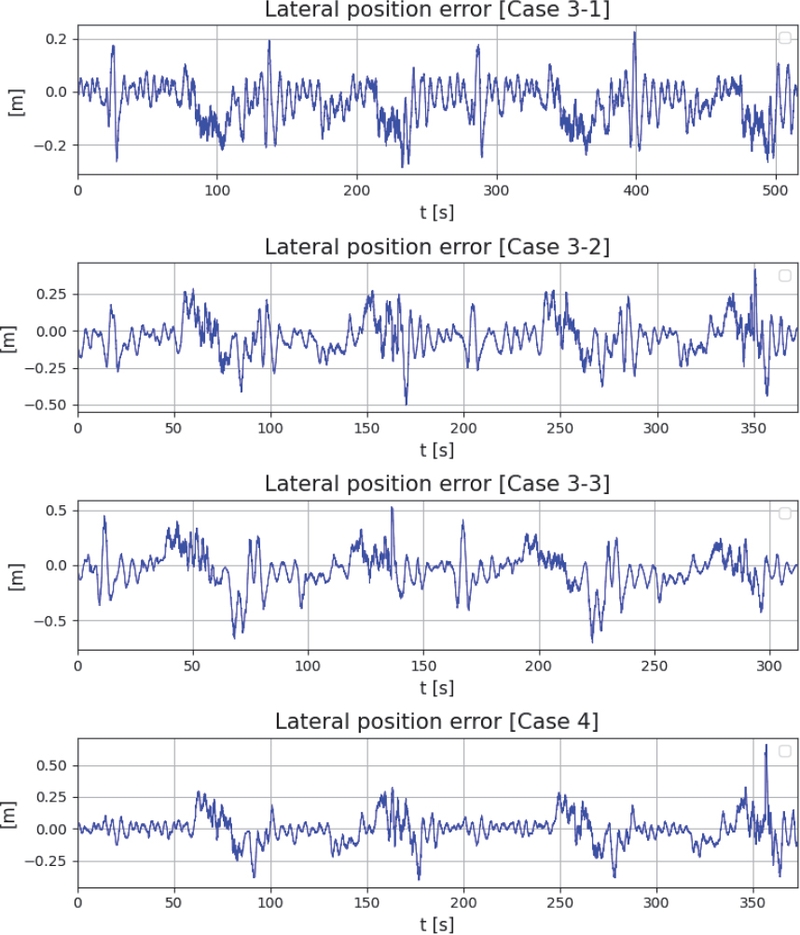

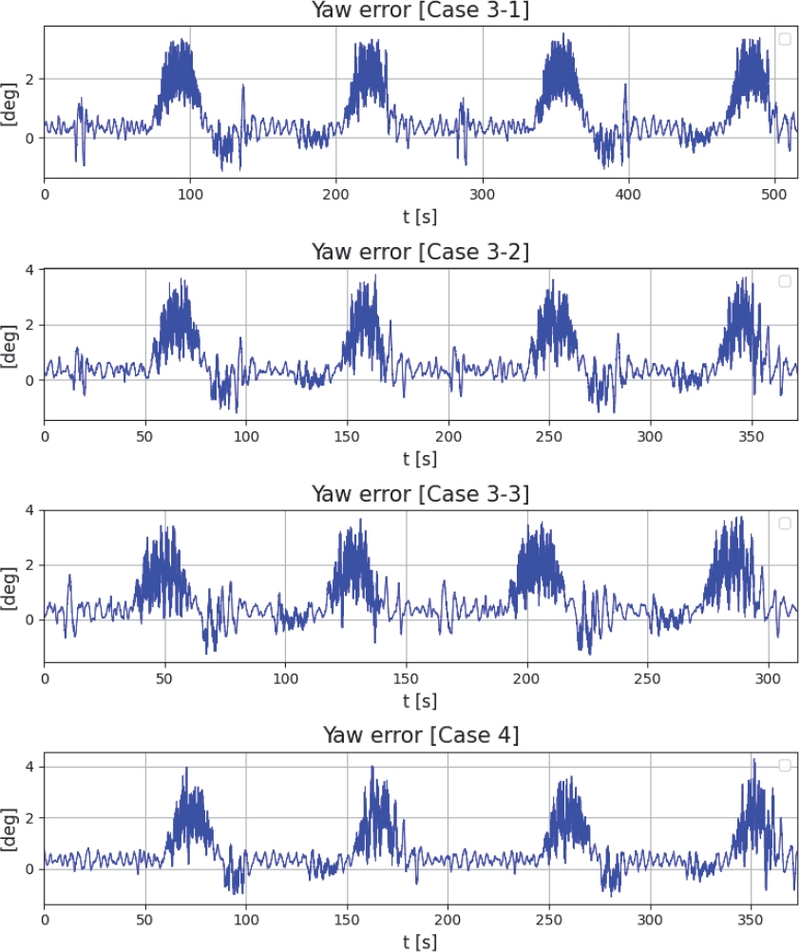

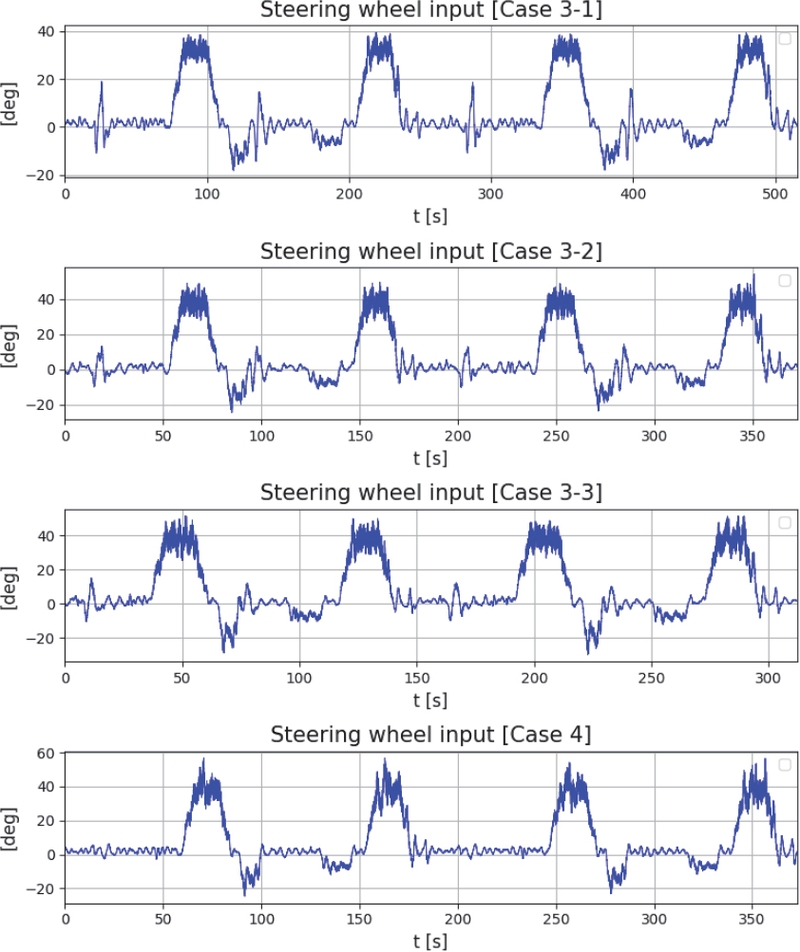

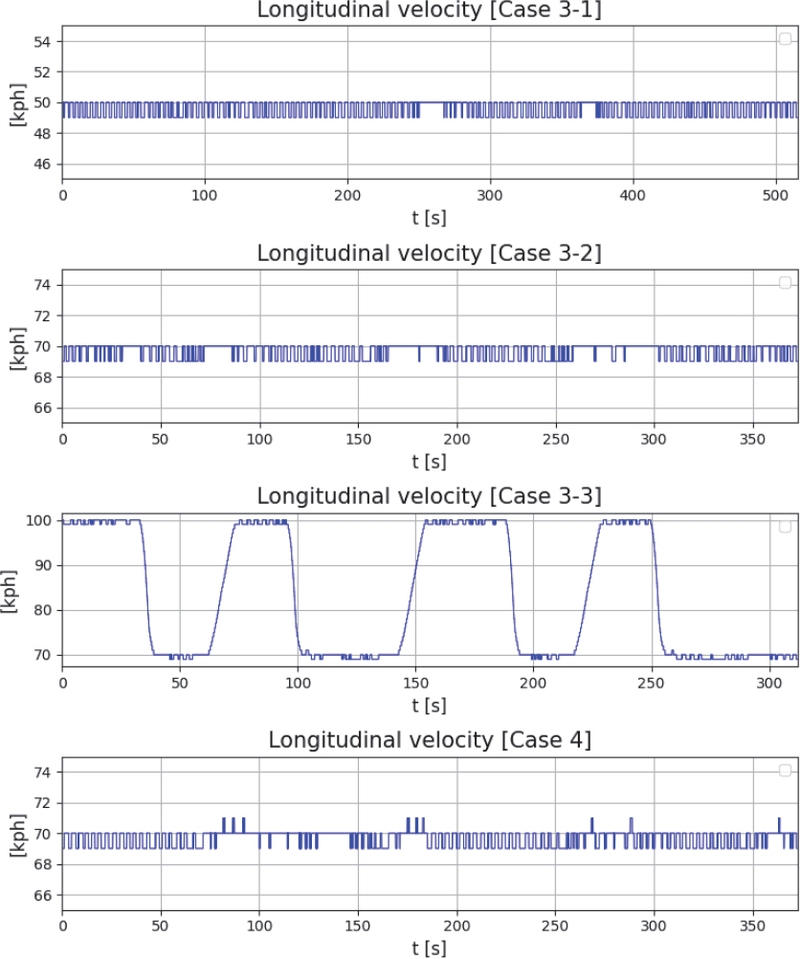

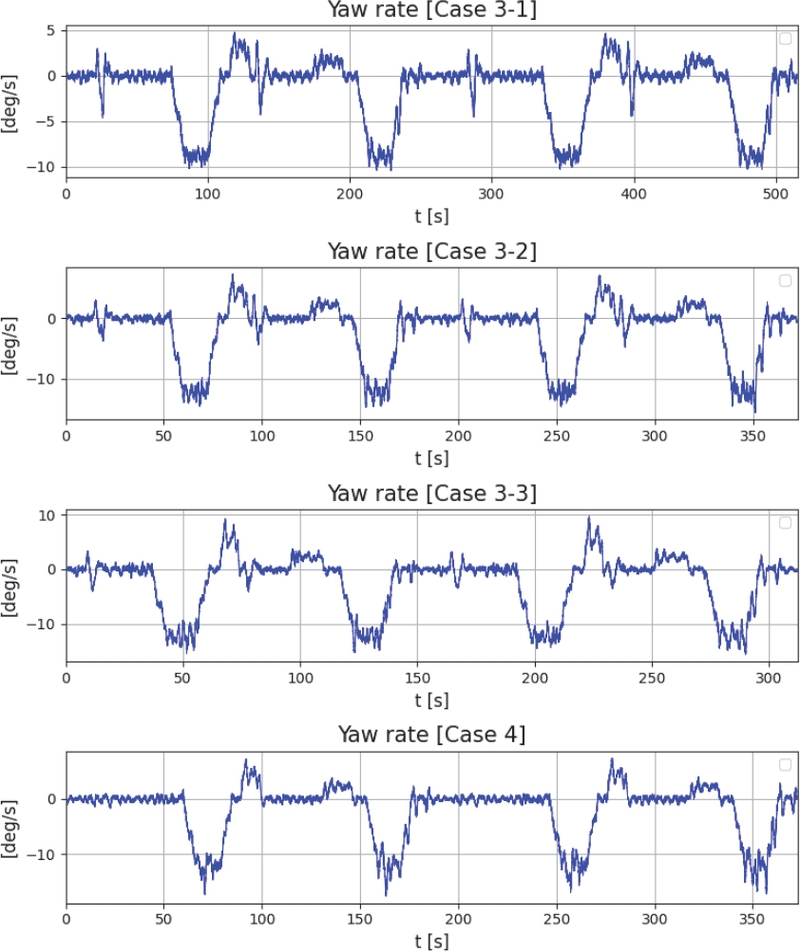

Fig. 13 ~ 18은 2바퀴 동안 회피 주행 및 뱅크부 주행을 수행했을 때의 결과 그래프이다. 이때 x축에는 시간을 나타내고, y축에는 상태량을 나타낸다. Fig. 13 ~ 18에서 확인할 수 있듯이 Case [1-1]에서는 약 10 ~ 30 s, 120 ~ 140 s, 270 ~ 290 s, 390 ~ 410 s 구간에서 회피 주행이 수행되었다. 그리고 80 ~ 110 s, 220 ~ 240 s, 340 ~ 370 s, 470 ~ 500 s 구간에서는 뱅크부 3차선 주행이 수행되었다. Case [1-2]의 경우는 약 10 ~ 20 s, 90 ~ 110 s, 200 ~ 210 s, 280 ~ 290 s 구간에서 회피 주행이 수행되었으며, 약 60 ~ 75 s, 150 ~ 165 s, 245 ~ 260 s, 340 ~ 355 s 구간에서는 뱅크부 3차선 주행이 수행되었다. Case [1-3]의 경우는 약 10 ~ 20 s, 65 ~ 75 s, 160 ~ 170 s, 230 ~ 240 s 구간에서 회피 주행이 수행되었으며, 약 40 ~ 60 s, 125 ~ 145 s, 200 ~ 220 s, 260 ~ 280 s 구간에서는 뱅크부 3차선 주행이 수행되었다. Case [2]에서는 70 ~ 90 s, 160 ~ 180 s, 250 ~ 270 s, 340 ~ 360 s 구간에서 회피 주행 및 뱅크부 3차선 주행이 수행되었다.

Fig. 13은 횡방향 오차를 나타내며, Fig. 14는 요각도 오차를 나타낸다. Fig. 13, 14에서 볼 수 있듯이 뱅크부 주행을 수행할 때 직진 주행하는 상황보다 더욱 큰 값의 오차를 나타내는 것을 확인할 수 있었다. Table 9는 ey, eψ의 RMS, STD와 절댓값의 최댓값을 나타낸다. Table 9에서 볼 수 있듯이 속도가 높을수록 RMS, STD, MAX 값이 점점 커지는 것을 확인할 수 있다. 동일한 요구 속도가 적용된 Case [1-2], Case [2]에서 볼 수 있듯이 Case [1-2]의 RMS, STD 값은 상대적 Case [2]보다 큰 값을 가졌으나, MAX 값은 Case [2]보다 작은 값을 나타내었다. Fig. 15은 MPC에서 계산된 스티어링 휠 조향 제어 입력을 나타낸다. Fig. 15의 스티어링 휠 조향 제어 입력은 최대 휠 조향각, 최대 스티어링 휠 조향각을 고려하여 MPC의 출력인 휠 조향 제어 입력을 자율주행 자동차의 MDPS 시스템에 제어 입력으로 인가하였다.

Fig. 16은 종방향 속도를 나타낸다. 종방향 속도는 자동차의 휠 오도메트리의 값을 활용하여 계산되었다. Fig. 17, 18은 각각 요 변화율과 횡방향 가속도를 나타낸다. 요 변화율과 횡방향 가속도는 Table 1의 IMU에서 계산된 값을 나타낸다.

6. 결 론

본 논문은 2024 대학생 자율주행 경진대회에서 진행한 자율주행 레이싱을 준비하며, 자율주행 레이싱 상황에서 센서 퓨전 및 MPC 제어기와 Frenet 최적 경로 계획을 활용한 객체 충돌 회피 알고리즘을 설계하였다. 고속 레이싱 상황에 대응하기 위해 LiDAR-CAMERA 센서 퓨전 기반의 객체 인지를 수행하여 최대 150 m 거리의 물체를 검출하였다. 검출된 장애물을 안정적으로 회피하기 위해 Frenet 최적 경로 계획 방법이 사용되었으며, 비용 함수에 가가속도(Jerk)와 횡방향 오차, 충돌, 연속성이 고려되었다. 비용함수는 적절한 파라미터 튜닝을 통해 충돌이 없으면서도 매우 부드럽고 안정적인 경로를 생성하였다. 생성된 경로를 MPC와 PID 제어기를 통해 추종하도록 하였으며, 본 연구에서는 기구학 기반의 MPC 제어기를 활용하였다.

제안된 알고리즘의 성능 평가를 위해 속도에 따른 다양한 시나리오가 적용되었다. 성능 평가 시나리오는 실차 환경과 Proving Ground 환경에서 차량의 목표속도(50, 70, 100 km/h)와 장애물에 위치 변화 따라 적용되었다. 저속부터 고속 환경 회피 시나리오에서 제안하는 알고리즘은 TTC 4초 이상에서 회피하는 반응성을 보이고 있으며 본 논문에서 제안하는 알고리즘의 합리적인 장애물 회피 성능을 확인할 수 있었다.

향후 뱅크 도로에서의 합리적인 경로 추종 성능을 위해 동역학 모델 기반 MPC 알고리즘 개발을 계획하고 있다. 또한 본 논문에서는 정적 장애물 회피를 다루고 있지만 추후 동적 장애물에 대한 회피와 ACC, 레이싱 상황에서 추월도 고려해야 할 것이다. 인지의 경우에도 단순히 센서 퓨전만을 사용해 인지를 수행했지만 각 센서의 장 단점을 고려한 다양한 알고리즘 기반의 객체 인지 알고리즘을 구현하여 고속 자율주행 레이싱의 통합 시스템을 개발할 계획이다.

Nomenclature

| MPC : | model predictive control |

| ROS : | robot operation system |

| LiDAR : | light detection and ranging |

| TTC : | time to collision |

| y : | lateral position, m |

| θ : | yaw angle, deg |

| δ : | wheel angle, deg |

| δc : | wheel angle control input, deg |

| L : | wheel base, m |

| τc : | time delay of steering system, - |

| Δt : | control period, s |

| k : | curvature, 1/m |

| w0 : | jerk cost coefficient |

| w1 : | d-axis offset cost coefficient |

| w2 : | collision cost coefficient |

| w3 : | continuity cost coefficient |

| J0 : | jerk cost |

| J1 : | d-axis offset cost |

| J2 : | collision cost |

| J3 : | continuity cost |

| Tmin : | min planning start time, s |

| Tmax : | max planning start time, s |

| Tsmpl : | planning time gap, s |

| Tpoint : | trajectory point sampling time, s |

| Dlateral : | lateral sampling period, m |

| Lroad : | left road boundary |

| Rload : | right road boundary |

Acknowledgments

A part of this paper was presented at the KSAE 2024 Spring Conference

이 연구는 2021년도 산업통상자원부 및 한국산업기술평가관리원(KEIT) 연구비 지원에 의한 연구임(20014121).

References

-

Z. Wang and K. Jia, “Frustum ConvNet: Sliding Frustums to Aggregate Local Point-Wise Features for Amodal 3D Object Detection,” 2019 IEEE/RSJ International Conference on Intelligent Robots and Systems(IROS), pp.1742–1749, 2019.

[https://doi.org/10.1109/IROS40897.2019.8968513]

-

Z. Yang, Y. Sun, S. Liu, X. Shen and J. Jia, “IPOD: Intensive Point-Based Object Detector for Point Cloud,” arXiv preprint arXiv:1812.05276, , 2018.

[https://doi.org/10.1109/ICCV.2019.00204]

-

Z. Tian, D. Zhao, Z. Lin, W. Zhao, D. Flynn, Y. Jiang, D. Tian, Y. Zhang and Y. Sun, “Efficient and Balanced Exploration-Driven Decision Making for Autonomous Racing Using Local Information,” IEEE Transactions on Intelligent Vehicles, 2024.

[https://doi.org/10.1109/TIV.2024.3432713]

-

S. Kato, S. Tokunaga, Y. Maruyama, S. Maeda, M. Hirabayashi, Y. Kitsukawa, A. Monrroy, T. Ando, Y. Fujii and T. Azumi, “Autoware on Board: Enabling Autonomous Vehicles with Embedded Systems,” 2018 ACM/ IEEE 9th International Conference on Cyber-Physical Systems (ICCPS), pp.287–296, 2018.

[https://doi.org/10.1109/ICCPS.2018.00035]

-

M. Werling, S. Kammel, J. Ziegler and L. Gröll, “Optimal Trajectories for Time-Critical Street Scenarios Using Discretized Terminal Manifolds,” The International Journal of Robotics Research, Vol.31, No.3, pp.346–359, 2012.

[https://doi.org/10.1177/0278364911423042]

-

J. Huang, Z. He, Y. Arakawa and B. Dawton, “Trajectory Planning in Frenet Frame via Multi-Objective Optimization,” IEEE Access, Vol.11, pp.70764–70777, 2023.

[https://doi.org/10.1109/ACCESS.2023.3294713]

- S. G. Kim, S. G. Kim and Y. W. Lee, “Developments of a Path Planning Algorithm and Simulator for Unmanned Ground Vehicle,” Transactions of KSAE, Vol.15, No.3, pp.1–9, 2007.

-

E. Alcalá, V. Puig and J. Quevedo, “LPV-MP Planning for Autonomous Racing Vehicles Considering Obstacles,” Robotics and Autonomous Systems, Vol.124, Paper No.103392, 2020.

[https://doi.org/10.1016/j.robot.2019.103392]

-

J. Betz, T. Betz, F. Fent, M. Geisslinger, A. Heilmeier, L. Hermansdorfer, T. Herrmann, S. Huch, P. Karle, M. Lienkamp, B. Lohmann, F. Nobis, L. Ögretmen, M. Rowold, F. Sauerbeck, T. Stahl, R. Trauth, F. Werner and A. Wischnewski, “TUM Autonomous Motorsport: An Autonomous Racing Software for the Indy Autonomous Challenge,” Journal of Field Robotics, Vol.40, No.4, pp.783–809, 2023.

[https://doi.org/10.1002/rob.22153]

-

S. He, J. Zeng and K. Sreenath, “Autonomous Racing with Multiple Vehicles Using a Parallelized Optimization with Safety Guarantee Using Control Barrier Functions,” 2022 International Conference on Robotics and Automation (ICRA), pp.3444–3451, 2022.

[https://doi.org/10.1109/ICRA46639.2022.9811969]

-

A. Liniger and J. Lygeros, “A Non-Cooperative Game Approach to Autonomous Racing,” IEEE Transactions on Control Systems Technology, Vol.28, No.3, pp.884–897, 2019.

[https://doi.org/10.1109/TCST.2019.2895282]

-

M. Wang, Z. Wang, J. Talbot, J. C. Gerdes and M. Schwager, “Game-Theoretic Planning for Self-Driving Cars in Multivehicle Competitive Scenarios,” IEEE Transactions on Robotics, Vol.37, No.4, pp.1313–1325, 2021.

[https://doi.org/10.1109/TRO.2020.3047521]

- J. Hwang, K. Huh, H. Na, H. Jung, H. Kang and P. Yoon, “Development of a Model Based Predictive Controller for Lane Keeping Assistance System,” Transactions of KSAE, Vol.17, No.3, pp.54–61, 2009.

-

A. Katriniok, B. Rosarius and P. Mähönen, “Fully Distributed Model Predictive Control of Connected Automated Vehicles in Intersections: Theory and Vehicle Experiments,” IEEE Transactions on Intelligent Transportation Systems, Vol.23, No.10, pp.18288–18300, 2022.

[https://doi.org/10.1109/TITS.2022.3162038]

-

Z. Zhou, C. Rother and J. Chen, “Event-Triggered Model Predictive Control for Autonomous Vehicle Path Tracking: Validation Using CARLA Simulator,” IEEE Transactions on Intelligent Vehicles, Vol.8, No.6, pp.3547–3555, 2023.

[https://doi.org/10.1109/TIV.2023.3266941]

-

Ó. Pérez-Gil, R. Barea, E. López-Guillén, L. M. Bergasa, C. Gómez-Huélamo, R. Gutiérrez and A. Díaz-Díaz, “Deep Reinforcement Learning Based Control for Autonomous Vehicles in CARLA,” Multimedia Tools and Applications, Vol.81, No.3, pp.3553–3576, 2022.

[https://doi.org/10.1007/s11042-021-11437-3]

-

S. Yang, W. Wang, C. Liu and W. Deng, “Scene Understanding in Deep Learning-Based End-to-End Controllers for Autonomous Vehicles,” IEEE Transactions on Systems, Man, and Cybernetics: Systems, Vol.49, No.1, pp.53–63, 2019.

[https://doi.org/10.1109/TSMC.2018.2868372]

- Tier IV, MPC Follower Description - Autoware Documentation, Available: https://web.archive.org/web/20220308221519/, , https://tier4.github.io/autoware-documentation/, , Mar. 2002.

- Y. Ban, H. Kim and S. Kee, “Collision Avoidance Algorithm Using Frenet Frame with MPC for Autonomous Vehicle Racing,” KSAE Spring Conference Proceedings, pp.540–541, 2024.

- G. Ahn, Y. H. Choi and S. C. Kee, “Research on Optimization and Improving High-Speed YOLO-Based Vehicle Detection Performance,” KSAE Spring Conference Proceedings, pp.548–552, 2024.

- R. Van Der Horst and J. Hogema, “Time-to-Collision and Collision Avoidance Systems,” Proceedings of the 6th International Conference on Vision in Vehicles, pp.19–24, 1993.