자율주행차량의 원격주행을 위한 네트워크 요구사항

Copyright Ⓒ 2023 KSAE / 209-01

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

This paper presents the requirement for a teleoperation system for an autonomous vehicle. To derive the requirements, first we researched the ToD(Tele-operated Driving) related works: standards, papers, patents, and interviews with global ToD solution providers. Then we identified two key features, ‘Total Latency’ and ‘Network Bandwidth,’ for stable ToD. The ToD solution consists of many systems including the camera, control, network, and graphic user interface, etc. In this paper, we focus on the camera and network system that mostly impact the above two key features. For the camera system, FHD(Full-HD, 1920×1080) resolution is the minimum requirement. Also, 5 Mbps or above bitrate is needed to clearly recognize objects around the vehicle when the video is compressed by H.264 codec. For the network system, the channel bonding technique, which was essential for ToD on the previous 4G network, is still required for ToD even on 5G mobile network.

Keywords:

Teleoperation driving, Autonomous vehicle, 5G, Total latency, Network bandwidht키워드:

원격주행, 자율주행차량, 5세대 통신, 전체 지연시간, 네트워크 대역폭1. 서 론

원격제어기술(Teleoperation)은 멀리 떨어져 있는 머신을 통신채널을 통해 인간이 모니터링하고, 제어하는 기술이다. 이러한, 원격제어기술은 주로 UAV(Unmanned Aerial Vehicle)나 산업용 로봇에 응용되어 왔다. 각 응용들은 그들만의 고유한 동작환경을 가지고 있기 때문에, 각각을 위한 요구조건들도 각각의 목적에 따라 다르다.

UAV의 원격제어기술의 목적은 비행체가 충돌 없이 목적지까지 도착하도록 하는 것이다. 이때, 공기의 흐름이 UAV의 움직임을 방해하기 때문에, 일반적으로 오퍼레이터가 조작하는 방향과 비행체의 실제 움직임이 항상 일치하지는 않는다. 때때로 이런 불일치는 UAV간 또는 UAV와 임의의 물체간 의도치 않은 충돌을 야기시킨다. 이 문제를 해결하기 위해, Lam 등1)은 UAV의 동작으로부터 촉각정보를 생성하고, 이를 이용하여 AFF(Artificial Force Field)를 만들어 충돌회피를 하였다. Lee 등2)에서는 다수의 UAV와 물체 사이의 충돌을 피하기 위해 오퍼레이터에게 촉각정보를 주었다. Zhang 등3), Lee와 Lee4), Aggravi 등5)에서도 유사하게 촉각정보를 이용하였다. 이러한 선행 연구들이 의미하는 것은, UAV 원격제어의 요구사항은, 오퍼레이터에게 촉각정보를 제공하여 비행체의 충돌을 회피하는 기술들이 핵심이라는 뜻이기도 하다.

산업용로봇 또는 머신 응용에서는, 위험하거나 오랜 작업시간을 필요로 하는 특정지역에서의 일들에 대해, 안전과 효율성을 증진시키기 위해서 원격제어기술을 사용한다. 예를 들어, Akizono 등6)에서는, 컴컴한 심해에서의 작업을 위해 일반 영상시스템을 대신하여 촉각기능을 구비한 영상시스템을 이용하여 작업환경을 구성하였다. 그리고, Franchi 등7), Glas 등8), Tanimoto 등9)에서는 여러 다양한 형태의 로봇들이 동시에 동작하고 있는 이질적 환경에서의 효율적인 원격제어 방법이 제시되었다. 제시된 방법들의 공통점은 로봇들이 실제 움직이고 있는 현장에서의 이동경로와 원격지역에서 예측한 로봇들의 이동경로의 불일치(Gao 등10))를 해결하기 위한 노력에 많은 노력을 하고 있다는 점이 주목할 만하다. 이러한 이동경로의 불일치는 로봇들의 움직임을 방해하는 다양한 환경적 원인으로부터 기인하다. 이러한 선행연구들의 연구를 살펴보면, 로봇의 원격제어를 위한 요구조건을 로봇들이 일하고 있는 환경의 정확한 모델링 및 묘사기술에 있음을 알 수 있다.

최근에는, 이러한 원격제어기술은 자율주행차량에 적용되어 원격주행기술(ToD)로 불려지고 있으며, 이 ToD는 자율주행차량을 위해 필수불가결한 기술로 인식되어 이미 몇 나라들은 이를 법제화하기 시작했다.11) 그러나, 자율주행 차량의 환경조건은 UAV와 로봇의 동작환경과는 매우 다르게 때문에, 이전의 원격제어기술들이 그대로 적용될 수는 없다. 예를 들어, 자율주행차량의 동작환경은 위성통신 같은 특별한 통신수단을 이용하지 않고, 일반적인 4G/5G 망을 이용하기 때문에 이전연구들과는 다른 요구조건을 가지고 있을 수 있다. 본 논문에서는 다양한 실험과 검증을 통해 자율주행차량을 위한 ToD의 요구조건을 나타내었다.

논문의 구성은 다음과 같다. 2장에서는 자율주행차량을 위한 ToD와 관련된 최근의 관련 연구들에 대해 살펴보고, 이를 통해 성공적인 자율주행 ToD를 위한 두 가지 핵심요소를 도출한다. 3장에서는 5G 이동통신 환경에서 그 핵심요소들을 테스트하기 위한 실험을 소개하고, 그 실험으로부터 우리는 자율주행차량의 ToD를 구성하는 시스템 중에서 그 핵심요소에 영향을 가장 많이 주는 두 물리적 파트들에 대한 요구사항을 도출할 것이다. 마지막으로 5장에서는 결론과 미래의 연구방향을 나타내었다.

2. 관련연구들

2.1 표준방향

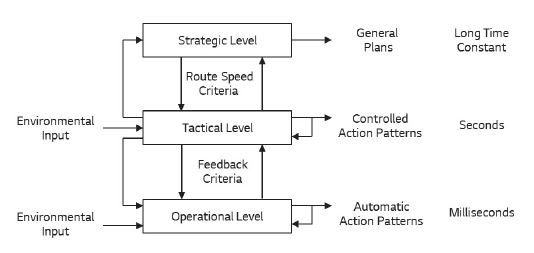

자율주행차량의 ToD는 EU Commission Report JRC-106565(Maria 등12))을 기반으로 5GAA(5G Automotive Association)에서 첫 번째로 연구되었다. 따라서, 표준에서 정의하고 있는 자율주행차량의 ToD를 이해하기 위해서는 5GAA XWG5-20002913)에서 정의한 자율주행 차량의 운전형태(Driving Task : DT)에 대해 먼저 이해할 필요가 있다. Fig. 1에 나타낸 바와 같이, EU에서 정의한 자율주행차량의 DT는 세 가지로 나눌 수 있다.

- · DT Type 1 - strategic level operation: 이는 운전목적을 정의하거나, 경로 또는 운전모델을 선택하는 등의 여행계획을 참조한다. 즉, 자율주행차량이 DT Type 1의 자율주행을 적용한 상태이면, 자율주행차량은 설정된 여행목적에 따라 속도, 스티어링 휠 각도, 브레이크 등을 스스로 만들어 내야 한다.

- · DT Type 2 - tactical level operation: 이 Type에서는 차량의 스피드, 차선선택등이 차량으로 주어진다. 이 Type은 Maneuvering level operation이라고도 불리운다.

- · DT Type 3 - operational level operation: 이 Type의 자율주행차량은 외부에서 직접 종횡, 브레이크 압력 및 각종 물체 감지 결과 등을 받아 움직인다. 이것은 Direct control operation 이라고도 불리운다.

이처럼 EU에서 정의한 DT를 기반으로, 5GAA에서는 세가지 형태의 ToD를 정의한다. Table 1에 나타낸 바와 같이, 각 ToD Type은 DT와 연계되어 원격지 오퍼레이터의 역할범위를 다음과 같이 규정하고 있다.

- · ToD Type 0: ToD 오퍼레이터는 차량조작에 대한 어떠한 권한도 갖지 않는다. 즉, 모든 차량조작은 차량 내 운전자나 자율주행차량이 보유한 자율주행시스템에 책임이 있다.

- · ToD Type 1: ToD 오퍼레이터는 ‘Dispatcher’로써의 역할을 한다. 이는 ToD 오퍼레이터는 DT Type 1 이 규정하는 여행계획만 줄 수 있으며, DT Type 2가 규정하는 속도, 차선선택등의 기능과 DT Type 3가 규정하는 가속페달, 브레이크, 휠조작 등은 차량내 운전자나 자율주행차량이 보유한 자율주행시스템이 수행한다.

- · ToD Type 2: ToD 오퍼레이터는 ‘Indirect controller’의 역할을 한다. 이는 ToD 오퍼레이터는 DT Type 1 및 DT Type 2가 규정하는 기능을 수행하며, DT Type 3가 규정하는 기능은 차량내 운전자나 자율주행차량이 보유한 자율주행시스템이 수행한다.

- · ToD Type 3: ToD 오퍼레이터는 ‘Direct controller’의 역할을 수행한다. 따라서 원격지 오퍼레이터는 모든 차량조작을 직접 수행하기 위하여 원격지에 스티어링 휠, 브레이크 등이 모두 구비되어 있어야 한다. 이 형태의 ToD에서는 차량내 운전자나 자율주행차량이 보유한 자율주행시스템은 운전조작에 관여하지 않는다.

이러한 ToD 정의를 기반으로, ToD 서비스를 준비하기 위해 5GAA는 가능한 사용 예와 조건들을 소개하였다. 그 사용 예에서는 자율주행차량에 수 대의 카메라와 통신장치가 설치되었고, 해당 카메라는 통신장치를 통해 원격지로 비디오 신호를 전송한다. 이러한 5GAA 표준활동에서는 유럽국경지역에서 자율주행 차량의 ToD 중에 발생할 수 있는 Network hand-over’등 자율주행이 어려운 환경 또는 이벤트 발생 이후의 자율주행차량 ToD의 안전한 동작정의에 초점을 맞추고 있다. 즉, 자율주행 차량을 위한 ToD 시스템의 카메라 요구조건 등의 내용은 포함하고 있지 않다.

2.2 문헌자료

자율주행차량의 성공적인 ToD를 위한 핵심요소는 지금까지의 문헌자료들의 분석을 통해 도출될 수 있었다.

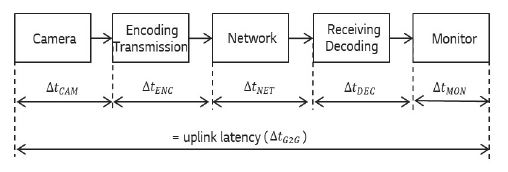

첫번째 핵심요소는 ‘전체지연시간(Total latency)’ 이다. ToD의 지연시간은 두 가지로 나뉠 수 있는데 이는 각각 ‘Uplink 지연’과 ‘Downlink 지연’이다. ‘Uplink 지연’은 자율주행차량이 전송하는 비디오 신호가 원격지의 출력장치에 출력 될때까지의 지연시간을 의미한다. 반대로 ‘Downlink 지연’은 원격지의 차량제어신호가 자율주행차량까지 전달될 때까지 발생하는 지연을 의미한다. Zhang14)에서, 저자는 자율주행차량의 ToD를 위한 전체지연시간을 제시하였다. 그의 제시안에 따르면, 전체지연시간이 170 ms보다 작을때는 고속(70 km/h 이상)으로 주행하는 자율주행차량의 ToD가 가능하고, 전체지연시간이 300 ms보다 작을 경우에는 ToD 운영자가 적응하여 큰 문제없이 원격지 조작이 가능하다. 하지만, 전체지연시간이 300 ms 이상이면, 시스템의 반응이 늦기 때문에 원격지 오퍼레이터는 멈칫멈칫하는 현상을 보였다. 이러한 현상은 지연시간을 점점 더 누적시키기 때문에 ToD 성능을 악화시켰다. 그리고 전체지연시간이 500 ms에 다다르면, 저속(30 km/h이하)의 자율주행 ToD만 가능했고, 전체지연시간이 700 ms을 초과하면 ToD는 사실상 불가능 하다. George 등15)의 저자는 전체지연시간을 그림 2에 나타낸 것처럼 여러 부분으로 세분화 하고, 각 부분들의 지연시간을 조사하였다. 여기서 주목할 만한 것은, 카메라 및 모니터 등으로부터 발생하는 지연시간 역시 수십ms를 나타내기 때문에 무시할 수 없다는 점이다. 즉, 비디오 전송을 위한 코덱 구조를 최적화 하는 것뿐만 아니라, 코덱을 포함하는 비디오 스트리밍 시스템 전체에 대한 최적화도 필요하다는 뜻이다. Fig. 2의 Uplink 지연을 구성하는 요소 중, ‘Network latency’는 시스템이 조절 가능한 요소가 아니라, 시스템이 적응해야 하는 요소이기 때문에 항시 측정되고 관리될 필요가 있다. Inam 등16)에서는 4G/LTE기반으로 이를 측정하였는데, 평균적으로 50 ms을 나타내었고, 그들은 5G가 도입이 된다면, 해당 ‘Network latency’는 4 ms 이하가 될 것으로 기대하였다.

두 번째 자율주행차량을 위한 ToD의 핵심요소는 자율주행차량에 설치된 카메라로부터 생성되는 대용량의 비디오신호를 원격지로 전송하기 위해 필요한 ‘네트워크 대역폭(Network bandwidth)’이다. George 등17)의 저자는 1080p 60 fps 전방 카메라의 비디오 신호를 전송하기 위해 8 MBps가 요구된다고 하였고, 사이드 및 후방 카메라를 전송하기 위해서는 추가적으로 24 Mbps가 요구된다고 하였다. 따라서, George 등17)의 ToD 시스템은 전체 32 Mbps의 Uplink 대역폭을 요구하고 있었으며, 이것은 4G/LTE 네트워크기반에서는 ToD가 불가능하다는 것을 나타낸다. 이러한 4G/LTE의 단점을 극복하기 위해, 모든 ToD의 상업용 솔루션들은 채널정합(Channel bonding), 채널예측(Channel est-imation) 같은 특별한 기술들을 그들의 시스템에 적용하여 자율주행차량이 사용할 수 있는 Uplink 대역폭을 최대한 확보하고 있다. 여기에서, 우리는 ‘네트워크 대역폭 확보를 위한 종래의 이런 기술들이 5G 상에서 ToD를 할때에도 여전히 요구되는지?’에 대한 의문을 갖을 수 있다. 이에 대한 해답을 찾기 위해, 이 논문에서 우리는 그 핵심요소들을 5G 네트워크상에서 검증해 보았다.

2.3 상업용 솔루션

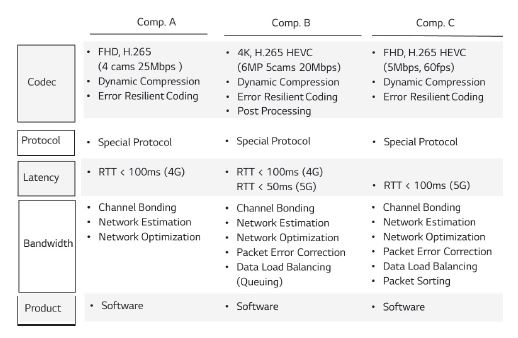

1장 서론에서 언급한 것처럼, 몇몇의 상업용 ToD 솔루션 공급업체는 UAV나 로봇에 적용하기 위해 ToD 솔루션을 개발해 왔으나, Fig. 3에 나타낸 바와 같이 최근에 이러한 업체들은 그들의 솔루션을 자율주행용으로 개선하였다. 그들이 개선한 ToD 시스템은 공통적으로, 자율주행 ToD의 핵심요소인 ‘전체지연시간(Total latency)’과 ‘네트워크 대역폭(Network bandwidth)’을 위한 특별한 두 개의 물리적 파트를 가지고 있다.

그 중 하나는 카메라 파트이다. 카메라 파트는 주로 ‘전체지연시간(Total latency)’를 줄이기 위해 다양한 압축기술들을 적용하고 있다. 좀더 자세히 설명하자면, 자율주행차량에는 ToD를 위해 적어도 4대의 카메라가 별도 설치되며, 각 카메라로부터의 비디오신호는 압축되어 원격지로 전송된다. 여기에서 주목할 점은 전체지연시간의 주된 원인은 바로 이 비디오 압축시스템의 구조적 문제에서 비롯된다는 점이다. 이러한 압축지연시간을 줄이기 위해서 대부분의 ToD 솔루션 제공사들은 각자의 방법대로 비디오 코덱을 병렬처리하고, NVIDIA Jetson18) 같은 고성능의 멀티코어 프로세서에 탑재한다. 이러한 노력으로 말미암아, 각 ToD 솔루션 제공업체들이 보유한 자율주행차량을 위한 ToD시스템의 전체지연 시간은 보통 100 ms 이하를 나타내고 있었다.

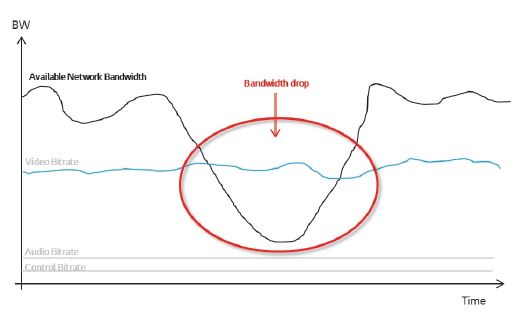

또 다른 하나의 파트는 네트워크 파트이다. 카메라파트에 의해 생성된 압축 비디오 스트림은 모바일 네트워크를 통하여 원격지로 전송된다. 이러한 모바일 네트워크의 알려진 문제점 중 하나는 급작스런 대역폭 하락(Bandwidth drop) 현상이고, 이것은 ToD도중의 자율주행차량에서 비디오신호를 원격지로 전송하는데 있어서 치명적인 결과를 가지고 올 수 있다. 예를 들어, 자율주행차량이 트래픽이 심한 도심지를 지나고 있을 때, Fig. 4에 나타낸 것처럼 갑작스런 네트워크 대역폭 하락현상이 발생했다고 가정해 보자. 문제는, 자율주행차량에 설치된 카메라 파트가 생성하는 압축 비디오 비트율이, 가용한 네트워크 대역폭보다 작게되면, 원격지로의 성공적인 비디오 스트림 전송을 기대할 수 없다. 이러한 대역폭 하락현상을 극복하기 위해서 ToD 솔루션 제공사들은 채널본딩(Channel bonding), 채널예측(Channel est-imation), 네트워크 최적화(Network optimization) 같은 기술들을 그들의 네트워크 파트에 적용하였고, 이로써 그들의 자율주행차량을 위한 ToD 솔루션들은 4G/LTE 환경에서도 약 25 ~ 30 Mbps의 네트워크 대역폭 요구조건을 만족할 수 있었다.

여기에서 우리는 두 가지 질문을 가지게 되었다. 하나는 카메라파트의 상세 요구조건이다. 우리는 현재의 ToD 솔루션 제공사들이 보유한 100 ms 이하의 전체지연시간을 카메라파트를 위한 요구조건의 하나로 정의할 수 있다. 하지만, 자율주행차량을 원격지에서 조작하기 위해서는 원격지 오퍼레이터가 차량이 전송하는 비디오 신호로부터 각종 물체나, 교통표지판, 또는 신호등의 인식을 위해 필요한 카메라의 해상도는 어떻게 되는지 등, 카메라 파트를 위한 더 많은 요구조건을 필요로 할 수 있다. 또 다른 하나는, 5G상에서의 네트워크 파트의 요구조건이다. 모든 이전의 연구들은 Uplink 대역폭이 5G 보다 훨씬작은 4G/LTE 상에서 이루어 졌다. 게다가, 5G상에서의 네트워크 속도는 4G/LTE보다 훨씬 빠르다. 그러므로, 네트워크 슬라이싱(Zhang19)) 같은 특별한 기술이 적용된 5G 모바일 네트워크 상에서도, 이전 ToD 솔루션에 적용된 채널본딩(Channel bonding) 같은 기술들이 요구사항으로 의미가 있는가에 대한 연구가 필요하다.

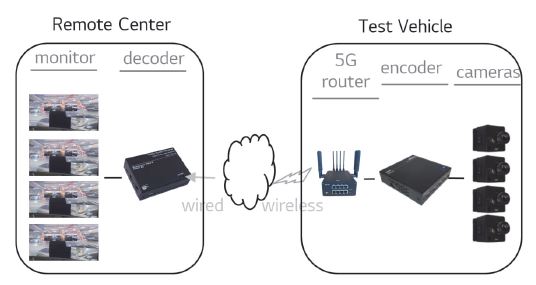

두 질문에 대한 답을 구하기 위해 우리는 Fig. 5에 나타낸 것과 같은 실험을 구성했다. 실험에서는 4대의 카메라가 차량에 설치되었고, 각각의 비디오들은, ToD 핵심요소에 영향을 주는 다양한 압축파라메터들과 함께 H.264로 압축이 된다. 구체적으로는, qHD(960×540)와 FHD(1920×1080)의 두 영상사이즈 및 다양한 비트율(1 ~ 7 Mbps)로 각 카메라의 비디오신호를 압축하였다. 각각의 압축된 비디오 스트림들은 5G 모바일 네트워크를 통해 원격지로 전송이 되었고, 원격지에서 수신되는 각 비디오 스트림은 복호되어 4개의 모니터에 출력되었다. 실험차량은 평균 트래픽을 갖는 도로, 심한 트래픽을 갖는 도로, 고속도로 등 다양한 환경의 도로를 주행하였다.

3. 실 험

두 질문에 대한 답을 구하기 위해 우리는 Fig. 5에 나타낸 것과 같은 실험을 구성했다. 실험에서는 4대의 카메라가 차량에 설치되었고, 각각의 비디오들은, ToD 핵심요소에 영향을 주는 다양한 압축파라메터들과 함께 H.264로 압축이 된다. 구체적으로는, qHD(960×540)와 FHD(1920×1080)의 두 영상사이즈 및 다양한 비트율(1 ~ 7 Mbps)로 각 카메라의 비디오신호를 압축하였다. 각각의 압축된 비디오 스트림들은 5G 모바일 네트워크를 통해 원격지로 전송이 되었고, 원격지에서 수신되는 각 비디오 스트림은 복호되어 4개의 모니터에 출력되었다. 실험차량은 평균 트래픽을 갖는 도로, 심한 트래픽을 갖는 도로, 고속도로 등 다양한 환경의 도로를 주행하였다.

3.1 카메라파트의 요구조건

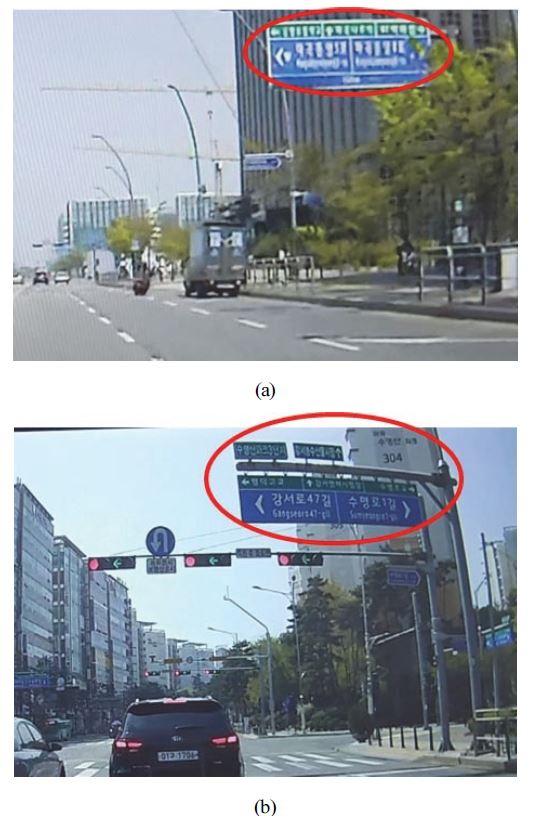

카메라 파트는 데이터 처리시간이 길기 때문에 긴 지연시간을 야기시키므로 ToD에서 가장 중요한 파트이다. 기존 문헌을 다시 상기하자면 Zhang14)에서는 170 ms 이하의 전체지연시간이 필요하다 고 했으며, 기존의 ToD 솔루션 제공 업체들은 100 ms 이하의 전체지연시간 성능을 보유하고 있다. 하지만, 카메라 파트에서 고려해야 할 사항이 지연시간 만 있는 것은 아니다. 원격지에서는 오퍼레이터가 모니터를 보면서 자율주행차량 주변의 물체들을 식별하고 위험요소인가를 판단해야 하기 때문에 전송되는 영상의 화질도 마찬가지로 중요하다. Fig. 6은 자율주행차량에 설치된 qHD와 FHD영상의 화질테스트 결과를 보여준다. Fig. 6에 나타난 것처럼, qHD 카메라의 비디오 스트림 상에서의 교통표지판의 내용은 인식이 불가능하다. 반면 FHD카메라의 비디오 스트림 상에서는 교통표지판 및 자동차 번호판이 충분히 인식될 수 있었다. 따라서, 적어도 FHD이상의 고해상도 카메라가 자율주행차량의 ToD를 위해 별도로 필요할 수 있다. 비디오 압축율 역시 비디오화질에 영향을 줄 수 있다. 우리는 각 영상을 1 ~ 7 Mbps까지 다양하게 설정하여 실험해 보았다.

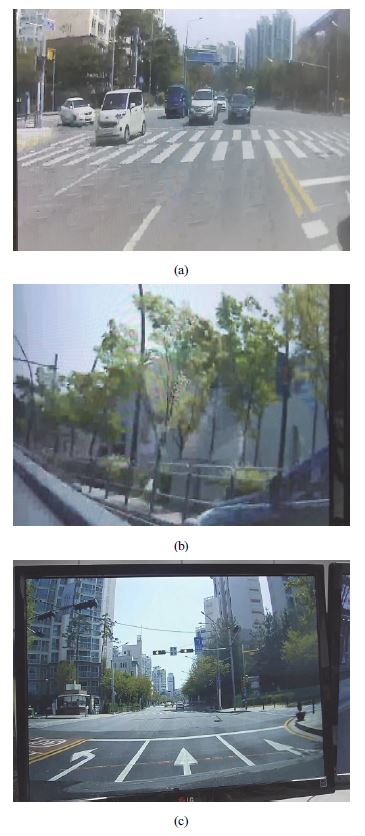

Fig. 7에 보여지는 바와 같이, FHD / H.264기반의 5 Mbps이상의 비트율에서 원격지 오퍼레이터가 느끼기에 좋은 화질을 보여주었다. 이러한 사실은, 만약 자율주행차량에 4대의 FHD 카메라가 설치되고 H.264로 압축이 된다면, 총 20 Mbps의 대역폭이 요구된다는 것을 의미한다.

3.2 네트워크 파트의 요구조건

이전에 언급된 바와 같이, 네트워크 대역폭은 안전한 ToD를 위해서 반드시 보장되어야 한다. 우리의 테스트 환경에서는, FHD 4대의 카메라가 5 Mbps의 H.264로 압축되었고, 따라서 20 Mbps의 대역폭이 카메라시스템에 의해 요구되었다. 여기서 우리가 확인해야 할 사항은, 현재의 5G 모바일 네트워크 환경이이 20 Mbps를 충분히 유지할 수 있는가 이다. 우리는 트래픽이 심한 도로상에서 해당 실험을 하였다. 실험을 통해 알 수 있었던 사실은, 테스트 경로의 단 54.1 %의 위치에서 5G 네트워크를 이용한 ToD 비디오 스트림 전송이 가능하다는 사실이다. 결국, 현재의 5G 모바일 네트워크 환경에서는 자율주행차량의 ToD가 가용하지 않을 수도 있다는 것을 의미한다. 그러므로 채널본딩과 같은 추가적인 네트워크 기술들이 여전히 5G 모바일 네트워크 환경에서 필요할 수 있다.

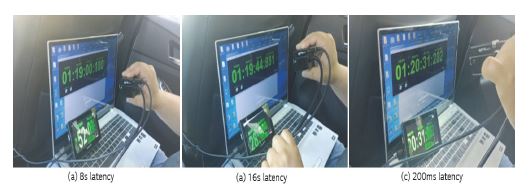

이전의 많은 연구들은, 5G 모바일 네트워크는 네트워크 지연시간이 매우 작을 것이라고 예측하였다(Boban 등20)). 예를 들어, Ericson은 5G Network의 Latency는 4 ms 이하일 것이라고 예상하였다.21) 여기서 우리의 추가적인 질문은 5G 네트워크의 저지연성이 안정적으로 유지되고 있는가였다. 답을 찾기 위해, 우리는 테스트 경로에서 실시간으로 네트워크지연을 측정하였다. 해당 테스트경로는 다양한 트래픽 조건을 가지고 있는 도심지였다. Fig. 8에 해당 실험결과를 나타내었다. 각 사진 위쪽의 아래쪽 큰 모니터는 현재의 측정시각을 보여주고, 각 사진 아래쪽의 작은 모니터는 5G 망을 통해 해당 영상이 도착한 시각을 나타낸다. 예를 들어, 첫 번째 사진의 경우에는, 현재 측정시각(큰 모니터)은 00:05:25.336초이며, 5G망을 통해 전송된 시각(작은 모니터)은 이보다 200 ms적은 00:05:25.136을 보여주고 있어(00:05는 카메라 각도상 보이지 않고 있음) 200 ms의 지연시간이 5G망을 통해 전송되는 동안 발생했음을 알 수 있다. 두 번째 및 세 번째 사진의 예에서도 모두 동일한 200 ms의 지연시간을 볼 수 있다. 이와 같은 관측은 차량이 운행되는 3시간 동안 동일하게 관측되었다. 200 ms의 지연시간은 카메라지연(20 ms), 코덱지연(80 ms), 모니터 입력지연(20 ms) 및 5G 네트워크지연(80 ms)으로 분석되었다. 카메라, 코덱, 그리고 모니터의 입력지원은 각 제품 스펙으로부터 도출되었고, 나머지 시간 80 ms은 네트워크 지연시간으로 계산되었다. 그러나, 어떤 구간에서는 굉장히 심각한 지연시간이 관측이 되었다. 예를 들어, Fig. 9(a)에 나타낸 바와 같이, 8 s 지연시간이 어떤 구간들에서 관측이 되었고(현재 시각 01:19:00:100, 전송된 시각은 약 8초전인 01:19:52:000 관측), 이는 Fig. 9(b)에 나타난 것처럼 차량이 주행하는 동안 16 s까지 증가하기도 하였다가(현재시각 01:19:44.851, 전송된 시각은 16초 전 시각인 01:19:28:400), 9(c)에 보여지는 것과 같이 다시 200 ms으로 돌아오기도 하였다. 이러한 현상에 대한 원인은 (1) 네트워크 스루풋 증가, (2) 무선통신 방해, (3) 라우터의 경로설정, (4) 중계기의 문제 등 여러 가지가 있을 수 있다. 이러한 문제를 해결하기 위해 5G보다 대역폭이 작은 4G 통신망에서의 ToD 솔루션들은 모두 채널본딩을 사용하여 대역폭을 충분히 확보하였다. 이 실험으로부터 알 수 있는 사실은 현재의 5G 망에서로 채널본딩 같은 기술은 안전한 ToD를 위해 필요하다는 것을 알 수 있다.

4. 결 론

이 논문에서, 우리는 김성민22)의 실험을 개선하여 자율주행차량을 위한 ToD 기술을 조사하였다. 조사로부터 ToD를 구성하는 중요한 두 개의 중요파트인 카메라 파트와 네트워크 파트를 도출하였고, 이를 현재 5G 모바일 네트워크상에서 테스트 하였으며, 그 결과로써 두 파트들에 대한 요구조건을 도출하였다. 카메라 파트는, FHD 해상도의 5 Mpbs H.264 압축이 기본적으로 요구되었다. 네트워크 파트는, 현 수준의 5G가 ToD에 도입이 되더라도, 대역폭 변화같은 문제를 극복하기 위해 채널본딩, 채널예측 같은 특별한 네트워크 기술들이 여전히 요구되고 있었다.

References

-

T. M. Lam, H. W. Boschloo, M. Max and M. M. van Paassen, “Artificial Force Field for Haptic Feedback in UAV Teleoperation,” IEEE Transactions on Systems, Man, and Cybernetics-Part A: System and Human, Vol.39, No.6, pp.1316-1330, 2009.

[https://doi.org/10.1109/TSMCA.2009.2028239]

-

D. J. Lee, C. S. Ha and P. R. Giordano, “Semiautonomous Haptic Teleoperation Control Architecture of Multiple Unmanned Aerial Vehicle,” IEEE/ASME Transactions on Mechatronics, Vol.18, No.4, pp.1334-1345, 2013.

[https://doi.org/10.1109/TMECH.2013.2263963]

-

D. Zhang, G. Yang and R. P. Khurshid, “Haptic Teleoperation of UAVs Through Control Barrier Functions,” IEEE Transactions on Haptics, Vol.13, No.1, pp.109-115, 2020.

[https://doi.org/10.1109/TOH.2020.2966485]

-

M. H. Lee and D. J. Lee, “A Distributed Two-Layer Framework for Teleoperated Platooning of Fixed-Wing UAVs via Decomposition and Backstepping,” IEEE Robotes and Automation Letter, Vol.6, No.2, pp.3655-3662, 2021.

[https://doi.org/10.1109/LRA.2021.3064207]

-

M. Aggravi, C. Pacchierotti and P. R. Giordano, “Connectivity-Maintenance Teleoperation of a UAV Fleet With Wearable Haptic Feedback,” IEEE Transactions on Automation Science and Engineering, Vol.18, No.3, pp.1243-1262, 2021.

[https://doi.org/10.1109/TASE.2020.3000060]

-

J. Akizono, T. Hirabayashi, T. Yamamoto, H. Sakai, H. Yano and M. Iwasaki, “Teleoperation of Construction Machines with Haptic Information for Underwater Applications,” Proceedings of the 21st ISARC, 2004.

[https://doi.org/10.22260/ISARC2004/0059]

-

A. Franchi, C. Secchi, H. I. Son, H. H. Bulthoff and P. R. Giordano, “Bilateral Teleoperation of Groups of Mobile Robots with Time-Varying Topology,” IEEE Transactions on Robotics, Vol.28, No.5, pp.1019-1033, 2012.

[https://doi.org/10.1109/TRO.2012.2196304]

-

D. F. Glas, T. Kanda, H. Ishiguro and N. Hagita, “Teleoperation of Multiple Social Robots,” IEEE Transactions on Systems, Man, and Cybernetics – Part A: Systems and Humans, Vol.42, No.3, pp.530-544, 2012.

[https://doi.org/10.1109/TSMCA.2011.2164243]

-

T. Tanimoto, K, Shinohara and H. Yoshinada, “Research on Effective Teleoperation of Construction Machinery Fusing Manual and Automatic Operation,” Robomech Journal 4, Article Number: 14, 2017.

[https://doi.org/10.1186/s40648-017-0083-5]

-

X. Gao, J. Silvério, E. Pignat, S. Calinon, M. Li and X. Xiao, “Motion Mappings for Continuous Bilateral Teleoperation,” IEEE Robotics and Automation Letters, Vol.6, No.3, pp.5048-5055, 2020.

[https://doi.org/10.1109/LRA.2021.3068924]

- Draft Implementing Regulation – Ares(2022) 2667391, Draft of European Commission Regulation, 2022.

- A. R. Maria, C. Biagio, M. Michail and T. Christian, The revolution of driving: from Connected Vehicles to Coordinated Automated Road Transport (C-ART), Publications Office of the European Union, JRC106565, 2017.

- 5GAA Technical Report on Tele-operated Driving (ToD): Use cases and Technical Requirements, 5GAA XWG5-200029, 2007.

-

T. Zhang, “Toward Automated Vehicle Teleoperation: Vision, Opportunities, and Challenges,” IEEE Journal on Internet of Things, Vol.7, No.12, pp.11347-11354, 2020.

[https://doi.org/10.1109/JIOT.2020.3028766]

-

J. George, J. Feiler, S. Hoffmann and Dr. F. Diermeyer, “Sensor and Actuator Latency during Teleoperation of Automated Vehicles,” IEEE Intelligent Vehicle Symposium (IV), 2020.

[https://doi.org/10.1109/IV47402.2020.9304802]

- R. Inam, K. Wang, N. Schrammar, A. Karapantelakis, L. Mokrushin, A. V. Feljan, V. Berggren and E. Fersman, 5G Teleoperated Vehicles for Future Public Transport, Ericsson Mobility Report, 2017.

-

J. George, E. Putz and Dr. F. Diermeyer, Longtime Effects of Video Quality, Video Canvases and Displays on Situation Awareness during Teleoperation of Automated Vehicles, IEEE International Conference on Systems, Man, and Cybernetics (SMC), 2020.

[https://doi.org/10.1109/SMC42975.2020.9283364]

- https://developer.nvidia.com/buy-jetson

-

S. Zhang, “An Overview of Network Slicing for 5G,” IEEE Wireless Communications, Vol.26, Issue 3, 2019.

[https://doi.org/10.1109/MWC.2019.1800234]

-

M. Boban, A. Kousaridas, K. Manolakis, J. Eichinger and W. Wu, “Connected Roads of the Future: Use cases, Requirements, and Design Considerations for Vehicle-to-Everything Communications,” IEEE Vehicular Technology Magazine, Vol.13, No.3, pp.110-123, 2018.

[https://doi.org/10.1109/MVT.2017.2777259]

- Remote Operation of Vehicles with 5G, Ericson Mobility Report, 2017.

- S. M. Kim, “Requirements in Teleoperation of Autonomous Vehicle,” KSAE Fall Conference Proceedings, pp.1223-1230, 2022.