청각 및 촉각 모달리티를 적용한 부분자율주행차량의 제어권 전환 알림방법 연구

Copyright Ⓒ 2020 KSAE / 175-05

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

Based on the recent progress on research and development on automated vehicles, mass production of partially autonomous driving vehicles is expected to be available in the 2020s. According to the SAE standard level 3, a takeover situation may occur where the vehicle driving party changes if autonomous driving is released for unavoidable reasons resulting from vehicle or system limitations. In the case of level 3 vehicles, drivers are not obliged to monitor the situation ahead, but they will be held responsible for any accident. Therefore, it is necessary to investigate how drivers can take over vehicle control swiftly and safely in an unexpected situation. This study compared the auditory alarm(e.g., earcons, spearcons, word-based speech, and sentence-based speech) and the haptic alarm(varied in vibration intensity and period), respectively. The selected dependent variables are user behaviors, biomarkers, and vehicle indices. A total of 26 subjects participated in the human-in-the-loop experiment in a vehicle simulation environment. Based on the analysis results, earcon was found to be the most efficient takeover alarm among the auditory alarms, while high intensity(2 g) combined with long-term alarm(3 s on, 0.2 s off) was found to be the most efficient takeover alarm for the haptic alarm.

Keywords:

Take over, Take over request, Automated vehicle, Driver-Vehicle Interaction, Auditory alarm, Haptic alarm키워드:

제어권 전환, 제어권 전환 알림, 자율주행자동차, 운전자-차량 상호작용, 청각 알림, 촉각 알림1. 서 론

미국 도로교통안전국(NHTSA)는 2016년 자율주행자동차 산업의 발전과 안전을 위한 자율주행자동차 가이드라인을 발표하였다.1) 국토교통부는 2019년 자율주행차량의 상용화를 위해 자율주행자동차 상용화 촉진 및 지원에 관한 법률을 제정하였으며, 2020년 시행을 앞두고 있다.2) 이처럼 국내외에서 자율주행차량을 상용화하기 위한 기술 개발과 더불어 법제화가 진행되고 있다. 자율주행 법제화 등을 위해서는 자율주행 기술 및 레벨에 대한 이해가 선행되어야 한다. 본 연구에서 다루는 자율주행 레벨 3 수준의 자율주행 시스템은 차량의 종, 횡 방향 움직임을 제어한다.3) 운전자는 외부 주행 상황을 모니터링할 의무는 없다. 하지만, 차량 및 자율주행시스템이 해제되는 상황이 발생하면 운전자는 시스템으로부터 차량 제어 권한을 받아 직접 운전을 수행해야 하는 의무가 있다.4) 따라서 운전자는 제어권 전환을 요청하는 알림에 안전하고 신속하게 대응할 수 있어야 하며, 자율주행 시스템은 운전자가 제어권 전환 알림(Take-Over Request, TOR)을 듣고 상황을 인지할 수 있도록 효과적인 알림을 제공해야 한다.

Petermeijer 등5)은 제어권 전환 실험에서, 청각, 촉각 모달리티와 그 조합을 활용한 알림을 사용하였으며 그 결과로 제어권 전환 알림으로 멀티모달 알림을 사용하는 것이 효과적이라는 결과를 제시하였다.

Petermeijer 등6)은 NDRT(Non-Driving Related Task)방법과 제어권 전환 시 시각, 청각 혹은 촉각 알림 간 상호작용에 대한 연구를 진행하였으며, NDRT 방법과 관련 없이 청각, 촉각 모달리티는 제어권 전환에 효과적이라는 연구 결과를 제시하였다.

이지원 등7)은 NHTSA 가이드라인, 차량 인터페이스에 대한 선행연구와 OEM 사례 분석을 바탕으로 단일 모달리티 알림 방법을 제시하였으며, 이를 검증하기 위해 청각, 촉각 단일 모달리티 알림 방법에 따른 제어권 전환 반응 시간을 비교하는 실험을 진행하였다. 그 결과, 청각 알림 중 이어콘과 음성메시지가 스피어콘에 비해 통계적으로 유의미하게 빠른 반응 시간을 유도하였다. 촉각 알림에서 좌석 시트 내 진동 위치에 따른 반응 시간의 유의미한 차이는 없었다. 마찬가지로, 진동 주기에 따른 반응 시간의 통계적인 유의성은 발견되지 않았으나, 평균값을 비교하였을 때, 켜짐(On)이 지속되는 정적 진동 보다 켜짐(On)과 꺼짐(Off)가 반복되는 동적 진동이 운전자의 빠른 반응 시간을 유도한다는 결과를 제시하였다.

김재원과 양지현8)은 시각, 청각 그리고 촉각 단일 모달리티 알림과 이를 두 개 이상 조합한 멀티 모달리티 알림에 대한 연구를 진행하였다. 제어권 전환 이후 차량 제어 측면에서 이를 분석하였으며, 그 결과, 청각, 촉각 모달리티를 포함하는 알림이 제어권 전환에 효과적이라는 결과를 제시하였다.

앞에서 서술한 것과 같이, 시각, 청각 그리고 촉각 모달리티 알림을 매개체로 제어권 전환 알림을 제공한 연구가 많이 진행되었다. 하지만, 단일 모달리티(Single modality) 알림과 멀티 모달리티(Multi modality)알림 간(between) 효과를 비교하는 연구 위주로 진행되었다. 즉, 동일한 모달리티 조합이더라도, 각 모달리티의 설계 변경에 따라서 다른 효과가 도출될 수 있는데, 이러한 모달리티 내(Within)의 설계 변경에 따른 효과를 비교한 연구는 상대적으로 부족하다. 본 연구에서는 청각, 촉각 모달리티가 제어권 전환에 효과적이라는 선행연구를 결과5-7)를 참고하여, 각 모달리티 내(Within modality)에서의 설계 변경에 따른 비교 연구를 수행하고자 한다.

제어권 전환 시 다양한 청각 알림을 제공한 연구가 선행되었으나5) 제어권 전환 알림이 영문으로 구성되어 그 효과가 국내 사정과 부합하는지 검토할 필요가 있다. 본 연구는 이러한 한계점을 개선하기 위해 한국어로 구성된 청각 알림을 사용하고자 한다.

또한, 본 연구에서는 제어권 전환 실험을 통해, 진동의 주기와 세기의 조합한 촉각 알림의 효과를 비교하고자 한다. 동적인 진동 주기(Term)를 긴 주기(Long term), 짧은 주기(Short term)로, 진동 세기(Intensity)를 강한 세기(High intensity), 약한 세기로(Low intensity)으로 세분화하였다.

본 연구에서는 청각, 촉각 알림 방법의 효과를 비교하기 위해 가상환경 기반 주행 시뮬레이터에서 운전자가 자율주행 중 전방 차량 고장으로 인한 제어권 전환 상황을 경험하는 Human-in-the-loop 실험을 진행하였다. 청각, 촉각 알림 설계를 위해 NHTSA 가이드라인1)과 차량 내 청각,9-11) 촉각 알림13,14) 방법에 대한 선행연구를 조사하였다. 이를 통해 네 가지 청각 알림(이어콘, 스피어콘, 단어 음성메시지, 문장 음성메시지)를 비교하는 실험과 네 가지의 촉각 알림(진동 세기 두 가지(1 g, 2 g)와 진동 주기 두 가지(3 s on 0.2 s off, 0.2 s on 0.05 s off)의 조합)을 도출하였으며, 이를 비교하는 실험을 진행하였다. 알림 방법에 따른 정량적인 차이를 관찰하기 위해 사용자 행동, 생체, 차량 지표를 선정하였다. 기술 통계, 추론 통계 분석을 통해 알림 방법에 따른 지표의 유의미한 차이를 분석하였다. 또한, 실험 중간 및 실험 직후 설문조사를 통해 알림 방법의 사용성에 대해 정성적으로 평가하였다.

2. 실험 설계

2.1 독립변수

청각 알림의 독립변수는 NHTSA 가이드라인에서 제시한 청각 알림 유형을 기반으로 선정하였다(Table 1).

이어콘(Earcons)은 짧은 음악적 신호로 일정한 주파수, 음으로 이루어진 청각 신호를 의미한다. 일정한 주파수, 음이 있으며 주의 경고에 적합한 알림이다. 본 실험에서는 880 Hz와 1,760 Hz의 단일 톤을 합성한 이어콘을 사용하였다.

스피어콘(Spearcons)은 음성메시지에 기반한 이어콘으로, 음성메시지를 알아듣기 어려운 정도로 압축시킨 청각 신호를 의미한다. 처음 스피어콘 알림을 접하면 의미를 파악하기 힘드나, 자주 사용하면 청자가 신호와 표현하고자 하는 대상을 연관 지을 수 있는 장점이 있다.9,10) 본 실험은 음성메시지 ‘직접 운전하시오’를 압축한 스피어콘을 제어권 전환 알림으로 사용하였다.

청각 아이콘(Auditory icons)은 대상이나 행동에 대한 정보를 직관적으로 전달하는 환경적인 소리로 객체의 기능이나 동작을 나타내는 소리를 의미한다. 알림 내용을 직관적으로 이해할 수 있다는 장점이 있으나, 제어권 전환을 직접적으로 표현하는 청각적인 표현이 없어 본 연구의 독립변수로 선정하지 않았다.

음성메시지는 특정 단어 혹은 문장을 전달하는 청각 알림 유형으로, 비교적 복잡하거나 구체적인 정보를 전달할 때 유용하다. 단어로 구성된 음성메시지를 사용하면 문장보다 처리할 수 있는 정보의 양이 적어서 청자의 인지 부하를 줄일 수 있다.11) 반대로 문장으로 구성된 음성메시지는 청자의 긍정적인 감성적 경험이 가능하다. 본 연구는 단어 음성메시지 내용으로, 국토교통부에서 2016년에 제어권 전환을 명명한 ‘운전 전환 요구’를 사용하였다.12) 문장 음성메시지 내용은 대부분 운전자가 쉽게 이해할 수 있는 단어로 구성된 ‘직접 운전하시오’로 선정하였다. 음성메시지는 제어권 전환 상황의 긴급함을 강조하기 위해 여성 화자의 음성을 사용하였다. 음성 메시지 구현은 Papago의 TTS(Text-To-Speech) 서비스를 이용하였다.

NHTSA 가이드라인은 촉각 알림 유형으로 가속 페달, 브레이크 페달, 스티어링 휠, 진동 시트, 안전 벨트를 제시하였다. 자율주행 레벨 3 수준에서 운전자의 신체는 가속 페달, 브레이크 페달, 스티어링 휠과 접하지 않는다. 따라서 제어권 전환 상황에서 가속 페달, 브레이크 페달, 스티어링 휠을 매개체로 활용하여 제어권 전환을 요청해도 운전자는 알림을 인지하지 어렵다. 따라서 본 연구는 운전자가 차량 내에서 가장 넓게 접촉한 부분으로, 진동을 인지하기 적합한 운전석 시트의 둔부(Seat pan)와 등받이 부분(Back support)을 촉각 알림 위치로 선정하였다.12)

촉각 알림의 독립변수는 진동 세기와 진동 주기의 조합으로 선정하였다. 진동 세기는 약한 세기, 강한 세기 두 가지 수준으로 분류하였다. 사람이 시트에서 감지할 수 있는 최소한의 진동 세기를 약한 세기로 선정하였으며, 시뮬레이터에서 구현할 수 있는 가장 강한 진동을 강한 세기로 선정하였다. 진동 세기를 정량적으로 파악하기 위해 가속도계를 사용하여 진동을 측정하였으며, 고속 푸리에 변환(Fast Fourier Transform) 방법을 사용하여 측정 데이터를 분석하였다. 그 결과, 가장 약한 세기의 진동은 약 1g, 가장 강한 세기의 진동은 약 2 g로 도출되었다.

진동의 주기는 긴 주기의 진동과 짧은 주기의 진동 두개의 수준으로 구성되었다. 긴 주기의 진동은 3초간 진동 켜짐과 0.5초 꺼짐이 반복하며,13) 짧은 주기는 0.2초 진동 켜짐과 0.05초의 꺼짐이 반복한다.14) 진동은 세기가 일정한 펄스파형으로 제공이 되며, 진동 세기와 주기의 조합과 알림 설계 내용은 Table 2에 기술하였다.

2.2 종속변수

사용자 행동 지표 측면에서 청각, 촉각 알림 방법에 따른 유의미한 차이를 확인하기 위해 두 가지 종속변수를 선정하였다. 인지 시간은 운전자가 제어권 전환 알림을 받은 시점부터 고개를 들어 시선을 전방으로 향하는데 소요되는 시간을 의미한다.15) 조작 시간은 제어권 전환 알림 시점부터 운전자가 직접 운전을 하기 위해 스티어링 휠, 브레이크, 가속 페달 중 하나를 처음으로 조작하기까지 소요한 시간을 의미한다.16) 본 실험은 사용자 행동 지표 측면에서 인지 시간과 반응시간을 분석하여, 운전자가 제어권 전환 상황을 직관적 이해하고 반응하였는지 평가하였다(Table 3).

생체 지표 측면에서 청각, 촉각 알림 방법에 따른 유의미한 차이를 관찰하기 위해 세 가지 종속변수를 선정하였다(Table 3). 피부전기전도도(Galvanic Skin Response, GSR)의 진폭(Amplitude)는 외부로부터 받은 자극의 정도를 의미한다.17) 그리고 운전자의 심전도(Electrocadiogram, ECG)를 통해 R-R interval을 분석하였다. R-R interval은 ECG의 R peak의 간격을 의미한다. 외부의 자극에 따라 심박동수가 증가하면 R peak의 간격은 작아진다. 본 실험은 생체 지표 측면에서 GSR의 진폭과 R-R interval의 평균과 표준편차를 분석하여, 제어권 전환 알림에 따른 운전자가 받은 자극 정도의 차이를 관찰하였다.18)

차량 지표 측면에서 청각, 촉각 알림 방법에 따른 유의미한 차이를 확인하기 위해 다섯 가지의 종속 변수를 선정하였다(Table 3). 최대가속도는 제어권 전환 이후 수동 주행 시 일정 구간 중 가장 큰 가속도 값을 의미한다. 차량의 가속도는 식 (1)과 같이 정의할 수 있으며,19) Gold16) 등은 가속도가 물리적인 한계에 가까워지면 운전 조건이 불안정해진다는 점을 이용하여, 수동주행 후 최대가속도 값이 작을수록 운전자가 안정적인 제어권 전환을 수행했다고 판단하였다.

| (1) |

where ac : current acceleration (m/s2)

along : longitudinal acceleration (m/s2)

alat : lateral acceleration (m/s2)

조향각 편차는 수동 주행 후 일정 구간에서 스티어링 휠의 최대 각도와 최소 각도 차이를 의미한다. 조향 편차가 작을수록, 제어권 전환 후 안정적으로 차량을 제어했다고 평가하였다.20)

횡 방향 위치 표준편차는 수동 주행 후 일정 구간에서 차선의 중심과 차량의 중심 간 거리의 표준편차를 의미한다. 차량이 차선 중심에서 횡 방향으로 이탈하는 정도로 제어권 전환 후 안정적으로 차량을 제어하였는지 평가하였다.21)

조향 반전율은 제어권 전환 이후 일정 구간에서 운전자가 스티어링을 좌, 우 3 degree 이상 반전한 비율을 의미한다. 조향 반전율을 통해 제어권 전환 알림을 제공 받은 운전자의 차량 제어 능력을 평가하였다.22)

페달 조작 횟수는 운전자가 제어권 전환 이후 1초당 가속페달을 입력한 횟수를 의미한다. 페달 조작 횟수를 통해 직접 운전 시 주행 안정성을 평가하였다.8)

제어권 전환을 수행하는 시나리오 주행 직후, 제어권 전환 알림을 평가하는 중간 설문을 진행한다. 설문 내용은 Table 3과 같으며, 실험 참여자는 이에 대해 7점 리커트 척도로 평가하였다.

모든 시나리오 주행을 완료하면 알림 중 가장 선호하는 알림을 평가하는 사후 설문을 한다. 실험 참여자는 실험 중 제공받은 청각 혹은 촉각 알림 중 가장 선호하는 알림 한 가지를 선택하도록 하였다.

2.3 실험 시나리오

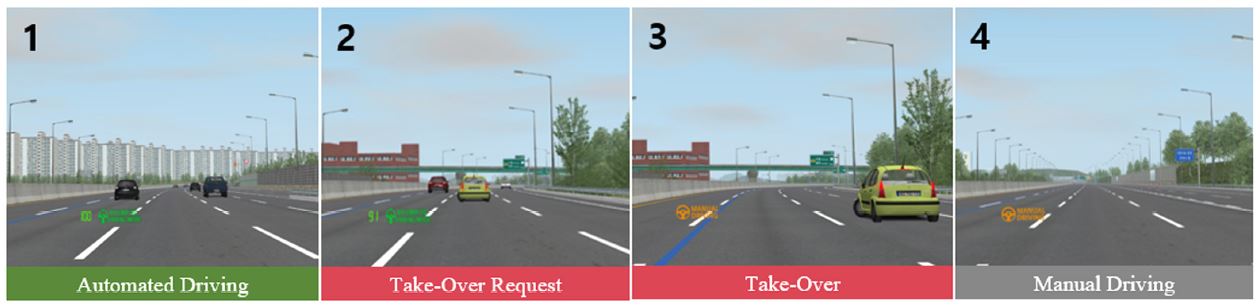

실험 시나리오는 전방에서 정차 중인 사고 차량으로 인해 자율주행 상태가 해제되는 Unplanned ODD exit 상황으로 설정되었다(Photo 1).23) 주행 환경은 경부고속도로 내 신갈-오산 IC를 구현한 가상 환경이다. 시나리오를 시작하면, 차량은 편도 4차선 중 3차선에서 자율주행으로 100 km/h 속도로 주행을 한다. 자율주행 중 실험 참여자의 전방 주시를 방지하기 위해 독서, 문자메시지 작성, 게임, 영상시청 중 한 가지 NDRT(Non Driving Relative Task)를 수행하도록 하였다. 전방 차량과의 충돌 8초 전, 실험 참여자는 제어권 전환 알림을 제공받는다.24) 실험 참여자는 사고 차량을 피하기 위해 스티어링 휠, 브레이크 페달, 가속 페달 중 한 가지를 조작하여 운전 제어권을 가져온다. 운전자는 전방 정차된 사고 차량을 피하기 위해 2차선 혹은 4차선으로 차선변경을 한다. 전방 차량을 피한 후 3차선으로 복귀하여 속도 100 km/h를 유지하면서 약 30초간 주행한다.

2.4 실험 장비

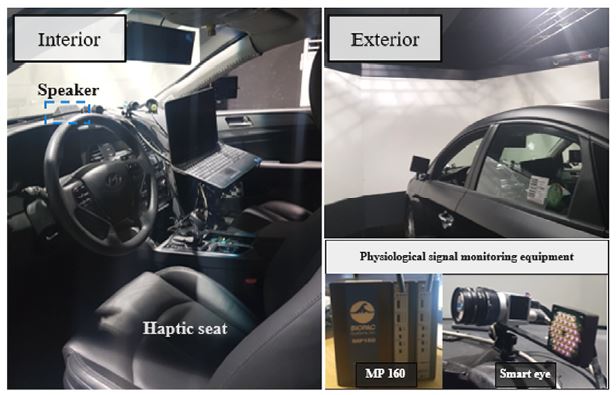

본 실험은 가상환경 기반 드라이빙 시뮬레이터(KMU-DS)에서 진행되었다(Photo 2). 캐빈(Cabin)은 2016년식 현대 LF 소나타이며, Full Scale 시뮬레이터로, 영상, 캐빈, 알림 장치, 모션, 운영 시스템으로 구성되었다. 캐빈 내 5.1 채널 스피커를 통해 청각 알림 장치가 있다. 운전자 좌석 시트는 총 9개의 진동 모터가 내장되어, 촉각 알림을 제공할 수 있다. 소프트웨어는 AV simulation의 SCANeR ver. 1.8을 사용하였다. 교통량, 차량의 경로, 차량의 속도, 주행 차량의 자율주행 여부를 설정하여 자율주행 레벨 3 수준의 환경을 구현하였다.

생체 데이터는 BIOPAC사의 MP 160을 사용하여 취득하였다. 해당 장비를 사용하여 실험 참여자의 피부전기전도도(GSR), 심전도(ECG) 데이터를 취득하였다. 운전자의 시선 데이터는 Smart eye사의 Smart Eye Pro 3 - camera System을 사용하여 취득하였다.

2.5 실험 참여자

실험 참여자는 모집은 운전 경력 1년 이상이며 평소 주 3회 이상 운전을 하는 성인을 대상으로 하였다. 실험 참여자는 총 26명이며 남성 19명(73 %), 여성 7명(27 %)으로 구성되었다. 평균 연령은 25.2세(SD=1.58), 평균 운전 경력은 3.5년(SD=22.6)이다. 실험 참여자들의 자율주행 차량에 대한 신뢰도는 7점 만점에 평균 4.54점이다. 본 실험은 국민대학교 생명윤리위원회(IRB)의 승인을 받았으며 생명윤리위원회의 규정을 준수하였다(KMU-201803-HR-174).

2.6 실험 절차

실험 참여자는 실험에 대한 전반적인 설명을 듣고 그 과정에 동의하면 IRB 실험 동의서를 작성한다. 이후 실험 참여자는 진행자의 안내에 따라 생체 신호 장비(GSR, ECG)를 착용한 후 시뮬레이터에 탑승하여 시트 위치를 자신의 신체에 맞게 조절한다. 시선 추적기 세팅 후, 실험 진행자는 생체 데이터가 정상적으로 취득되는지 확인한다.

실험 장비 세팅 후 실험 참여자는 시뮬레이터 환경과 시나리오에 적응하기 위해 연습 주행을 2회 실시한다. 본실험에서 사용하지 않는 청각, 촉각 알림이 제공되는 시나리오를 각 1회씩 주행한다. 실험 참여자는 자율주행에서 수동 주행으로 전환하는 방법을 익히기 위해, 실험 진행자의 지시에 따라 스티어링 휠, 브레이크, 가속 페달을 사용하여 제어권 전환 방법을 연습한다. 실험 참여자가 시뮬레이터 혹은 제어권 전환 방법에 대한 이해도가 낮다고 판단되는 경우 추가로 연습 주행을 실시한다.

연습 주행 종료 후, 실험 참여자는 청각 알림 시나리오를 4회 주행한다. 시나리오의 순서는 무작위다. 시나리오 주행을 종료할 때마다 직전에 경험한 알림을 평가하는 중간 설문을 실시한다. 청각 시나리오 주행을 완료하면, 청각 알림을 평가하는 사후 설문을 실시한다. 설문 후 실험 참여자는 5분간 휴식을 취하며 컨디션에 따라 추가적인 휴식 시간이 제공된다.

휴식 후 실험 참여자는 청각 알림 실험과 같은 절차로 촉각 시나리오 주행과 중간 설문을 실시한다. 촉각 알림 실험을 마치면, 촉각 알림을 평가하는 사후 설문을 실시한다. 실험 진행자는 취득 데이터 확인하며 실험 참여자의 착용 장비를 탈거한 후 실험을 종료한다.

3. 실험 결과

3.1 분석 방법

청각 혹은 촉각 알림 방법에 따른 종속변수의 유의미한 차이를 확인하기 위해 추론통계분석을 진행하였다. 통계 검정 방법으로 일원배치 분산분석인 ANOVA를 사용하였으며, p-value가 0.05 미만이면, Bonferroni 사후 검정 방법으로 알림 간 쌍대 비교를 실시하여 통계적으로 유의미한 차이를 확인하였다(α=0.0125).

3.2 청각 알림

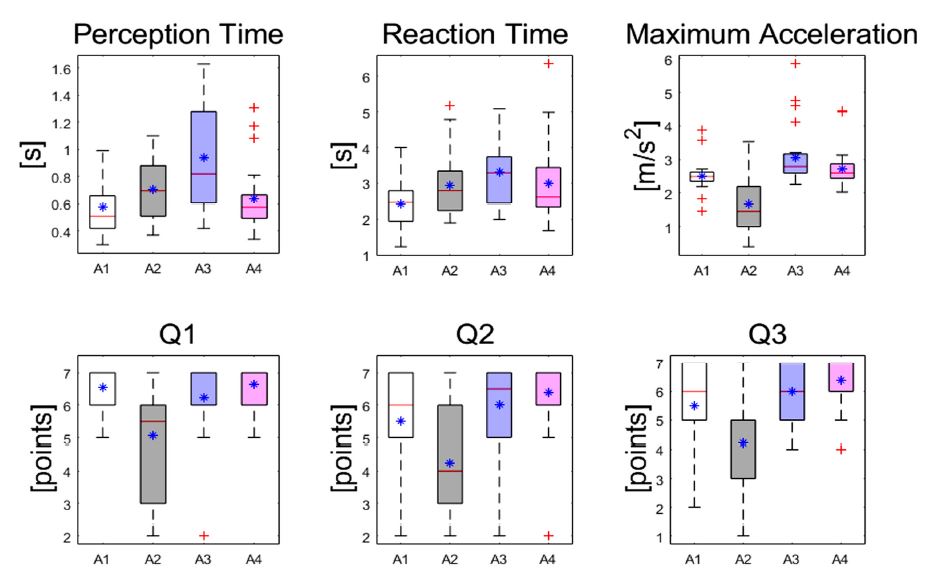

통계 분석 결과, 청각 알림 방법에 따라 인지 시간[F(3,87)=7.536, p=0.006]과 조작 시간[F(3,100)=4.464, p<0.001]에 통계적으로 유의한 차이가 있음을 확인하였다(Table 4, Fig. 1). 사후 검정 결과, A1 알림 제공 시 인지 시간이 A3 알림 제공 시 인지 시간보다 유의미하게 빨랐으며(p<0.001), A4 알림 제공 시 인지 시간은 A3 알림 제공 시 인지 시간보다 유의미하게 빨랐다(p=0.002)(Table 10). A1 알림 제공 시 조작 시간은 A3 알림 제공 시 조작 시간보다 유의미하게 빨랐다(p=0.007).

생체 지표에 해당하는 종속변수의 분석 구간은 제어권 전환 알림 시점부터 이후 5초(Seconds)로 선정하였다. 통계 분석 결과, 청각 알림 방법에 따라 GSR의 진폭[F(3,100)=0.111, p=0.954], R-R interval의 평균[F(3,100)= 0.176, p=0.926] 그리고 R-R interval의 표준편차[F(3,100)= 0.155, p=0.155]의 통계적으로 유의한 차이는 없었다.

차량 지표에 해당하는 종속변수의 분석 구간은 실험 참여자가 자율 주행에서 수동 주행으로 제어권을 전환한 시점부터 이후 2초(Seconds)다. 통계 분석 결과, 청각 알림 방법에 따라 최대 가속도의 통계적으로 유의미한 차이가 있었다[F(3,100)=19.547, p<0.001]. 조향각 편차, 횡 방향 위치 표준편차, 조향 반전율 그리고 페달 입력 횟수는 통계적으로 유의미한 차이가 없었다(Table 5). 사후 검정 결과, A2 알림 제공 시 최대 가속도는 A1 알림(p<0.001), A3 알림(p<0.001), A4 알림(p<0.001) 제공 시 최대 가속도 보다 유의미하게 작았다(Table 10).

중간 설문에 대한 청각 알림 방법에 따라 Q1 문항[F(3,100)=11.193, p<0.001], Q2 문항[F(3,100)=11.599, p<0.001], Q3 문항[F(3,100)=21.307, p<0.001] 점수의 통계적으로 유의미한 차이를 확인하였다(Table 6). 사후 검정 결과, Q1 문항에서 A2 알림의 중간 설문 점수는 A1 알림(p<0.001), A3 알림(p=0.002), A4 알림(p<0.001)의 점수보다 통계적으로 유의미하게 낮은 점수를 기록하였다(Table 10). Q2 문항에서 A2 알림 제공 시 중간 설문 점수는, A1알림(p=0.009), A3 알림(p<0.001), A4 알림(p<0.001)제공 시 중간 설문 점수에 비해 유의미하게 낮은 점수를 기록하였다.

사후 설문에서, 실험 참여자는 A4 알림을 가장 선호하였으며(37 %), 반대로 A2 알림을 가장 선호하지 않았다(10 %).

3.3 촉각 알림

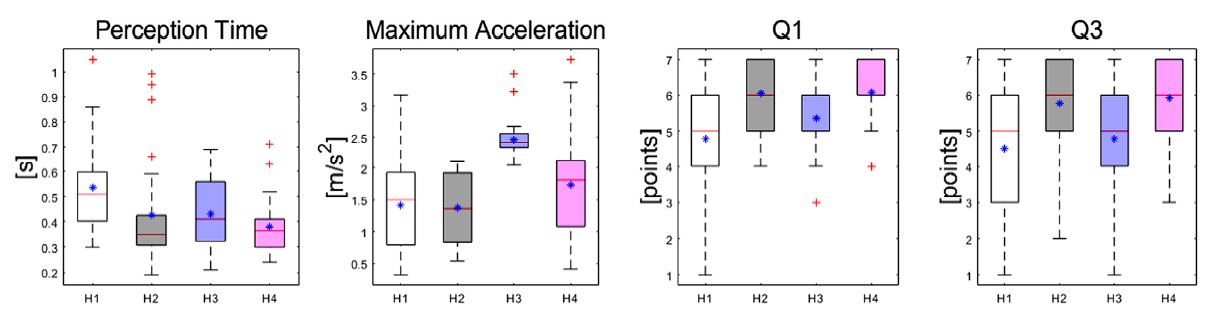

통계 분석 결과, 촉각 알림 방법에 따른 인지 시간의 통계적으로 유의미한 차이를 확인하였다[F(3,95)=3.894, p=0.011](Table 7, Fig. 2). 반면에, 조작 시간에는 유의미한 차이가 없었다[(F(3, 100)=2.20, p=0.093]. 사후 검정 결과, H4 알림 제공 시 인지 시간은 H1 알림 제공 시 인지 시간보다 유의미하게 빨랐다(p=0.008)(Table 11).

분석 구간은 본문 3.2.2와 동일하다. 통계 분석 결과, 촉각 알림 방법에 따라 GSR의 진폭[F(3,100)=0.709, p=0.549], R-R interval의 평균[F(3,100)=0.103, p=0.958], 그리고 표준편차[F(3,100)=1.857, p=0.142]의 통계적으로 유의한 차이가 없음을 확인하였다.

분석 구간은 본문 3.2.3과 동일하다. 통계 분석 결과, 촉각 알림 방법에 따라 최대 가속도[F(3,100)=17.350, p<0.001]와 페달 입력 횟수[F(3,100)=3.485, p=0.019]의 유의미한 차이가 있음을 확인하였다(Table 8). 사후 검정 결과, H3 알림 제공 시 최대 가속도는 H1 알림(p<0.001), H2 알림(p<0.001), H4 알림(p<0.001) 제공 시 최대 가속도보다 유의미하게 컸다(Table 11). 페달 입력 횟수는 알림 간 쌍대비교에서 유의 확률(α=0.0125)을 만족하지 못했다.

통계 분석 결과, 촉각 알림 방법에 따라 Q1 문항[F(3,100)= 7.367, p<0.001]과 Q3 문항[F(3,100)=6.094, p=0.001]의 통계적으로 유의미한 점수 차이를 확인하였다. 사후 검정 결과, Q1 문항에서 H1 알림 제공 시 중간 설문 점수는 H2 알림(p=0.001)과 H4 알림(p=0.001)제공 시 중간 설문 점수보다 통계적으로 유의미하게 낮은 응답 점수를 기록하였다(Table 11). Q3 문항에서 H4 알림 제공 시 중간 설문 점수는 H1 알림 제공 시 중간 설문 점수보다 유의미하게 높은 응답 점수를 기록하였다(p=0.004).

사후 설문에서, 실험 참여자는 H2 알림을 가장 선호하였으며(65 %), 반대로 H1 알림을 가장 선호하지 않았다(4 %) (Table 9).

3.4 알림별 순위화

청각, 촉각 알림 설계 방법 중 가장 효과적인 알림 방법을 도출하기 위해 분석 결과를 활용하여 통계적으로 유의한 차이를 나타내는 지표에 대해 순위화를 진행하였다. 사후검정으로 유의미한 차이가 있는 두 알림 간 평균값을 비교하여 Table 3의 기준에 따라 효과적인 결과를 도출한 알림을 지표 내 알림 1순위로 선정하였다(Table 10, 11). 반대 결과의 알림은 4순위로 선정하였다. 사후 설문은 가장 많은 응답 수를 기록한 알림 순서대로 순위를 매겼다.

4. 결론 및 향후 연구

본 연구에서는 SAE 레벨 3 수준 부분자율주행차량의 청각, 촉각 모달리티 측면에서 효과적인 제어권 전환 알림을 도출하기 위해 알림을 설계하였으며, 가상환경 시뮬레이터에서 Human-in-the-loop 실험을 진행하였다. 26명의 실험 참여자에게 취득한 데이터를 사용자 행동 지표, 생체, 차량, 설문 지표 측면에서 알림 방법에 따른 효과를 통계 분석하였다. 분석 결과를 바탕으로 통계적으로 유의미한 차이가 있는 지표에 대해 바람직한 제어권 전환 기준(Table 3)에 따라 알림 간 순위화를 진행하였으며, 순위에 따른 점수를 차등으로 부여하여 점수가 가장 높은 알림을 효과적인 알림으로 선정하였다.

청각 알림 방법을 사용자 행동 측면에서 분석한 결과, 이어콘(A1)이 제어권 전환 상황에 대한 인지 시간(PT)과 조작 시간(RT)을 가장 빠르게 유도하였다. 이는 제어권 전환 시 청각 알림으로 이어콘을 접했을 때, 상황을 빠르게 인지하고 반응했음을 알 수 있다.

제어권 인계 후 차량 제어 측면에서, 스피어콘(A2)은 다른 청각 알림보다 통계적으로 유의미하게 낮은 최대가속도를 유도하였다. 이는 스피어콘이 제어권 인계 후 운전자에게 안정적인 차량 제어를 유도하였음을 시사한다.

실험 참여자의 설문 조사 결과, 모든 중간 설문 문항(Q1, Q2, Q3)에서 스피어콘(A2)은 다른 청각 알림에 비해 통계적으로 유의미하게 낮은 점수를 받았다. 또한 제어권 전환의 선호도를 묻는 사후 설문(Q4)에서, 스피어콘은 가장 낮은 응답 수를 기록하였다(10 %). 이를 통해 제어권 전환 알림으로 스피어콘을 사용하는 것은 사용자 경험 측면에서 적절하지 않음을 알 수 있다.

촉각 알림 방법을 사용자 행동 측면에서 분석한 결과, 제어권 전환 시 강한 세기의 긴 주기 알림(H4)제공 시 인지 시간은 약한 세기의 짧은 주기 알림(H1)제공 시 인지 시간 보다 제 유의미하게 빨랐다. 이는 강한 세기의 긴 주기 알림이(H4) 다른 알림에 비해 제어권 전환 상황을 빠르게 인지시켰음을 시사한다.

촉각 알림 방법을 차량 제어 측면에서 분석한 결과, 약한 세기의 긴 주기 알림(H3) 제공 시 최대 가속도는, 다른 촉각 알림 방법 제공 시 최대 가속도보다 통계적으로 유의미하게 컸다. 이는 제어권 전환 알림으로 약한 세기(1 g)의 긴 주기 알림(3s on, 0.2s off)을 제공 받은 운전자가 수동주행 시 반응의 질(Quality)이 좋지 않았음을 시사한다.

실험 참여자의 설문 조사 결과, 경험한 알림이 직접 운전할 필요성을 느끼게 하는지 묻는 질문(Q1)에서 약한 세기의 짧은 주기 알림(H1)이 강한 세기의 짧은 주기(H2), 강한 세기의 긴 주기(H4) 알림에 비해 유의미하게 낮은 점수를 받았다. 그리고 자율주행 시 경험한 알림의 유용성 평가하는 질문(Q3)에서, 약한 세기의 짧은 주기 알림(H1)은 강한 세기의 긴 주기 알림(H4)보다 유의미하게 낮은 점수를 받았다. 이를 통해 약한 진동 세기(약 1g)는 사용자 경험 측면에서 제어권 전환 알림으로 적절하지 않음을 알 수 있다.

알림 선호도를 평가하는 사후 설문(Q4)을 분석한 결과, H2의 선호도가 가장 높았으며(65 %), 뒤이어 H4(19 %), H3(12 %), H1(4 %) 순으로 높은 선호도를 기록하였다. 이는 제어권 전환 상황에서 운전자가 강한 세기의 진동(2 g)을 선호함을 시사한다.

청각 및 촉각 알림 방법에 매겨진 점수를 합산한 결과, 청각 알림 중 이어콘이 가장 효과적인 알림으로 도출되었다(Table 12). 촉각 알림은 강한 세기(2 g)의 긴 주기(3 s on, 0.2 s off) 알림이 가장 효과적인 알림으로 도출되었다(Table 12).

본 연구를 통해 도출된 청각, 촉각 알림을 조합한 멀티 모달리티 알림 방법 후속 연구를 진행하고 있다. 또한 실험 참여자 구성 시 연령대와 성비를 균등하게 맞춰, 본 연구에서 다루지 못했던 연령대, 성별에 따른 제어권 전환 반응에 대해 분석할 것으로 예상된다.

본 연구에서는 전방 차량의 정차로 인한 제어권 전환 상황에서 실험을 진행하였다. 추후 연구에서는 자율주행 시스템의 고장, 분기로 진입 등 다양한 제어권 전환 상황에서 실험을 진행하여 상황별 가장 효과적인 제어권 전환 알림을 도출할 필요가 있다. 또한, 시뮬레이터 실험 환경과 실제 교통 상황, 소음 그리고 노면의 진동은 차이가 있기 때문에 추후 실차 실험을 통한 제어권 전환 알림 검증이 필요하다.

Acknowledgments

본 연구는 국토교통부 교통물류연구사업의 연구비 지원(20TLRP-B127651-04)과 과학기술정보통신부의 재원으로 한국연구재단의 기초연구사업의 지원을 받아 수행된 연구입니다(No.2017R1A2B4008615).

References

- NHTSA, Human Factors Design Guidance for Driver-Vehicle Interfaces, Washington, D.C., USA, 2016.

- The National Law Information Center, Act on the Pro motion and Support of Commercialization of Autom ated Vehicles, http://www.law.go.kr/LSW/lsInfoP.do?lsiSeq=208588&efYd=20200501#0000, , 2019.

- SAE On-Road Automated Vehicle Standards Committee, Taxonomy and Definitions for Terms Related to On-road Motor Vehicle Automated Driving Systems, SAE Standard J3016, 2018.

-

H. Yun, S. Kim, J. Lee and J. Yang, “Analysis of Cause of Disengagement Based on U.S. California DMV Autonomous Driving Disengagement Report,” Transactions of KSAE, Vol.26, No.4, pp.464-475, 2018.

[https://doi.org/10.7467/KSAE.2018.26.4.464]

-

S. Petermeijer, P. Bazilinskyy, K. Bengler and J. Winter, “Take-over Again: Investigating Multimodal and Directional TORs to Get the Driver Back into the Loop,” Applied Ergonomics, Vol.62, pp.204-215, 2017.

[https://doi.org/10.1016/j.apergo.2017.02.023]

-

S. Petermeijer, F. Doubek and J. Winter, “Driver Response Times to Auditory, Visual, and Tactile Take-Over Requests: A Simulator Study with 101 Participants,” IEEE International Conference on Systems, Man and Cybernetics(SMC), pp.1505-1510, 2017.

[https://doi.org/10.1109/SMC.2017.8122827]

-

J. Lee, H. Yun, J. Kim, S. Baek, H. Han, S. M. FakhrHosseini, E. Vasey, O. Lee, M. Jeon and J. Yang, “Design of Single-modal Take-over Request in SAE Level 2 & 3 Automated Vehicle,” Transactions of KSAE, Vol.27, No.3, pp.171-183, 2019.

[https://doi.org/10.7467/KSAE.2019.27.3.171]

-

J. Kim and J. Yang, “Understanding Metrics of Vehicle Control Take-over Requests in Simulated Automated Vehicles,” Int. J. Automotive Technology, Vol.21, No.3, pp.757-770, 2020.

[https://doi.org/10.1007/s12239-020-0074-z]

- T. Dinger, J. Lindsay and B. Walker, “Learnability of Sound Cues for Environmental Features: Auditory Icons, Earcons, Spearcons, and Speech,” International Conference on Auditory Display, 2008.

-

B. Walker, J. Lindsay, A. Nance, Y. Nakano, D. Palladino, T. Dingler and M. Jeon, “Spearcons (Speech-based Earcons) Improve Navigation Performance in Advanced Auditory Menus,” Human Factors, Vol.55, No.1, pp.157-182, 2013.

[https://doi.org/10.1177/0018720812450587]

- G. You, T. Kim, J. Kim, K. Lee and J. Choi, “The Effects of Voice and Visual Information Types on Driver’s Cognitive Workload and Emotion,” Proceedings of HCI Korea, pp.986-991, 2018.

- The National Law Information Center, Regulations on the Safety Operation Requirements and Test Operation of Automated Vehicles, http://www.law.go.kr/LSW/admRulLsInfoP.do?admRulSeq=2100000119909, , 2019.

-

Y. Ji, K. Lee and W. Hwang, “Haptic Perceptions in the Vehicle Seat,” Human Factors and Ergonomics in Manufacturing & Service Industries, Vol.21, No.3, pp.305-325, 2011.

[https://doi.org/10.1002/hfm.20235]

-

G. Fitch, J. Hankey, B. Kleiner and T. Dingus, “Driver Comprehension of Multiple Haptic Seat Alerts Intended for Use in an Integrated Collision Avoidance System,” Transportation Research Part F: Traffic Psychology and Behaviour, Vol.14, No.4, pp.278-290, 2011.

[https://doi.org/10.1016/j.trf.2011.02.001]

-

S. Baek, H. Yun and J. Yang, “How Do Humans Respond When Automated Vehicles Request an Immediate Vehicle Control Take-Over?,” Proceedings of the 11th International Conference on Automotive User Interfaces and Interactive Vehicular Applications: Adjunct Proceedings, pp.341-345, 2019.

[https://doi.org/10.1145/3349263.3351496]

-

C. Gold, D. Dambock, L. Lorenz and K. Bengler, “Take over!” How long does it take to get the driver back into the loop?,” Proceedings of the and Ergonomics Society Annual Meeting, Vol.57, No.1, pp.1938-1942, 2013.

[https://doi.org/10.1177/1541931213571433]

-

J. Bakker, M. Pechenizkiy and N. Sidorova, “What’s Your Current Stress Level? Detection of Stress Patterns from GSR Sensor Data,” IEEE 11th International Conference on Data Mining Workshops, pp.573-580, 2011.

[https://doi.org/10.1109/ICDMW.2011.178]

- J. Noh, H. Park, S. Yang and J. Sohn, “Classification of Anger, Fear, Surprise Using Physiological Signals,” Proceedings of the Ergonomics Society of Korea, pp.355-358, 2011.

- H. Pacejka, Tire and Vehicle Dynamics, 2nd Edn., Elsevier, Oxford, 2005.

-

T. Dukic, L. Hanson and T. Falkmer, “Effect of Drivers' Age and Push Button Locations on Visual Time off Road, Steering Wheel Deviation and Safety Perception,” Ergonomics, Vol.49, No.1, pp.78-92, 2006.

[https://doi.org/10.1080/00207540500422320]

- F. Naujoks, C. Mai and A. Neukum, “The Effect of Urgency of Take-Over Requests during Highly Automated Driving under Distraction Conditions,” Advances in Human Aspects of Transportation: Part I, pp.431-438, 2014.

-

W. Macdonald and E. Hoffmann, “Review of Relationships between Steering Wheel Reversal Rate and Driving Task Demand,” Human Factors, Vol.22, No.6, pp.733-739, 1980.

[https://doi.org/10.1177/001872088002200609]

-

M. Park and J. Son, “Reference Test Scenarios for Assessing the Safety of Take-over in a Conditionally Autonomous Vehicle,” Transactions of KASE, Vol.27, No.4, pp.309-317, 2019.

[https://doi.org/10.7467/KSAE.2019.27.4.309]

- United Nations Economic Commission for Europe, Automatically Commanded Steering Function (ACSF) Proposal, Take-Over Time Comparison, 18th Congress, 9th Session, https://wiki.unece.org/display/trans/ACSF+18th+session, , 2019.