선행 차량 중앙선 침범 인지 모델의 디지털 트윈 자율주행 시뮬레이션 기반 성능 검증에 관한 연구

Copyright Ⓒ 2026 KSAE / 242-07

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

This study proposes a model capable of recognizing and making decisions on whether a preceding vehicle will inevitably cross the center line in challenging road scenarios encountered by autonomous vehicles. In order to validate the proposed approach, a high-definition road map, based on a 3D point cloud map and a vector map of the Yeungnam University campus, and a digital twin-based autonomous driving simulation environment were utilized. To detect whether a preceding vehicle crosses the center line, the recognition model has been combined with a YOLO-based preceding vehicle detection model and a center line detection model that utilizes both LaneNet and RANSAC. We applied the counterclockwise algorithm using the position of the detected vehicle and the center line to verify center line violations. The proposed model was validated through simulations conducted in a digital twin environment. The validation dataset incorporated various weather and road conditions within the simulation environment. Simulation results achieved an average accuracy of 0.929, reaching a maximum accuracy of 0.995 under sunny weather conditions on straight road scenarios.

Keywords:

Digital twin, Simulation, High definition road map, Center line violation, Recognition model, Neural network키워드:

디지털 트윈, 시뮬레이션, 정밀도로지도, 중앙선 침범, 인지 모델, 인공 신경망1. 서 론

자율주행(Autonomous driving) 기술과 인공지능(Artificial intelligence) 기술은 빠른 속도로 발전하며 자율주행차량의 주행 안전성을 향상시키고 있다. 최근의 자율주행 시스템은 일반적인 도로 환경에서 안정적으로 주행이 가능한 단계에 도달하였다. 그러나 자율주행 레벨 4 이하의 자율주행 시스템은 정의된 운행 설계 영역(ODD, Operational Design Domain) 내에서만 안전성과 신뢰성을 보장하며, 운행 설계 영역을 벗어나는 돌발 상황이나 예외적 도로 조건에 직면했을 때는 인지 및 판단 능력의 한계를 보이는 경우가 많다. 특히 편도 1차선 도로에서 도로 공사, 불법주정차 차량 등으로 인해 자율주행차량이 중앙선을 일시적으로 침범하지 않으면 주행을 지속할 수 없는 상황은 실제 도로에서 자주 발생하지만, 현재의 차선유지 및 차선변경 시스템으로는 이와 같은 상황에 유연하게 대응하기 어렵다.

자율주행차량이 주행 중 마주할 수 있는 돌발 상황이나 운행 설계 영역(ODD) 외의 도로 상황에 대한 대응 능력을 안전하게 검증하기 위해서는 현실 도로가 아닌 가상 환경에서의 실험이 요구된다. 특히 중앙선 침범과 같은 실제 도로에서 재현하기 어렵고 위험한 시나리오는 디지털 트윈(Digital twin) 기반의 시뮬레이션을 통해 안전하게 검증할 수 있다. 디지털 트윈 기반의 시뮬레이션은 현실의 지형, 교통 흐름, 차량 및 센서 정보 등을 가상 공간에 정밀하게 복제하여 다양한 기상 조건이나 자율주행차량이 도로에서 마주할 수 있는 다양한 엣지 케이스(Edge case)에서 자율주행 시스템의 인지⋅판단⋅제어 능력을 종합적으로 평가할 수 있다. 최근에는 디지털 트윈 자율주행 시뮬레이션의 신뢰도를 높이기 위해 센서 모델의 정밀도, 도로 및 교통 시나리오의 다양성, 실제 환경과의 동기화(Sim2Real) 가능성 등을 고려한 시뮬레이션 프레임워크가 제안되고 있으며 관련 연구 또한 활발히 진행되고 있다.1)

국내 및 국외에서는 다수의 상용 소프트웨어 플랫폼과 오픈소스(Open source) 플랫폼을 기반으로 디지털 트윈 시뮬레이션 환경을 구현하고 이를 통해 경로 추종, 장애물 회피, 3GPP를 이용한 군집 주행 등 다양한 자율주행 시나리오를 설정하고 디지털 트윈 시뮬레이션 환경에서 자율주행 시스템의 성능을 분석하는 연구가 다수 진행되고 있다.2-5) 이 외에도 Lee 등6)은 디지털 트윈 환경에서 드라이빙 시뮬레이터(Driving simulator)를 사용해 시뮬레이션을 수행하고, 이후 동일한 실험 프로토콜로 혼합현실 환경에서 시험을 진행하는 방식으로 항법 센서의 누적 위치 오차를 극복하기 위한 자율주행차량 시험 방법을 제안하였고, Kwak 등7)은 3D 차량 시뮬레이터인 LGSVL을 이용해 ROS 기반 자율주행 알고리즘 시뮬레이션 환경을 통합 개발하여 차선 유지, 차선 변경, 코스 주행 시나리오에 대한 시뮬레이션을 통해 자율주행 알고리즘의 성능을 검증하는 방법을 제안하였다.

이러한 선행 연구를 바탕으로, 본 연구에서는 디지털 트윈 기반 시뮬레이션 환경을 활용하여 자율주행차량이 실제 도로에서 직면할 수 있는 엣지 케이스 중 하나인 선행 차량(Preceding vehicle)의 중앙선 침범 상황(Center line violation)을 인지하는 모델을 제안하고, 해당 시나리오에 대한 시스템 성능을 정량적으로 검증하고자 한다. 이를 위해 대학교 캠퍼스를 대상으로 3차원 점군(Point cloud) 지도와 벡터(Vector) 지도를 제작하였으며, 제작한 지도를 바탕으로 디지털 트윈 시뮬레이션 환경을 구축하였다. 선행 차량의 중앙선 침범을 인지하는 모델은 YOLO(You Only Look Once) 기반의 객체 인식 모델을 통해 선행 차량의 위치를 인식하며, Lanenet 기반 중앙선 검출 모델에 RANSAC(Random Sample Consensus) 알고리즘을 결합하여 중앙선을 검출한다. 두 검출 결과에 CCW(Counter Clock Wise) 알고리즘을 적용하여 선행 차량의 중앙선 침범 여부 인지 모델을 구성하였다.

2. 디지털 트윈 시뮬레이션 환경 구축

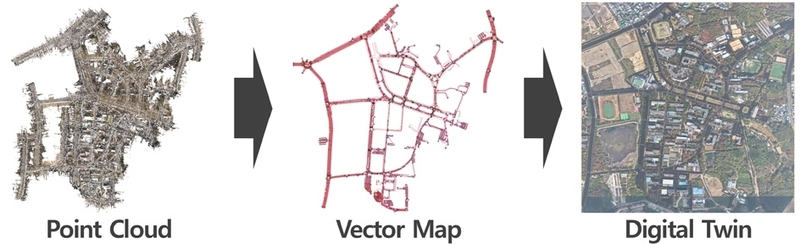

디지털 트윈 시뮬레이션 환경은 개발한 자율주행 시스템을 실도로에서 적용하기 전, 다양한 시나리오를 가상으로 구현하여 자율주행 시스템을 검증할 수 있다. 본 연구에서는 MMS(Mobile Mapping System) 장비를 이용하여 Fig. 1과 같이 대학교 캠퍼스의 3D 점군(Point cloud) 지도를 제작한 후 자율주행에 불필요한 데이터를 지우고 자율주행 시스템에 필요한 도로 및 주행 환경 속성을 추가한 벡터 지도를 제작하였다. 제작한 점군 지도와 벡터 지도는 자율주행에 사용할 수 있는 정밀도로지도로 사용할 수 있으며 해당 정밀도로지도를 기반으로 디지털 트윈 환경을 구축하였다.8)

2.1 대상 지역 선정

본 연구에서 디지털 트윈 시뮬레이션 환경 구축 대상 지역은 영남대학교 캠퍼스 및 주변도로로 선정하였다. 영남대학교 캠퍼스는 약 2,689,651 m2의 크기로 전국에서 두 번째로 넓은 부지를 가지고 있으며, Table 1과 같이 교차로, 횡단보도 등을 보유하고 있어 자율주행 실험에 적합한 도로 환경을 갖추고 있다. 이 외에도 영남대학교는 신호등, 교통표지판 등을 갖추고 있는 자율주행실습 트랙(Y-Road)을 보유하고 있어, 다양한 시나리오 기반의 자율주행 기술 개발 및 검증이 가능하다.

2.2 3D 점군 지도 제작

3D 점군 지도를 제작하기 위한 MMS 장비는 Table 2와 같이 LiDAR, 카메라, GNSS, IMU 센서를 탑재하고 있는 Leica Pegasus: Two Ultimate를 사용하였다. 점군 지도 제작은 MMS 장비가 탑재된 차량으로 영남대학교 캠퍼스 도로를 주행하며 LiDAR 센서를 이용해 점군 데이터를 수집하였고 Fig. 2와 같은 3차원 점군 지도를 제작하였다. 점군 지도의 오차범위는 Table 3과 같이 5 cm 이내이며 점군 지도에 드론 이미지를 포함하여 오차범위를 3 cm 이내로 향상시켰다.

2.3 벡터 지도 제작

벡터 지도는 앞서 제작한 3차원 점군 지도에서 자율주행에 불필요한 요소들을 제거하고 국토정보지리원의 정밀도로지도 매뉴얼9)에 정의된 속성을 추가하여 제작하였다. 정밀도로지도 매뉴얼은 도로와 교통 환경을 표현하는 주행 경로 노드(A1_NODE), 주행경로링크(A2_LINK)를 포함한 총 14가지의 속성을 정의하고 있다. 본 연구에서는 Table 4와 같이 캠퍼스에 존재하지 않는 구간(A3_DRIVEWAYSECTION), 킬로포스트(C2_KILOPOST), 높이장애물(C5_HEIGHTBARRIER)을 제외한 11가지 속성을 벡터 지도에 추가하였다.

제작한 벡터 지도는 단순한 공간 표현이 아닌 자율주행차량 주행에 필요한 도로 정보 및 주행 환경 정보를 제공한다. 벡터 지도는 차선, 횡단보도, 신호등과 같은 교통 시설 및 도로의 형태, 곡률, 제한 속도 등의 정보를 포함하고 있어, 자율주행차량의 경로 계획, 최고 속도 제한, 차선 유지, 횡단보도 및 정지선 인식과 같은 다양한 자율주행 판단 및 제어에 사용할 수 있다.

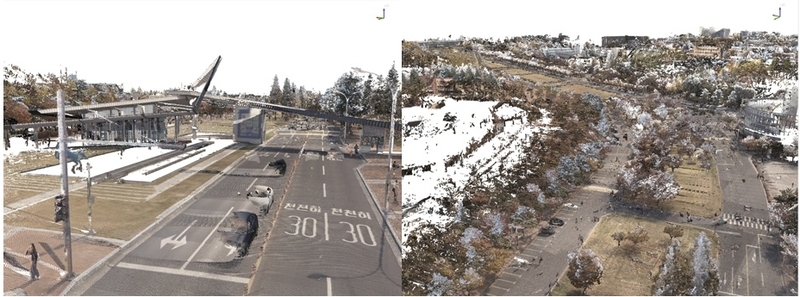

2.4 디지털 트윈 시뮬레이션 환경 구성

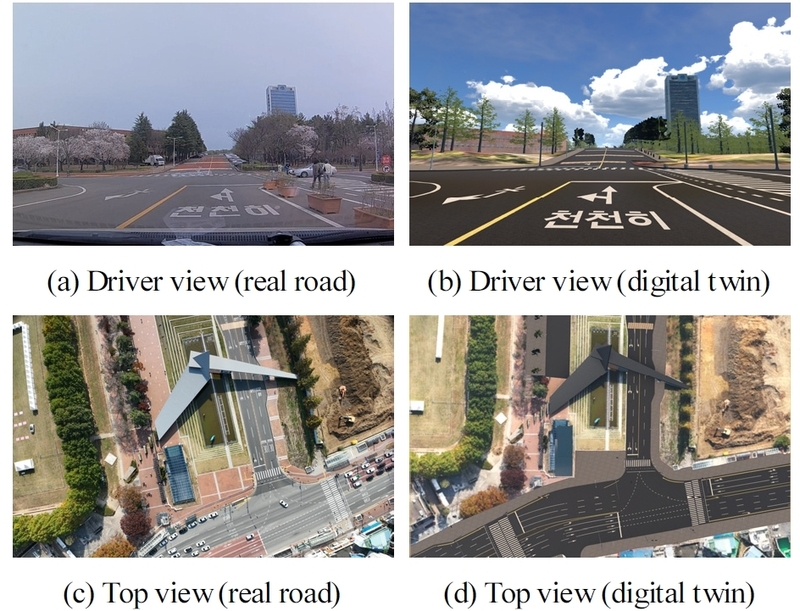

디지털 트윈 시뮬레이션 환경은 앞서 제작한 점군 지도와 벡터 지도를 이용해 구축하였다. 점군 지도와 벡터 지도는 자율주행에 필요한 도로 정보와 교통 인프라 정보를 갖추고 있으며, 이를 활용하여 실제 영남대학교 캠퍼스를 모사한 가상의 디지털 트윈 환경을 구축하였다. 실제 환경과 더욱 유사한 디지털 트윈 시뮬레이션 환경을 위해 건물, 가로수, 표지판 등 대학교 캠퍼스를 구성하는 다양한 요소들도 3차원 객체로 모델링하였다. Fig. 3은 실제 도로와 구축한 디지털 트윈 환경을 비교한 것이다. 구축한 디지털 트윈 환경은 LiDAR, 카메라, GPS 등 다양한 센서 모델을 포함하고 있으며 날씨, 시간 등 기상 조건도 자유롭게 설정할 수 있도록 구성하였다.

3. 선행 차량의 중앙선 침범 인지 모델

본 연구에서는 편도 1차선 도로에서 도로 공사, 불법 주정차, 자전거와 같은 느린 이동체와 같은 이유로 자율주행차량이 중앙선을 일시적으로 침범하지 않으면 정상적인 주행을 지속할 수 없는 엣지 케이스 시나리오를 설정하였다. 이러한 시나리오는 실제 도로에서도 빈번하게 발생하며 자율주행 시스템의 차선유지 및 변경 주행 방식만으로는 대응하기 어려운 상황이다. 자율주행차량이 해당 시나리오에 대응하기 위해선 선행 차량의 움직임, 도로 폭, 장애물의 위치, 맞은편 차량의 유무 등 다양한 변수를 종합적으로 고려해야 한다. Fig. 4(a)는 대학교 인근 실제 도로에서 중앙선 침범이 필요한 상황을 촬영한 것이며, Fig. 4(b)는 해당 시나리오를 디지털 트윈 시뮬레이션 환경에서 재현한 것이다.

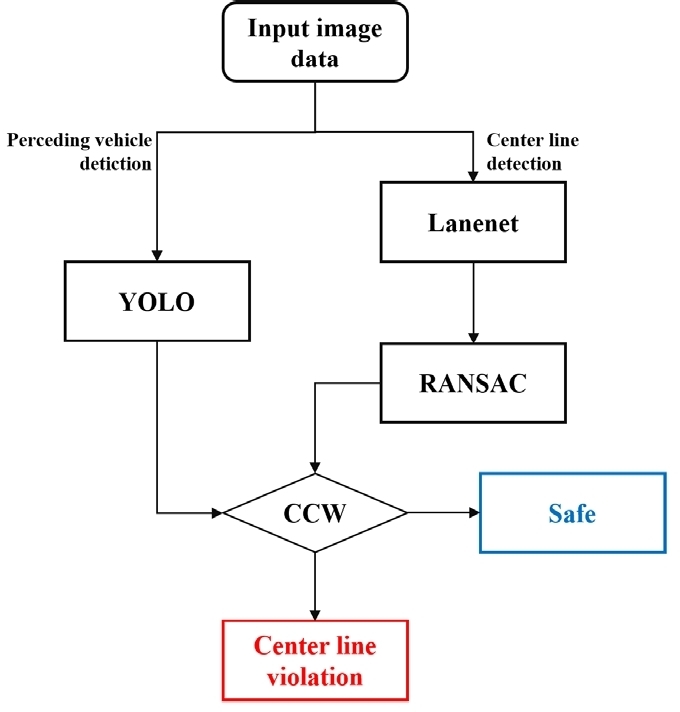

선행 차량의 중앙선 침범 여부 인지 프로세스는 Fig. 5의 흐름도와 같이 YOLO 기반의 객체 인식 모델과 Lanenet 및 RANSAC 기반의 차선 검출 모델을 통합한 구조10)로 설계하였다. 전체 시스템은 전방 카메라로부터 입력된 영상에서 선행 차량과 도로의 중앙선을 동시에 검출하고 이 둘의 상대적인 위치를 분석하여 중앙선 침범 여부를 실시간으로 인지하도록 구성하였다.

객체 인식을 담당하는 YOLO는 실시간 객체 인식에서 우수한 속도와 정확도를 제공하는 딥러닝 기반 알고리즘으로 전방 카메라 영상을 통해 선행 차량의 위치를 인식하였다. 중앙선 검출은 중앙선의 위치를 픽셀 단위로 예측하는 Lanenet과 예측한 픽셀 분포 중 이상치를 제거하고 중앙선을 하나의 직선으로 근사화하는 RANSAC 알고리즘 결합하여 불연속적이거나 잡음이 많은 결과에서도 일관성 있게 중앙선을 검출하도록 하였다.

기존 YOLO 기반 객체 인식이나 차선 검출 모델은 주로 독립적으로 객체를 식별하거나 차선 경계를 검출하여 규칙 위반 여부를 판단하는 데 초점을 두고 있으나, 본 연구에서 제안한 모델은 단일 카메라 영상으로부터 선행 차량과 중앙선을 동시에 검출하고, 이 두 정보를 통합하여 선행 차량의 중앙선 침범 여부를 실시간으로 판단할 수 있도록 설계하였다. 또한 해당 모델은 중앙선 침범이라는 법적, 기술적 판단이 요구되는 복합적인 상황에서 선행 차량의 행위를 단순히 인지하는 것을 넘어, 해당 상황을 자율주행 시스템이 이해하고 이에 따른 주행 전략을 수립하는 것을 목표로 한다. 또한 자율주행차량이 복잡한 도로 환경에서도 단순 회피나 비상 정지가 아닌 도로 환경에 따라 적합한 주행 전략을 수립하고 궁극적으로는 인간 운전자와같이 다양한 도로 상황에 유연하고 자연스럽게 주행하는 데에 기여할 수 있다.

3.1 선행 차량 인식 모델

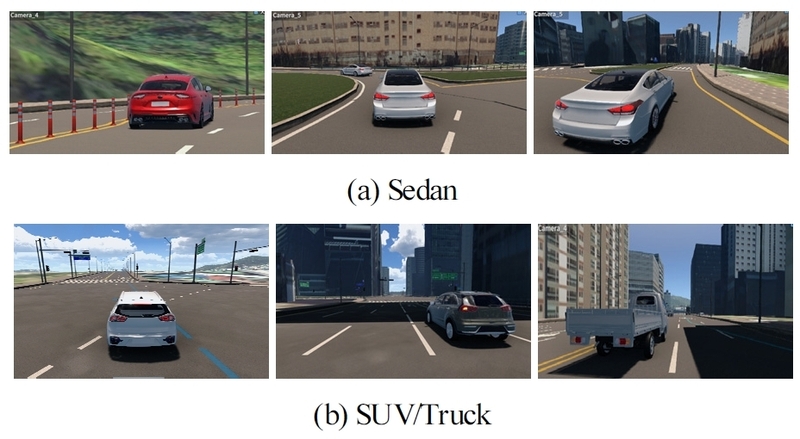

선행 차량 인식 모델 학습을 위한 데이터 셋은 2장에서 구축한 디지털 트윈 시뮬레이션 환경에서 제작하였다. Fig. 6과 Table 5와 같이 다양한 차량 모델이 포함된 1,976장의 이미지 데이터와 각 이미지 내에 차량의 위치 정보를 포함하는 라벨링 데이터로 구성하였다.

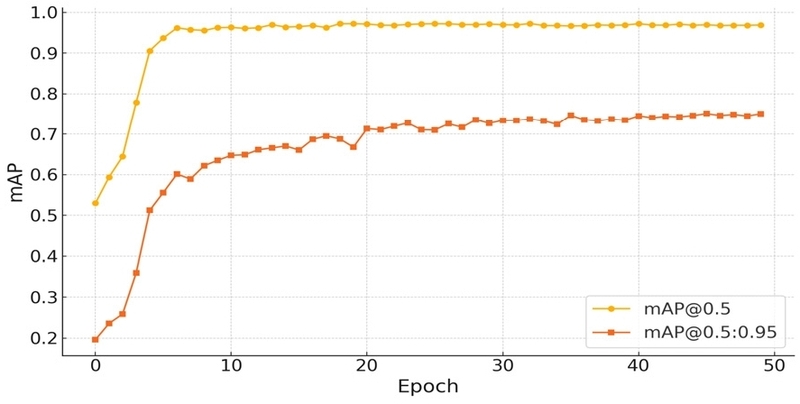

모델 학습은 구성한 데이터 셋을 8:2의 비율로 학습 데이터와 검증 데이터로 나누어 진행하였다. 모델 성능 평가는 정밀도와 재현율 곡선 아래 면적을 계산 후 모든 클래스에 대한 평균값을 나타내는 지표인 mAP(Mean Average Precision)11)를 기준으로 수행하였으며 Fig. 7과 같이 IoU(Intersection over Union) 0.5 기준인 mAP@0.5에서 0.9644, IoU 0.5에서 0.95까지 0.05 간격으로 평균한 기준(mAP@0.5:0.95)에서 0.7303의 성능을 나타내었다.

3.2 중앙선 검출 모델

중앙선 검출 모델은 Kaggle에서 제공하는 TuSimple 데이터 셋12)을 사용하여 학습하였다. TuSimple은 차선 검출 모델 학습 및 성능 평가에 널리 활용되는 공개 데이터 셋으로 총 3,626장의 학습 이미지와 라벨링 된 8가지 차선 클래스로 구성되어 있다. 학습 데이터에 포함된 전체 차선의 수는 14,337개이며, 차선 클래스별 분포는 Table 6과 같다.

TuSimple 데이터 셋을 기반으로 학습한 중앙선 검출 모델은 Lanenet과 RANSAC 알고리즘을 결합하여 설계하였다. Lanenet은 심층 신경망 기반의 실시간 차선 검출 모델로, 픽셀 임베딩을 통한 인스턴스 분할과 이진 분할을 동시에 수행하는 모델13)이며 경량화된 구조로 인해 실시간 처리에 적합하다. 본 연구에서는 디지털 트윈 시뮬레이션 환경의 다양한 도로 이미지에서 중앙선을 안정적으로 검출할 수 있는 모델로 Lanenet을 사용하였다.

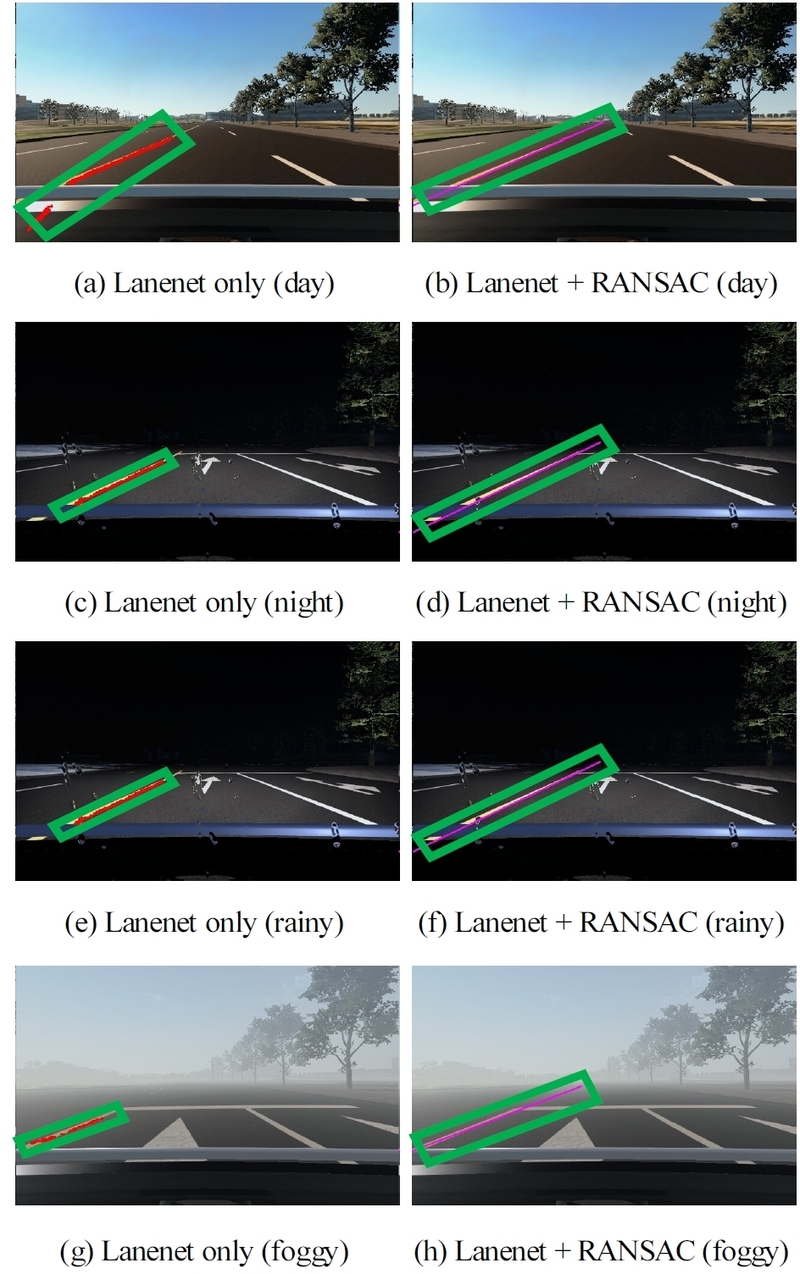

본 연구에서는 가우시안 함수 기반 스코어링을 통해 가장 많은 인라이어(Inlier)를 포함하는 모델을 탐색하는 알고리즘14,15)인 RANSAC을 중앙선 검출의 후처리 단계에 적용하여 Lanenet의 출력 결과에서 이상치(Outlier)를 제거하고 검출한 중앙선의 카메라 기준 좌표를 추출하였다. Fig. 8은 밤, 우천, 안개와 같이 다양한 기상 조건을 디지털 트윈 시뮬레이션 환경에서 구현한 후 중앙선을 검출한 결과이다. Lanenet 모델의 정확도는 Table 7과 같이 0.779를 기록하였으며, Lanenet에 RANSAC 알고리즘을 적용했을 때의 정확도는 0.875를 기록하였다.

3.3 중앙선 침범 인지 알고리즘

중앙선 침범 인지 알고리즘은 3.1절과 3.2절에서 개발한 선행 차량 인식 모델과 중앙선 검출 모델을 결합하여 구성하였다. 본 알고리즘은 자율주행차량이 주행 중 실시간으로 카메라 영상에서 선행 차량과 중앙선의 좌표를 추출하고, 이들의 위치 관계를 분석하여 침범 여부를 인지한다. 인지 기준은 선행 차량의 바운딩박스(Bounding box) 하단 선분과 검출된 중앙선 선분 간의 교차 여부이며, 이를 위해 CCW 알고리즘을 적용하였다.

CCW 알고리즘은 세 점의 상대 위치를 기반으로 선분의 방향성을 수학적으로 판단하는 알고리즘이다. CCW 알고리즘의 연산식은 식 (1)에 제시하였으며, 4회의 CCW 연산 결과가 식 (2)와 (3)을 만족하면 두 선분이 교차하는 것으로 판별한다. 연산 구조가 단순하고 계산 속도가 빨라 실시간 시스템에 사용하기에 적합하다.

| (1) |

| (2) |

| (3) |

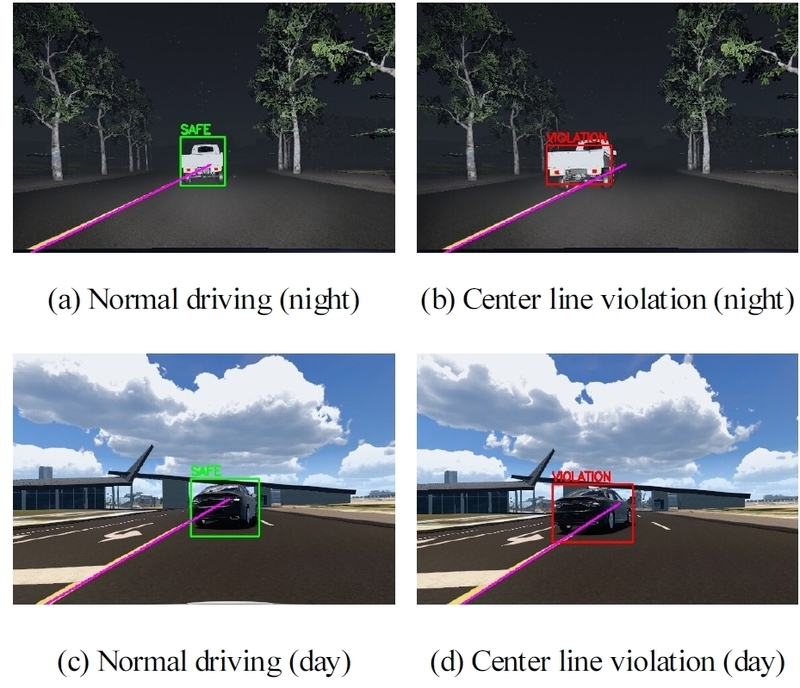

본 연구에서는 선행 차량의 바운딩 박스 하단 선분을 중앙선 침범의 판단 기준으로 CCW 알고리즘을 적용하였다. Figs. 9(a)와 (c)에서는 두 선분이 교차하지 않아 정상 주행 상황으로 인지하였고, Figs. 9(b)와 (d)에서는 두 선분이 교차하여 선행 차량이 중앙선을 침범한 것으로 인지하였다. 이러한 방식은 센서나 GPS 기반의 위치 정보에 의존하지 않고 카메라 기반의 이미지 정보만 사용하여 선행 차량의 중앙선 침범 인지가 가능하여 GPS 음역 지역 등에서도 적용이 가능하다.

4. 선행 차량의 중앙선 침범 인지 모델 검증

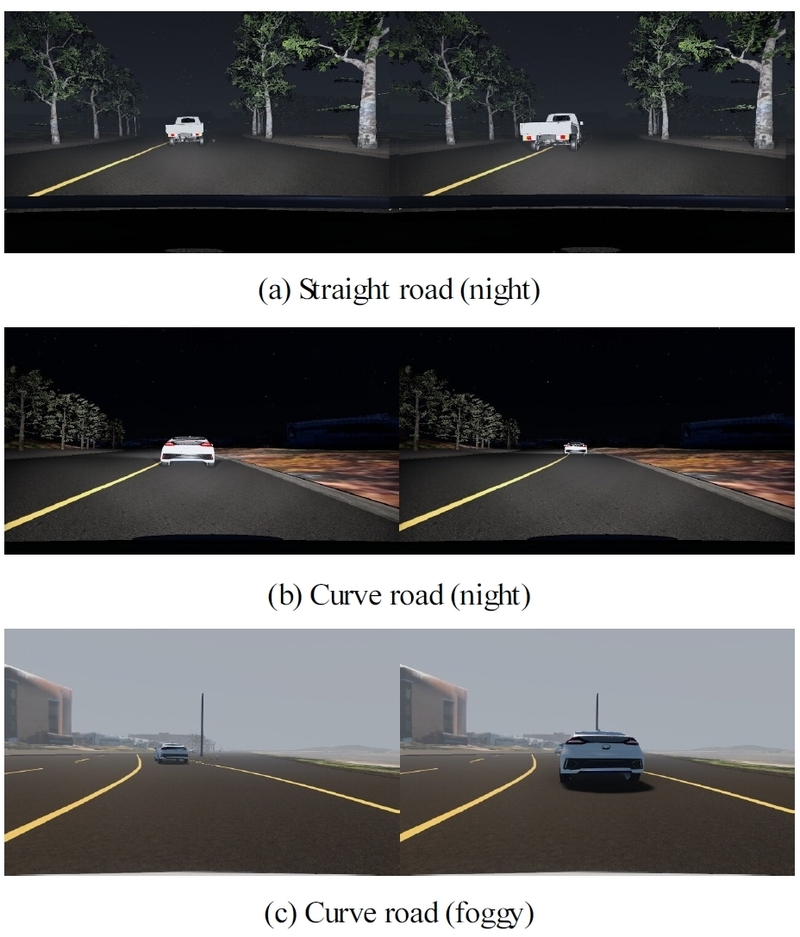

선행 차량의 중앙선 침범 인지 모델의 검증은 2장에서 구축한 디지털 트윈 시뮬레이션 환경에서 진행하였다. 검증 데이터는 디지털 트윈 환경에서 Fig. 10과 같이 다양한 날씨, 차선 조건을 반영한 3,600장의 이미지 데이터와 중앙선 침범 여부에 대한 라벨링 데이터로 데이터 셋을 구축하였다.

Tables 8과 9는 디지털 트윈 시뮬레이션에서 설정한 환경 조건에 따른 정확도와 F1 score 평가 결과이며 검증 데이터 셋 전체에 대한 평균 정확도는 0.929, F1 score는 0.871을 기록하였다. 이는 검증 데이터 셋에서 중앙선 침범 상황의 비중이 상대적으로 낮기 때문으로 해석된다. 또한 맑은 날씨의 직선 구간에서는 0.995의 정확도와 0.950의 F1 score를 기록하며 안정적인 성능을 보였다. 곡선 구간에서는 다소 낮은 정확도와 F1 score를 보였으며 이는 Lanenet의 출력 결과가 불연속적으로 나타나는 일부 데이터에서 RANSAC 피팅 과정에서 이상치의 영향이 증가하기 때문으로 판단된다. 향후에는 곡선 구간 데이터 셋을 추가하여 Lanenet 모델의 곡선 검출 성능을 향상할 예정이다.

4. 결 론

본 연구에서는 대학교 캠퍼스를 기반으로 정밀도로지도와 디지털 트윈 시뮬레이션 환경을 구축하고, 이를 활용하여 자율주행차량이 주행 중 선행 차량의 중앙선 침범 상황을 인지할 수 있는 모델을 개발하고 그 성능을 검증하였다. 본 연구의 주요 결론은 다음과 같다.

- 1) MMS 장비로 취득한 점군 데이터와 드론으로 촬영한 고해상도 이미지를 결합하여 영남대학교 캠퍼스를 오차범위 3 cm 이내의 벡터 지도로 제작하였다. 이를 활용하여 자율주행차량이 사용할 수 있는 정밀도로지도를 제작하였으며 이를 디지털 트윈 시뮬레이션 환경 구축에 적용하였다. 이를 통해 자율주행 시스템이 실제 도로에서 실험하기 어려운 복잡하고 위험한 시나리오도 반복적으로 테스트할 수 있는 환경을 구축하였다.

- 2) 선행 차량의 중앙선 침범 인지 모델은 YOLO 기반 선행 차량 인식 모델과 Lanenet-RANSAC 기반 중앙선 검출 모델을 결합하여 구현하였으며 CCW 알고리즘을 이용해 두 객체 간의 교차 여부를 판별하였다. 선행 차량의 바운딩 박스 하단이 중앙선과 교차하는 경우 중앙선 침범 상황으로 판별하여 이를 자율주행 시스템이 실시간으로 인지하도록 설계하였다.

- 3) 구현한 선행 차량의 중앙선 침범 인지 모델은 디지털 트윈 시뮬레이션 환경에서 다양한 도로, 날씨 조건을 반영한 실험을 통해 성능을 검증하였으며 전체 검증 데이터 셋에서 평균 92.9 %의 정확도를 기록하였다. 이는 제안한 모델이 다양한 도로 조건에서도 안정적인 인지 성능을 나타낼 수 있음을 보여준다.

본 연구에서는 불가피한 중앙선 침범이라는 법적, 기술적 판단이 요구되는 복잡한 상황에서 선행 차량의 행위를 단순히 인지하는 것을 넘어, 해당 상황을 자율주행 시스템이 이해하고 이에 따른 주행 전략을 수립하는 것을 목표로 하였다. 본 연구에서 선정한 시나리오가 편도 1차선 도로에 한정 되어있는 점을 고려하여 향후 연구에서는 다차선 도로, 교차로, 혼잡 교통 상황 등의 주행 데이터를 수집하고, 선행 차량의 크기, 속도 변화, 교통 밀집도와 같은 변수를 고려한 데이터 셋을 구축할 계획이다. 또한 V2X 통신을 활용하여 교통 상황과 돌발 상황을 인지하고 다중 센서 데이터 융합을 통한 선행 차량의 고정밀 위치 정보와 주행 궤적 산출에 대한 연구도 수행할 예정이다.

Acknowledgments

A part of this paper was presented at the KSAE 2025 Spring Conference

본 논문은 2025년도 산업통상자원부 및 한국산업기술기획평가원(KEIT) 연구비 지원에 의한 연구임(과제번호: No.20024908, 과제명: 운전자 맞춤형 Seamless 자율주행제어권 통합관리 시스템 기술 개발).

References

-

X. Hu, S. Li, T. Huang, B. Tang, R. Huai and L. Chen, “How Simulation Helps Autonomous Driving: A Survey of Sim2real, Digital Twins, and Parallel Intelligence,” IEEE Transactions on Intelligent Vehicles, Vol.9, No.1, pp.593–612, 2024.

[https://doi.org/10.1109/TIV.2023.3312777]

-

H. H. Lee, H. J. Kim and S. C. Kee, “Implementation of a Simulator Environment Based on an Open-Source Autonomous Driving Platform,” Transactions of KSAE, Vol.33, No.5, pp.353–363, 2025.

[https://doi.org/10.7467/KSAE.2025.33.5.353]

-

H. S. Jo, J. M. Kim and S. W. Yoon, “Proposal of CARLA-Based Test Scenarios for Autonomous Vehicle Data Acquisition in a Virtual Environment,” Transactions of KSAE, Vol.32, No.3, pp.267–272, 2024.

[https://doi.org/10.7467/KSAE.2024.32.3.267]

-

I. S. Jang, K. J. Li, E. O. Joo and M. S. Kim, “Synthetic Training Dataset Generation Using a Digital Twin-Based Autonomous Driving Simulator,” Sensors and Materials, Vol.36, No.9, pp.4029–4041, 2024.

[https://doi.org/10.18494/SAM5343]

-

Z. Zhou, C. Rother and J. Chen, “Event-Triggered Model Predictive Control for Autonomous Vehicle Path Tracking: Validation Using CARLA Simulator,” IEEE Transactions on Intelligent Vehicles, Vol.8, No.6, pp.3547–3555, 2023.

[https://doi.org/10.1109/TIV.2023.3266941]

- Y. H. Lee, W. J. Yang, H. J. Hong and J. H. Won, “Mixed-Reality for Simulation Testing of Automated Vehicles,” Journal of Positioning, Navigation, and Timing, Vol.13, No.4, pp.449–455, 2024.

- J. S. Kwak and K. S. Yi, “Development of Simulation Environment for Autonomous Driving Algorithm Validation Based on ROS,” Journal of Auto-Vehicle Safety Association, Vol.14, No.1, pp.20–25, 2022.

- D. W. Lee, T. L. Kim and S. J. Kwon, “Establishment and Utilization of Digital Twin Self-Driving Testbed Based on Yeungnam University Campus and Self-Driving Test Track (Y-Road),” KSAE Daegu-Gyeongbuk Branch Autumn Conference Proceedings, p.28, 2024.

- National Geographic Information Institute, HD Map Construction Manual, https://www.ngii.go.kr/kor/contents/view.do?sq=1379&board_code=contents_data, , Accessed on 2025. 07. 02.

- J. H. Han and S. J. Kwon, “Recognition Model Verification for Preceding Vehicle’s Center Line Violation by Using a Digital Twin Based Autonomous Driving Simulation,” KSAE Spring Conference Proceedings, pp.385–386, 2025.

-

M. Everingham, L. V. Gool, C. K. I. Williams, J. Winn and A. Zisserman, “The PASCAL Visual Object Classes (VOC) Challenge,” International Journal of Computer Vision, Vol.88, pp.303–338, 2010.

[https://doi.org/10.1007/s11263-009-0275-4]

- Kaggle, TuSimple Lane Detection Dataset, https://www.kaggle.com/datasets/manideep1108/tusimple?resource=download, , Accessed on 2025. 07. 22.

-

D. Neven, B. De Brabandere, S. Georgoulis, M. Prosmans and L. Van Gool, “Towards End-to-End Lane Detection: an Instance Segmentation Approach,” 2018 IEEE Intelligent Vehicles Symposium (IV), pp.286–291, 2018.

[https://doi.org/10.1109/IVS.2018.8500547]

-

M. A. Fischler and R. C. Bolles, “Random Sample Consensus: A Paradigm for Model Fitting with Applications to Image Analysis and Automated Cartography,” Communications of the ACM, Vol.24, No.6, pp.381–395, 1981.

[https://doi.org/10.1145/358669.358692]

- Y. G. Choi, E. Y. Seo, S. Y. Suk, J. H. Park and H. Y. Jung, “Lane Detection Using Gaussian Function Based RANSAC,” Journal of Embedded Systems and Applications, Vol.13, No.4, pp.195–204, 2018.