자율 객체 추종을 위한 파티클 필터 기반 위치 추정 및 제어 시스템

Copyright Ⓒ 2025 KSAE / 235-04

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

Tracking objects in large indoor spaces like airports poses various challenges due to dynamic obstacles such as crowds. This paper presents a particle filter-based system that integrates camera and Ultra-Wideband sensor data for estimating and controlling object position. The camera provides detailed visual detection, while Ultra-Wideband ensures robust positioning under occlusion. By fusing these inputs, the system achieves accurate object tracking in crowded settings. A control algorithm utilizes the estimated position to enable smooth and precise object following. Experiments in an airport-like environment validate the system’s effectiveness, demonstrating reliable performance in dynamic conditions. This work contributes to the field of autonomous navigation in complex indoor spaces.

Keywords:

Particle filter, Ultra-Wideband, Depth camera, Sensor fusion, Position estimation, Object following키워드:

파티클필터, 초광대역, 깊이카메라, 센서융합, 위치추정, 객체추종1. 서 론

대규모 실내 환경에서 특정 객체의 위치를 정밀하게 추정하고 이를 제어하는 기술은 자율 로봇 시스템에서 필수적인 연구 분야 중 하나이다. 특히, 공항과 같은 넓고 인구가 밀집된 실내 환경에서는 사람과 같은 이동 장애물로 인해 로봇의 시야가 제한되고, 객체의 위치를 추정하기 어려워 위치 추정과 객체 추종의 복잡성이 증가한다. 기존 연구에서는 주로 단일 비전 센서를 활용한 객체 추종 방식을 적용하였으나, 이 방식은 다음과 같은 한계를 가진다. 첫째, 로봇과 객체 사이에 다른 사람이 지나가면 센서가 객체를 일시적으로 인식하지 못하여 추종이 중단될 가능성이 크다. 이 때 기존의 추정하던 객체의 위치와 이후 센서의 측정 값이 차이를 가지게 된다. 이는 추종 성능의 불안전성을 초래할 수 있다. 둘째, 유사한 특징을 가진 여러 명의 사람이 존재할 경우 객체 검출 정확도가 저하되며, 잘못된 대상을 추적할 위험이 증가한다.

이러한 문제는 특히 공항과 같이 사람이 많고 이동이 빈번한 환경에서 더욱 두드러진다. 이러한 환경에서 신뢰할 수 있는 위치 추정은 로봇의 객체 추종 시스템 성능과 안정성을 좌우하는 핵심 요소다. 기존의 위치 추정 기술은 주로 단일 센서를 활용한 접근 방식을 따랐다. 예를 들어, GPS 기반 시스템은 야외 환경에서는 효과적이지만, 실내에서는 신호 약화나 차단 문제로 인해 많은 제약이 발생한다.1) 비전 센서(Camera, LiDAR 등) 역시 널리 사용되지만, 가림 현상이나 환경적 요인에 따라 성능이 제한된다. 카메라는 조명 변화와 장애물에 민감하며,2) 3D LiDAR는 고비용 문제와 신호 왜곡의 한계를 가진다. 이러한 이유로 단일 센서 기반 위치 추정은 대규모 실내 환경에서 실시간으로 객체 위치를 정확히 추정하는 데 불안정한 결과를 초래한다.

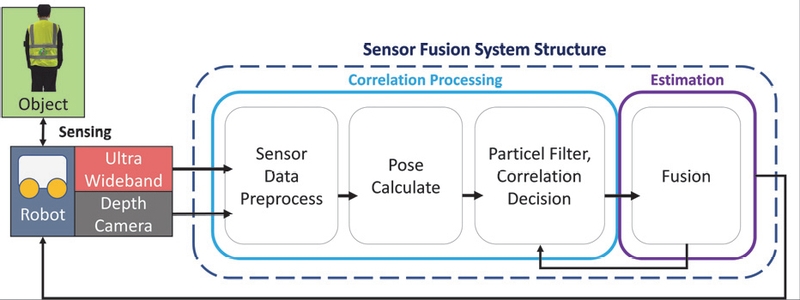

본 연구는 이러한 한계를 극복하기 위해 센서 융합 기술을 활용한 새로운 접근 방식을 제안한다. Ultra-Wideband (UWB) 센서와 Depth camera 데이터를 파티클 필터 기반으로 융합하여 각각의 센서가 가진 강점을 상호 보완적으로 활용한다. UWB 센서는 군중과 장애물에 의해 가려져도 거리 데이터를 안정적으로 제공하며, Depth camera는 객체의 깊이 정보를 포함한 시각적 데이터를 제공한다. 제안된 알고리즘은 각 센서의 오차 특성을 분석하고, 센서 신뢰도를 동적으로 조정하여 더욱 정확한 위치 추정을 실현한다. 특히, 본 연구는 기존 연구와 다음과 같은 차별점을 가진다. 첫째, 단순 데이터 결합을 넘어 카메라 기반 객체 검출 신뢰도를 기반으로 파티클 필터의 가중치를 실시간으로 조정하는 동적 가중치 조정 기법을 도입한다. 기존 센서 융합 기법은 고정된 가중치를 사용하여 환경 변화에 유연하게 대응하지 못했지만, 본 연구는 환경 변화에도 높은 적응성을 유지하도록 설계하였다. 둘째, 파티클 필터를 활용하여 센서 오차를 최소화하고, Convex hull 및 Graham scan 알고리즘으로 센서 데이터 간 상호 연관성을 분석하여 융합 데이터의 신뢰도를 높인다. 셋째, 군중이 많은 공항과 같은 실내 환경에서의 객체 추종에 특화된 시스템을 구현한다. 객체를 1 ~ 4 m 범위 내에서 안전 거리를 유지하며 추종하는 시나리오를 통해 Depth camera와 UWB 센서의 융합 데이터가 안정적으로 작동함을 확인한다.

본 연구의 결과는 다양한 실내 로봇 시스템에 적용할 수 있다. 또한, 기존 단일 센서 기반 방식의 한계를 극복하여 대규모 실내 환경에서도 신뢰할 수 있는 위치 추정과 객체 추종을 실현할 수 있다. 이로써 자율 로봇 시스템의 신뢰성을 크게 향상시키는 데 기여한다.

2. 센서융합을 위한 데이터 전처리

본 연구에서는 UWB 센서와 Depth camera 데이터를 융합하여 객체 위치를 추정하는 시스템을 제안한다. 각 센서의 데이터를 파티클 필터 기반으로 처리하고, 센서 신뢰도에 따라 동적으로 가중치를 조정함으로써 객체 위치 추정의 정확도를 향상시킨다. 본 절에서는 UWB 센서와 Depth camera를 활용한 위치 추정 방법과 이를 융합하기 위한 파티클 필터 및 제어기 설계 과정을 기술한다.3)

2.1 UWB

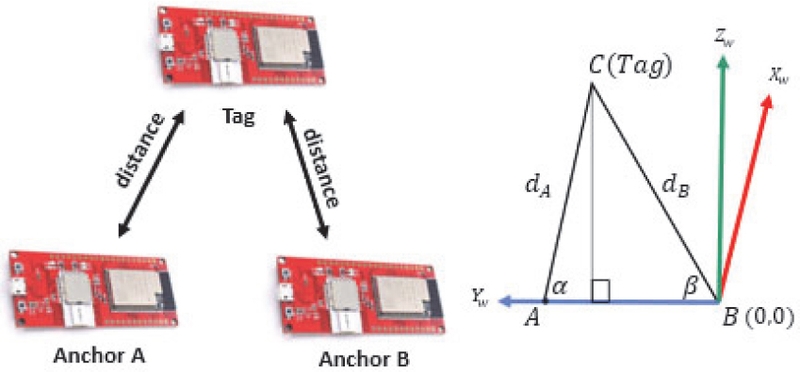

UWB센서는 수 GHz 폭의 넓은 주파수 대역을 사용하여 신호를 고속으로 전송할 수 있는 통신 시스템이다. 소비전력이 낮고, 방해전파에 강하며, 높은 위치 검출 정밀도를 갖는 것이 특징이다.4,5) Fig. 2는 삼각측량법을 위해 구성된 UWB 센서의 배치도이다.

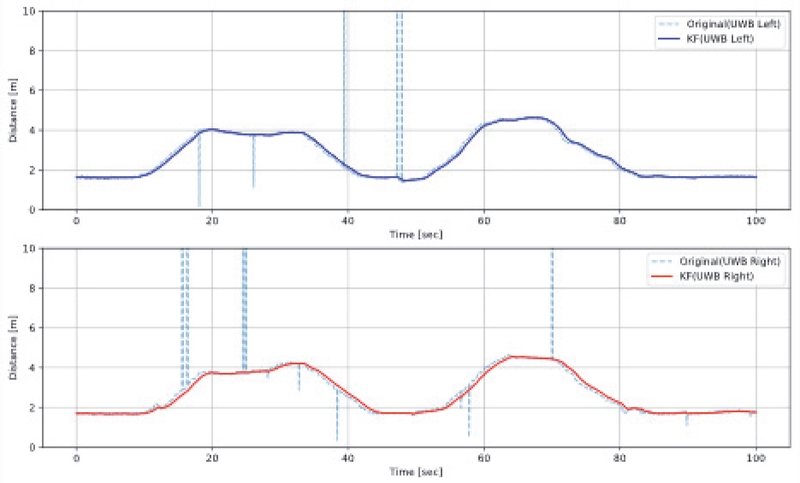

UWB 센서를 이용한 거리 데이터 수신 과정에서, 사람과 같은 이동 장애물로 인해 통신 경로가 차단되면 비정상적인 이상치가 발생할 수 있다. 이를 해결하기 위해, 본 연구에서는 두 단계의 전처리 기법을 적용하였다. 먼저, 객체가 센싱 주기 사이에 이동할 수 있는 최대 거리를 3.0 m로 가정하고, 이전 값과의 차이가 이를 초과하거나 센서의 동작 범위를 벗어나는 데이터를 이상치로 간주한다. 이후, 이상치가 제거된 데이터를 선형 칼만 필터를 통해 처리하여 센서 잡음을 최소화한다.6) Fig. 3은 앞의 전처리 된 데이터의 그래프이다.

위치 추정을 위한 센서 구성은 두 개의 앵커와 하나의 태그로 구성되며, 식 (1)을 이용해 객체 위치 추정을 위한, 점 C(Tag)와 점 B의 사잇각 β를 구할 수 있다.7) 이 때 점 B의 위치는 계산의 편의를 위해 원점으로 설정하였다. 이후 최종식에서 앵커 간 거리를 고려해 위치를 추정하였다.

| (1) |

이를 통해 Ultra-Wideband 센서를 통해 거리 데이터를 제공받아, 이동 장애물에 의해 Camera 센서 가려졌을 때 객체의 위치를 추정할 수 있다. 해당 위치 좌표는 ROS 좌표계와 동일한 좌표계이다.

2.2 Depth Camera

Depth camera는 객체의 3D 좌표 추정에 사용되며, 실시간 Depth 정보를 제공한다. 이러한 Depth camera 기반 위치 추정은 근거리에서 높은 신뢰도를 가지나, 강한 조명 변화나 환경적 요인 그리고 물리적 요인에 따라 데이터의 신뢰도에 많은 영향을 미친다. 본 연구에서는 객체 검출 모델로 계산 비용적인 측면에서 유리한, 경량화 된 모델 YOLOv8n을 사용한다.8)

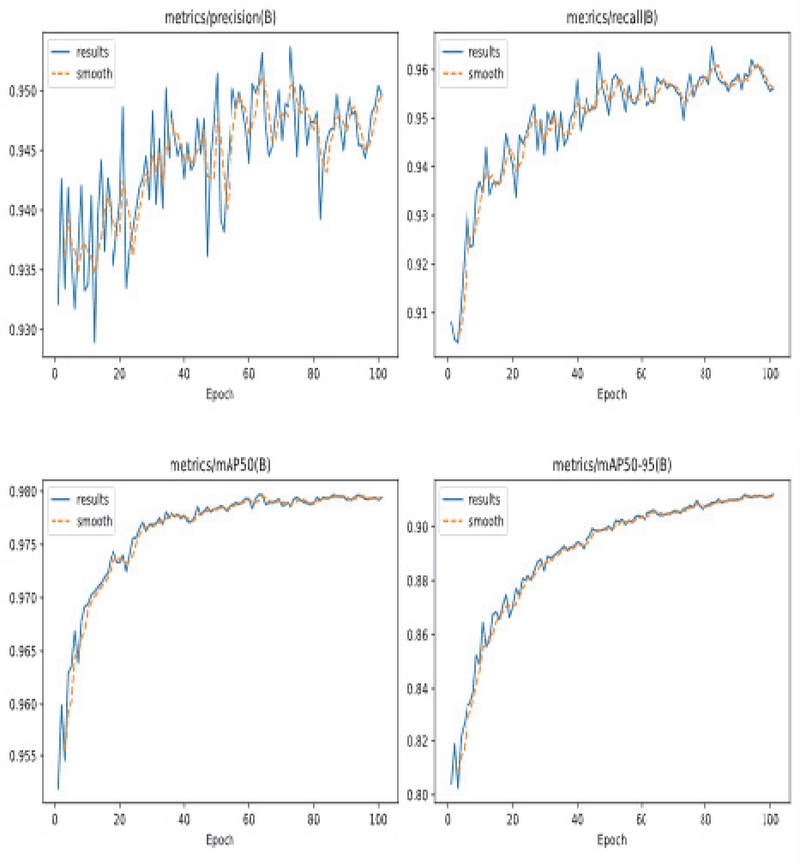

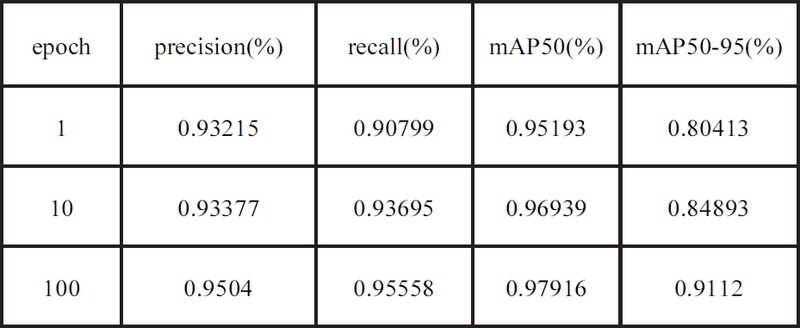

학습에 사용된 데이터셋은 공항에서 수집한 총 8,125장의 이미지로 구성되었으며, 훈련 데이터 7,110장(88 %), 검증 데이터 676장(8 %), 테스트 데이터 339장(4 %)으로 분할하여 사용하였다. 입력 이미지는 실제 환경에서 사용하는 해상도와 동일한 848 × 480으로 조정하였다. 또한, 조도의 변화가 빈번한 환경에서도 모델의 일반화 성능을 높이기 위해 훈련 데이터에 밝기를 ±15 % 범위로 조정하고, 노출을 ±10 % 범위로 변경하는 데이터 증강(Data augmentation) 기법을 적용하였다. 이 과정에서 각 훈련 샘플마다 3개의 변형 데이터를 추가로 생성하여 학습 데이터의 다양성을 확보하였다. Fig. 4는 학습 과정에서 모델의 성능 변화 추이를 나타낸다. 초기 학습 단계에서는 정확도가 상대적으로 낮았으나, 학습이 진행됨에 따라 성능이 점차 개선됨을 확인 할 수 있다.

Epoch 100일 때 모델의 성능은 mAP(mean Average Precision)50 일 때 97.9 %, mAP@50:95일 때 91.1 %, Precision(정밀도) 95.0 %, Recall(재현율) 95.5 %를 기록하였으며, 본 연구에서 학습된 모델은 테스트 데이터셋 뿐만 아니라 실제 환경에서도 객체를 성공적으로 검출하는 성능을 보인다.

본 학습은 NVIDIA GeForce RTX 4060Ti 8GB GPU 제품을 사용한다. 파라미터는 Batch size는 16, epoch는 100, imgsz는 832, lr은 0.01로 설정한다.

학습된 모델을 이용하여 검출된 객체의 Depth 값을 필터링하여, 객체 움직임에 대해 강인한 Depth 추정을 수행하였다. 필터링 기준이 되는 Depth 값은 객체 중심의 픽셀 좌표를 기반으로 추출한다.

이후, 객체의 Bounding box 내에서 Depth 값의 분산을 줄이기 위해 식 (2)를 이용한다. 이 필터링 과정을 통해 객체의 움직임으로 인해 발생하는 Depth값의 급격한 변화를 최소화하여 보다 정확한 객체의 Depth를 확보할 수 있다.

| (2) |

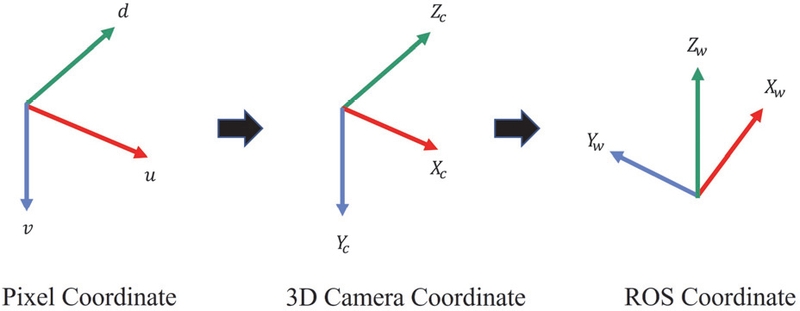

필터링 된 Depth를 얻은 후, UWB 센서와 Depth camera 융합하는 좌표 일치 과정은 다음 Fig. 7과 같다.

Depth camera의 2D 이미지 데이터, Depth 그리고 식 (3)9)을 활용하여 3D Camera 좌표를 계산한다.

| (3) |

여기서 Zc는 필터링을 거친 Depth 값이다. 이후 수식 (4)9,10)의 회전행렬을 이용하여 3D Camera 좌표계의 축을 ROS 좌표계와 동일하게 변환하고, 병진 행렬을 더해 로봇의 실제 Camera 위치를 표현한다.

| (4) |

3. 파티클 필터 기반 센서 융합

본 연구에서는 객체의 비정형적이고 예측하기 어려운 행동 특성을 고려하여, 확률론적 기반의 추정 알고리즘인 파티클 필터를 사용한다.11-14)

3.1 파티클 생성

파티클 생성 단계에서는 각 센서의 오차 특성을 반영하여 파티클의 범위를 설정한다.11) UWB 센서 데이터에서 발생하는 오차는 Depth camera에 비해 상대적으로 크므로, 넓은 범위로 파티클을 생성한다. 반면, Depth camera 센서 데이터에서 발생하는 오차는 UWB 보다 비교적 작은 오차를 가지기 때문에 좁은 범위로 파티클을 생성한다. 이러한 접근은 실제 환경에서 발생할 수 있는 센서 데이터의 불확실성을 효과적으로 반영하여, 더욱 정확하고 강인한 위치 추정을 가능하게 한다.

3.2 파티클 연관성 판단 및 위치 추정

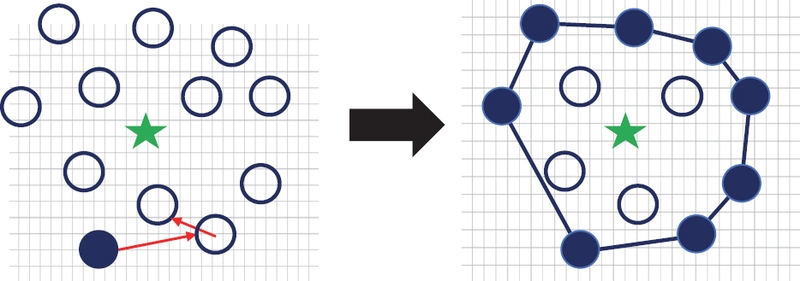

생성된 파티클의 연관성 판단을 위해 Convex hull 기법 중 Graham scan11,15) 알고리즘을 사용한다. Fig. 8의 ☆은 센서데이터이며, ○은 생성된 파티클들, ●은 외각 블록 껍질을 구성하는 파티클이다.

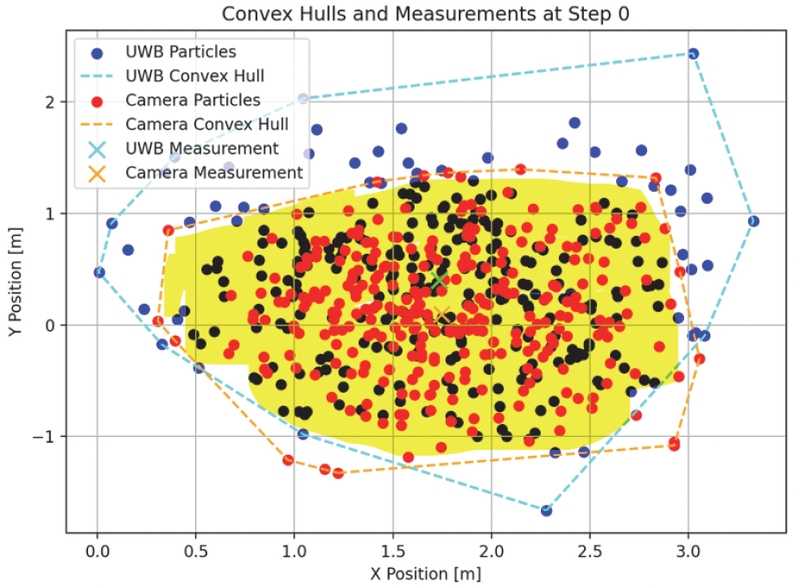

Graham scan은 CCW(Counter Clockwise) 알고리즘을 활용하여 Convex hull을 계산하는 기법 중 하나이다. CCW는 세 점의 벡터 외적을 이용한 방향 판별 원리를 기반으로 한다. 이를 통해 새로운 점이 Convex hull을 유지하는 방향인지 판별할 수 있다. CCW 값이 0보다 클 때는 반시계 방향을 의미하며, 이는 Convex hull을 형성하는 점으로 유지된다. 반대로 0보다 작을 때는 시계 방향으로 꺾인다는 의미이므로, Convex hull의 일부가 될 수 없으므로 스택에서 제거한다. 세 점이 일직선(CCW=0)일 경우, 특정 조건(예: 거리가 먼 점 유지)에 따라 포함 여부를 결정한다. 이 과정을 반복하면 불필요한 점을 제거하면서 Convex hull을 형성할 수 있으며, Fig. 8의 오른쪽 사진과 같이 최종적인 Convex hull을 구할 수 있다. 두 센서의 Convex hull 간 교집합 영역을 추출한다.15) 이후 교집합 영역 내에 포함된 파티클만을 최종 위치 추정에 활용한다. Convex hull 간 교집합 영역이 없는 경우에는 기존에 생성된 파티클로 위치를 추정한다. CCW 알고리즘은 점들의 방향성을 기반으로 효율적으로 Convex hull을 계산하며, 이는 UWB와 Depth camera의 파티클 분포를 비교 분석하는 데 활용한다. Fig. 9에서는 UWB의 파티클집합이 Depth camera의 파티클집합보다 넓은 범위를 갖는 것을 확인이 가능하다.

연관성 판단 과정을 거친 각 센서 데이터의 파티클들은 식 (5)를 이용하여 추적 오차 기반의 가중치를 업데이트하고 정규화를 한다. 이후, 파티클들의 추정치와 정규화 된 가중치를 가중합하여 최종 위치를 추정한다.2)

| (5) |

여기서 x는 관측값이며, μ는 파티클들의 평균값이며, σ는 표준편차이다. M은 교집합 영역에 속하는 파티클들의 개수이다. 딥러닝 모델의 객체 검출 여부와 그 신뢰도를 기반으로 추정된 두 위치의 가중합을 구한다. 객체 검출 모델의 결과가 높은 Confidence 값을 가질 경우, 해당 값을 기반으로 가중치를 결정하여 Depth camera로 추정한 위치 데이터가 최종 위치 추정에 더 큰 기여를 하도록 한다. UWB 센서의 데이터는 객체 검출 모델의 Confidence 값이 낮거나 검출되지 않는 경우 큰 가중치 값을 부여하여 보완적으로 사용된다. 이와 같은 방법은 실제 환경에서 센서의 성능이 변화하거나 신뢰도가 달라질 수 있는 상황을 효과적으로 처리할 수 있다.

| (6) |

여기서 는 객체 검출 모델의 신뢰도 값이다.

3.3 제어기 설계

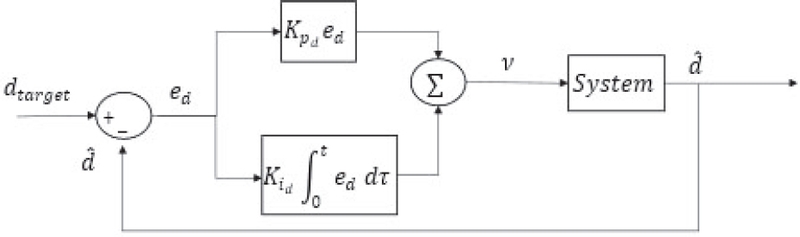

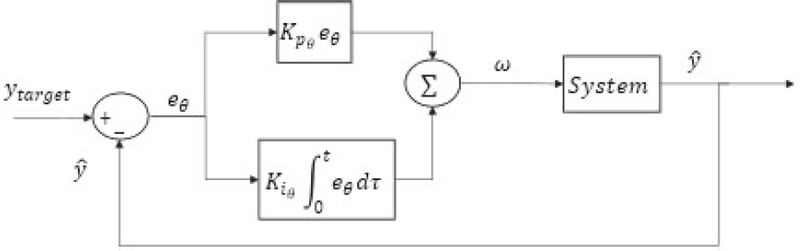

추정된 위치 정보를 바탕으로 로봇이 객체를 안정적으로 추종할 수 있도록 로봇 모터의 속도 제어기를 설계한다. PI 제어기를 사용하여 위치 오차를 줄이고, 로봇이 목표 객체를 부드럽고 정확하게 따라갈 수 있도록 한다. 로봇의 선속도 입력(v)은 식 (7)을 참고하여 설계한다. 다음 Fig. 10은 선속도 제어기의 블록 다이어그램이다.

로봇 모터의 각속도 입력(w)은 로봇이 객체를 따라가게 하기 위해 식 (7)을 참고하여 설계한다. 다음 Fig. 11은 설계된 각속도 제어기의 블록 다이어그램이다.

비례 상수(Kp)과 적분 상수(Ki)을 이용하여 로봇 모터의 갑작스러운 입력이 들어가지 않도록 제어기를 설계하였다. 이 때, Kp는 즉각적인 오차 보정을 담당하고, Ki는 정상상태에서 오차를 줄이는 역할을 한다. 입력 속도 계산은 다음 식 (7)을 참고한다.

| (7) |

여기서 dtarget는 객체 유지 최소 거리 1.0 m 이며, ytarget은 로봇이 객체를 바라보게 하는 y축 좌표 0.0 이다.

4. 실험 환경 및 결과

Depth camera와 UWB를 융합한 파티클 필터 기반 위치 추정 시스템이 군중 밀집 환경에서도 작업자의 위치를 높은 정확도로 추정할 수 있음을 실험적으로 입증하였다. 특히, 단일 센서를 사용할 때 발생할 수 있는 센서가림 문제나 신뢰도 저하와 같은 한계를 효과적으로 극복할 수 있는지 실험을 통해 검증하였다.

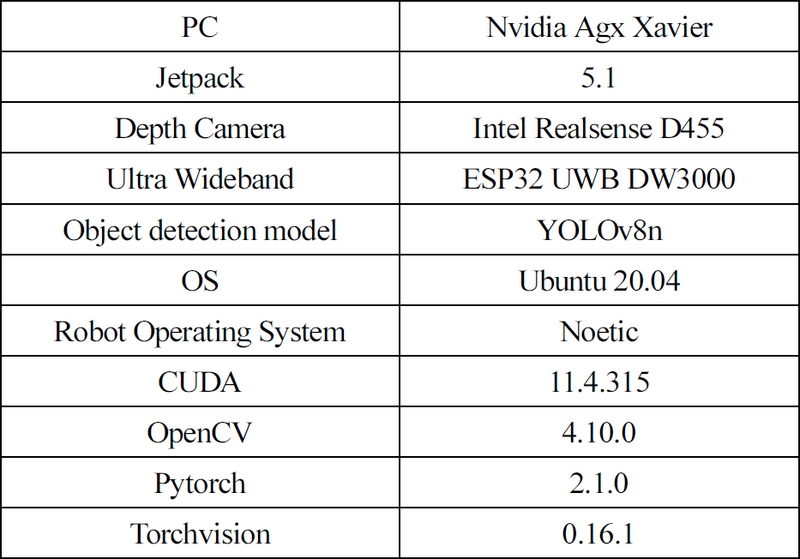

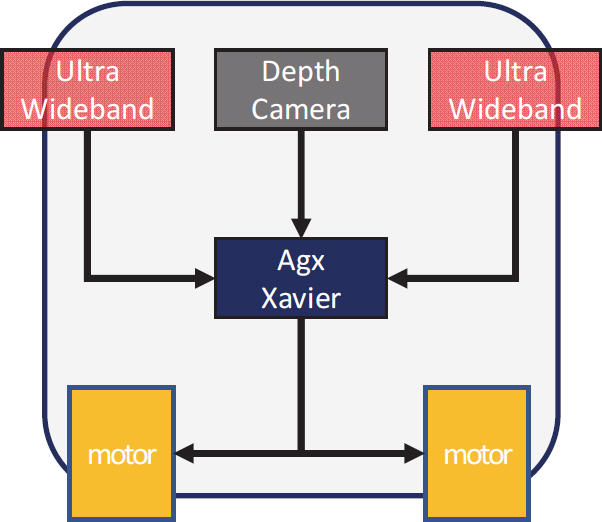

4.1 실험 환경

실험은 인천국제공항에서 진행되었으며, 실험 환경은 다음 Fig. 12와 같다.

센서 배치는 다음 Fig. 13과 같게 하였다.

본 실험은 Depth camera가 객체 데이터를 수신하지 못하는 경우, UWB 센서를 활용하여 지속적으로 객체의 위치를 추정할 수 있는지를 검증한다. 로봇이 객체를 추종하는 과정에서 이동 장애물이 로봇과 객체 사이를 가로지르는 상황을 모사하였다. 로봇은 Depth camera와 UWB 센서를 통해 작업자를 4.0 m 거리 내에서 추종하였으며, 이 거리는 Depth camera의 Depth 정보의 오차가 ±1 %로 보장되는 범위이다. 또한, UWB 센서는 태그와 앵커 간의 신호 차단을 최소화하기 위해 로봇 상단 위치에 설치되었으며, 플랫폼은 Photo. 1의 인천공항 폐기물 이송로봇을 사용하였다.

4.2 실험 결과

Depth camera와 UWB를 융합한 파티클 필터 기반 위치 추정 시스템은 시나리오 상황에서도 안정적으로 작업자의 위치를 추정하였다.

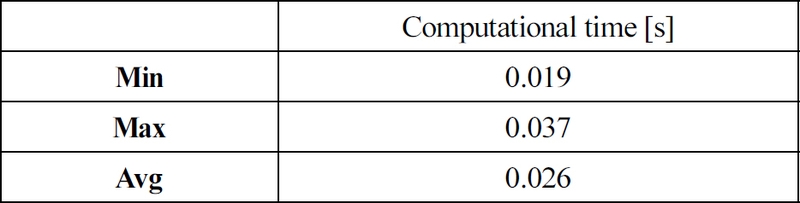

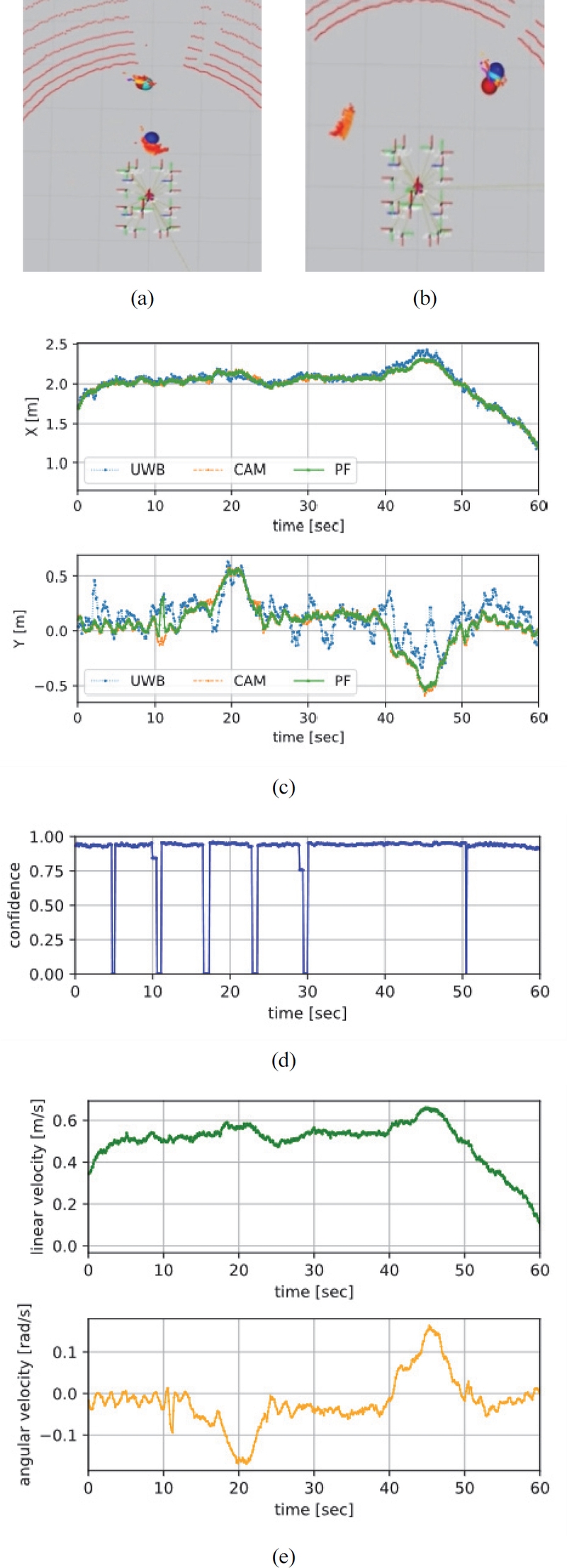

Fig. 14는 본 논문에서 제안하는 파티클 필터 기법의 연산시간이다. 총 파티클 수는 500개, 리샘플링 파티클은 200개로 100초의 시간동안 실험을 진행했을 때 최소 연산시간은 0.019초, 최대 연산시간은 0.037초 평균 연산시간은 0.026초로 이는 해당 알고리즘이 위치 추정 시스템에 적용할 수 있음을 알 수 있다. 실험 결과는 Fig. 15(a), (b)는 Rviz에서 시나리오 도중 이동 장애물이 시야를 가리는 상황이다. Fig. 15(c)는 객체 위치 추정 데이터를 기록해 도식화한 모습이다. 위 그래프는 객체의 지역 x좌표를 추정한 데이터이고, 아래 그래프는 객체의 지역 y좌표를 추정한 데이터이다. 이 때 UWB와 CAM는 칼만 필터로 추정한 데이터이며 PF는 본 논문에서 제안하는 위치 추정 기법이 적용된 데이터이다. UWB 단일 센서의 경우 지역 x좌표 추정은 Depth camera와 같이 좋은 성능을 보였으나, 지역 y좌표 추정에서는 다소 데이터가 흔들리는 모습을 보인다. 이는 삼각측량법을 이용해 추정한 객체의 위치가 태그와 앵커가 이루는 사잇각을 기반으로 추정하기 때문에, 객체의 작은 횡방향 움직임이나 객체의 떨림 등에 의해 센서 측정데이터에 노이즈가 생겨 삼각측량법으로 계산한 사잇각이 큰 변화를 가지게 되기 때문이다. 이는 파티클 필터 연관성 판단 과정을 통해 칼만필터보다 효과적으로 노이즈를 감소시킨 것을 확인할 수 있다. 이는 센서의 오차 특성을 고려한 파티클 생성과, 연관성 판단 과정을 거치는 것이 효과가 있음을 나타낸다. Fig. 15(d)는 객체 검출 모델의 Confidence 값이다. 12, 18, 22, 30, 50초에서 Confidence의 값이 0.0으로 출력되는 것을 볼 수 있는데 이는 카메라를 가리기 위해 시나리오 대로 카메라 전방에서 객체 검출이 불가능하게 한 상황이다. 최종 객체 위치 추정의 가중치가 동적으로 적용되어, Depth camera보다 신뢰도가 높은 UWB의 데이터를 통해 객체의 위치를 추정하는 것을 볼 수 있다. Fig. 15(e)는 객체 위치 정보와 제어기를 통해 생성된 속도 값 그래프이며 UWB의 데이터가 높은 가중치 일 때 각속도의 변화가 높아지는 것을 볼 수 있다.

5. 결 론

본 연구에서는 UWB 센서 기반 삼각측량법과 Depth camera를 활용하여 객체의 위치 정보를 추정하는 강인한 시스템을 제안하였다. 각 센서의 오차 특성을 반영하여 파티클 필터를 설계하고, Convex hull 및 Graham scan 알고리즘을 활용한 파티클 연관성 판단 과정을 통해 센서 데이터를 융합하였다. 이를 통해 Depth camera의 데이터가 장애물로 인한 시야 가림으로 인해 신뢰도가 저하되어 정확도가 낮아지는 상황에서도 안정적으로 객체의 위치를 추정할 수 있었다. 또한, 다양한 환경적 요인으로 인한 센서 데이터의 변동성을 효과적으로 처리하여, 복잡한 실내 환경에서도 높은 정확성을 유지하였다. 센서 융합을 통해 추정된 위치 정보는 로봇의 제어에 활용되었으며, 이를 바탕으로 로봇이 객체를 효과적으로 추종할 수 있는 시스템을 구현하였다. 실험을 통해 단일 센서 사용 시 발생할 수 있는 센서 가림이나 신뢰도 저하 문제를 해결하였다. 또한, Convex hull과 Graham scan 알고리즘을 활용하여 파티클 간 연관성을 효과적으로 판단하고, 융합 데이터의 신뢰도를 높임으로써 제안된 시스템이 대규모 실내 환경에서도 안정적으로 동작할 수 있음을 검증하였다.

본 시스템은 실시간으로 센서 데이터를 융합하여 객체의 이동을 지속적으로 추적하며, 사람과 같은 이동 장애물에 인해 예기치 않은 상황이 발생하더라도 위치 추정 및 제어 성능을 유지할 수 있었다. 이를 통해 자율 로봇이 복잡한 환경에서 작업자의 움직임을 따라가거나 특정 객체를 추종하는 실용적인 응용 가능성을 확인할 수 있었다. 향후 연구에서는 센서 데이터의 시간적 비동기성을 해결하기 위해 다중 주기 칼만 필터를 설계하고, 단순 PI 제어기에서 발전된 경로 예측 기반의 제어기를 개발하고자 한다. 이러한 제어기는 객체의 이동 궤적을 예측하여 보다 매끄럽고 정교한 추종을 가능하게 하며, 복잡한 환경에서의 장애물 회피 및 효율적인 경로 설정에 기여할 수 있을 것으로 기대된다. 또한, 다양한 센서 조합과 새로운 데이터 융합 기법을 도입하여 더욱 높은 신뢰성과 적응성을 가진 객체 추종 시스템을 구현하고자 한다.

Nomenclature

| d : | distance, m |

| D : | depth, m |

| ed : | distance error, m |

| eθ : | angular error, rad |

| v : | linear velocity, m/s |

| w : | angular velocity, rad/s |

| W : | particle weights |

Acknowledgments

A part of this paper was presented at the KSAE 2024 Fall Conference and Exhibition

이 논문은 인천대학교 2024년도 자체연구비 지원에 의하여 연구되었음.

References

-

Y. H. Park, M. G. Kang, J. H. Jeong and S. G. Choi, “The Data Alignment Method Between GPS and IMU Based on ICP for Indoor Positioning,” Proceedings of the International Conference on Advanced Communications Technology(ICACT), pp.369–372, 2024.

[https://doi.org/10.23919/ICACT60172.2024.10471932]

-

H. S. Cho, Y. J. Park, M. G. Park and J. W. Son, “Study on Designing Scenarios to Evaluate Adverse Condition Positioning for Highly Reliable Autonomous Driving,” Transactions of KSAE, Vol.31, No.12, pp.1021–1037, 2023.

[https://doi.org/10.7467/KSAE.2023.31.12.1021]

- T. H. Kim, Y. J. An and C. M. Kang, “Particle Filter-Based Object Localization Using UWB Sensors and Depth Camera,” KSAE Fall Conference Proceedings, pp.947–948, 2024.

-

J. Zhang, P. V. Orlik, Z. Sahinoglu, A. F. Molisch and P. Kinney, “UWB Systems for Wireless Sensor Networks,” Proceedings of the IEEE, Vol.97, No.2, pp.313–328, 2009.

[https://doi.org/10.1109/JPROC.2008.2008786]

- D. O. Yoo, J . Y. Kim, S. J. Ahn, C. S. Park, S. P. Nah, G. M. Kim and Y. S. Chung, “A Study on the Calibration Technique of UWB Sensors,” Proceedings of the KICS Summer Conference, pp.288–289, 2024.

- G. Welch and G. Bishop, “An Introduction to the Kalman Filter,” Department of Computer Science, University of North Carolina at Chapel Hill, 1997.

- H. S. Lee, Y. K. Kim, Y. J. An and C. M. Kang, “Ultra-Wideband Based Object Tracking Algorithm for Autonomous Driving Mobility,” Proceedings of the KIEE Conference, pp.54–55, 2024.

- J. H. Kim, Driving Control Algorithm Based on Sensor Fusion and Deep Learning for Autonomous Driving, Ph.D. Dissertation, Hanyang University, Seoul, 2021.

- K. J. Rhee and Y. G. Lee, “Prediction of Camera Intrinsic Parameter Using Go Board Image,” Proceedings of the KBS Media Engineering Summer Conference, pp.237–240, 2017.

-

J. H. Ko, “Robot Vision System Based on 3D Depth Map and Object Recognition,” Journal of The Institute of Electronics and Information Engineers, Vol.57, No.3, pp.101–105, 2020.

[https://doi.org/10.5573/ieie.2020.57.3.101]

-

G. I. Lee, C. M. Kang, S. H. Lee and C. C. Chung, “Sensor Fusion Based on the Particle Filter and Multi-Rate Kalman Filter,” Journal of Institute of Control, Robotics and Systems, Vol.23, No.11, pp.969–980, 2017.

[https://doi.org/10.5302/J.ICROS.2017.17.0124]

- S. H. Kim and K. G. Oh, “An Investigation of Particle Filtering Performance for Camera-Based Path Tracking With Variation of Illumination,” KSAE Annual Conference Proceedings, pp.1674–1675, 2023.

-

J. R. Hwang, Research on Localization for Autonomous Vehicles Based on Particle Filter Using Road Feature Map and 3D LiDAR Sensor, M.S. Thesis, Kookmin University, Seoul, 2019.

[https://doi.org/10.5302/J.ICROS.2019.19.0015]

-

P. M. Djuric, J. H. Kotecha, J. Zhang, Y. Huang, T. Ghirmai, M. F. Bugallo and J. Míguez, “Particle Filtering,” IEEE Signal Processing Magazine, Vol.20, No.5, pp.19–38, 2003.

[https://doi.org/10.1109/MSP.2003.1236770]

-

R. L. Graham, “An Efficient Algorithm for Determining the Convex Hull of a Finite Planar Set,” Information Processing Letters, Vol.1, No.4, pp.132–133, 1972.

[https://doi.org/10.1016/0020-0190(72)90045-2]