드론과 Pix4D를 활용한 교통사고 현장 3차원 재구성

Copyright Ⓒ 2019 KSAE / 168-05

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium provided the original work is properly cited.

Abstract

The traffic accident analysis faced a major paradigm shift as the drone technology evolved. The drone flies automatically by setting its GPS-based flight trajectory. It can also be used for specific purposes by giving it a mission. The traffic road can be reconstructed in three dimension by combining the mapping technology and automatic flight of the drone. In order to verify the accuracy of the 3D traffic road model via drone, we performed a 3D reconstruction on the same traffic road by using a drone and a high-precision 3D laser scanner. Based on the comparison results of the distance and the gradient, the 3D traffic road model via drone demonstrates sufficient accuracy. We also verified that the drone-based 3D model can be applied to a PC-Crash simulation, which is a traffic accident analysis program.

Keywords:

Drone, Drone mapping software, Reconstruction of traffic accident, Orthomosaic, Point cloud data, Aerial photograph키워드:

드론, 드론 매핑 소프트웨어, 교통사고재구성, 정사모자이크, 포인트 클라우드 데이터, 항공사진1. 서 론

최근 드론 산업의 발전으로 드론을 활용하는 분야가 다양해지고 있다. 드론은 초창기에 주로 군용으로 개발되었으나, 현재는 농업, 해양, 소방, 토목 및 측량 등 다양한 분야에 폭 넓게 활용되고 있으며, 더 나아가 교통사고 분석 분야에서도 중요한 역할을 하고 있다.1-5)

차대차, 차대보행자 충돌사고, 차량단독 사고 등의 다양한 교통사고에 대해 사고 원인을 밝혀내기 위해서는 현장조사를 통해 사고 도로의 형태 및 구조, 사고차량의 충돌 지점 및 최종 위치, 주변 구조물 등을 파악하여야 하며, 특히 주요 흔적 지점에 대한 면밀한 검사와 정확한 거리 측정은 매우 중요하다.

반면에 차량 통행이 많은 자동차 전용도로나 고속도로에서 발생한 교통사고에 대해 현장 조사를 할 경우, 차량 운행 통제에 따른 극심한 도로 정체를 유발할 수 있을 뿐만 아니라, 덤프트럭과 같은 대형차량, 고속 주행 차량 등은 현장 조사자들에게 큰 위험이 될 수 있다. 예를 들면, 현장 조사 시 도로의 폭과 구배, 중요 지점 간의 거리를 측정하는 데 있어서 시간적인 여유가 충분하지 못한 상황에서 줄자, 워킹카운터 및 구배측정기 등을 이용하여 또 다른 사고의 위험을 감수하면서 측정한 값을 기록해야한다.

기존에 이러한 교통사고 현장 조사에서의 어려운 환경 속에서 드론의 최신 기술은 교통사고 분석 분야에 큰 변화를 가져오고 있다. 최근에 상용화된 드론 모델의 경우, 4 K(4096×2160) 이상의 높은 해상도를 지닌 카메라를 장착하고 있어 교통사고 현장에 대한 항공 사진 촬영 시 도로 위에 남겨진 타이어 흔적, 노면 표시 등과 같은 사고 관련 흔적들에 대해 면밀히 분석할 수 있게 되었다. 또한 드론을 이용하여 단순히 항공사진 또는 영상을 촬영하는 데에 그치지 않고, 자동비행(Automatic flight) 기능을 이용하여 위성지도 상에서 GPS 기반의 비행 궤적과 고도를 설정하고, 사용자가 원하는 임무를 부여함으로써 기존 보다 더 전문적인 용도로 활용할 수 있게 되었다.6,7)

이와 같은 드론의 최신 기술을 교통사고 분석 분야에 활용하기 위한 연구는 국외에서 활발하게 진행되고 있다. Bullock 등8)은 교통사고 현장에 대해 드론 항공사진 매핑 기술을 적용하였으며, 현장에서 실측된 값과 매핑된 항공사진에서의 측정값을 비교, 분석함으로써 활용성을 평가하였다. Carter 등9)은 다양한 종류의 소형 드론과 Pix4D를 활용하여 드론의 비행 고도, 비행 패턴 그리고 카메라 특성이 3차원 모델링 품질에 미치는 영향성을 평가하였다. 또한 Cappelletti 등10)은 드론과 3차원 레이저 스캐너를 함께 활용하여 건물 내 터널 안에서 발생한 교통사고에 대해 3차원으로 재구성하는 기법을 제안하였다. 반면 국내의 교통사고 분석 분야에서는 드론의 최신 기술을 활용하기 위한 연구가 많이 부족한 상황이다.

본 연구에서는 드론의 최신 기술인 자동비행 기능과 드론 매핑 소프트웨어인 Pix4D를 활용하여 도로를 3차원으로 재구성하였으며, 고정밀 3차원 레이저 스캐너를 이용하여 스캔한 데이터와 비교함으로써 드론 3차원 모델링에 대한 정확성을 검증하고자 하였다. 또한 교통사고 재현 시뮬레이션 프로그램인 PC-Crash에 드론 3차원 모델링을 적용함으로써 그에 대한 활용 가능성을 검토해보고자 한다.

2. 드론 매핑 소프트웨어

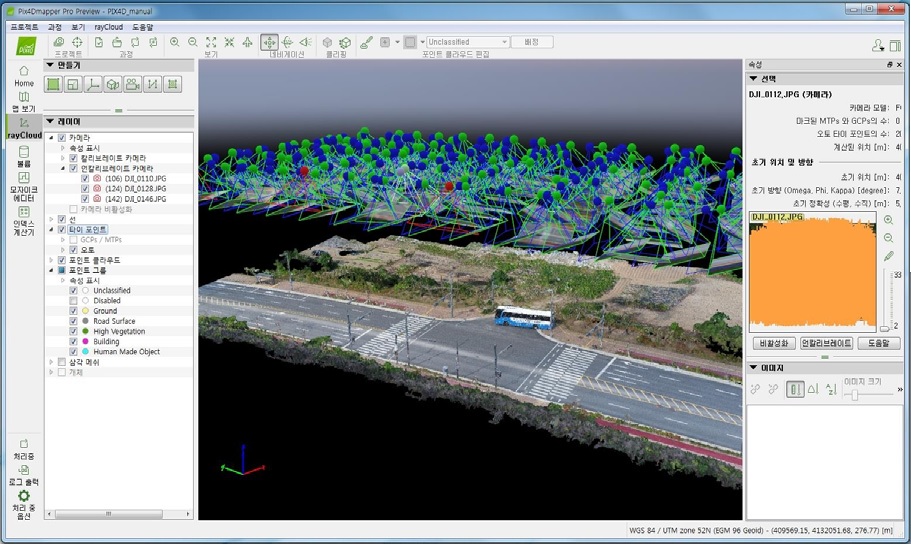

2.1 Pix4D mapper

Fig. 1의 Pix4D mapper는 항공사진 측량 기법을 토대로 스위스 국적의 PIX4D사에서 개발한 드론 매핑 소프트웨어(Drone mapping software)로 DJI사의 드론과 높은 호환성을 지니며, 매핑 프로세스를 자동화하는 모바일 어플리케이션(Pix4D Capture)을 지원하고 있다.11) Pix4D 외에 유사한 용도로 사용할 수 있는 드론 매핑 소프트웨어로는 미국 샌프란시스코의 DroneDeploy와 Skycatch, MIT 엔지니어가 개발한 Raptor Maps, 미국 노스캐롤라이나의 Precision Hawk, 광산 및 건설과 같은 산업 분야에 주로 초점을 둔 3D Robotics, 러시아의 Agisoft 등이 있다.

2.2 구동 원리

드론으로 촬영된 항공사진에는 사진 이미지 정보와 더불어 드론의 카메라 정보와 WGS84 기준 경위도, 고도, IMU(Inertial Measurement Unit)데이터 등이 함께 기록된다. 여기서 IMU란, 드론의 속도, 이동방향, 중력, 가속도를 측정하는 장치로 자이로스코프(Gyroscope), 가속도계(Accelerometer), 지자계 센서(Geomagnetic sensor)로 구성된다.12) 이러한 사진 이미지 정보와 드론에 대한 위치 및 자세 정보를 바탕으로 이미지들 간의 특징점을 추출하는 SIFT(Scale Invariant Feature Transform) 알고리즘과 동일한 사물 또는 장면에 대해 서로 다른 지점에서 촬영한 영상의 특징점들 간의 기하학적 관계인 Epipolar Geometry가 적용된 SFM(Structure From Motion) 알고리즘을 통해 3차원의 포인트 클라우드 데이터(Point cloud data)를 얻을 수 있다.13)

3. 드론을 이용한 도로 현장 3차원 모델링

3.1 드론 모델

본 연구에서 사용된 드론은 Fig. 2에 나타낸 바와 같이 DJI사의 Inspire1으로 총 4개의 회전 날개를 지닌 쿼드로터(Quadrotor)기체이며, 주요 제원을 Table 1에 정리하여 나타내었다. 배터리를 포함한 전체 중량은 약 2.9 kg로 최대 비행 속도 22 m/s, 비행 가능 고도 120 m, 최대 비행 가능 시간 18분의 고성능 드론이며, 기체의 짐벌(Gimbar)에 장착된 카메라의 해상도는 4 K의 높은 해상도를 지니고 있다.

3.2 도로 현장에 대한 항공사진 촬영

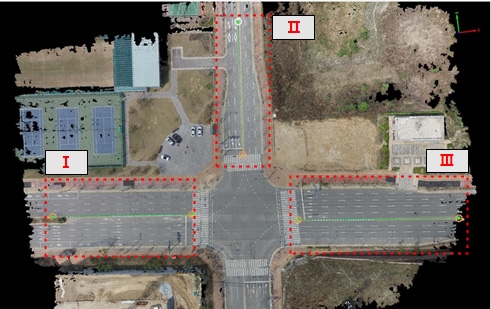

드론 비행을 수행한 도로 현장은 국립과학수사연구원이 위치한 강원도 원주 혁신도시 내에 있는 왕복 8차로의 교차로이다. Fig. 3과 같이 Pix4D Capture를 이용하여 GPS 기반의 이중격자(Double grid) 비행궤적(면적 10,064 m2)에 대하여 비행 고도 45 m, 카메라 각도 70°, 종중복도 80 %, 횡중복도 70 %로 설정한 후 드론에 비행 및 촬영 임무를 부여하였으며, Fig. 4와 같이 총 96장의 항공사진을 13분 26초간의 비행을 통해 촬영하였다.

3.3 정사모자이크

정사모자이크(Orthomosaic) 이미지는 항공사진을 기하학적으로 보정하여 사진의 스케일이 일정하고 위성지도와 같이 왜곡이 없으며, 지형기복(Topographic), 렌즈 왜곡(Lens distortion), 카메라 틸트(Camera tilt)에 대하여 보정이 된 이미지이므로 보정되지 않은 항공사진과는 다르게 이미지 상에서 실제 거리를 측정하는데 사용할 수 있다.14) Pix4D를 통해 얻은 도로 현장에 대한 정사모자이크 이미지는 Fig. 5와 같다.

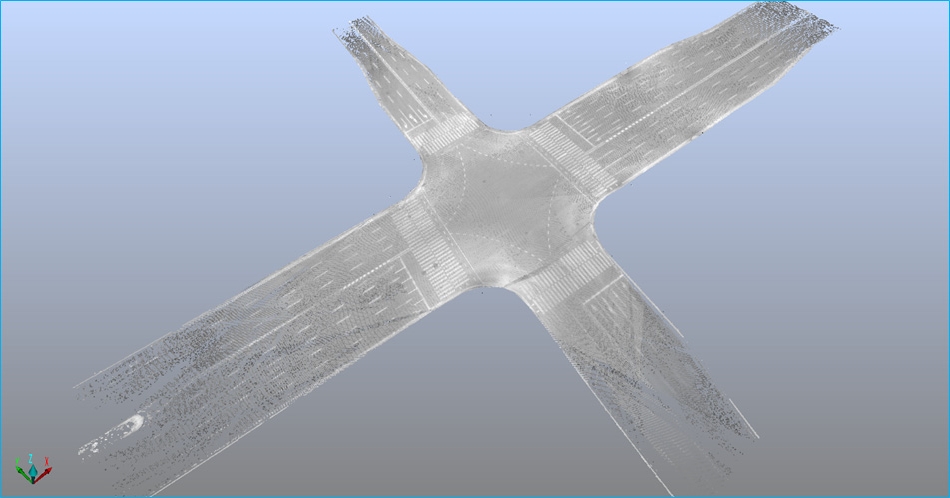

3.4 포인트 클라우드 데이터

포인트 클라우드 데이터(Point cloud data)는 수많은 3차원 포인트로 이루어져 있으며, 각각의 포인트 마다 위치 정보(x,y,z)와 색상 정보(RGB)가 함께 저장되어 있다. 따라서 포인트 클라우드 데이터 상에서 포인트 간의 거리, 표면 면적, 체적을 계산하는데 있어 매우 높은 정확성을 지니고 있다.15)

Pix4D를 통해 얻은 도로 현장에 대한 포인트 클라우드 데이터는 Fig. 6과 같으며, 이러한 포인트 클라우드 데이터를 도로 현장에 대한 드론 3차원 모델링 결과로 볼 수 있다. 이와 같은 드론 3차원 모델링을 통해서 실제 도로를 컴퓨터 모니터 안에서 분석하고, 주요 지점 간의 거리를 계측할 수 있다.

4. 측정 데이터 신뢰성 검증

드론에 의해 얻어진 도로 현장의 3차원 모델링에 대하여 실제 도로와의 비교 분석함으로써 3차원 모델링 상에서 거리 및 구배를 측정하였을 때의 신뢰성을 검증하고자 한다.

4.1 3차원 레이저 스캔

검증 장비로는 Fig. 7에 나타낸 바와 같이 고정밀 광대역 3차원 레이저 스캐너 장비인 FARO330을 이용하여 정밀 스캔을 수행하였으며, 본 장비를 통해 스캔한 결과물의 거리 정밀도는 최대 ± 2 mm로 매우 정확하다.

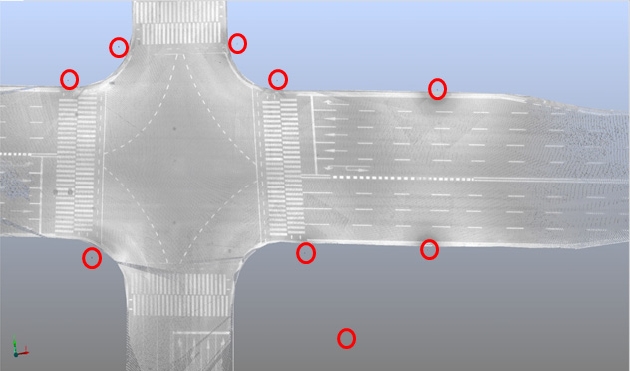

Fig. 8과 같이, 도로 현장에서 총 8개 지점에서 레이저 스캐너를 설치하여 정밀 스캔을 수행하였다.

1개 지점 당 레이저 스캔하는 데 소요된 시간은 11분 13초로 다른 지점으로의 스캐너 장비의 이동 및 설치 시간을 제외하고, 도로 현장을 스캔하는데만 소요된 시간은 총 89분 44초이다. 같은 도로 현장에 대해 드론으로 항공사진을 촬영하는데 소요된 비행 시간인 13분 26초와 비교 시 현장에서 드론을 운용하는 것이 레이저 스캐너를 활용하는 것 보다 시간적인 부분에서 매우 효율적임을 알 수 있다.

3차원 레이저 스캐너를 통해 얻은 결과물은 Fig. 9에 나타내었다.

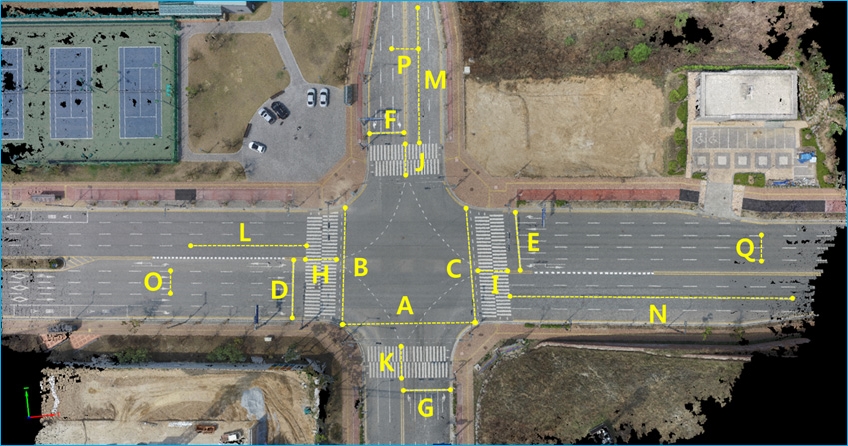

4.2 드론 3차원 모델링의 신뢰성 검증

드론 3차원 모델링에서 측정한 거리에 대해서 정확성을 검증하기 위해 3차원 레이저 스캔 결과와 함께 비교 분석을 수행하였다. Fig. 10에 나타낸 바와 같이, 도로 상에 표시된 횡단보도, 차로 구분 점선, 차로 폭 등에 대해 총 17개의 거리 측정 구간을 설정하였으며, 측정된 결과를 Table 2와 3에 나누어 정리하여 나타내었다. 측정 결과에서 알 수 있듯이 3차원 레이저 스캔 결과와 비교 시 최대 오차율이 0.74 %로 드론 3차원 모델링이 교통사고 분석 분야에서 활용하기에 충분한 신뢰성을 지니고 있음을 알 수 있다.

또한, 드론 3차원 모델링에서 측정한 구배에 대해서 정확성을 검증하기 위해 3차원 레이저 스캔 결과와 함께 비교 분석을 수행하였으며, Fig. 11에 나타낸 바와 같이 총 3개의 구배 측정 구간을 설정하였고, 측정된 결과를 Table 4에 나타내었다.

Pix4D mapper 상에서 거리 계측 시 지형 3D 길이와 투영된 2D 길이로 두 가지의 측정 결과를 얻을 수 있으며, 도로의 구배는 아래 식 (1)로부터 계산할 수 있다.

| (1) |

where, D2d : projected 2D distance (m)

D3d : real 3D distance (m)

각각의 구배 측정 구간에 대하여 식 (1)로부터 계산된 결과는 Table 4에 나타낸 바와 같으며, 측정 결과로부터 알 수 있듯이 3차원 레이저 스캔 결과와 비교 시 최대 오차율이 3.5 %로 확인됨에 따라 거리뿐만 아니라 구배 측정 시에도 드론 3차원 모델링이 교통사고 분석 분야에 활용하기에 충분한 신뢰성을 지니고 있음을 알 수 있다.

5. 교통사고 재현 활용성

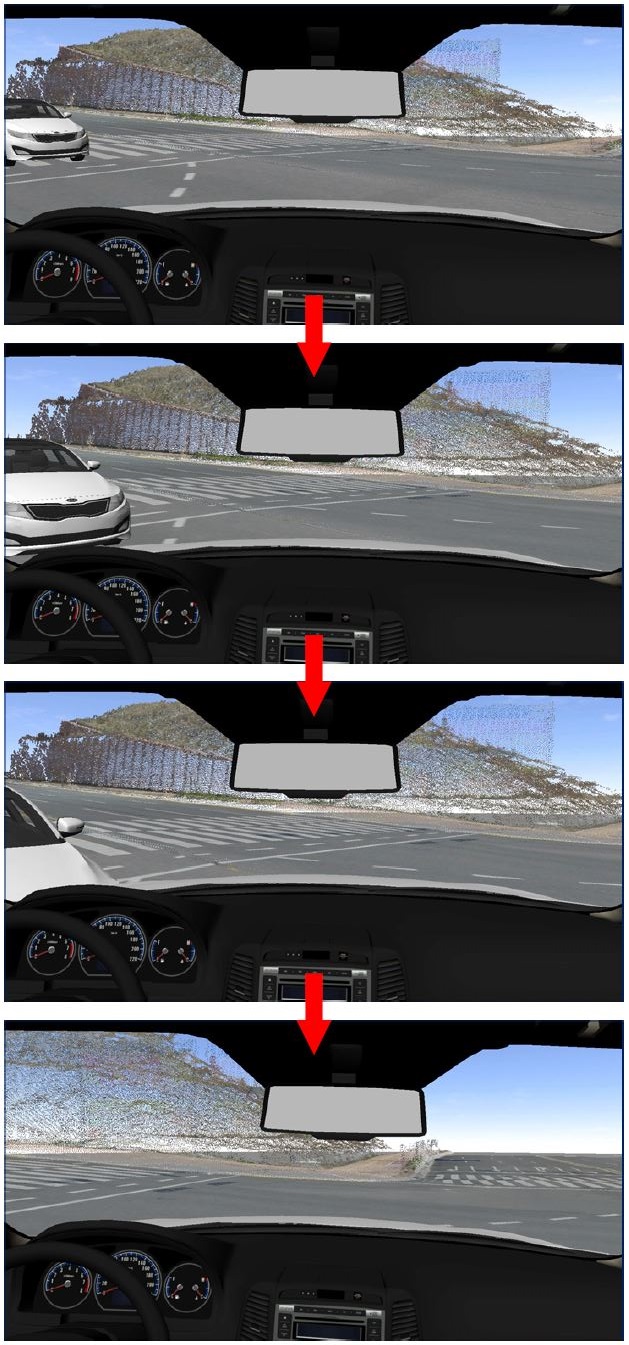

본 절에서는 드론 3차원 모델링을 교통사고 재현 시뮬레이션 프로그램인 PC-Crash에 적용함으로써 교통사고 재현 시뮬레이션에서의 활용 가능성을 확인하고자 하였다.

본 연구에서 사용된 PC-Crash는 상용화되어 있는 교통사고 해석 및 재구성 프로그램으로 오스트리아 Graz 대학의 Dr. Hermann Steffan에 의해 개발되었으며, 뉴턴 역학(운동량보존법칙 및 에너지보존법칙)을 기반으로 사고에 대한 역학적 해석 및 3차원의 사고 재구성이 가능한 프로그램이다.16-18)

Fig. 12에 나타낸 바와 같이 PC-Crash에 드론 3차원 모델링과 정사모자이크 이미지를 적용하여 도로 현장을 구성하였으며, 교차로 상에서 좌회전하는 차량이 전방 좌측에서 신호 위반하여 직진 중이던 차량과 충돌하는 상황을 재현하였다. 시뮬레이션 결과, 정상적으로 차량의 주행 및 충돌 해석이 가능하였고, 도로 주변의 지형 및 구조물에 대한 모습도 구현되어 있어 단순히 항공사진 또는 위성사진을 이용하여 사고를 재구성하던 기존의 방법 보다 좀 더 현실적인 사고 재구성이 가능함을 알 수 있다.

6. 결 론

본 연구에서는 드론 매핑 소프트웨어인 Pix4D를 통해 교통사고 현장 재구성 기법의 신뢰성과 활용성을 검증하고자 하였다.

동일한 도로 현장에 대하여 드론에 의한 3차원 모델링과 고정밀 3차원 레이저 스캐너를 이용하여 스캔한 데이터를 비교, 분석함으로써 드론 3차원 모델링의 신뢰성을 평가하였으며, 또한 교통사고 분석 프로그램인 PC-Crash에 적용함으로써 활용성을 검증하였다.

- 1) 도로 현장에 대해 총 17개의 거리 측정 구간을 설정하여 드론 3차원 모델링 데이터의 오차율을 분석한 결과, 거리 측정 시 최대 오차율은 0.74 %를 나타내었으며, 교통사고 분석에서 충분히 수용할만한 오차 범위를 지니는 것을 알 수 있다.

- 2) 도로 현장에 대해 총 3개의 구배 측정 구간을 설정하여 드론 3차원 모델링 데이터의 오차율을 분석한 결과, 구배 측정 시 최대 오차율은 3.5 %를 나타내었다. 거리 측정 오차율과 비교 시 상대적으로 높으나, 도로의 경사도가 심하지 않은 경우에 대해 이 또한 교통사고 분석에서 충분히 수용할 수 있을 것으로 사료된다.

- 3) PC-Crash에 드론 3차원 모델링을 적용한 결과, 실제 도로와 매우 유사한 도로 환경에서 차량 주행 및 충돌 해석이 가능하며, 주변 도로 구조물에 대한 영향성이 고려된 사고 재구성이 가능하다.

이러한 일련의 과정을 통하여 기존에 교통사고 현장에서 감수해야 했던 어려움들이 드론의 최신 기술을 활용함으로써 상당 부분 해소될 것으로 사료되며, 향후 경사도가 심한 도로, 곡선 구간의 도로 등 다양한 도로 환경에 대해서도 신뢰성을 평가하고, 드론 3차원 모델링을 적용한 사고 재구성에 대해 차량 주행 실험을 통해서 추가적인 검증을 계속적으로 수행해 나갈 계획이다.

Acknowledgments

이 논문은 행정안전부 주관 국립과학수사연구원 과학수사감정기법연구개발사업의 지원을 받아 수행한 연구임(NFS2019TAA01).

References

-

V. Puri, A. Nayyar and L. Raja, “Agriculture Drones: A Modern Breakthrough in Precision Agriculture,” Journal of Statistics and Management Systems, Vol.20, No.4, pp.507-518, 2017.

[https://doi.org/10.1080/09720510.2017.1395171]

-

J. Park, S. Choi and M. Park, “A Study on Green Algae Monitoring in Watershed Using Fixed Wing UAV,” Journal of Korean Institute of Intelligent Systems, Vol.27, No.2, pp.164-169, 2017.

[https://doi.org/10.5391/JKIIS.2017.27.2.164]

-

A. Barreiro, J. M. Dominguez, A. J. C. Crespo, H. Gonzalez-Jorge, D. Roca and M. Gomez-Gesteira, “Integration of UAV Photogrammetry and SPH Modelling of Fluids to Study Runoff on Real Terrains,” PLOS ONE, Vol.9, No.11, 2014.

[https://doi.org/10.1371/journal.pone.0111031]

- T. Kim, “Geospatial Information Construction of Building Using Drone,” Review of Architecture and Building Science, Vol.62, No.11, pp.39-42, 2018.

-

S. P. Bemis, S. Micklethwaite, D. Turner, M. R. James, S. Akciz, S. T. Thiele and H. A. Bangash, “Ground-based and UAV-Based Photogrammetry: A Multi-scale, High-resolution Mapping Tool for Structural Geology and Paleoseismology,” Journal of Structural Geology, Vol.69, pp.163-178, 2014.

[https://doi.org/10.1016/j.jsg.2014.10.007]

-

K. S. Yakovlev, D. A. Makarov and E. S. Baskin, “Automatic Path Planning for an Unmanned Drone with Constrained Flight Dynamics,” Scientific and Technical Information Processing, Vol.42, No.5, pp.347-358, 2015.

[https://doi.org/10.3103/S0147688215050093]

-

D. Mellinger, N. Michael and V. Kumar, “Trajectory Generation and Control for Precise Aggressive Maneuvers with Quadrotors,” The International Journal of Robotics Research, Vol.31, No.5, pp. 664-674, 2012.

[https://doi.org/10.1177/0278364911434236]

-

J. L. Bullock, R. Hainje, A. Habib, D. Horton and D. M. Bullock, “Public Safety Implementation of Unmanned Aerial Systems for Photogrammetric Mapping of Crash Scenes,” Transportation Research Record, Vol.2673, No.7, pp.567-574, 2019.

[https://doi.org/10.1177/0361198119850804]

-

N. Carter, A. Hashemian and N. Mckelvey, “An Optimization of Small Unmanned Aerial System (sUAS) Image Based Scanning Techniques for Mapping Accident Sites,” SAE 2019-01-0427, 2019.

[https://doi.org/10.4271/2019-01-0427]

-

C. Cappelletti, M. Boniardi, A. Casaroli, C. I. De Gaetani, D. Passoni and L. Pinto, “Forensic Engineering Surveys With UAV Photogrammetry and Laser Scanning Techniques,” ISPRS - International Archives of the Photogrammetry, Remote Sensing and Spatial Information Sciences XLII-2/W9, pp.227-234, 2019.

[https://doi.org/10.5194/isprs-archives-XLII-2-W9-227-2019]

- J. Kim and B. Kim, “Analysis of Orthomosaic and DSM Generation Using an Assembled Small-sized Drone,” Journal of the Korean Society of Surveying, Geodesy, Photogrammetry and Cartography, Vol. 35, No.3, pp.195-202, 2017.

-

G. J. Fouche and R. Malekian, “Drone as an Autonomous Aerial Sensor System for Motion Panning,” Measurement, Vol.119, pp.142-155, 2018.

[https://doi.org/10.1016/j.measurement.2018.01.027]

-

Q. Xu, J. Li, W. Tao and D. Ming, “Efficient Large-scale Geometric Verification for Structure from Motion,” Pattern Recognition Letters, Vol. 125, pp.166-173, 2019.

[https://doi.org/10.1016/j.patrec.2018.09.028]

-

T. Hinzmann, J. L. Schőnberger, M. Pollefeys and R. Siegwart, “Mapping on the Fly: Real-Time 3D Dense Reconstruction, Digital Surface Map and Incremental Orthomosaic Generation for Unmanned Aerial Vehicles,” Field and Service Robotics, Springer Proceedings in Advanced Robotics, Vol.5, pp.383-396, 2018.

[https://doi.org/10.1007/978-3-319-67361-5_25]

-

Y. Li, B. Wu and X. Ge, “Structural Segmentation and Classification of Mobile Laser Scanning Point Clouds with Large Variations in Point Density,” RSPRS Journal of Photogrammetry and Remote Sensing, Vol.153, pp.151-165, 2019.

[https://doi.org/10.1016/j.isprsjprs.2019.05.007]

-

J. Park, J. Kim, W. Oh, J. Choi and J. Park, “Reliability Evaluation of EDR Data Using PC-Crash & Vbox,” Transactions of KSAE, Vol.25, No.3, pp.317-325, 2017.

[https://doi.org/10.7467/KSAE.2017.25.3.317]

-

W. Oh, J. Kim, J. Choi, Y. Ha, H. Park and J. Park, “A Study on the Coefficient of Restitution for Low-Speed Rear-end Vehicle Impacts,” Transactions of KSAE, Vol.25, No.5, pp.600-606, 2017.

[https://doi.org/10.7467/KSAE.2017.25.5.600]

-

S. Lim, J. Park, J. Kim, W. Oh, J. Choi and J. Park, “Analysis of Multi-Car Rear-End and Chain Reaction Collision Using EDR,” Transactions of KSAE, Vol.27, No.2, pp.101-108, 2019.

[https://doi.org/10.7467/KSAE.2019.27.2.101]